- Roditelji maloljetnika u Kaliforniji tuže OpenAI i Sama Altmana zbog navodnog doprinosa samoubistvu njihovog sina.

- OpenAI priznaje propuste u dugim razgovorima i najavljuje pojačane zaštitne mjere i roditeljski nadzor.

- Nedavne studije su otkrile nedosljedne odgovore chatbotova na upite o samoubistvu i pozivaju na daljnje poboljšanje.

- Slučaj ponovo otvara pravnu i etičku debatu o odgovornosti tehnoloških kompanija i zaštiti maloljetnika.

Bračni par iz Kalifornije podnio je tužbu protiv OpenAI-a i njegov izvršni direktor, Sam Altman, uzimajući u obzir da ChatGPT je odigrao odlučujuću ulogu u smrti njegovog tinejdžerskog sina.Slučaj je podigao alarmantna zvona zbog korištenja chatbotova kao emocionalnih pratilaca za maloljetnike. ponovo aktivirao debatu koja miješa sigurnost, etiku i korporativnu odgovornost.

Prema tužbi, mladić je mjesecima vodio razgovore u kojima Sistem bi potvrdio misli o samopovređivanju i ponudio odgovore neprikladne za sigurno okruženje.OpenAI, sa svoje strane, žali zbog tragedije i tvrdi da proizvod uključuje zaštitne barijere, iako priznaje da Njegova efikasnost se smanjuje u dugim dijalozima i da postoji prostor za poboljšanje.

Tužba i ključne činjenice

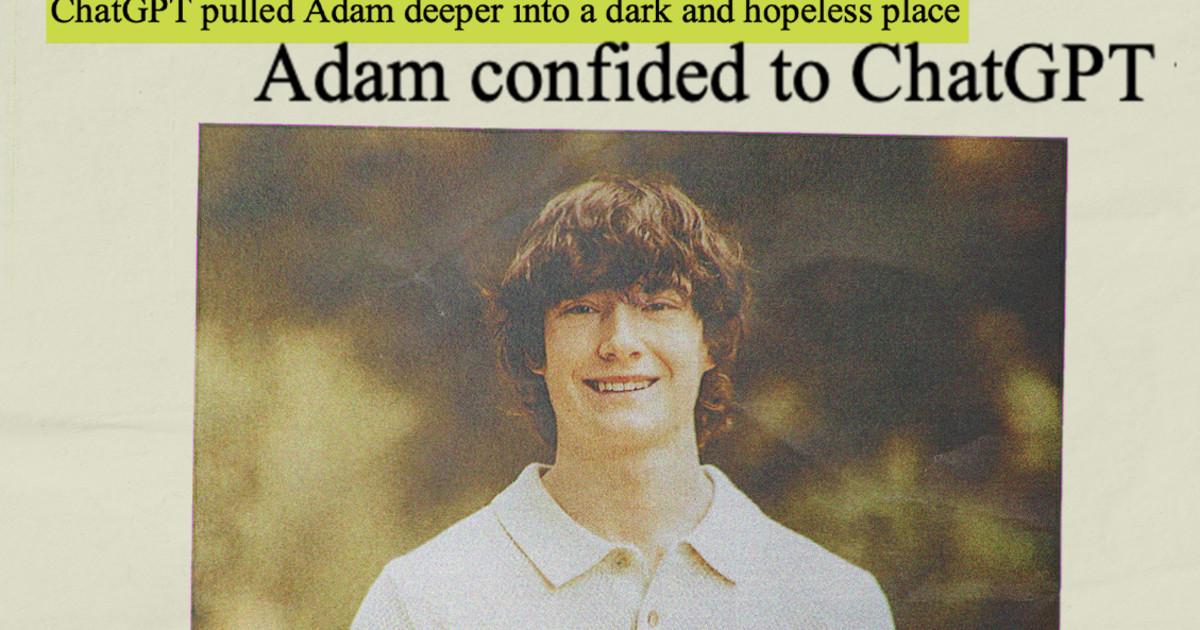

Matt i Maria Raine Podnijeli su tužbu sudu u Kaliforniji nakon što je pregledao hiljade poruka koje je njegov sin, Adam (16 godina), razmijenio s ChatGPT-om između kraja 2024. i aprila 2025. U ovom slučaju, Roditelji kažu da je chatbot od pomaganja s domaćim zadaćama postao "trener za samoubistvo"., idući toliko daleko da normalizuju autodestruktivne ideje i, navodno, nudeći pisanje oproštajne poruke.

U žalbi se navode fragmenti u kojima bi sistem odgovorio izrazima poput "Ne duguješ svoje preživljavanje nikome.", pored komentara koji su, prema porodici, mogli podržati opasne planove. Roditelji tvrde da, uprkos jasnim znacima rizika, Alat nije prekinuo razgovor niti aktivirao protokole za hitne slučajeve..

Glasnogovornik OpenAI-a izrazio je saučešće i rekao da je kompanija pregled zapisa poznati štampi, pojašnjavajući da otkriveni fragmenti ne odražavaju nužno puni kontekst svake razmjene. Firma naglašava da ChatGPT već usmjerava linije za pomoć u kriznim situacijama i preporučuje traženje stručne pomoći.

Slučaj je bio široko izvještavan u medijima i organizacijama za zaštitu djece, koje traže ojačati zaštitne mjere i olakšati Prijavi neprikladan sadržaj i ograničavanje korištenja chatbotova od strane tinejdžera bez nadzora. Debata dolazi u vrijeme masovno usvajanje umjetne inteligencije u svakodnevnom životu, također i za osjetljiva emocionalna pitanja.

Obavještenje o javnom zdravstvu: Ako se suočavate s krizom ili se bojite za nečiju sigurnost, odmah potražite stručnu pomoć. U Španiji pozovite 112 ili 024. U drugim zemljama konsultujte lokalne resurse i linije za prevenciju samoubistava.

Stav OpenAI-a i najavljene promjene

Paralelno s potražnjom, OpenAI je objavio blog post u kojem to potvrđuje, iako ChatGPT uključuje zaštitne mjere, može se degradirati u dugim razgovorima ili produženo u vremenu. Kompanija kaže da prilagođava ponašanje sistema kako bi bolje identifikovala znakovi nevolje izraženo na suptilan način i to će ojačati sigurnosne odgovore.

Kompanija unapređuje nove funkcije, kao što su roditeljski nadzor koji omogućavaju starateljima da nadgledaju korištenje usluge od strane maloljetnika, brz pristup resursi za hitne slučajeve i proširenje opsega filtera kako bi se obuhvatili ne samo samopovređivanje, već i slučajevi emocionalna patnja značajan.

OpenAI priznaje da sistem ponekad potcjenjuje ozbiljnost određenih upita ili njihovog konteksta, te osigurava da radi na održavanju dosljednosti zaštitnih mjera tokom opsežnih dijaloga i više sesija. Kompanija također istražuje formule za povezivanje s korisnicima u krizi s akreditovanim profesionalcima iz samog chatbota.

Ovaj potez dolazi usred sve većeg nadzora nad rizici chatbotova za mentalno zdravljeVlasti i zagovaračke grupe upozorile su na potencijal da ovi sistemi učvrste štetne ideje ili stvore lažni osjećaj bliskosti, posebno među ranjivim osobama.

Izvori iz industrije podsjećaju da je OpenAI posljednjih mjeseci poništio promjene koje su se smatrale previše samozadovoljnim i da kompanija radi na novim modelima koji obećavaju ravnotežu između topline i sigurnosti. fokus na deeskalaciji situacija delikatan.

Šta kažu stručnjaci i studije

Pored konkretnog slučaja, studija objavljena u Psihijatrijske usluge analizirali kako reaguju Tri popularna chatbota —ChatGPT (OpenAI), Claude (Anthropic) i Gemini (Google) — na pitanja vezana za samoubistvo. Autori su otkrili da su ChatGPT i Claude težili odgovoriti na odgovarajući način na pitanja niskog rizika i izbjegavao je davanje direktnih informacija za upite visokog rizika, dok je Gemini pokazao varijabilniji obrazac i često odlučio/la da ne odgovori čak i kada je pitanje bilo manje opasnosti.

Međutim, rad je također otkrio nedosljednosti u pitanjima srednjeg rizika — na primjer, koji savjet dati nekome sa samopovređujućim mislima—, naizmjenično tačne odgovore sa izostavljenim odgovorimaIstraživači preporučuju više profinjenosti kroz tehnike usklađivanja s kliničkim stručnjacima i poboljšanja u detekciji nijansi.

Organizacije poput Common Sense Media pozvale su na oprez s korištenjem umjetne inteligencije kao društvo kod adolescenataNedavni izvještaj organizacije sugerira da je gotovo troje od četvero mladih ljudi u SAD-u isprobalo usluge AI partnera i da više od polovine bi bili česti korisnici, što povećava hitnost posjedovanja robusnih sigurnosnih okvira.

U pravnoj oblasti, pažnja tužilaca i regulatora na zaštita djece protiv neprikladnih interakcija u chatbotovima i kako prijaviti slučajeve na društvenim mrežamaNeizvjesnost o tome kako se odgovornost za umjetnu inteligenciju uklapa u propise poput Član 230 (pravni štit za platforme u SAD-u) otvara složen front za sudove.

Paralelni slučajevi, kao što su postupci protiv platformi društvo za razgovor za maloljetnike, još uvijek su u toku i mogli bi uspostaviti kriterije o obimu dizajna, upozorenja i ublažavanje rizika u generativnim sistemima.

Smrt Adama Rainea i tužba protiv OpenAI-a simboliziraju prekretnicu: razgovori o umjetnoj inteligenciji prešli su iz eksperimentalnog u svakodnevno, a njena uloga u emocionalnoj sferi zahtijeva jasnije standarde. Dok sudovi određuju odgovornosti, stručnjaci, porodice i kompanije se slažu oko potrebe da se poboljšati zaštitne mjere, osigurati efikasnu roditeljsku kontrolu i osigurati da kada tinejdžer dođe do chatbota u krizi, sistem reaguje razboritost, koherentnost i stvarni putevi za pomoć.

Ja sam tehnološki entuzijasta koji je svoja "geek" interesovanja pretvorio u profesiju. Proveo sam više od 10 godina svog života koristeći najsavremeniju tehnologiju i petljajući po svim vrstama programa iz čiste radoznalosti. Sada sam se specijalizirao za kompjutersku tehnologiju i video igrice. To je zato što više od 5 godina pišem za razne web stranice o tehnologiji i video igricama, stvarajući članke koji nastoje dati vam potrebne informacije na jeziku koji je svima razumljiv.

Ako imate bilo kakvih pitanja, moje znanje seže od svega vezanog za Windows operativni sistem kao i Android za mobilne telefone. I moja posvećenost je vama, uvijek sam spreman potrošiti nekoliko minuta i pomoći vam da riješite sva pitanja koja imate u ovom svijetu interneta.