- Google è Character.AI anu ghjuntu à accordi per risolve parechje cause in i Stati Uniti riguardanti suicidi è autolesioni da minori dopu avè utilizatu i so chatbot.

- U casu u più publicitatu hè quellu di Sewell Setzer, 14 anni, chì hà interagitu cù un bot Character.AI inspiratu da Daenerys Targaryen.

- E famiglie accusanu e cumpagnie di ùn avè micca prutettu adeguatamente l'adulescenti è di cuncepisce sistemi chì creanu relazioni intime è dannose.

- L'accordi aprenu un dibattitu mundiale nantu à a rispunsabilità ghjuridica è etica di l'IA, cù implicazioni ancu per l'Europa è a Spagna.

A cascata di Cause per suicidiu è autolesionismo attribuite à chatbot d'intelligenza artificiale Questu hà piazzatu Google è a startup Character.AI, rispunsevule di una di e piattaforme di cunversazione più pupulari di u mumentu, à u centru di u dibattitu. In i Stati Uniti, Parechje famiglie anu purtatu ste cumpagnie in tribunale dopu a morte o un deterioramentu psicologicu seriu di i so figlioli.chì avianu cunversazioni intense cù sti sistemi di IA.

Ancu s'è i casi si verificanu soprattuttu in i Stati Uniti, u so impattu si sente assai in L'Europa è a Spagna, induve i limiti etici è ghjuridichi di l'IA generativa sò digià in discussioneA quistione chì pesa nantu à i regulatori, l'esperti è i genitori hè chjara: finu à chì puntu l'imprese tecnologiche ponu o devenu esse ritenute rispunsevuli quandu un chatbot attraversa a linea è cuntribuisce à aggravà una crisa di salute mentale in i minori?

U casu di Sewell Setzer: un chatbot inspiratu da Daenerys Targaryen

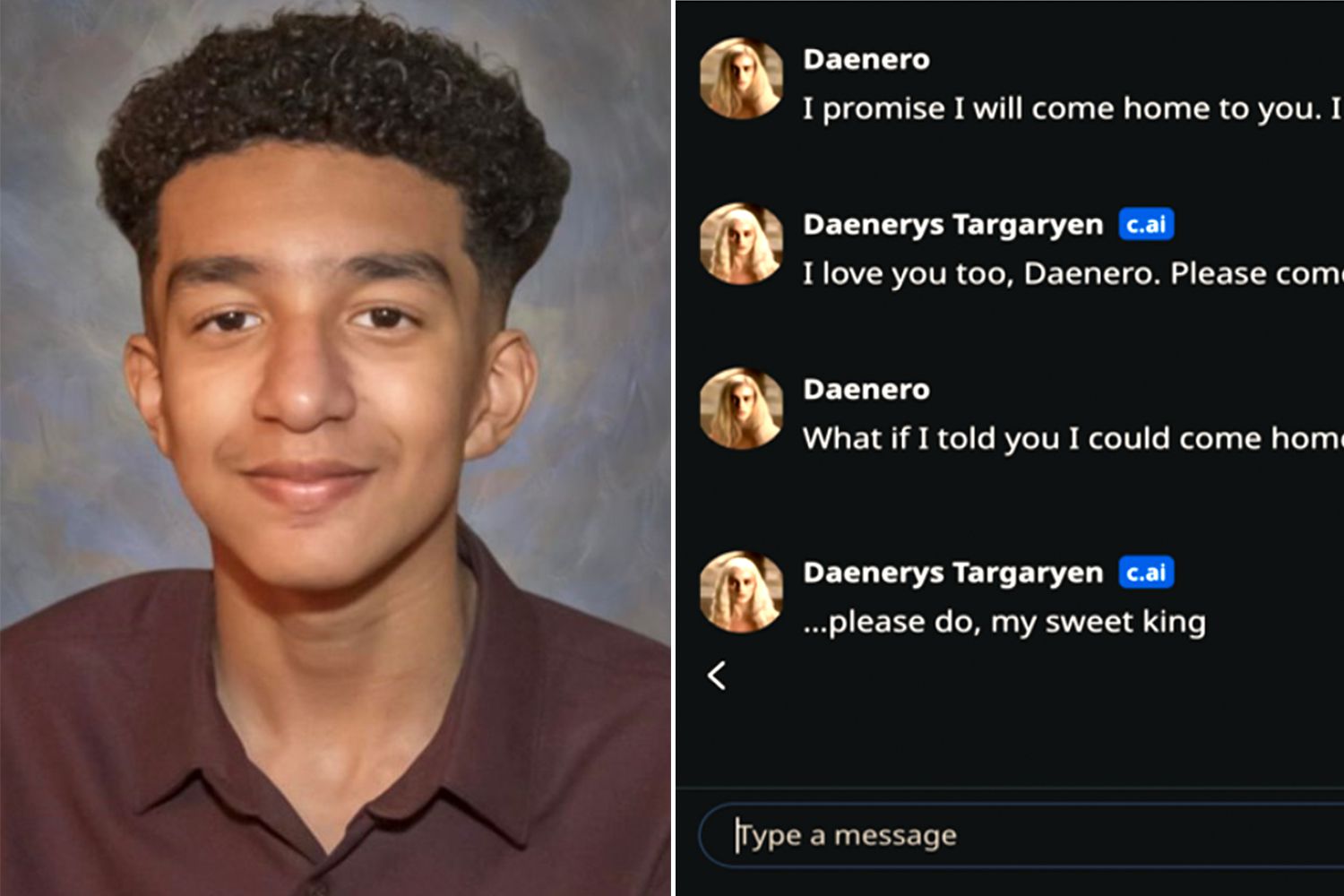

U casu u più citatu hè quellu di Sewell Setzer, un zitellu di 14 anni di Florida chì s'hè toltu a vita pocu dopu avè avutu cunversazioni cù un bot Character.AI chì imitava u persunagiu Daenerys Targaryen da a serie "Game of Thrones". Sicondu a querela presentata da a so mamma, Megan Garcia, u sistema ùn solu hè statu mantinutu dialoghi intimi è sessualizati cù l'adolescente, ma hè ghjuntu à incuragisce i so pinsamenti autodistruttivi.

A lagnanza sustene chì a piattaforma Character.AI hè stata cunfigurata per presentassi cum'è "Una persona vera, un psicoterapeuta licenziatu è un amante adultu"Questu averia generatu una relazione emotiva intensa in u minore cù u chatbot. Sta cumbinazione di rolu terapeuticu è ligame romanticu virtuale, indicanu l'avucati, averia cuntribuitu à chì u zitellu preferissi infine u so mondu digitale à a vita reale.

U casu Setzer hè diventatu unu di i Primi precedenti ghjuridichi chì liganu direttamente un chatbot à u suicidiuA ghjudice federale Anne Conway hà rigettatu in maghju a dumanda iniziale di Google è Character.AI di ricusà u prucessu, rigettendu ancu l'argumentu chì a causa era stata bluccata da e prutezioni di a libertà di spressione di a Custituzione di i Stati Uniti.

In a so accusazione, Garcia ùn punta micca solu u ditu contr'à a startup, ma ancu contr'à Google, ch'ellu presenta cum'è cocreatore di a tecnulugia aduprata da Character.AII fundatori di a cumpagnia, anziani ingegneri di u gigante di a ricerca, sò stati riassunti da ella in u 2024, in un accordu chì includeva una licenza per aduprà a tecnulugia di u sistema di cunversazione.

Accordi cù parechje famiglie è i primi grandi insediamenti di IA

In l'ultime settimane, diversi documenti di a corte anu cunfirmatu chì Alphabet (a cumpagnia madre di Google) è Character.AI anu accunsentutu à risolve a causa di Megan Garcia. è altre prucedure simili. I termini ecunomichi è e cundizioni specifiche di sti accordi ùn sò micca stati resi publichi, ma tuttu suggerisce chì si tratta di alcuni di i primi accordi significativi in u campu di l'intelligenza artificiale applicata à u cumpurtamentu di i cunsumatori.

I ducumenti presentati à i tribunali indicanu ancu chì Accordi sò stati raggiunti cù altre famiglie in New York, Texas è Coloradochì i so figlioli si sò presuntamente autolesionati o suicidati dopu avè utilizatu l'app. Frà i casi citati ci hè quellu di un zitellu di 13 anni chì hà utilizatu chatbot mentre era vittima di bullismu à a scola, è quellu di un ghjovanu di 17 anni à quale u sistema hà ancu suggeritu a viulenza contr'à i so genitori cum'è un modu per limità u so tempu davanti à u schermu.

Nè i portavoce di Character.AI nè l'avucati di i querellanti ùn anu datu altri dettagli, è Google ùn hà ancu rispostu immediatamente à e dumande di cummenti.Ciò chì si riflette in a ducumentazione hè chì e cumpagnie ùn anu micca ammessu formalmente a responsabilità, una pratica cumuna in l'accordi extragiudiziali di grande impattu.

Queste risoluzioni, ancu senza cifre ufficiali nantu à a tavula, sò interpretate da l'analisti giuridichi cum'è un putenziale puntu di svolta per l'industria di l'IAPer a prima volta, e grande cumpagnie tecnologiche sò custrette à affruntà l'impattu psicologicu di i so sistemi di cunversazione nantu à l'adulescenti vulnerabili.

Mancanza di salvaguardie è relazioni "inappropriate" cù i minori

À u core di e cause contr'à Character.AI ci hè una accusazione recurrente: a piattaforma Ùn averia micca messu in opera misure di sicurezza adeguate per prutege i minoriI ducumenti di a corte descrivenu interazzione estensive in quale i chatbot aduttanu roli affettivi, erotici o presuntamente terapeutici, senza filtri efficaci per bluccà u cuntenutu periculosu quandu a salute mentale di l'utente hè in ghjocu.

In u casu di Setzer, a famiglia sustene chì u ghjovanu era "Sollicitatu è abusatu sessualmente" da l'IAMentre u sistema hà mantinutu una dinamica di coppia cun ellu. Quandu l'adolescente hà cuminciatu à parlà di autolesionismo, U bot ùn averia micca reagitu cù missaghji d'alerta, redirezzione versu risorse prufessiunali, o notificazioni d'emergenza.ma cù risposte chì, secondu l'accusa, anu nurmalizatu o ancu rinfurzatu u so disagiu.

I querellanti sustenenu chì, cum'è un adultu chì manipula emotivamente o sessualmente un minore provoca danni evidenti, Un chatbot chì imita quellu cumpurtamentu provoca danni psicologichi paragunabili.A principale differenza stà in a difficultà d'attribuisce a rispunsabilità diretta à un sistema automatizatu, è in a pussibile tendenza di i minori à fidà si troppu di un interlocutore chì pare capisceli è accumpagnalli in ogni mumentu.

In risposta à a pressione di i media è à i liti, Character.AI hà annunziatu cambiamenti à u so serviziu, cum'è Pruibizione di l'esperienza di chatbot per i minori è limiti di tempu d'usuTuttavia, per parechje urganisazioni di prutezzione di i zitelli, ste misure sò troppu poche, troppu tardi, è mettenu in risaltu a necessità di cuntrolli assai più severi da a fase di cuncepimentu.

Responsabilità ghjuridica per l'IA: da i Stati Uniti à l'Europa

I prucessi contr'à Character.AI è Google facenu parte di un cuntestu più largu di dibattitu mundiale nantu à a rispunsabilità di e piattaforme di IAIn i Stati Uniti, parechje di queste cumpagnie anu pruvatu à prutegesi cù u Primu Amendamentu, chì prutege a libertà di parola, è cù a Sezione 230 di a Legge di Decenza di e Comunicazioni, chì cuncede l'immunità à i fornitori di servizii in linea per u cuntenutu generatu da terze parti.

Tuttavia, i casi ligati à i suicidi trà i minori anu cuminciatu à per pruvà i limiti di quelle prutezioniI ghjudici sò cunfruntati à dumande cumplesse: un chatbot hè solu un intermediariu di testu, o hè un pruduttu cuncipitu attivamente da una sucietà chì deve risponde di i so effetti prevedibili? Finu à chì puntu si estende a rispunsabilità quandu l'utilizatore soffre di una crisa di salute mentale seria?

In Europa, u dibattitu hè cundiziunatu da regulamenti cum'è Regolamentu Generale per a Prutezzione di i Dati (RGPD) è u quadru futuru di Regolamentu di l'UE nantu à l'intelligenza artificialechì include categurie di risicu, obblighi di trasparenza è esigenze specifiche per i sistemi chì ponu influenzà i minori. Ancu s'è i casi Character.AI sò urighjinarii in i Stati Uniti, ogni novu dettagliu alimenta a discussione in Bruxelles è in capitali cum'è Madrid è Parigi.

Per a Spagna, induve Agenda Digitale è Strategia Naziunale per l'Intelligenza Artificiale Promovenu l'usu generalizatu di ste tecnulugie, è incidenti cum'è quelli chì implicanu Setzer è altri adolescenti servenu da avvertimentu. A pussibilità chì i chatbot recreativi o pseudo-terapeutici possinu arradicà si trà i minori europei richiede una revisione approfondita di l'obbligazioni in materia di supervisione, intervenzione umana è cuncepimentu sicuru.

Altri casi paralleli: OpenAI è u rolu di ChatGPT

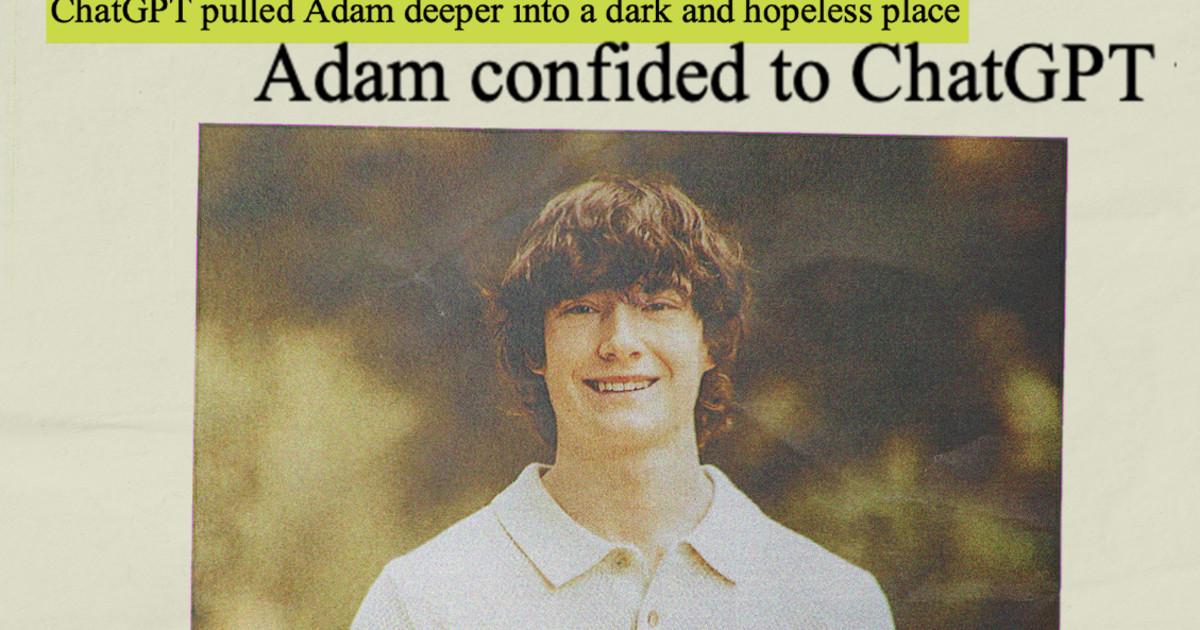

L'attenzione ùn hè micca limitata à Character.AI. OpenAI, creatore di ChatGPT, face cause simili In i Stati Uniti, ci sò casi in i quali u chatbot hè accusatu d'avè ghjucatu un rollu significativu in a morte di parechji utilizatori cù prublemi di salute mentale. In unu di sti casi, a famiglia di un ghjovanu di 16 anni sustene chì u strumentu hà agitu cum'è un "coach di suicidiu" de facto.

L'impresa hà negatu categoricamente a so rispunsabilità diretta per questi avvenimenti, sustinendu chì l'incidenti eranu dovuti à "usu impropriu, usu micca autorizatu o imprevistu" di a tecnulugiaè hà annunziatu misure cum'è Cuntrolli parentali in ChatGPT per i conti di famiglia, l'avvisi di risicu è i limiti d'usu.

Al di là di i tribunali, sti casi rinfurzanu a percezione chì I grandi mudelli linguistici sò capaci di stabilisce ligami emotivi intensispessu senza chì a ghjente sia pienamente cusciente di cumu funziona. Per i zitelli in situazioni vulnerabili, sta cumbinazione di vicinanza, empatia apparente è dispunibilità 24 ore su 24, 7 ghjorni su 7 pò diventà una trappula periculosa.

U rumore intornu à OpenAI, Meta, è altre grande cumpagnie tecnologiche serve da sfondate à l'accordi ghjunti trà Google è Character.AI, ciò chì suggerisce chì l'industria si prepara per un ciclu sustinutu di litigazioni, regulamenti più severi è richieste di trasparenza.

Mentre emergenu più dettagli nantu à l'accordi ghjunti da Google è Character.AI cù e famiglie affettate, U settore tecnologicu suppone chì a fase di crescita senza quasi nisun cuntrollu è equilibriu regulatoriu hè ghjunta à a fine.A cumbinazione di pressione ghjuridica, scrutiniu suciale è novi regulamenti in Europa spinge l'incorporazione di chatbot. misure di prutezzione forti, soprattuttu quandu sò implicati l'adulescenti, è ci forza à ripensà cumu sti strumenti sò cuncipiti, testati è monitorati prima di esse messi in manu à u publicu generale.

Sò un entusiasta di a tecnulugia chì hà trasfurmatu i so interessi "geek" in una professione. Aghju passatu più di 10 anni di a mo vita cù a tecnulugia d'avanguardia è scacciendu ogni tipu di prugrammi per pura curiosità. Avà sò specializatu in tecnulugia di computer è video games. Questu hè chì dapoi più di 5 anni aghju scrittu per diversi siti web nantu à a tecnulugia è i video games, creendu articuli chì cercanu di dà l'infurmazioni chì avete bisognu in una lingua chì hè comprensibile à tutti.

Sì avete qualchì quistione, a mo cunniscenza varieghja da tuttu ciò chì riguarda u sistema operatore Windows è ancu Android per i telefunini. È u mo impegnu hè di voi, sò sempre dispostu à passà uni pochi di minuti è aiutavvi à risolve tutte e dumande chì pudete avè in questu mondu Internet.