- SAM 3 führt die Bild- und Videosegmentierung ein, die durch Text- und visuelle Beispiele geleitet wird und über ein Vokabular von Millionen von Konzepten verfügt.

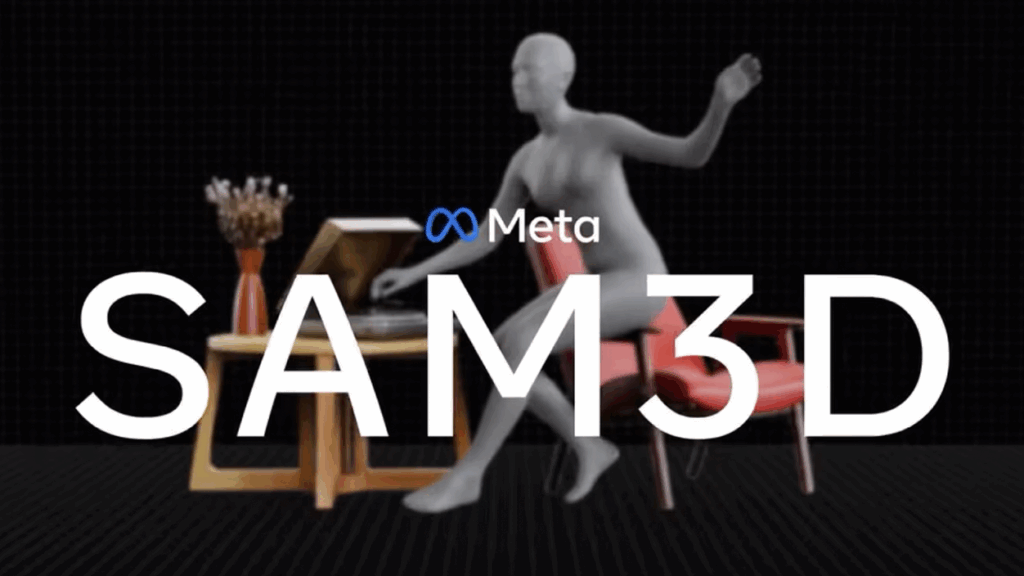

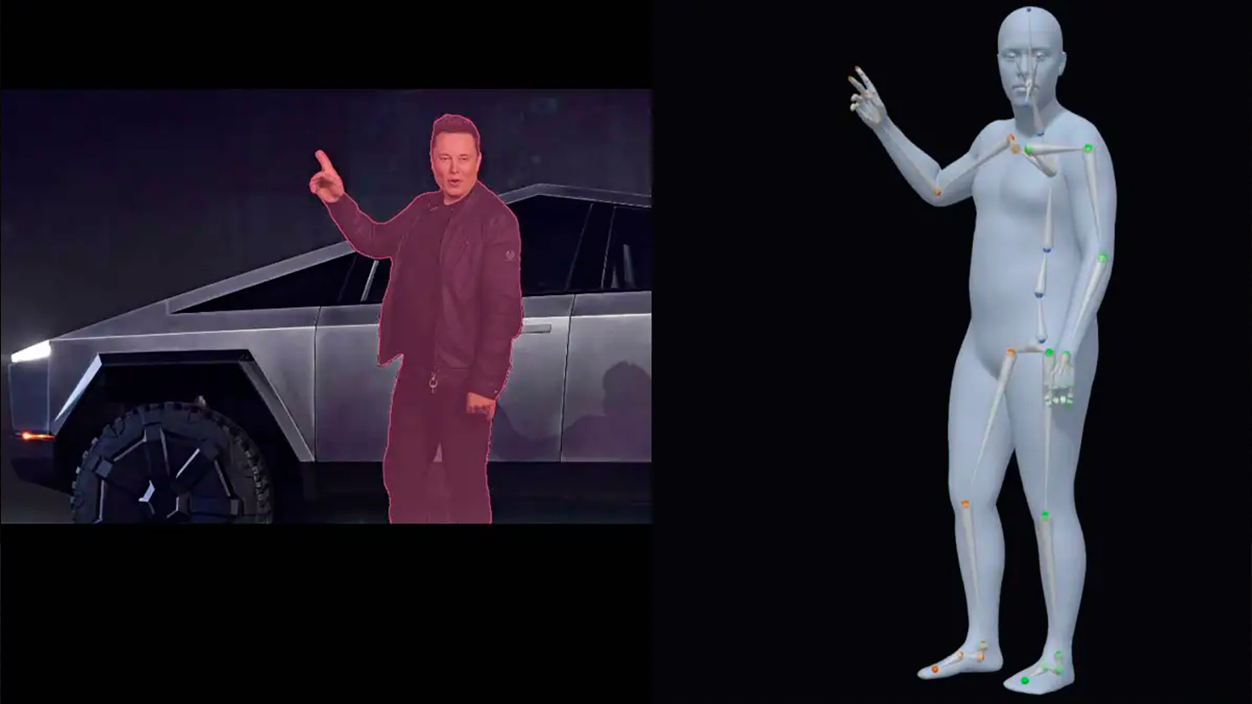

- Mit SAM 3D können Sie Objekte, Szenen und menschliche Körper aus einem einzigen Bild mithilfe offener Modelle in 3D rekonstruieren.

- Modelle können im Segment Anything Playground mithilfe praktischer und kreativer Vorlagen auch ohne technische Vorkenntnisse getestet werden.

- Meta veröffentlicht Gewichtungen, Prüfpunkte und neue Benchmarks, damit Entwickler und Forscher in Europa und dem Rest der Welt diese Funktionen in ihre Projekte integrieren können.

Meta hat einen weiteren Schritt in seinem Engagement unternommen Künstliche Intelligenz angewendet auf Computer Vision mit Markteinführung von SAM 3 und SAM 3D, zwei Modelle, die die Segment Anything-Familie erweitern und die Sie wollen die Art und Weise verändern, wie wir mit Fotos und Videos arbeiten.Das Unternehmen möchte, dass diese Werkzeuge nicht nur ein Laborexperiment bleiben, sondern sowohl von Fachleuten als auch von Anwendern ohne technischen Hintergrund genutzt werden.

Mit dieser neuen Generation konzentriert sich Meta auf Verbesserung der Objekterkennung und -segmentierung und indem sie die dreidimensionale Rekonstruktion für ein viel breiteres PublikumVon Videobearbeitung bis hin zur Produktvisualisierung für den E-Commerce in Spanien und dem übrigen Europa – das Unternehmen stellt sich ein Szenario vor, in dem Es genügt, wenn Sie in Worten beschreiben, was Sie tun möchten, damit die KI den Großteil der Arbeit erledigen kann..

Was bietet SAM 3 im Vergleich zu früheren Versionen?

SAM 3 ist als direkte Weiterentwicklung positioniert von den Segmentierungsmodellen, die Meta in den Jahren 2023 und 2024 vorstellte und die als SAM 1 und SAM 2 bekannt sind. Diese frühen Versionen konzentrierten sich darauf, zu identifizieren, welche Pixel zu welchem Objekt gehören, hauptsächlich mithilfe visueller Hinweise wie Punkte, Kästchen oder Masken, und im Falle von SAM 2 darauf, Objekte in einem Video nahezu in Echtzeit zu verfolgen.

Die wichtigste Neuerung ist nun, dass SAM 3 versteht reichhaltige und präzise Textvorgabennicht nur allgemeine Bezeichnungen. Während zuvor einfache Begriffe wie „Auto“ oder „Bus“ verwendet wurden, ist das neue Modell in der Lage, auf viel spezifischere Beschreibungen zu reagieren, zum Beispiel „gelber Schulbus“ oder „rotes Auto in zweiter Reihe geparkt“.

In der Praxis bedeutet dies, dass es ausreicht, etwa Folgendes zu schreiben: „rote Baseballkappe“ So kann das System alle Elemente, die dieser Beschreibung entsprechen, in einem Bild oder Video finden und trennen. Diese Möglichkeit, die Beschreibung mit Worten zu verfeinern, ist besonders nützlich in professionelle Bearbeitungskontexte, Werbung oder Inhaltsanalyse, wo man oft auf sehr spezifische Details achten muss.

Darüber hinaus wurde SAM 3 so konzipiert, dass es sich integrieren lässt mit große multimodale SprachmodelleDies ermöglicht es Ihnen, über einfache Formulierungen hinauszugehen und komplexe Anweisungen zu verwenden, wie zum Beispiel: „Leute, die sitzen, aber keine rote Kappe tragen“ oder „Fußgänger, die in die Kamera schauen, aber keinen Rucksack tragen“. Diese Art von Anweisung kombiniert Bedingungen und Ausschlusskriterien, die bis vor Kurzem schwer in ein Computer-Vision-Tool zu übersetzen waren.

Leistungsfähigkeit und Skalierbarkeit des SAM 3-Modells

Meta wollte außerdem den weniger sichtbaren, aber entscheidenden Teil hervorheben: den technische Leistungsfähigkeit und Wissensskala des Modells. Laut Unternehmensangaben ist SAM 3 in der Lage, ein einzelnes Bild mit mehr als einhundert erkannten Objekten in etwa 30 Millisekunden mit einer H200-GPU zu verarbeiten – eine Geschwindigkeit, die den Anforderungen anspruchsvoller Arbeitsabläufe sehr nahe kommt.

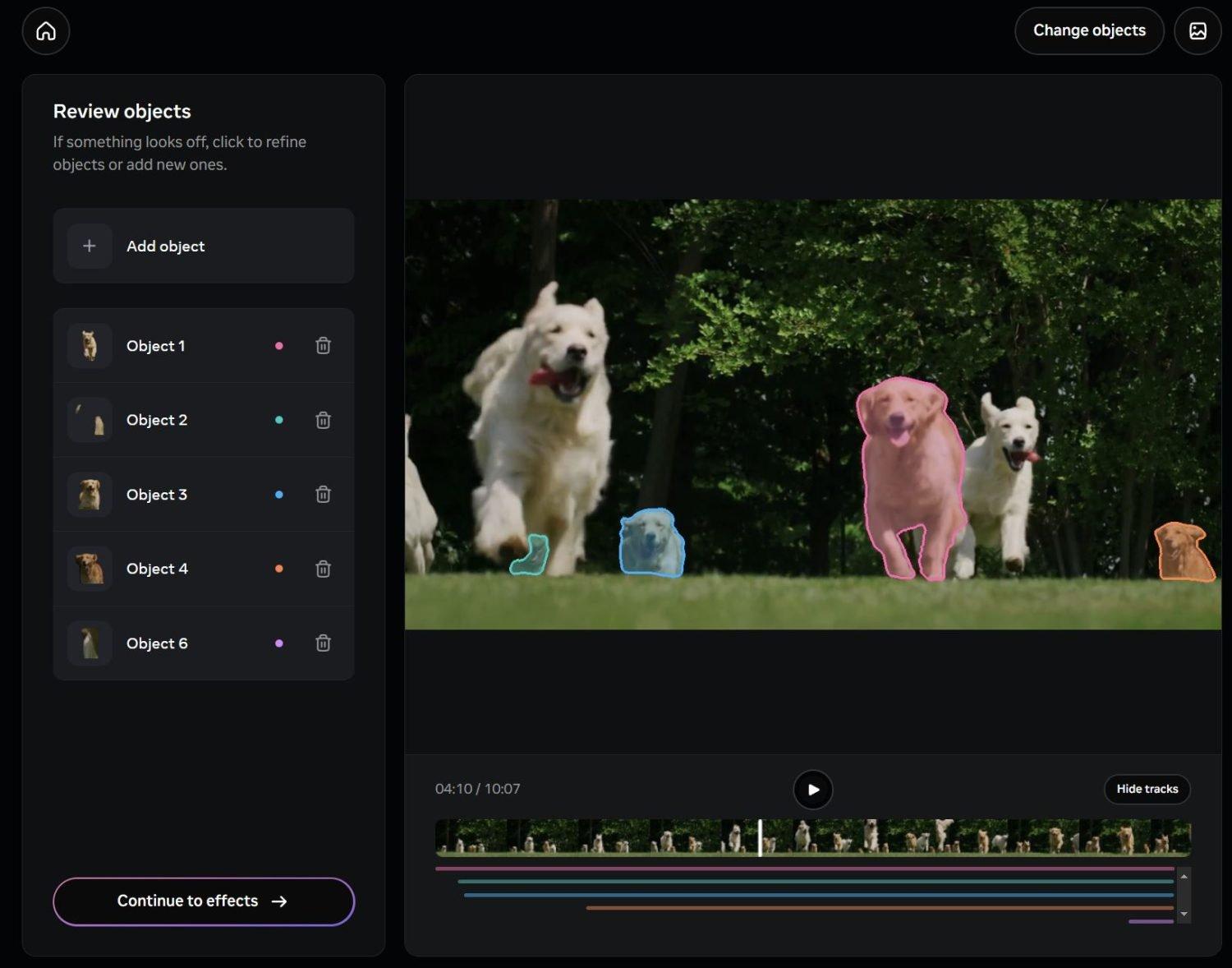

Im Falle des Videos versichert das Unternehmen, dass das System seine Leistungsfähigkeit beibehält. praktisch in Echtzeit Bei der Arbeit mit etwa fünf gleichzeitigen Objekten ist es möglich, bewegte Inhalte zu verfolgen und zu segmentieren, von kurzen Social-Media-Clips bis hin zu ambitionierteren Produktionsprojekten.

Um dieses Verhalten zu erreichen, hat Meta eine Trainingsbasis mit mehr als 4 Millionen einzigartige KonzepteDurch die Kombination menschlicher Annotatoren mit KI-Modellen zur Kennzeichnung großer Datenmengen zielt diese Mischung aus manueller und automatisierter Überwachung darauf ab, Genauigkeit und Skalierbarkeit in Einklang zu bringen – ein Schlüsselfaktor, um sicherzustellen, dass das Modell auf unterschiedliche Eingaben in europäischen, lateinamerikanischen und anderen Marktkontexten gut reagiert.

Das Unternehmen ordnet SAM 3 in das ein, was es nennt Segment Anything CollectionEine Reihe von Modellen, Benchmarks und Ressourcen zur Erweiterung des visuellen Verständnisses von KI. Die Veröffentlichung wird von einem neuen Benchmark für die Segmentierung mit „offenem Vokabular“ begleitet, der darauf abzielt, zu messen, inwieweit das System nahezu jedes in natürlicher Sprache ausgedrückte Konzept verstehen kann.

Integration mit Edits, Vibes und anderen Meta-Tools

Über die technische Komponente hinaus hat Meta bereits damit begonnen, SAM 3 in spezifische Produkte integrieren die für den täglichen Gebrauch bestimmt sind. Eines der ersten Ziele wird Edits sein., ihrer Anwendung zur Videoerstellung und -bearbeitung, bei der die Idee darin besteht, dass der Benutzer bestimmte Personen oder Objekte mit einer einfachen Textbeschreibung auswählen und Effekte, Filter oder Änderungen nur auf diese Teile des Filmmaterials anwenden kann.

Ein weiterer Integrationsweg wird sich finden in Vibes, innerhalb der Meta AI App und der Meta.ai PlattformIn diesem Umfeld wird die Textsegmentierung mit generativen Werkzeugen kombiniert, um neue Bearbeitungs- und kreative Erlebnisse zu schaffen, wie z. B. benutzerdefinierte Hintergründe, Bewegungseffekte oder selektive Fotomodifikationen, die für soziale Netzwerke entwickelt wurden, die in Spanien und dem übrigen Europa sehr beliebt sind.

Das Unternehmen schlägt vor, diese Fähigkeiten nicht auf Berufsstudiengänge zu beschränken, sondern sie vielmehr auszuweiten... unabhängige Kreative, kleine Agenturen und fortgeschrittene Nutzer Für alle, die täglich mit visuellen Inhalten arbeiten, verkürzt die Möglichkeit, Szenen durch Beschreibungen in natürlicher Sprache zu segmentieren, die Einarbeitungszeit im Vergleich zu herkömmlichen Werkzeugen, die auf manuellen Masken und Ebenen basieren.

Gleichzeitig pflegt Meta einen offenen Ansatz gegenüber externen Entwicklern, was darauf hindeutet, dass Anwendungen von Drittanbietern Von Bearbeitungswerkzeugen bis hin zu Lösungen für Videoanalysen im Einzelhandel oder im Sicherheitsbereich – auf SAM 3 kann man sich verlassen, solange die Nutzungsrichtlinien des Unternehmens eingehalten werden.

SAM 3D: Dreidimensionale Rekonstruktion aus einem Einzelbild

Die andere große Neuigkeit ist SAM 3Dein System, das für die Durchführung entwickelt wurde Dreidimensionale Rekonstruktionen Ausgehend von 2D-Bildern. Anstatt mehrere Aufnahmen aus verschiedenen Winkeln zu benötigen, zielt das Modell darauf ab, aus einem einzigen Foto eine zuverlässige 3D-Darstellung zu generieren, was insbesondere für diejenigen interessant ist, die keine spezialisierte Scanausrüstung oder Arbeitsabläufe besitzen.

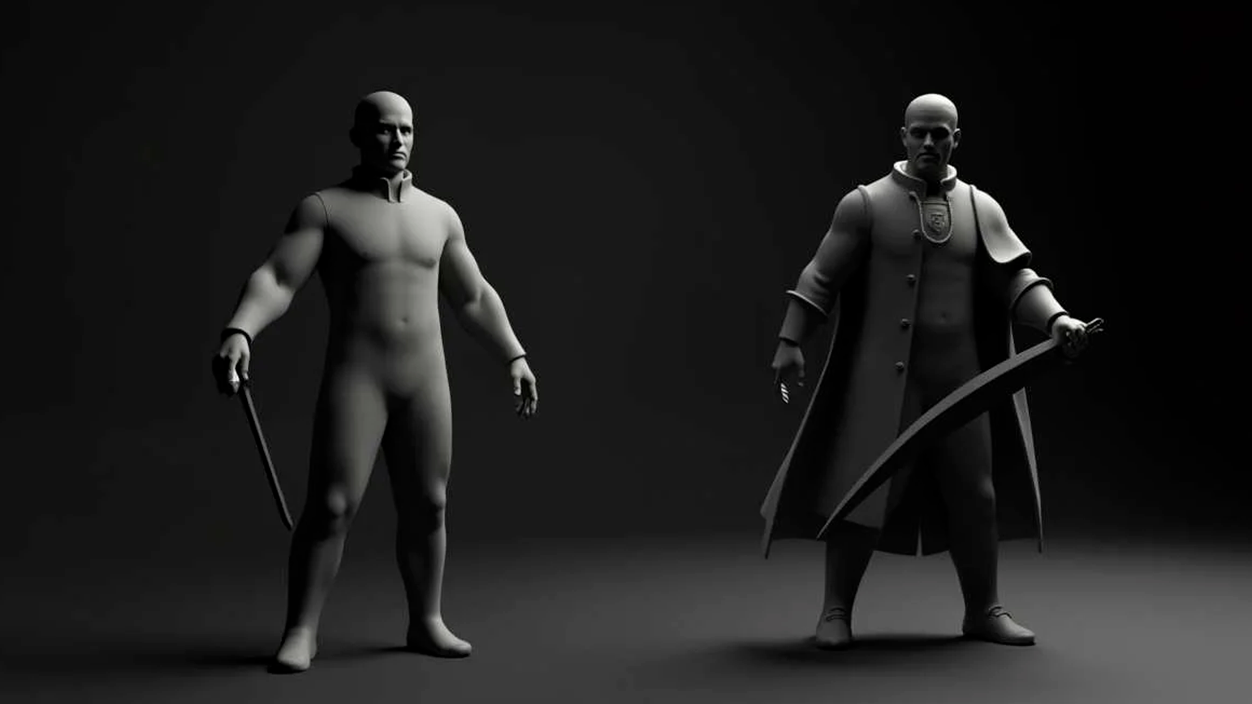

SAM 3D besteht aus zwei Open-Source-Modellen mit unterschiedlichen Funktionen: SAM 3D-Objektekonzentrierte sich auf die Rekonstruktion von Objekten und Szenen, und SAM 3D-KörperEs ist darauf ausgelegt, die menschliche Form und den Körperbau zu erfassen. Diese Trennung ermöglicht es, das System an sehr unterschiedliche Anwendungsfälle anzupassen, von Produktkatalogen bis hin zu Gesundheits- oder Sportanwendungen.

Laut Meta kennzeichnet SAM 3D Objects ein Neuer Leistungsmaßstab in der KI-gestützten 3D-RekonstruktionDie neuen Methoden übertreffen bisherige Verfahren in wichtigen Qualitätskriterien deutlich. Um die Ergebnisse genauer zu bewerten, hat das Unternehmen gemeinsam mit Künstlern SAM 3D Artist Objects entwickelt – einen Datensatz, der speziell für die Beurteilung der Genauigkeit und Detailtreue von Rekonstruktionen verschiedenster Bilder und Objekte konzipiert wurde.

Dieser Fortschritt eröffnet die Tür zu praktischen Anwendungen in Bereichen wie zum Beispiel Robotik, Wissenschaft, Sportmedizin oder digitale KreativitätIn der Robotik kann es beispielsweise Systemen helfen, das Volumen der Objekte, mit denen sie interagieren, besser zu verstehen; in der medizinischen oder sportwissenschaftlichen Forschung kann es bei der Analyse von Körperhaltung und Bewegung helfen; und im kreativen Design dient es als Grundlage für die Generierung von 3D-Modellen für Animationen, Videospiele oder immersive Erlebnisse.

Eine der ersten bereits sichtbaren kommerziellen Anwendungen ist die Funktion "Aussicht im Zimmer" de Facebook MarktplatzDadurch können Sie sich vor dem Kauf vorstellen, wie ein Möbelstück oder ein Dekorationsobjekt in einem realen Raum aussehen würde. Mit SAM 3D Meta ist bestrebt, diese Art von Erlebnissen zu perfektionieren.Dies ist besonders relevant für den europäischen E-Commerce, wo die Rücksendung von Produkten aufgrund nicht erfüllter Erwartungen einen zunehmenden Kostenfaktor darstellt.

Segment Anything Playground: eine Umgebung zum Experimentieren

Um der Öffentlichkeit das Testen dieser Funktionen ohne Installation zu ermöglichen, hat Meta die folgenden Funktionen aktiviert: Segment Anything PlaygroundEs handelt sich um eine Webplattform, auf der man Bilder oder Videos hochladen und direkt im Browser mit SAM 3 und SAM 3D experimentieren kann. Die Idee dahinter ist, dass jeder, der sich für visuelle KI interessiert, die Möglichkeiten ohne Programmierkenntnisse erkunden kann.

Im Fall von SAM 3 ermöglicht der Playground die Segmentierung von Objekten mithilfe von kurze Sätze oder detaillierte AnweisungenDurch die Kombination von Text und, falls gewünscht, visuellen Beispielen werden gängige Aufgaben vereinfacht, wie beispielsweise die Auswahl von Personen, Autos, Tieren oder bestimmten Elementen der Szene und die Anwendung spezifischer Aktionen darauf, von ästhetischen Effekten bis hin zu Unschärfe oder Hintergrundaustausch.

Bei der Arbeit mit SAM 3D ermöglicht die Plattform Folgendes: Erkunden Sie Szenen aus neuen Perspektiven.Objekte neu anordnen, dreidimensionale Effekte anwenden oder alternative Ansichten generieren. Für alle, die in den Bereichen Design, Werbung oder 3D-Content arbeiten, bietet es eine schnelle Möglichkeit, Ideen zu prototypisieren, ohne von Anfang an auf komplexe technische Werkzeuge zurückgreifen zu müssen.

Der Spielplatz umfasst auch eine Reihe von gebrauchsfertige Vorlagen Diese Funktionen sind auf sehr spezifische Aufgaben zugeschnitten. Dazu gehören praktische Optionen wie das Verpixeln von Gesichtern oder Nummernschildern aus Datenschutzgründen sowie visuelle Effekte wie Bewegungsspuren, selektive Hervorhebungen oder das Fokussieren auf interessante Bereiche im Video. Solche Funktionen eignen sich besonders gut für die Arbeitsabläufe von digitalen Medienschaffenden und Content-Erstellern in Spanien, wo die Produktion von Kurzvideos und Social-Media-Inhalten zum Alltag gehört.

Offene Ressourcen für Entwickler und Forscher

Im Einklang mit der Strategie, die Meta bei anderen KI-Veröffentlichungen verfolgt hat, hat das Unternehmen beschlossen, einen bedeutenden Teil davon zu veröffentlichen. Technische Ressourcen im Zusammenhang mit SAM 3 und SAM 3DZum einen wurden die Modellgewichte, ein neuer Benchmark mit Schwerpunkt auf der Segmentierung offener Vokabulare sowie ein technisches Dokument, das die Entwicklung detailliert beschreibt, veröffentlicht.

Im Falle von SAM 3D stehen folgende Optionen zur Verfügung: Modell-Checkpoints, Inferenzcode und ein Evaluierungsdatensatz nächste Generation. Dieser Datensatz umfasst eine beträchtliche Vielfalt an Bildern und Objekten, die über traditionelle 3D-Referenzpunkte hinausgehen und mehr Realismus und Komplexität bieten sollen, was für europäische Forschungsgruppen im Bereich Computer Vision und Grafik sehr nützlich sein kann.

Meta hat außerdem Kooperationen mit Annotationsplattformen wie Roboflow angekündigt, mit dem Ziel, Entwicklern und Unternehmen die Möglichkeit zu geben, Geben Sie Ihre eigenen Daten ein und passen Sie SAM 3 an. Dies ermöglicht branchenspezifische Lösungen, von der industriellen Inspektion bis zur Stadtverkehrsanalyse, einschließlich Projekten im Bereich des kulturellen Erbes, bei denen eine präzise Segmentierung architektonischer oder künstlerischer Elemente wichtig ist.

Durch die Wahl eines relativ offenen Ansatzes will das Unternehmen sicherstellen, dass das Entwickler-Ökosystem Universitäten und Startups -einschließlich derjenigen, die in Spanien und dem übrigen Europa tätig sind- können mit diesen Technologien experimentieren, sie in ihre eigenen Produkte integrieren und letztendlich Anwendungsfälle beitragen, die über diejenigen hinausgehen, die Meta intern entwickeln kann.

Mit SAM 3 und SAM 3D will Meta seine Position festigen flexiblere und zugänglichere visuelle KI-PlattformTextgestützte Segmentierung und 3D-Rekonstruktion aus Einzelbildern sind keine Fähigkeiten mehr, die hochspezialisierten Teams vorbehalten sind. Das Potenzial reicht von der alltäglichen Videobearbeitung bis hin zu fortschrittlichen Anwendungen in Wissenschaft, Industrie und E-Commerce – in einem Kontext, in dem die Kombination aus Sprache, Computer Vision und Kreativität zum Standardwerkzeug wird und nicht länger nur ein technologisches Versprechen bleibt.

Ich bin ein Technik-Enthusiast, der seine „Geek“-Interessen zum Beruf gemacht hat. Ich habe mehr als 10 Jahre meines Lebens damit verbracht, modernste Technologie zu nutzen und aus purer Neugier an allen möglichen Programmen herumzubasteln. Mittlerweile habe ich mich auf Computertechnik und Videospiele spezialisiert. Das liegt daran, dass ich seit mehr als fünf Jahren für verschiedene Websites zum Thema Technologie und Videospiele schreibe und Artikel erstelle, die Ihnen die Informationen, die Sie benötigen, in einer für jeden verständlichen Sprache vermitteln möchten.

Bei Fragen reicht mein Wissen von allem rund um das Windows-Betriebssystem bis hin zu Android für Mobiltelefone. Und mein Engagement gilt Ihnen, ich bin immer bereit, ein paar Minuten zu investieren und Ihnen bei der Lösung aller Fragen in dieser Internetwelt zu helfen.