- KI-Assistenten speichern Inhalte, Kennungen, Nutzungsdaten, Standortdaten und Gerätedaten, wobei in bestimmten Fällen eine menschliche Überprüfung erfolgt.

- Während des gesamten Lebenszyklus (Aufnahme, Training, Schlussfolgerung und Anwendung) bestehen Risiken, einschließlich der Gefahr einer sofortigen Injektion und eines Auslaufens.

- Die DSGVO, das KI-Gesetz und Rahmenwerke wie das NIST AI RMF fordern Transparenz, Risikominimierung und dem Risiko angemessene Kontrollen.

- Konfigurieren Sie Aktivitäten, Berechtigungen und die automatische Löschung; schützen Sie sensible Daten, verwenden Sie 2FA und überprüfen Sie Richtlinien und Anbieter.

Künstliche Intelligenz hat sich in Rekordzeit von einem Versprechen zur Routine entwickelt, und damit sind ganz spezifische Zweifel aufgekommen: Welche Daten sammeln KI-Assistenten?Wie sie diese Daten nutzen und was wir tun können, um unsere Informationen zu schützen. Wenn Sie Chatbots, Browser-Assistenten oder generative Modelle verwenden, ist es ratsam, so schnell wie möglich die Kontrolle über Ihre Privatsphäre zu übernehmen.

Diese Systeme sind nicht nur äußerst nützliche Werkzeuge, sondern basieren auch auf umfangreichen Datenmengen. Umfang, Herkunft und Verarbeitung dieser Informationen Sie bergen neue Risiken: von der Rückschlüssen auf Persönlichkeitsmerkmale bis hin zur versehentlichen Offenlegung sensibler Inhalte. Hier erfahren Sie detailliert und ohne Umschweife, was sie erfassen, warum sie es tun, was das Gesetz dazu sagt und Wie Sie Ihre Konten und Ihre Aktivitäten schützen könnenLasst uns alles darüber lernen Welche Daten sammeln KI-Assistenten und wie können Sie Ihre Privatsphäre schützen?

Welche Daten sammeln KI-Assistenten eigentlich?

Moderne Assistenten verarbeiten weit mehr als nur Ihre Fragen. Kontaktinformationen, Kennungen, Nutzung und Inhalte Diese sind üblicherweise in den Standardkategorien enthalten. Wir sprechen von Namen und E-Mail-Adressen, aber auch von IP-Adressen, Geräteinformationen, Interaktionsprotokollen, Fehlern und natürlich den Inhalten, die Sie erstellen oder hochladen (Nachrichten, Dateien, Bilder oder öffentliche Links).

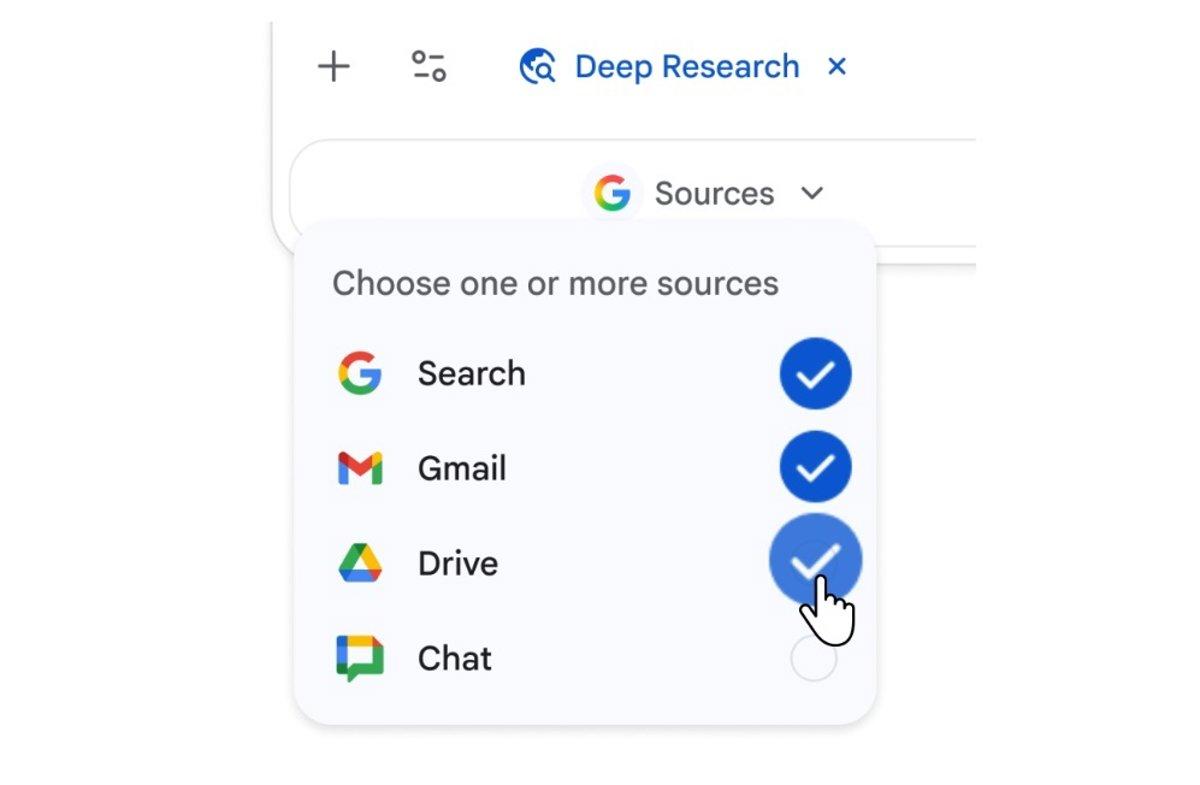

Innerhalb des Google-Ökosystems beschreibt die Datenschutzerklärung von Gemini präzise, welche Daten erfasst werden. Informationen von verbundenen Anwendungen (z. B. Such- oder YouTube-Verlauf, Chrome-Kontext), Geräte- und Browserdaten (Typ, Einstellungen, Kennungen), Leistungs- und Debugging-Metriken und sogar Systemberechtigungen auf Mobilgeräten (wie der Zugriff auf Kontakte, Anruflisten und Nachrichten oder Bildschirminhalte), sofern vom Benutzer autorisiert.

Sie befassen sich auch damit Standortdaten (ungefährer Gerätestandort, IP-Adresse oder im Konto gespeicherte Adressen) und Abonnementdetails, falls Sie kostenpflichtige Tarife nutzen. Zusätzlich werden folgende Daten gespeichert: eigene Inhalte, die die Modelle generieren (Text, Code, Audio, Bilder oder Zusammenfassungen), etwas, das wesentlich dazu beiträgt, die Spuren zu verstehen, die Sie bei der Interaktion mit diesen Werkzeugen hinterlassen.

Es ist zu beachten, dass die Datenerhebung nicht auf Schulungszwecke beschränkt ist: Teilnehmer können Aktivitäten in Echtzeit aufzeichnen. Während der Nutzung (z. B. bei Verwendung von Erweiterungen oder Plugins) werden Telemetriedaten und Anwendungsereignisse erfasst. Daher ist die Kontrolle von Berechtigungen und die Überprüfung der Aktivitätseinstellungen von entscheidender Bedeutung.

Wozu werden diese Daten verwendet und wer kann sie einsehen?

Unternehmen berufen sich häufig auf weit gefasste und wiederkehrende Zwecke: Um den Service bereitzustellen, aufrechtzuerhalten und zu verbessern, das Nutzererlebnis zu personalisieren und neue Funktionen zu entwickelnum mit Ihnen zu kommunizieren, die Leistung zu messen und den Benutzer sowie die Plattform zu schützen. All dies erstreckt sich auch auf Technologien des maschinellen Lernens und die generativen Modelle selbst.

Ein heikler Teil des Prozesses ist die menschliche ÜberprüfungVerschiedene Anbieter bestätigen, dass interne Mitarbeiter oder Dienstleister Interaktionsbeispiele überprüfen, um Sicherheit und Qualität zu verbessern. Daher die einhellige Empfehlung: Vermeiden Sie die Angabe vertraulicher Informationen, die Sie nicht an Dritte weitergeben möchten oder die zur Verfeinerung von Modellen verwendet werden könnten.

In ihren Richtlinien geben einige Dienste an, dass sie bestimmte Daten nicht zu Werbezwecken weitergeben, Ja, sie können den Behörden Informationen zur Verfügung stellen. aufgrund gesetzlicher Verpflichtung. Andere, aufgrund ihrer Natur Mit Werbetreibenden oder Partnern teilen Identifikatoren und aggregierte Signale für Analysen und Segmentierung, wodurch die Möglichkeit zur Profilerstellung eröffnet wird.

Die Behandlung umfasst auch: Aufbewahrung für vordefinierte ZeiträumeManche Anbieter legen beispielsweise eine standardmäßige automatische Löschfrist von 18 Monaten fest (einstellbar auf 3, 36 oder unbegrenzt) und speichern überprüfte Konversationen aus Qualitäts- und Sicherheitsgründen länger. Es empfiehlt sich, die Aufbewahrungsfristen zu überprüfen und die automatische Löschung zu aktivieren, wenn Sie Ihre digitalen Spuren minimieren möchten.

Datenschutzrisiken während des gesamten KI-Lebenszyklus

Die Privatsphäre ist nicht an einem einzelnen Punkt gefährdet, sondern in der gesamten Wertschöpfungskette: Datenerfassung, Training, Inferenz und AnwendungsschichtBei der Massendatenerfassung können sensible Daten unbeabsichtigt und ohne entsprechende Einwilligung einbezogen werden; beim Training können die ursprünglichen Nutzungserwartungen leicht überschritten werden; während der Inferenz können Modelle auf persönliche Eigenschaften schließen Ausgehend von scheinbar trivialen Signalen sind APIs oder Web-Schnittstellen attraktive Ziele für Angreifer.

Bei generativen Systemen vervielfachen sich die Risiken (zum Beispiel, KI-Spielzeug). Datensätze, die ohne ausdrückliche Genehmigung aus dem Internet extrahiert wurden Sie können personenbezogene Daten enthalten, und bestimmte bösartige Eingabeaufforderungen (Prompt-Injection) versuchen, das Modell zu manipulieren, um sensible Inhalte zu filtern oder gefährliche Anweisungen auszuführen. Andererseits gibt es viele Nutzer Sie fügen vertrauliche Daten ein. ohne zu berücksichtigen, dass sie gespeichert oder zur Anpassung zukünftiger Versionen des Modells verwendet werden könnten.

Die akademische Forschung hat konkrete Probleme aufgezeigt. Eine aktuelle Analyse zu Browser-Assistenten Es wurden weitverbreitete Tracking- und Profiling-Praktiken festgestellt, darunter die Übermittlung von Suchinhalten, sensiblen Formulardaten und IP-Adressen an die Server des Anbieters. Darüber hinaus wurde die Fähigkeit demonstriert, Alter, Geschlecht, Einkommen und Interessen abzuleiten, wobei die Personalisierung über verschiedene Sitzungen hinweg erhalten blieb. Nur bei einem Dienst gab es keine Anzeichen für Profiling..

Die Geschichte der Vorfälle erinnert uns daran, dass das Risiko nicht theoretischer Natur ist: Sicherheitslücken Sie haben Chatverläufe oder Benutzermetadaten offengelegt, und Angreifer nutzen bereits Modellierungstechniken, um Trainingsdaten zu extrahieren. Erschwerend kommt hinzu, dass KI-Pipeline-Automatisierung Wenn von Anfang an keine Schutzmaßnahmen vorgesehen sind, wird es schwierig, Datenschutzprobleme zu erkennen.

Was sagen die Gesetze und Rahmenbedingungen?

Die meisten Länder haben bereits Datenschutzstandards in Kraft, und obwohl nicht alle spezifisch für KI sind, gelten sie für jedes System, das personenbezogene Daten verarbeitet. In Europa sind die DSGVO Es erfordert Rechtmäßigkeit, Transparenz, Minimierung, Zweckbindung und Sicherheit; außerdem KI-Gesetz Die Europäische Union führt Risikokategorien ein und verbietet Praktiken mit hohen Auswirkungen (wie zum Beispiel die Sozialbewertung öffentlich) und stellt strenge Anforderungen an Hochrisikosysteme.

In den USA gelten staatliche Vorschriften wie beispielsweise CCPA oder texanisches Recht Sie gewähren Rechte auf Zugriff, Löschung und Widerspruch gegen den Verkauf von Daten, während Initiativen wie das Gesetz von Utah Sie fordern klare Benachrichtigungen bei jeder Interaktion des Nutzers. mit generativen Systemen. Diese normativen Ebenen koexistieren mit sozialen Erwartungen: Meinungsumfragen zeigen ein bemerkenswertes Misstrauen gegenüber verantwortungsvollem Umgang Daten von Unternehmen und eine Diskrepanz zwischen der Selbstwahrnehmung der Nutzer und ihrem tatsächlichen Verhalten (z. B. die Annahme von Richtlinien, ohne sie zu lesen).

Um das Risikomanagement zu fundieren, wird der Rahmen dafür entwickelt NIST (AI RMF) Es schlägt vier fortlaufende Funktionen vor: Steuern (verantwortungsvolle Richtlinien und Aufsicht), Kartieren (Kontext und Auswirkungen verstehen), Messen (Risiken anhand von Kennzahlen bewerten und überwachen) und Managen (Priorisierung und Minderung). Dieser Ansatz hilft bei der Anpassung der Steuerung entsprechend dem Risikoniveau des Systems.

Wer sammelt am meisten: Ein Röntgenbild der beliebtesten Chatbots

Aktuelle Vergleiche ordnen verschiedene Assistenten auf einem Spektrum der Leistungsbewertung ein. Googles Gemini führt die Rangliste an durch das Sammeln der größten Anzahl einzigartiger Datenpunkte über verschiedene Kategorien hinweg (einschließlich mobiler Kontakte, sofern die entsprechenden Berechtigungen erteilt werden), was bei anderen Wettbewerbern selten vorkommt.

Im mittleren Preissegment umfassen Lösungen beispielsweise: Claude, Copilot, DeepSeek, ChatGPT und Perplexität, mit zwischen zehn und dreizehn Datentypen, wobei die Mischung aus Kontakt-, Standort-, Kennungs-, Inhalts-, Verlaufs-, Diagnose-, Nutzungs- und Kaufdaten variiert. Grok Es befindet sich im unteren Bereich und verfügt über ein eingeschränkteres Signalangebot.

Es gibt auch Unterschiede in nachfolgende VerwendungEs ist dokumentiert, dass einige Dienste bestimmte Kennungen (wie verschlüsselte E-Mails) und Segmentierungssignale mit Werbetreibenden und Geschäftspartnern teilen, während andere angeben, dass sie Daten nicht für Werbezwecke verwenden oder verkaufen, sich aber das Recht vorbehalten, auf rechtliche Anfragen zu reagieren oder sie für andere Zwecke zu verwenden. das System verbessern, es sei denn, der Benutzer beantragt die Löschung.

Aus Sicht des Endnutzers bedeutet dies einen klaren Ratschlag: Prüfen Sie die Richtlinien jedes Anbieters.Passen Sie die Berechtigungen der App an und entscheiden Sie bewusst, welche Informationen Sie in welchem Kontext preisgeben, insbesondere wenn Sie Dateien hochladen oder sensible Inhalte teilen möchten.

Wichtige Best Practices zum Schutz Ihrer Privatsphäre

Konfigurieren Sie zunächst sorgfältig die Einstellungen für jeden Assistenten. Erforschen Sie, was gespeichert wird, wie lange und zu welchem Zweck.Aktivieren Sie gegebenenfalls die automatische Löschung. Überprüfen Sie die Richtlinien regelmäßig, da diese häufig geändert werden und neue Kontrolloptionen enthalten können.

Vermeiden Sie das Teilen persönliche und sensible Daten In Ihren Eingabeaufforderungen: Keine Passwörter, Kreditkartennummern, Krankenakten oder interne Firmendokumente. Falls Sie sensible Daten verarbeiten müssen, ziehen Sie Anonymisierungsmechanismen, geschlossene Umgebungen oder On-Premise-Lösungen in Betracht. gestärkte Regierungsführung.

Schützen Sie Ihre Konten mit sicheren Passwörtern und Zweistufige Authentifizierung (2FA)Unbefugter Zugriff auf Ihr Konto legt Ihren Browserverlauf, hochgeladene Dateien und Einstellungen offen, die für äußerst glaubwürdige Social-Engineering-Angriffe oder für den illegalen Verkauf von Daten missbraucht werden können.

Sofern die Plattform es zulässt, Chatverlauf deaktivieren Oder nutzen Sie temporäre Lösungsansätze. Diese einfache Maßnahme reduziert Ihr Risiko im Falle eines Sicherheitsverstoßes, wie vergangene Vorfälle mit beliebten KI-Diensten gezeigt haben.

Vertrauen Sie den Antworten nicht blind. Modelle können Halluzinieren, voreingenommen sein oder manipuliert werden durch böswillige Eingabeaufforderungen, die zu fehlerhaften Anweisungen, falschen Daten oder dem Auslesen sensibler Informationen führen. Im Gegensatz dazu gilt für rechtliche, medizinische oder finanzielle Angelegenheiten: offizielle Quellen.

Seien Sie äußerst vorsichtig mit Links, Dateien und Code Diese Inhalte werden von KI bereitgestellt. Es besteht die Möglichkeit, dass schädliche Inhalte oder absichtlich eingeschleuste Sicherheitslücken (Datenvergiftung) enthalten sind. Überprüfen Sie URLs vor dem Anklicken und scannen Sie Dateien mit seriösen Sicherheitslösungen.

Seien Sie vorsichtig mit Erweiterungen und Plugins von zweifelhafter Herkunft. Es gibt unzählige KI-basierte Add-ons, und nicht alle sind zuverlässig; installieren Sie nur die wichtigsten aus seriösen Quellen, um das Risiko von Malware zu minimieren.

Im Unternehmensbereich muss der Einführungsprozess strukturiert werden. Definieren KI-spezifische Governance-RichtlinienEs beschränkt die Datenerfassung auf das Notwendige, verlangt eine informierte Einwilligung, prüft Lieferanten und Datensätze (Lieferkette) und setzt technische Kontrollen ein (wie DLP, Überwachung des Datenverkehrs zu KI-Anwendungen und granulare Zugriffskontrollen).

Bewusstsein ist Teil des Schutzschildes: Bilden Sie Ihr Team Im Bereich der KI-Risiken, des fortgeschrittenen Phishings und der ethischen Nutzung fördern Brancheninitiativen, die Informationen über KI-Vorfälle austauschen – beispielsweise solche von spezialisierten Organisationen –, kontinuierliches Lernen und verbesserte Abwehrmaßnahmen.

Datenschutz und Aktivitäten in Google Gemini konfigurieren

Wenn Sie Gemini nutzen, melden Sie sich in Ihrem Konto an und überprüfen Sie „Aktivität in Gemini AppsDort können Sie Interaktionen einsehen und löschen, den Zeitraum für die automatische Löschung ändern (standardmäßig 18 Monate, einstellbar auf 3 oder 36 Monate oder unbegrenzt) und entscheiden, ob sie verwendet werden für KI verbessern von Google.

Es ist wichtig zu wissen, dass dies auch dann gilt, wenn das Speichern deaktiviert ist. Ihre Konversationen werden zur Beantwortung verwendet und die Systemsicherheit mit Unterstützung menschlicher Prüfer zu gewährleisten. Geprüfte Konversationen (und zugehörige Daten wie Sprache, Gerätetyp oder ungefähre Standortangabe) können gespeichert werden. bis zu drei Jahren.

Auf dem Handy, Überprüfen Sie die App-Berechtigungen.Standort, Mikrofon, Kamera, Kontakte oder Zugriff auf Bildschirminhalte. Wenn Sie Diktier- oder Sprachaktivierungsfunktionen nutzen, denken Sie daran, dass das System versehentlich durch Geräusche, die dem Schlüsselwort ähneln, aktiviert werden kann; je nach Einstellungen können diese Geräusche... zur Verbesserung von Modellen verwendet werden und reduzieren unerwünschte Aktivierungen.

Wenn Sie Gemini mit anderen Apps (Google oder Drittanbietern) verbinden, beachten Sie bitte, dass jede dieser Apps Daten gemäß ihren eigenen Richtlinien verarbeitet. ihre eigenen RichtlinienBei Funktionen wie Canvas kann der App-Entwickler sehen und speichern, was Sie teilen, und jeder, der über den öffentlichen Link verfügt, kann diese Daten ansehen oder bearbeiten: Teilen Sie Inhalte nur mit vertrauenswürdigen Apps.

In Regionen, in denen dies möglich ist, kann ein Upgrade auf bestimmte Funktionen angeboten werden. Anruf- und Nachrichtenverlauf importieren Wir analysieren Ihre Web- und App-Aktivitäten sowie Gemini-spezifische Aktivitäten, um die Vorschläge (z. B. für Kontakte) zu verbessern. Wenn Sie dies nicht wünschen, passen Sie die Einstellungen an, bevor Sie fortfahren.

Massennutzung, Regulierung und Trend der „Schatten-KI“

Die Akzeptanz ist überwältigend: Jüngste Berichte deuten darauf hin, dass Die überwiegende Mehrheit der Organisationen setzt bereits KI-Modelle ein.Dennoch mangelt es vielen Teams an ausreichender Reife in den Bereichen Sicherheit und Governance, insbesondere in Sektoren mit strengen Vorschriften oder großen Mengen sensibler Daten.

Studien im Wirtschaftssektor decken Mängel auf: ein sehr hoher Prozentsatz der Organisationen in Spanien Es ist nicht darauf vorbereitet, KI-gestützte Umgebungen zu schützen.Den meisten fehlen zudem grundlegende Praktiken zum Schutz von Cloud-Modellen, Datenflüssen und Infrastruktur. Gleichzeitig werden die regulatorischen Maßnahmen verschärft und neue Bedrohungen entstehen. Strafen bei Nichteinhaltung der DSGVO und den lokalen Vorschriften.

Inzwischen hat sich das Phänomen der Schatten-KI Das Problem nimmt zu: Mitarbeiter nutzen externe Assistenten oder private Konten für Arbeitsaufgaben und geben interne Daten ohne Sicherheitsvorkehrungen oder Verträge mit Anbietern preis. Die wirksame Antwort besteht nicht darin, alles zu verbieten, sondern sichere Nutzung ermöglichen in kontrollierten Umgebungen, mit zugelassenen Plattformen und Überwachung des Informationsflusses.

Auf Verbraucherebene passen die großen Anbieter ihre Richtlinien an. Jüngste Änderungen erklären beispielsweise, wie die Aktivitäten mit Gemini zur „Verbesserung der Dienstleistungen“Sie bieten Optionen wie temporäre Konversationen sowie Aktivitäts- und Anpassungsmöglichkeiten. Gleichzeitig betonen Messaging-Unternehmen, dass Persönliche Chats bleiben weiterhin nicht zugänglich. Standardmäßig an KIs, obwohl davon abgeraten wird, Informationen an die KI zu senden, die das Unternehmen nicht erfahren soll.

Es gibt auch öffentliche Strafvollzugsdienste: Dienste von Dateiübertragung Sie stellten klar, dass sie Nutzerinhalte weder zum Trainieren von Modellen verwenden noch an Dritte verkaufen, nachdem Bedenken hinsichtlich geänderter Nutzungsbedingungen geäußert worden waren. Dieser soziale und rechtliche Druck veranlasst sie zu mehr Transparenz. Dem Benutzer mehr Kontrolle geben.

Mit Blick auf die Zukunft erkunden Technologieunternehmen Wege, um Abhängigkeit von sensiblen Daten verringernSelbstlernende Modelle, leistungsfähigere Prozessoren und die Generierung synthetischer Daten. Diese Fortschritte versprechen, Datenengpässe und Probleme mit der Einwilligung zu beheben. Experten warnen jedoch vor neuen Risiken, falls KI ihre Fähigkeiten weiter ausbaut und in Bereichen wie Cyberangriffen oder Manipulation eingesetzt wird.

KI ist sowohl eine Verteidigung als auch eine Bedrohung. Sicherheitsplattformen integrieren bereits Modelle für erkennen und reagieren schneller, während Angreifer LLMs verwenden, um überzeugendes Phishing und DeepfakesDieser Wettstreit erfordert nachhaltige Investitionen in technische Kontrollen, Lieferantenbewertung, kontinuierliche Audits und ständige Geräteaktualisierungen.

KI-Assistenten erfassen zahlreiche Daten über Sie, von Ihren Eingaben über Gerätedaten und Nutzungsinformationen bis hin zu Ihrem Standort. Je nach Dienst können einige dieser Informationen von Menschen geprüft oder an Dritte weitergegeben werden. Um KI zu nutzen, ohne Ihre Privatsphäre zu gefährden, kombinieren Sie Feineinstellungen (Verlauf, Berechtigungen, automatische Löschung), umsichtiges Handeln (keine sensiblen Daten weitergeben, Links und Dateien überprüfen, Dateierweiterungen einschränken), sicheren Zugriff (starke Passwörter und Zwei-Faktor-Authentifizierung) und die aktive Überwachung von Richtlinienänderungen und neuen Funktionen, die Ihre Privatsphäre beeinträchtigen könnten. wie Ihre Daten verwendet und gespeichert werden.

Seit seiner Kindheit begeistert er sich für Technik. Ich liebe es, in der Branche auf dem neuesten Stand zu sein und es vor allem zu kommunizieren. Deshalb widme ich mich seit vielen Jahren der Kommunikation auf Technologie- und Videospiel-Websites. Ich schreibe über Android, Windows, MacOS, iOS, Nintendo oder jedes andere verwandte Thema, das mir in den Sinn kommt.