- Nemotron 3 estas malfermita familio de modeloj, datumoj kaj bibliotekoj fokusitaj sur agenta AI kaj pluragentaj sistemoj.

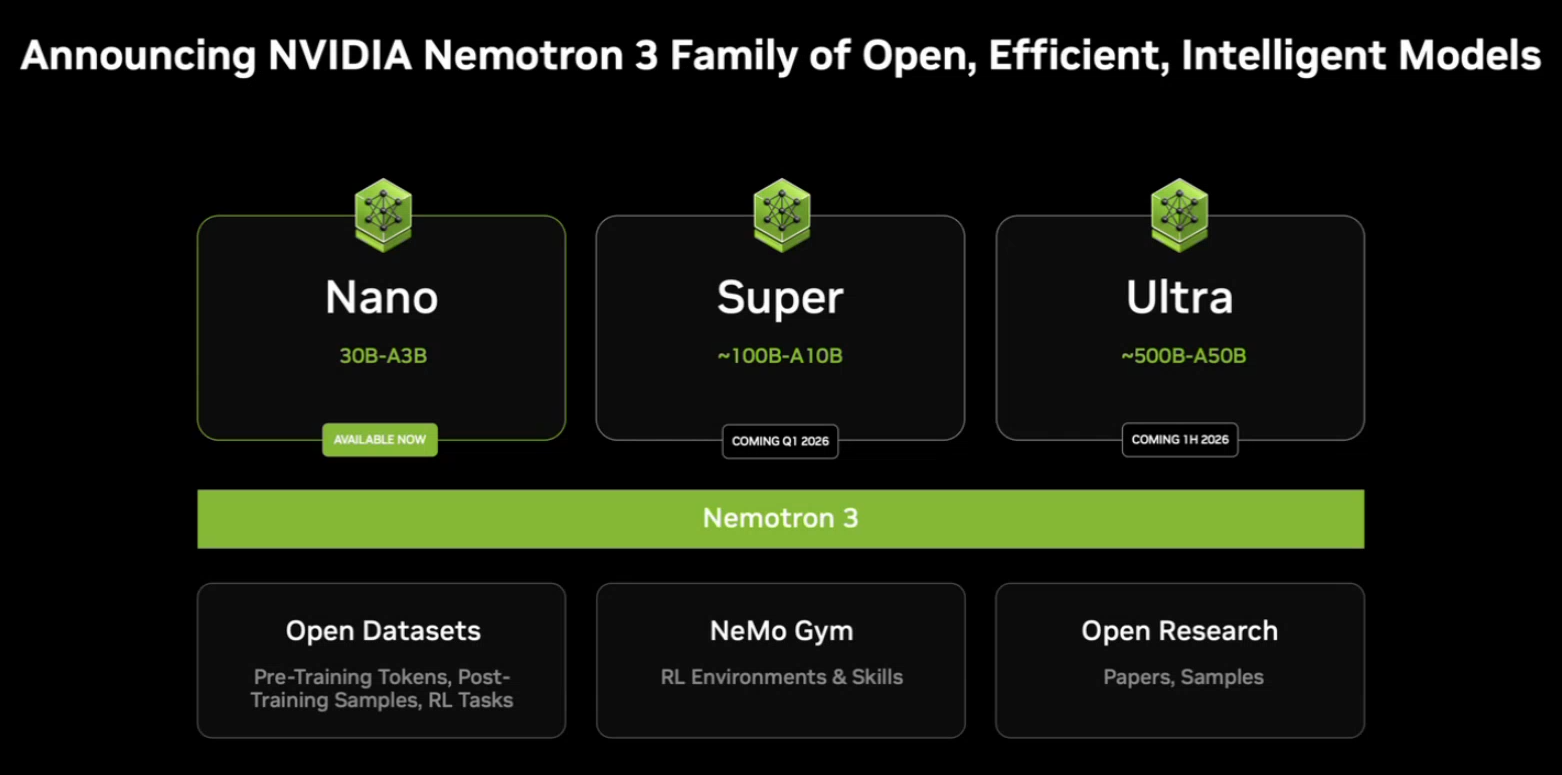

- Ĝi inkluzivas tri MoE-grandecojn (Nano, Super kaj Ultra) kun hibrida arkitekturo kaj efika 4-bita trejnado sur NVIDIA Blackwell.

- Nemotron 3 Nano nun haveblas en Eŭropo per Hugging Face, publikaj nuboj kaj kiel NIM-mikroservo, kun fenestro de 1 miliono da ĵetonoj.

- La ekosistemo estas kompletigita per masivaj datumaroj, NeMo Gym, NeMo RL kaj Evaluator por trejni, agordi kaj kontroli suverenajn AI-agentojn.

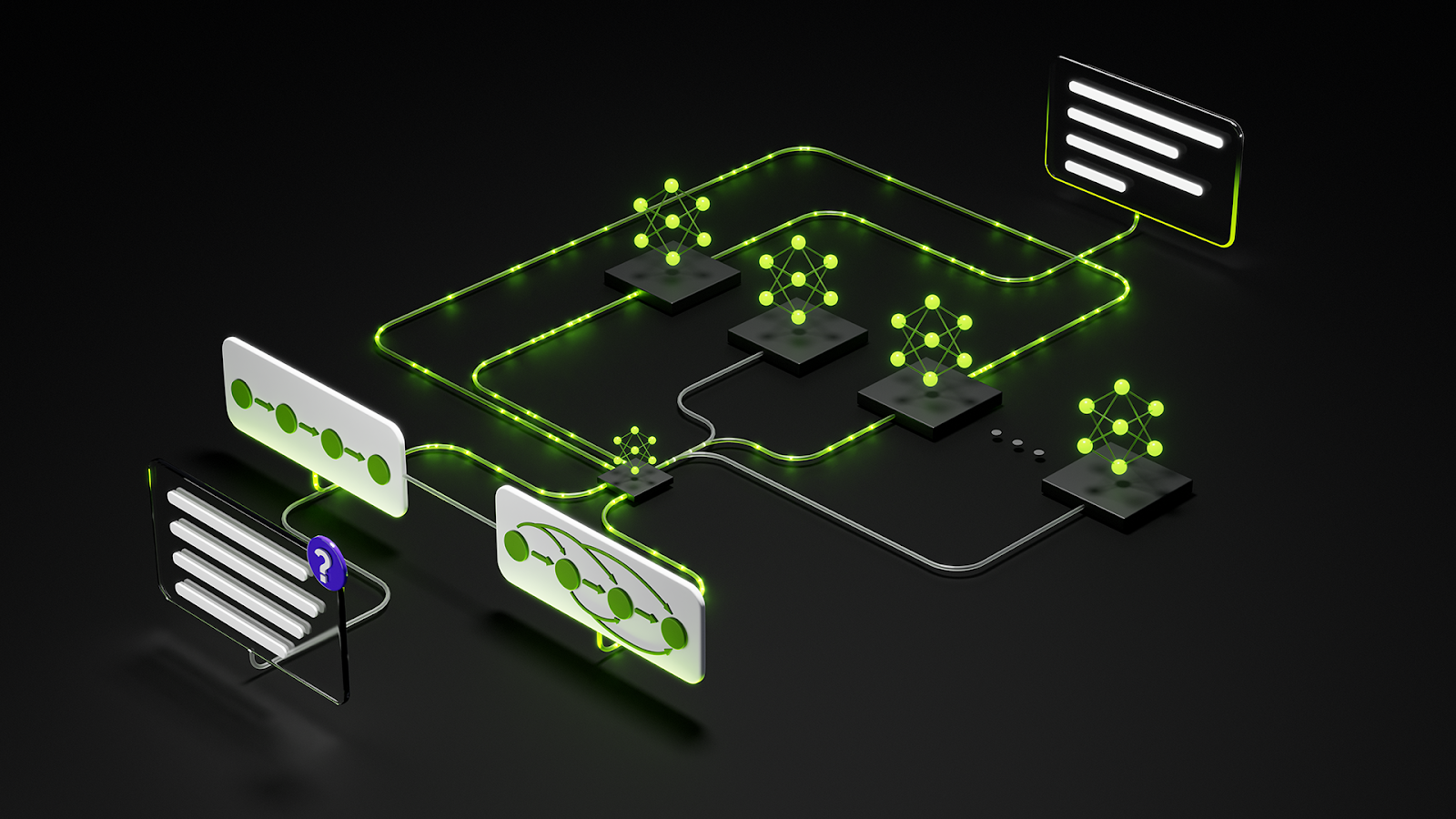

La vetkuro por artefarita inteligenteco moviĝas de simplaj, izolitaj babilrobotoj al agentaj sistemoj, kiuj kunlaboras unu kun la alia, administras longajn laborfluojn kaj devas esti kontroleblaj. En ĉi tiu nova scenaro, NVIDIA decidis fari sufiĉe klaran paŝon: malfermi ne nur modelojn, sed ankaŭ datumojn kaj ilojnpor ke kompanioj, publikaj administracioj kaj esplorcentroj povu konstrui siajn proprajn AI-platformojn kun pli da kontrolo.

Tiu movado realiĝas en Nemotron 3, familio de malfermaj modeloj adaptitaj al plur-agenta AI Ĝi celas kombini altan rendimenton, malaltajn inferencajn kostojn kaj travideblecon. La propono ne estas celita kiel nur alia ĝeneraluzebla babilroboto, sed kiel bazo sur kiu deploji agentojn kiuj rezonas, planas kaj efektivigas kompleksajn taskojn en reguligitaj sektorojĈi tio estas aparte grava en Eŭropo kaj Hispanio, kie datumsuvereneco kaj reguliga konformeco estas gravaj.

Malferma familio de modeloj por agenta kaj suverena AI

Nemotron 3 estas prezentita kiel kompleta ekosistemo: modeloj, datumaroj, bibliotekoj kaj trejnadreceptoj sub malfermaj licencoj. La ideo de NVIDIA estas, ke organizoj ne nur konsumu artefaritan inteligentecon kiel netravidebla servo, sed ankaŭ povu inspekti tion, kio estas interne, adapti la modelojn al siaj domajnoj, kaj deploji ilin sur sia propra infrastrukturo, ĉu en la nubo aŭ en lokaj datumcentroj.

La kompanio enkadrigas ĉi tiun strategion en sia engaĝiĝo al Suverena AIRegistaroj kaj kompanioj en Eŭropo, Sud-Koreio kaj aliaj regionoj serĉas malfermajn alternativojn al fermitaj aŭ fremdaj sistemoj, kiuj ofte ne bone konformas al iliaj datenprotektaj leĝoj aŭ reviziaj postuloj. Nemotron 3 celas esti la teknika fundamento sur kiu konstrui naciajn, sektorajn aŭ entreprenajn modelojn kun pli granda videbleco kaj kontrolo.

Paralele, NVIDIA plifortigas sian pozicion preter aparataroĜis nun, ĝi estis ĉefe referenca GPU-provizanto; kun Nemotron 3, ĝi ankaŭ poziciigas sin en la tavolo de modeligaj kaj trejnaj iloj, konkurante pli rekte kun ludantoj kiel OpenAI, Google, Anthropic, aŭ eĉ Meta, kaj kontraŭ altkvalitaj modeloj kiel SuperGrok PezaMeta malpliigis sian engaĝiĝon al malfermitkoda programaro en lastatempaj generacioj de Llama.

Por la eŭropa esplora kaj noventreprena ekosistemo — forte dependa de malfermaj modeloj gastigitaj sur platformoj kiel Hugging Face — la havebleco de pezoj, sintezaj datumoj kaj bibliotekoj sub malfermaj licencoj reprezentas potencan alternativon al la Ĉinaj modeloj kaj usonanoj, kiuj dominas la popularecon kaj komparnormajn rangotabelojn.

Hibrida MoE-arkitekturo: efikeco por grandskalaj agentoj

La centra teknika trajto de Nemotron 3 estas Hibrida arkitekturo de latenta miksaĵo-de-fakuloj (MoE)Anstataŭ aktivigi ĉiujn parametrojn de la modelo en ĉiu inferenco, nur frakcio de ili estas ŝaltita, la subaro de fakuloj plej gravaj por la koncerna tasko aŭ ĵetono.

Ĉi tiu aliro permesas draste redukti komputilajn kostojn kaj memorkonsumonTio ankaŭ pliigas la trairon de ĵetonoj. Por plur-agentaj arkitekturoj, kie dekoj aŭ centoj da agentoj kontinue interŝanĝas mesaĝojn, tiu efikeco estas ŝlosila por malhelpi, ke la sistemo fariĝu nedaŭrigebla rilate al GPU- kaj nubaj kostoj.

Laŭ datumoj dividitaj de NVIDIA kaj sendependaj komparnormoj, la Nemotron 3 Nano atingas ĝis kvar fojojn pli da ĵetonoj po sekundo Kompare kun sia antaŭulo, la Nemotron 2 Nano, ĝi reduktas la generadon de nenecesaj rezonadĵetonoj je ĉirkaŭ 60%. En praktiko, tio signifas same aŭ eĉ pli precizajn respondojn, sed kun malpli da "vorteco" kaj pli malalta kosto por ĉiu serĉmendo.

La hibrida arkitekturo de la Ministerio pri Edukado, kombinita kun specifaj trejnadoteknikoj, kondukis al Multaj el la plej progresintaj malfermaj modeloj adoptas spertajn skemojnNemotron 3 aliĝas al ĉi tiu tendenco, sed fokusiĝas specife al agenta AI: internaj vojoj desegnitaj por kunordigo inter agentoj, uzo de iloj, pritraktado de longaj statoj, kaj paŝon post paŝa planado.

Tri grandecoj: Nano, Super, kaj Ultra por malsamaj laborkvantoj

La familio Nemotron 3 estas organizita en tri ĉefaj grandecoj de MoE-modelo, ĉiuj malfermitaj kaj kun reduktitaj aktivaj parametroj danke al la sperta arkitekturo:

- Nemotron 3 Nanoĉirkaŭ 30.000 miliardoj da totalaj parametroj, kun ĉirkaŭ 3.000 miliardoj da aktivaĵoj po ĵetonoĜi estas desegnita por celitaj taskoj kie efikeco gravas: programara sencimigado, dokumentresumado, informserĉado, sistemmonitorado aŭ specialigitaj AI-asistantoj.

- Nemotron 3 Super: proksimume 100.000 miliardoj da parametroj, kun 10.000 miliardoj en aktivaĵoj ĉe ĉiu paŝo. Ĝi estas direktita al Altnivela rezonado en plur-agentaj arkitekturojkun malalta latenteco eĉ kiam pluraj agentoj kunlaboras por solvi kompleksajn fluojn.

- Nemotron 3 Ultra: la supra nivelo, kun proksimume 500.000 miliardoj da parametroj kaj ĝis 50.000 miliardoj da aktivaĵoj po ĵetonoĜi funkcias kiel potenca rezonadmotoro por esplorado, strategia planado, altnivela decidsubteno, kaj aparte postulemaj AI-sistemoj.

En praktiko, tio permesas al organizoj Elektu la modelograndecon laŭ via buĝeto kaj bezonojNano por masivaj, intensaj laborkvantoj kaj malaltaj kostoj; Super kiam pli da profundo de rezonado estas bezonata kun multaj kunlaborantaj agentoj; kaj Ultra por kazoj kie kvalito kaj longa kunteksto superas la koston de GPU.

Nuntempe, Nur la Nemotron 3 Nano estas havebla por tuja uzo.La variaĵoj Super kaj Ultra estas planitaj por la unua duono de 2026, donante al eŭropaj kompanioj kaj laboratorioj tempon unue eksperimenti kun Nano, establi duktojn kaj, poste, migri kazojn, kiuj postulas pli grandan kapaciton.

Nemotron 3 Nano: fenestro de 1 miliono da ĵetonoj kaj limigita kosto

Nemotron 3 Nano estas, ekde hodiaŭ, la praktika lancopinto de la familioNVIDIA priskribas ĝin kiel la plej kompute kostefikan modelon en la gamo, optimumigitan por liveri maksimuman rendimenton en pluragentaj laborfluoj kaj intensaj sed ripetaj taskoj.

Inter ĝiaj teknikaj trajtoj, elstaras la jenaj: kunteksta fenestro de ĝis unu miliono da ĵetonojĈi tio ebligas la konservadon de memoro por ampleksaj dokumentoj, tutaj koddeponejoj aŭ plurpaŝaj komercaj procezoj. Por eŭropaj aplikoj en bankado, sanservo aŭ publika administrado, kie registroj povas esti grandegaj, ĉi tiu longdaŭra kunteksta kapablo estas aparte valora.

La komparnormoj de la sendependa organizo Artefarita analizo metas Nemotron 3 Nano kiel unu el la plej ekvilibraj malfermfontaj modeloj Ĝi kombinas inteligentecon, precizecon kaj rapidon, kun trairaj rapidecoj de centoj da ĵetonoj po sekundo. Ĉi tiu kombinaĵo igas ĝin alloga por AI-integristoj kaj servoprovizantoj en Hispanio, kiuj bezonas bonan uzantosperton sen tre altaj infrastrukturkostoj.

Rilate al uzkazoj, NVIDIA celas Nano-n ĉe Enhavresumo, programara sencimigado, informserĉado kaj entreprenaj AI-asistantojDank'al la redukto de redundaj rezonadĵetonoj, eblas funkciigi agentojn, kiuj subtenas longajn konversaciojn kun uzantoj aŭ sistemoj sen ke la inferenckosto eksplodu.

Malfermaj datumoj kaj bibliotekoj: NeMo Gym, NeMo RL kaj Evaluator

Unu el la plej karakterizaj trajtoj de Nemotron 3 estas, ke Ĝi ne limiĝas al publikigo de modelaj pezojNVIDIA akompanas la familion per ampleksa aro de malfermaj rimedoj por trejnado, agordado kaj taksado de agentoj.

Unuflanke, ĝi disponigas sintezan korpuson de pluraj trilionoj da ĵetonoj de antaŭtrejnaj, posttrejnaj kaj plifortigaj datumojĈi tiuj datumaroj, fokusitaj sur rezonado, kodado kaj plurpaŝaj laborfluoj, permesas al kompanioj kaj esplorcentroj generi siajn proprajn domajno-specifajn variaĵojn de Nemotron (ekz., juraj, sanservaj aŭ industriaj) sen komenci de nulo.

Inter tiuj rimedoj, elstaras la jenaj: Nemotron Agentic Sekureca datumbazoĜi kolektas telemetriajn datumojn pri la konduto de agentoj en realmondaj scenaroj. Ĝia celo estas helpi teamojn mezuri kaj plifortigi la sekurecon de kompleksaj aŭtonomaj sistemoj: de kiajn agojn agento faras kiam ĝi renkontas sentemajn datumojn, ĝis kiel ĝi reagas al ambiguaj aŭ eble damaĝaj komandoj.

Koncerne la sekcion pri iloj, NVIDIA lanĉas NeMo Gym kaj NeMo RL kiel malfermitkodaj bibliotekoj por plifortiga trejnado kaj post-trejnado, kune kun NeMo Evaluator por taksi sekurecon kaj rendimenton. Ĉi tiuj bibliotekoj provizas pretajn simulajn mediojn kaj duktojn kun la Nemotron-familio, sed povas esti etenditaj al aliaj modeloj.

La tuta ĉi materialo — pezoj, datumaroj kaj kodo — estas distribuita tra GitHub kaj Hugging Face estas licencitaj sub la Malferma Modela Licenco de NVIDIA.por ke eŭropaj teamoj povu senjunte integri ĝin en siajn proprajn MLO-ojn. Firmaoj kiel Prime Intellect kaj Unsloth jam integrigas NeMo Gym rekte en siajn laborfluojn por simpligi plifortigan lernadon sur Nemotron.

Havebleco en publikaj nuboj kaj la eŭropa ekosistemo

Nemotron 3 Nano nun haveblas ĉe Brakumanta Vizaĝo y GitHubsame kiel per inferencaj provizantoj kiel Baseten, DeepInfra, Fireworks, FriendliAI, OpenRouter, kaj Together AI. Ĉi tio malfermas la pordon por evoluigteamoj en Hispanio por testi la modelon per API aŭ deploji ĝin sur siaj propraj infrastrukturoj sen troa komplekseco.

Sur la nuba fronto, Nemotron 3 Nano aliĝas al AWS per Amazon Bedrock por senserva inferenco, kaj anoncis subtenon por Google Cloud, CoreWeave, Crusoe, Microsoft Foundry, Nebius, Nscale, kaj Yotta. Por eŭropaj organizaĵoj jam laborantaj sur ĉi tiuj platformoj, ĉi tio faciligas la adopton de Nemotron sen drastaj ŝanĝoj al ilia arkitekturo.

Aldone al la publika nubo, NVIDIA antaŭenigas la uzon de Nemotron 3 Nano kiel NIM-mikroservo deplojebla sur iu ajn NVIDIA-akcelita infrastrukturoTio ebligas hibridajn scenarojn: parton de la ŝarĝo en internaciaj nuboj kaj parton en lokaj datencentroj aŭ en eŭropaj nuboj, kiuj prioritatigas datenloĝadon en EU.

La versioj Nemotron 3 Super kaj Ultra, adaptitaj al ekstremaj rezonadŝarĝoj kaj grandskalaj pluragentaj sistemoj, estas planita por la unua duono de 2026Ĉi tiu templinio donas al la eŭropa esplora kaj komerca ekosistemo tempon eksperimenti kun Nano, validigi uzkazojn, kaj desegni migradajn strategiojn al pli grandaj modeloj kiam necese.

Nemotron 3 poziciigas NVIDIA kiel unu el la ĉefaj provizantoj de luksaj malfermaj modeloj adaptitaj al agenta AIKun propono kiu kombinas teknikan efikecon (hibrida MoE, NVFP4, masiva kunteksto), malfermitecon (pezoj, datumaroj kaj disponeblaj bibliotekoj) kaj klaran fokuson pri datumsuvereneco kaj travidebleco, aspektoj aparte sentemaj en Hispanio kaj la resto de Eŭropo, kie reguligo kaj premo por revizii AI estas ĉiam pli grandaj.

Mi estas teknologientuziasmulo, kiu transformis siajn "geek" interesojn en profesion. Mi pasigis pli ol 10 jarojn de mia vivo uzante avangardan teknologion kaj tuŝante ĉiajn programojn pro pura scivolemo. Nun mi specialiĝis pri komputila teknologio kaj videoludoj. Ĉi tio estas ĉar de pli ol 5 jaroj mi verkas por diversaj retejoj pri teknologio kaj videoludoj, kreante artikolojn, kiuj celas doni al vi la informojn, kiujn vi bezonas en lingvo komprenebla por ĉiuj.

Se vi havas demandojn, mia scio varias de ĉio rilata al la Vindoza operaciumo same kiel Android por poŝtelefonoj. Kaj mia devontigo estas al vi, mi ĉiam pretas pasigi kelkajn minutojn kaj helpi vin solvi ajnajn demandojn, kiujn vi povas havi en ĉi tiu interreta mondo.