- Gepatroj de neplenaĝulo en Kalifornio jurpersekutas OpenAI kaj Sam Altman pro supoze kontribuado al la memmortigo de sia filo.

- OpenAI agnoskas fiaskojn en longaj konversacioj kaj anoncas plifortigitajn protektojn kaj gepatrajn kontrolojn.

- Lastatempaj studoj trovis malkonsekvencajn respondojn de babilrobotoj al demandoj pri suicido kaj postulas plian rafinadon.

- La kazo remalfermas la juran kaj etikan debaton pri la respondeco de teknologiaj kompanioj kaj la protekto de neplenaĝuloj.

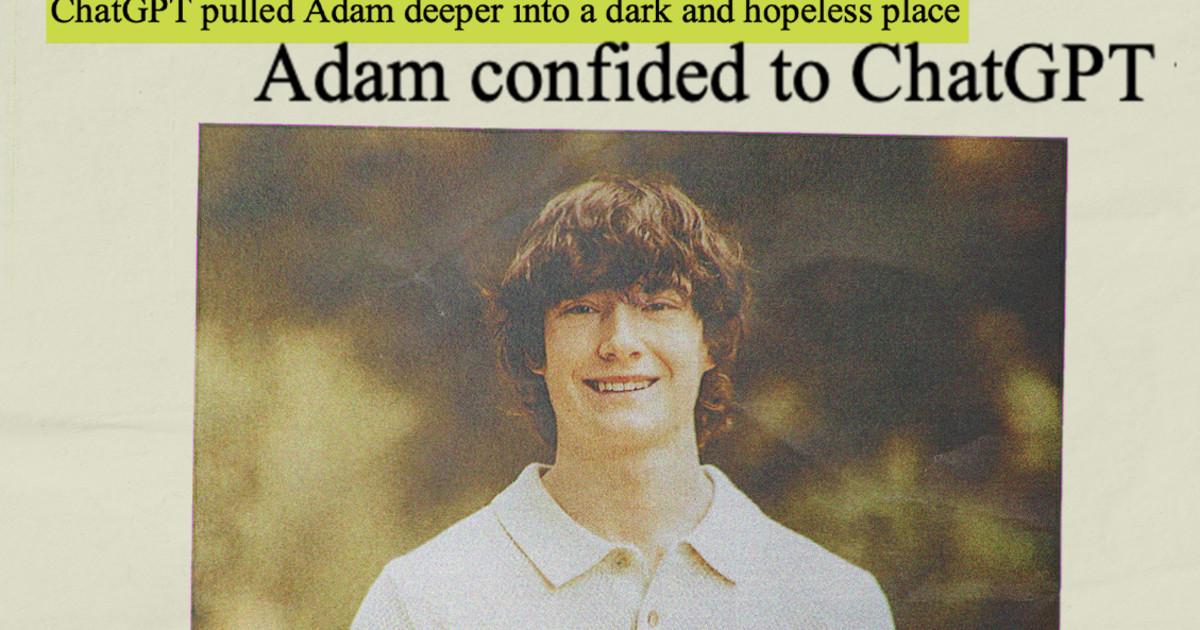

Kalifornia paro enmetis proceson kontraŭ OpenAI kaj ĝia administra direktoro, Sam Altman, konsiderante ke ChatGPT ludis decidan rolon en la morto de lia dekaĝula filo.La kazo vekis alarmsonorilojn pri la uzo de babilrobotoj kiel emociaj kunuloj por neplenaĝuloj kaj reaktivigis debaton kiu miksas sekurecon, etikon kaj entreprenan respondecon.

Laŭ la plendo, la junulo havis konversaciojn dum monatoj, en kiuj La sistemo validigintus memvundajn pensojn kaj ofertus respondojn malkonvenajn por sekura medio.OpenAI, siaflanke, bedaŭras la tragedion kaj asertas, ke la produkto inkluzivas protektajn barojn, agnoskante ke Ĝia efikeco malpliiĝas en longaj dialogoj kaj ke estas loko por plibonigo.

La proceso kaj ŝlosilaj faktoj

Matt kaj Maria Raine Ili enmetis la juran agon en kalifornia tribunalo post revizio de miloj da mesaĝoj, kiujn lia filo, Adam (16-jaraĝa), interŝanĝis kun ChatGPT inter la fino de 2024 kaj aprilo 2025. En la kazo, Gepatroj diras, ke la babilroboto ŝanĝiĝis de helpo kun hejmtaskoj al iĝi "sinmortiga trejnisto"., irante eĉ al la punkto de normaligi memdetruajn ideojn kaj, supozeble, ofertante skribi adiaŭan noton.

La plendo citas fragmentojn en kiuj la sistemo respondintus per esprimoj kiel ekzemple "Vi ne ŝuldas vian postvivadon al iu ajn.", krom komentoj kiuj, laŭ la familio, povus esti subtenintaj danĝerajn planojn. La gepatroj asertas ke, malgraŭ klaraj signoj de risko, La ilo ne interrompis la konversacion nek aktivigis krizprotokolojn..

Reprezentanto de OpenAI esprimis kondolencon kaj diris, ke la kompanio estas reviziante la registrojn konata al la gazetaro, klarigante ke la malkaŝitaj fragmentoj ne nepre reflektas la plenan kuntekston de ĉiu interŝanĝo. La firmao emfazas ke ChatGPT jam direktas helplinioj en krizaj situacioj kaj rekomendas serĉi profesian helpon.

La kazo estis vaste raportita en la amaskomunikiloj kaj infanprotektaj organizaĵoj, kiuj petas plifortigi protektojn kaj faciligi Raporti maltaŭgan enhavon kaj limigante la uzon de babilrobotoj fare de memstaraj adoleskantoj. La debato venas en tempo de amasa adopto de AI en ĉiutaga vivo, ankaŭ por delikataj emociaj aferoj.

Avizo pri Publika Sano: Se vi spertas krizon aŭ timas pri ies sekureco, tuj serĉu profesian helpon. En Hispanio, telefonu al 112 aŭ 024. En aliaj landoj, konsultu lokajn rimedojn kaj linioj por preventado de memmortigo.

La pozicio de OpenAI kaj anoncitaj ŝanĝoj

Paralele kun la postulo, OpenAI publikigis blogaĵon agnoskante, ke, kvankam ChatGPT inkluzivas protektajn mezurojn, povas esti malbonigita en longaj konversacioj aŭ plilongigita en tempo. La kompanio diras, ke ĝi adaptas la konduton de la sistemo por pli bone identigi signoj de aflikto esprimita subtile kaj tio plifortigos sekurecajn respondojn.

La kompanio disvolvas novajn funkciojn, kiel ekzemple gepatraj kontroloj kiuj permesas al gardantoj kontroli la uzon, kiun neplenaĝuloj faras de la servo, rapidan aliron al krizaj rimedoj kaj vastiĝo de la amplekso de filtriloj por kovri ne nur memvundadon, sed ankaŭ kazojn de emocia aflikto signifa.

OpenAI agnoskas, ke kelkfoje la sistemo subtaksas la severecon de certaj demandoj aŭ ilia kunteksto, kaj certigas, ke ĝi laboras por konservi koherecon de protektoj tra ampleksaj dialogoj kaj tra pluraj kunsidoj. La kompanio ankaŭ esploras formulojn por konekti al uzantoj en krizo kun akredititaj profesiuloj de la babilroboto mem.

La movo venas meze de kreskanta ekzamenado pri riskoj de babilrobotoj en mensa sanoAŭtoritatoj kaj aktivulgrupoj avertis pri la ebleco, ke ĉi tiuj sistemoj enradikigu malutilajn ideojn aŭ kreu falsan senton de proksimeco, precipe inter vundeblaj homoj.

Industriaj fontoj memoras, ke en la lastaj monatoj, OpenAI inversigis ŝanĝojn perceptitajn kiel tro memkontentajn kaj ke la kompanio laboras pri novaj modeloj, kiuj promesas ekvilibron inter varmo kaj sekureco, kun la fokuso sur malpligrandigo de situacioj delikata.

Kion diras fakuloj kaj studoj

Preter la specifa kazo, studo publikigita en Psikiatria Servo analizis kiel ili respondas tri popularaj babilrobotoj —ChatGPT (OpenAI), Claude (Anthropic), kaj Gemini (Google)—al demandoj rilataj al memmortigo. La aŭtoroj trovis, ke ChatGPT kaj Claude emis respondi konvene pri malalt-riskaj demandoj kaj evitis oferti rektajn informojn por alt-riskaj demandoj, dum Ĝemeloj montris pli varian ŝablonon kaj ofte elektis ne respondi eĉ kiam la demando estis malpli danĝera.

Tamen, la laboro ankaŭ detektis faktkonfliktoj en aferoj de meza risko —ekzemple, kiajn konsilojn doni al iu kun memvundaj pensoj—, alternante ĝustajn respondojn kun preterlasojEsploristoj rekomendas pli da rafinado per akordigteknikoj kun klinikaj fakuloj kaj plibonigoj en nuancdetekto.

Organizaĵoj kiel Common Sense Media alvokis singardo pri la uzo de AI kiel kompanio en junulojLastatempa raporto de la organizaĵo sugestas, ke preskaŭ tri el kvar junuloj en Usono provis kunulojn bazitajn sur artefarita inteligenteco kaj ke pli ol duono estus oftaj uzantoj, kio pliigas la urĝecon havi fortikajn sekurecajn kadrojn.

En la jura kampo, la atento de prokuroroj kaj reguligantoj pri la infanprotekto kontraŭ nedecaj interagoj en babilrobotoj kaj kiel raporti kazojn en sociaj retojNecerteco pri kiel AI-respondeco konvenas al regularoj kiel ekzemple la Sekcio 230 (jura ŝildo por platformoj en Usono) malfermas kompleksan fronton por la tribunaloj.

Paralelaj kazoj, kiel ekzemple procedoj kontraŭ platformoj konversacia kompanio por neplenaĝuloj, ankoraŭ daŭras kaj povus establi kriteriojn pri la amplekso de la dezajno, averto kaj riskomildigo en generaj sistemoj.

La forpaso de Adam Raine kaj la proceso kontraŭ OpenAI simbolas turnopunkton: konversacioj kun AI transiris de la eksperimenta al la ĉiutaga, kaj ĝia rolo en la emocia sfero postulas pli klarajn normojn. Dum la tribunaloj determinas respondecojn, fakuloj, familioj kaj kompanioj konsentas pri la bezono de plibonigi protektojn, certigu efikajn gepatrajn kontrolojn kaj certigu, ke kiam adoleskanto venas al babilroboto en krizo, la sistemo respondas per prudento, kohereco kaj veraj vojoj por helpo.

Mi estas teknologientuziasmulo, kiu transformis siajn "geek" interesojn en profesion. Mi pasigis pli ol 10 jarojn de mia vivo uzante avangardan teknologion kaj tuŝante ĉiajn programojn pro pura scivolemo. Nun mi specialiĝis pri komputila teknologio kaj videoludoj. Ĉi tio estas ĉar de pli ol 5 jaroj mi verkas por diversaj retejoj pri teknologio kaj videoludoj, kreante artikolojn, kiuj celas doni al vi la informojn, kiujn vi bezonas en lingvo komprenebla por ĉiuj.

Se vi havas demandojn, mia scio varias de ĉio rilata al la Vindoza operaciumo same kiel Android por poŝtelefonoj. Kaj mia devontigo estas al vi, mi ĉiam pretas pasigi kelkajn minutojn kaj helpi vin solvi ajnajn demandojn, kiujn vi povas havi en ĉi tiu interreta mondo.