- SAM 3 introduit la segmentation d'images et de vidéos guidée par du texte et des exemples visuels, avec un vocabulaire de millions de concepts.

- SAM 3D vous permet de reconstruire des objets, des scènes et des corps humains en 3D à partir d'une seule image, en utilisant des modèles ouverts.

- Dans Segment Anything Playground, grâce à des modèles pratiques et créatifs, il est possible de tester des modèles sans connaissances techniques.

- Meta publie des poids, des points de contrôle et de nouveaux benchmarks afin que les développeurs et les chercheurs en Europe et dans le reste du monde puissent intégrer ces fonctionnalités à leurs projets.

Meta a franchi une nouvelle étape dans son engagement envers intelligence artificielle appliquée à la vision par ordinateur avec la Lancement de SAM 3 et SAM 3D, deux modèles qui élargissent la famille Segment Anything et que Leur objectif est de changer notre façon de travailler avec les photos et les vidéos.Loin de rester une simple expérience de laboratoire, l'entreprise souhaite que ces outils soient utilisés aussi bien par les professionnels que par les utilisateurs sans formation technique.

Avec cette nouvelle génération, Meta se concentre sur améliorer la détection et la segmentation des objets et en apportant le reconstruction tridimensionnelle pour un public beaucoup plus largeDe l'édition vidéo à la visualisation de produits pour le e-commerce en Espagne et dans le reste de l'Europe, l'entreprise envisage un scénario dans lequel Il suffit de décrire avec des mots ce que vous voulez faire pour que l'IA prenne en charge la majeure partie du travail..

Qu’est-ce que SAM 3 offre par rapport aux versions précédentes ?

SAM 3 se positionne comme l'évolution directe des modèles de segmentation que Meta a présentés en 2023 et 2024, connus sous le nom de SAM 1 et SAM 2. Ces premières versions se concentraient sur l'identification des pixels appartenant à chaque objet, principalement à l'aide d'indices visuels tels que des points, des boîtes ou des masques, et dans le cas de SAM 2, en suivant les objets tout au long d'une vidéo presque en temps réel.

La principale nouveauté réside désormais dans le fait que SAM 3 comprend invites textuelles riches et précisesIl ne s'agit pas seulement d'étiquettes générales. Alors qu'auparavant on utilisait des termes simples comme « voiture » ou « bus », le nouveau modèle est capable de répondre à des descriptions beaucoup plus spécifiques, par exemple « bus scolaire jaune » ou « voiture rouge garée en double file ».

En pratique, cela signifie qu'il suffit d'écrire quelque chose comme « casquette de baseball rouge » afin que le système puisse localiser et séparer tous les éléments correspondant à cette description au sein d'une image ou d'une vidéo. Cette capacité d'affinage par les mots est particulièrement utile dans contextes d'édition professionnelle, la publicité ou l'analyse de contenu, où il faut souvent examiner des détails très spécifiques.

De plus, SAM 3 a été conçu pour s'intégrer à grands modèles de langage multimodauxCela vous permet d'aller au-delà des phrases simples et d'utiliser des instructions complexes telles que : « Des gens assis mais ne portant pas de casquette rouge » ou encore « des piétons qui regardent la caméra mais sans sac à dos ». Ce type d’instruction combine des conditions et des exclusions qui, jusqu’à récemment, étaient difficiles à traduire dans un outil de vision par ordinateur.

Performances et échelle du modèle SAM 3

Meta souhaitait également mettre en lumière la partie moins visible mais cruciale : échelle de performance technique et de connaissances Selon les données de l'entreprise, le SAM 3 est capable de traiter une seule image contenant plus d'une centaine d'objets détectés en environ 30 millisecondes grâce à un GPU H200, une vitesse très proche de celle requise pour les flux de travail exigeants.

Concernant la vidéo, l'entreprise assure que le système maintient ses performances. pratiquement en temps réel lorsqu'il s'agit de travailler avec environ cinq objets simultanés, ce qui le rend viable pour le suivi et la segmentation de contenu en mouvement, allant de courts clips pour les réseaux sociaux à des projets de production plus ambitieux.

Pour parvenir à ce comportement, Meta a constitué une base d'entraînement comprenant plus de 4 millions de concepts uniquesEn combinant des annotateurs humains et des modèles d'IA pour faciliter l'étiquetage de grands volumes de données, ce mélange de supervision manuelle et automatisée vise à équilibrer précision et échelle, un élément clé pour garantir que le modèle réagisse bien à diverses entrées dans les contextes de marché européens, latino-américains et autres.

L'entreprise intègre SAM 3 dans ce qu'elle appelle Collection Segment AnythingUne famille de modèles, de benchmarks et de ressources conçus pour étendre la compréhension visuelle de l'IA. Ce lancement s'accompagne d'un nouveau benchmark pour la segmentation en « vocabulaire ouvert », visant à mesurer la capacité du système à comprendre presque n'importe quel concept exprimé en langage naturel.

Intégration avec les outils Edits, Vibes et autres outils Meta

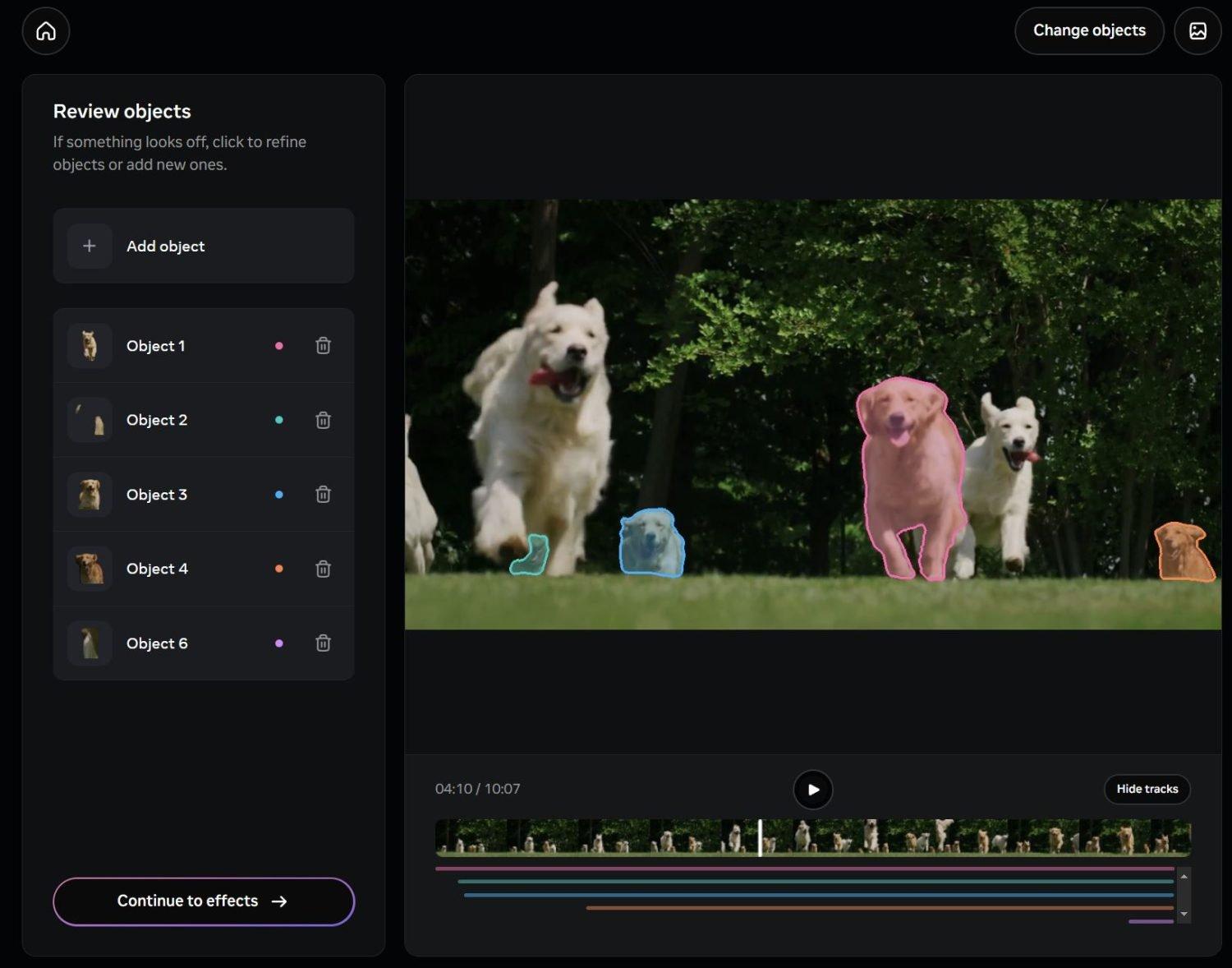

Au-delà de l'aspect technique, Meta a déjà commencé à intégrer SAM 3 dans des produits spécifiques qui sont destinées à un usage quotidien. L'une des premières destinations sera Edits, leur application de création et de montage vidéo, dont l'idée est que l'utilisateur puisse sélectionner des personnes ou des objets spécifiques avec une simple description textuelle et appliquer des effets, des filtres ou des modifications uniquement à ces parties de la séquence.

Une autre voie d'intégration se trouvera dans Vibes, au sein de l'application Meta AI et de la plateforme meta.aiDans ce contexte, la segmentation de texte sera combinée à des outils génératifs pour créer de nouvelles expériences d'édition et de création, telles que des arrière-plans personnalisés, des effets de mouvement ou des modifications sélectives de photos conçues pour les réseaux sociaux très populaires en Espagne et dans le reste de l'Europe.

La proposition de l'entreprise est que ces compétences ne se limitent pas aux études professionnelles, mais s'étendent plutôt... créateurs indépendants, petites agences et utilisateurs avancés qui travaillent quotidiennement avec du contenu visuel. La possibilité de segmenter des scènes en rédigeant des descriptions en langage naturel réduit considérablement le temps d'apprentissage par rapport aux outils traditionnels basés sur des masques et des calques manuels.

Dans le même temps, Meta maintient une approche ouverte envers les développeurs externes, ce qui suggère que applications tierces -des outils de montage aux solutions d'analyse vidéo dans le commerce de détail ou la sécurité- peuvent s'appuyer sur SAM 3 tant que les politiques d'utilisation de l'entreprise sont respectées.

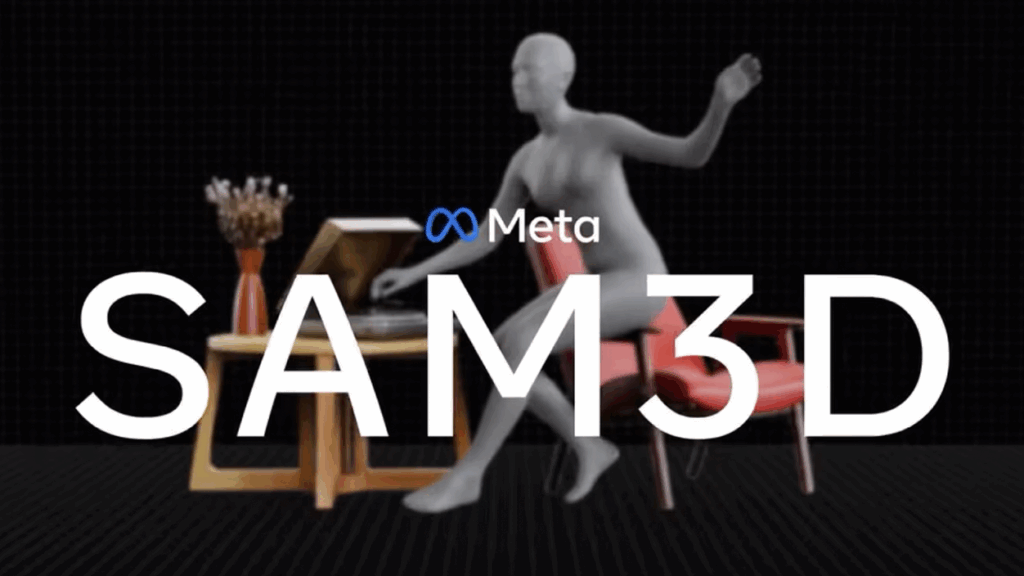

SAM 3D : Reconstruction tridimensionnelle à partir d’une seule image

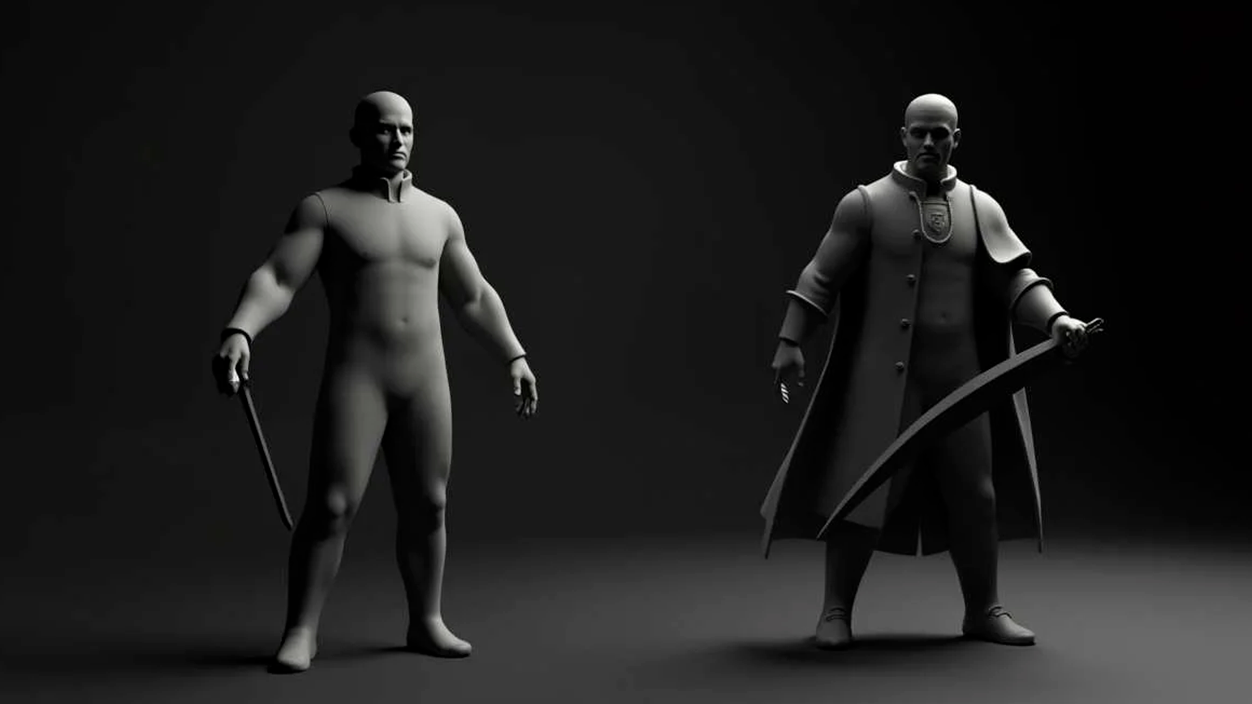

L’autre grande nouvelle est SAM 3Dun système conçu pour fonctionner reconstructions tridimensionnelles À partir d'images 2D, le modèle vise à générer une représentation 3D fiable à partir d'une seule photo, évitant ainsi de multiples prises de vue sous différents angles. Cette approche est particulièrement intéressante pour ceux qui ne disposent pas d'équipements ou de flux de travail de numérisation spécialisés.

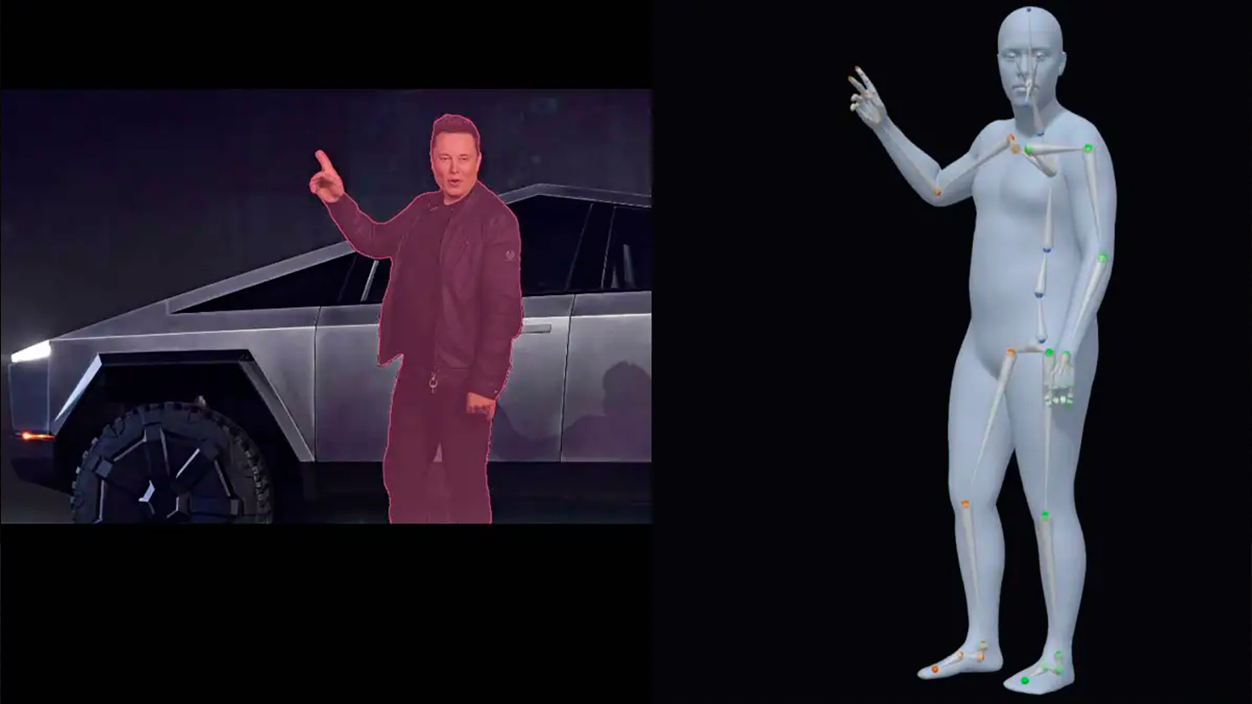

SAM 3D se compose de deux modèles open-source aux fonctions distinctes : Objets 3D SAMaxé sur la reconstitution d'objets et de scènes, et Corps 3D SAMConçu pour l'estimation de la morphologie humaine, ce système, grâce à sa conception modulaire, s'adapte à des cas d'utilisation très variés, des catalogues de produits aux applications de santé ou sportives.

Selon Meta, SAM 3D Objects marque un Nouvelle référence de performance en reconstruction 3D guidée par l'IASurpassant aisément les méthodes précédentes sur les principaux indicateurs de qualité, l'entreprise a collaboré avec des artistes pour créer SAM 3D Artist Objects, un ensemble de données conçu spécifiquement pour évaluer la fidélité et le niveau de détail des reconstructions à partir d'une grande variété d'images et d'objets, afin d'évaluer plus rigoureusement les résultats.

Cette avancée ouvre la voie à des applications pratiques dans des domaines tels que robotique, sciences, médecine sportive ou créativité numériquePar exemple, en robotique, cela peut aider les systèmes à mieux comprendre le volume des objets avec lesquels ils interagissent ; dans la recherche médicale ou sportive, cela pourrait aider à analyser la posture et les mouvements du corps ; et dans la conception créative, cela sert de base à la génération de modèles 3D pour l'animation, les jeux vidéo ou les expériences immersives.

L'une des premières applications commerciales déjà visibles est la fonction "Vue depuis la chambre" de Marché Facebookqui vous permet de visualiser à quoi ressemblerait un meuble ou un objet décoratif dans une pièce réelle avant de l'acheter. Avec SAM 3D, Meta cherche à perfectionner ces types d'expériences, un point particulièrement pertinent pour le commerce électronique européen, où les retours de produits dus à des attentes non satisfaites représentent un coût croissant.

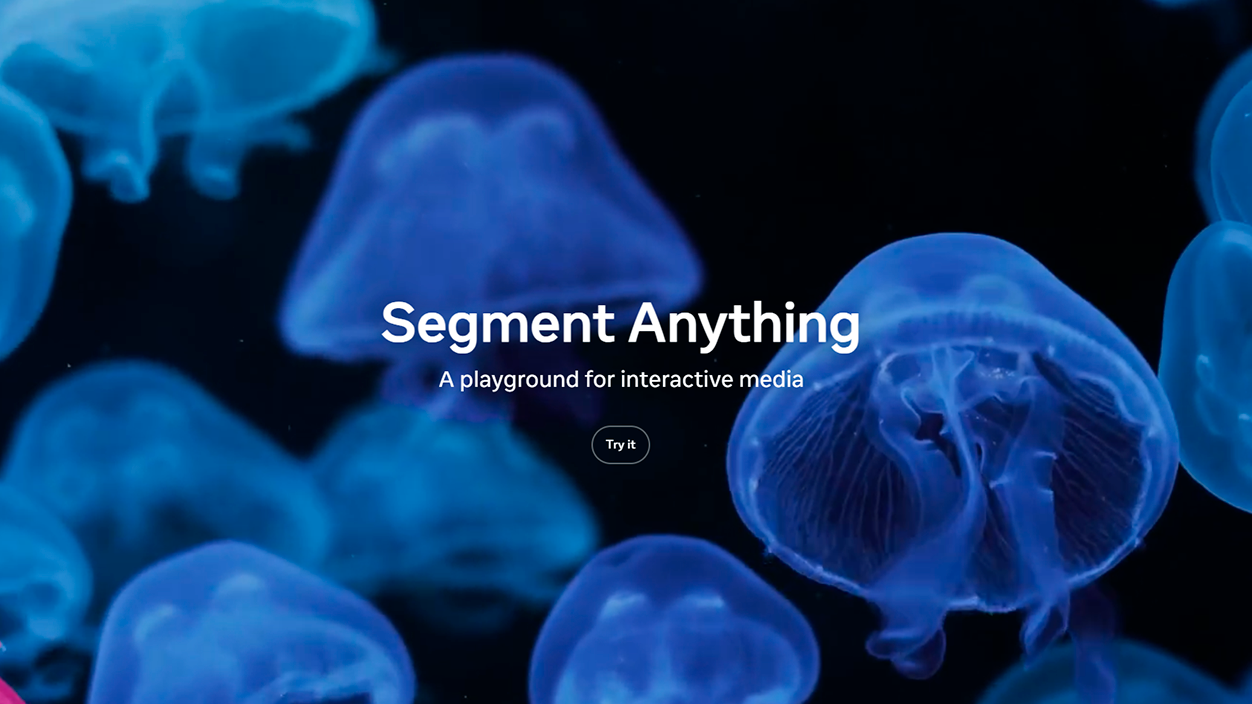

Segment Anything Playground : un environnement pour expérimenter

Pour permettre au public de tester ces fonctionnalités sans rien installer, Meta a activé Segmenter n'importe quel terrain de jeuIl s'agit d'une plateforme web permettant de télécharger des images ou des vidéos et d'expérimenter SAM 3 et SAM 3D directement depuis votre navigateur. L'objectif est de permettre à toute personne curieuse de découvrir l'intelligence artificielle visuelle et ses possibilités, sans aucune connaissance en programmation.

Dans le cas de SAM 3, l'espace de jeu permet de segmenter les objets à l'aide de phrases courtes ou instructions détailléesIl est possible de combiner du texte et, si besoin, des exemples visuels. Cela simplifie les tâches courantes telles que la sélection de personnes, de véhicules, d'animaux ou d'éléments spécifiques de la scène et l'application d'actions spécifiques, allant des effets esthétiques au floutage ou au remplacement de l'arrière-plan.

Lorsqu'on travaille avec SAM 3D, la plateforme permet de Explorez les scènes sous de nouveaux anglesRéorganiser des objets, appliquer des effets tridimensionnels ou générer des vues alternatives : cette fonctionnalité permet aux professionnels du design, de la publicité ou de la création de contenu 3D de prototyper rapidement leurs idées sans avoir à maîtriser d'emblée des outils techniques complexes.

Le terrain de jeu comprend également une série de modèles prêts à l'emploi Ces fonctionnalités sont conçues pour des tâches très spécifiques. Elles incluent des options pratiques comme le floutage des visages ou des plaques d'immatriculation pour des raisons de confidentialité, et des effets visuels tels que les traînées de mouvement, les surlignages sélectifs ou les projecteurs sur des zones d'intérêt dans la vidéo. Ces types de fonctions sont particulièrement adaptés aux flux de travail des créateurs de contenu et de médias numériques en Espagne, où la production de vidéos courtes et de contenu pour les réseaux sociaux est constante.

Ressources ouvertes pour les développeurs et les chercheurs

Conformément à la stratégie adoptée par Meta pour ses autres versions d'IA, l'entreprise a décidé de publier une partie importante de ressources techniques associées à SAM 3 et SAM 3DPremièrement, les pondérations du modèle, un nouveau référentiel axé sur la segmentation par vocabulaire ouvert et un document technique détaillant son développement ont été rendus publics.

Dans le cas de SAM 3D, les éléments suivants sont disponibles : points de contrôle du modèle, code d'inférence et ensemble de données d'évaluation Nouvelle génération. Cet ensemble de données comprend une grande variété d'images et d'objets qui vise à dépasser les points de référence 3D traditionnels, offrant un réalisme et une complexité accrus, ce qui peut s'avérer très utile pour les groupes de recherche européens travaillant dans le domaine de la vision par ordinateur et de l'infographie.

Meta a également annoncé des collaborations avec des plateformes d'annotation comme Roboflow, dans le but de permettre aux développeurs et aux entreprises de Saisissez vos propres données et ajustez SAM 3 aux besoins spécifiques. Cela ouvre la voie à des solutions sectorielles, allant du contrôle industriel à l'analyse du trafic urbain, en passant par les projets de valorisation du patrimoine culturel où il est important de segmenter avec précision les éléments architecturaux ou artistiques.

En optant pour une approche relativement ouverte, l'entreprise cherche à garantir que l'écosystème des développeurs, universités et startups — y compris celles opérant en Espagne et dans le reste de l’Europe — peuvent expérimenter ces technologies, les intégrer à leurs propres produits et, au final, contribuer à des cas d’utilisation qui vont au-delà de ceux que Meta peut développer en interne.

Avec SAM 3 et SAM 3D, Meta vise à consolider un plateforme d'IA visuelle plus flexible et accessibleLà où la segmentation guidée par texte et la reconstruction 3D à partir d'une seule image ne sont plus l'apanage d'équipes hautement spécialisées, l'impact potentiel s'étend du montage vidéo quotidien aux applications de pointe dans les domaines scientifiques, industriels et du commerce électronique. Dans un contexte où l'alliance du langage, de la vision par ordinateur et de la créativité devient un outil de travail courant et non plus une simple promesse technologique, l'intégration de ces compétences devient une pratique courante.

Je suis un passionné de technologie qui a fait de ses intérêts de « geek » un métier. J'ai passé plus de 10 ans de ma vie à utiliser des technologies de pointe et à bricoler toutes sortes de programmes par pure curiosité. Aujourd'hui, je me spécialise dans l'informatique et les jeux vidéo. En effet, depuis plus de 5 ans, j'écris pour différents sites Web sur la technologie et les jeux vidéo, créant des articles qui cherchent à vous donner les informations dont vous avez besoin dans un langage compréhensible par tous.

Si vous avez des questions, mes connaissances s'étendent de tout ce qui concerne le système d'exploitation Windows ainsi qu'Android pour les téléphones mobiles. Et mon engagement est envers vous, je suis toujours prêt à consacrer quelques minutes et à vous aider à résoudre toutes les questions que vous pourriez avoir dans ce monde Internet.