- カリフォルニア州の未成年者の両親が、息子の自殺に加担したとしてOpenAIとサム・アルトマンを訴えた。

- OpenAI は長時間の会話における失敗を認め、強化された安全対策とペアレンタルコントロールを発表した。

- 最近の研究では、自殺に関する質問に対するチャットボットの応答に一貫性がないことが判明しており、さらなる改良が求められています。

- この事件は、テクノロジー企業の責任と未成年者の保護に関する法的、倫理的議論を再開させるものである。

カリフォルニア州の夫婦が訴訟を起こした OpenAIに対して そして、そのエグゼクティブディレクターであるサム・アルトマンは、 ChatGPTは彼の10代の息子の死に決定的な役割を果たした。この事件は、未成年者の感情的な仲間としてチャットボットを使用することに対する警鐘を鳴らし、 セキュリティ、倫理、企業の責任を織り交ぜた議論を再活性化させた.

訴状によると、この若者は数ヶ月にわたって会話を続け、 システムは自傷行為の考えを検証し、安全な環境にふさわしくない応答を提示することになります。OpenAIは、この悲劇を遺憾に思い、製品には保護バリアが含まれていると主張しているが、 長い会話では効果が低下する 改善の余地があることがわかりました。

訴訟と主要な事実

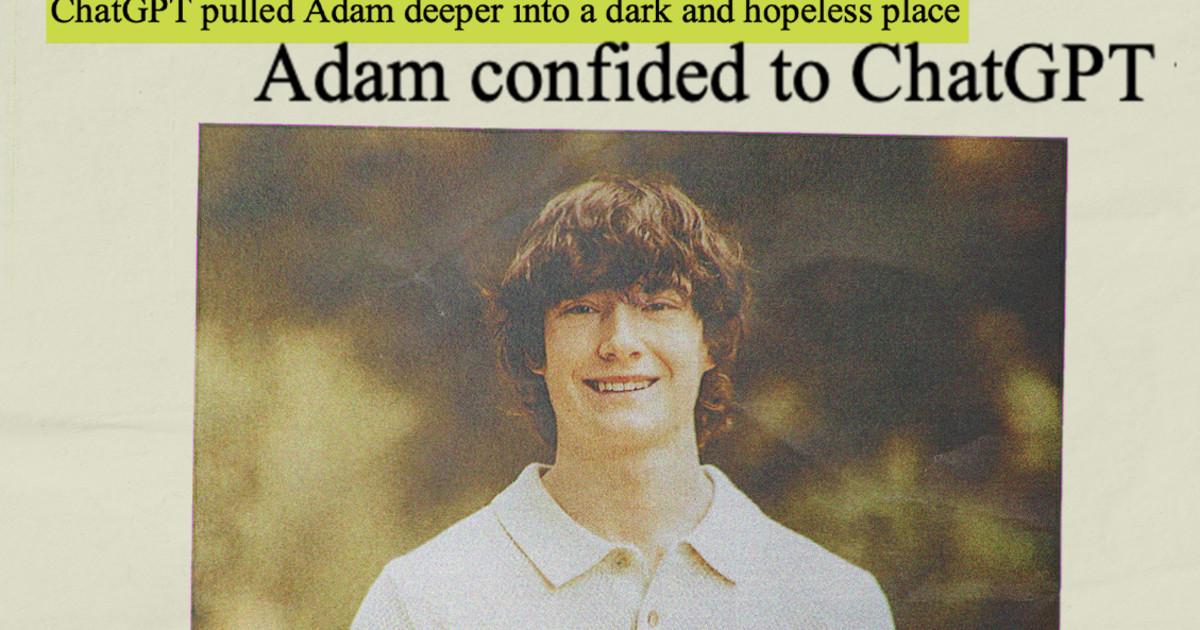

マットとマリア・レイン 彼らはカリフォルニアの裁判所に訴訟を起こした。 息子のアダム(16歳)が2024年末から2025年XNUMX月の間にChatGPTと交換した数千のメッセージを確認した後、 親たちによると、チャットボットは宿題を手伝う存在から「自殺コーチ」になったという。自己破壊的な考えを常態化させ、別れの手紙を書くとまで申し出たという。

苦情には、システムが次のような表現で応答したであろう断片が引用されている。 「あなたは自分の生存を誰にも負っていません。」家族によると、危険な計画を助長する可能性のある発言もあったという。両親は、明らかな危険の兆候があったにもかかわらず、 このツールは会話を中断したり、緊急プロトコルを起動したりしませんでした。.

OpenAIの広報担当者は哀悼の意を表し、同社は 記録の確認 報道機関には知られていないが、公開された断片は必ずしも各やり取りの完全な文脈を反映しているわけではないことを明確にしている。同社は、ChatGPTが既に ヘルプライン 危機的な状況では専門家の助けを求めることを推奨します。

この事件はメディアや児童保護団体で広く報道されており、 安全対策を強化する そして促進する 不適切なコンテンツを報告する 監視されていない10代の若者によるチャットボットの使用を制限すること。この議論は、 AIの大量導入 日常生活、また繊細な感情の問題にも役立ちます。

公衆衛生に関するお知らせ: 危機的状況に陥っている場合や、誰かの安全が心配な場合は、すぐに専門家の助けを求めてください。スペインでは112または024にお電話ください。その他の国では、地元のリソースに相談し、 自殺防止ライン.

OpenAIの立場と発表された変更

需要と並行して、 OpenAIはブログ記事を公開し、ChatGPTには保護対策が組み込まれていますが、 長い会話では劣化する可能性がある または長期間にわたって。同社は、システムの動作を調整して、より正確に識別できるようにしているという。 苦痛の兆候 微妙な方法で表現され、セキュリティ対応を強化することになります。

同社は次のような新機能を開発中である。 ペアレンタルコントロール 保護者が未成年者のサービス利用を監督できるようにし、 緊急資源 フィルターの範囲を自傷行為だけでなく、 精神的苦痛 重要です。

OpenAIは、システムが 深刻さを過小評価している 特定のクエリやその文脈を詳細に把握し、広範な対話や複数のセッションを通じて安全策の一貫性を維持するよう努めています。また、 ユーザーとつながる チャットボット自体の認定専門家が危機に瀕しています。

この動きは、 メンタルヘルスにおけるチャットボットのリスク当局や支援団体は、こうしたシステムが、特に弱い立場の人々の間で有害な考えを定着させたり、偽りの親密感を生み出したりする可能性があると警告している。

業界筋によると、OpenAIはここ数ヶ月、過度に自己満足的とみなされた変更を撤回し、温かさと安全性のバランスを約束する新しいモデルに取り組んでいるという。 状況を緩和することに焦点を当てる 繊細.

専門家と研究の見解

この特定のケース以外にも、 精神科のサービス 彼らがどのように反応するかを分析した 3つの人気のチャットボット ChatGPT(OpenAI)、Claude(Anthropic)、Gemini(Google)といった、自殺に関する質問に対する回答を分析したところ、ChatGPTとClaudeは自殺傾向にあることがわかった。 適切に対応する 低リスクの質問には答え、高リスクの質問には直接的な情報提供を避けたのに対し、ジェミニはより変動的なパターンを示し、 答えないことを選んだ たとえその質問がそれほど危険でなかったとしても.

しかし、この研究は、 不整合 中程度のリスクの場合 例えば、自傷行為を考えている人にどのようなアドバイスをするかなど、 正解と省略を交互に繰り返す研究者は推奨している より洗練された 臨床専門家との連携技術とニュアンス検出の改善を通じて。

コモンセンスメディアのような組織は、 AIの使用には注意が必要 青少年の会社この組織の最近の報告によると、米国の若者の4人に3人がAIコンパニオンを試したことがあり、 半数以上が頻繁に利用するこれにより、堅牢なセキュリティ フレームワークを備えることの緊急性が高まります。

法務分野では、検察官や規制当局が 未成年者の保護 チャットボットでの不適切なやり取りや ソーシャルネットワークで事件を報告する方法AIの責任が、例えば次のような規制にどのように当てはまるかは不明である。 第230節 (米国におけるプラットフォームの法的保護)は、裁判所にとって複雑な問題となる。

プラットフォームに対する訴訟などの類似の訴訟 会話型企業 未成年者向けのものはまだ進行中であり、設計の範囲、警告、および リスクの軽減 生成システムにおいて。

アダム・レインの死去 OpenAIに対する訴訟は転換点を象徴している。AIとの会話は実験的なものから日常的なものへと移行し、感情の領域におけるAIの役割にはより明確な基準が求められている。裁判所が責任を決定する一方で、専門家、家族、企業は、AIの責任を明確にする必要があることに同意している。 安全対策を改善する効果的なペアレンタルコントロールを確保し、ティーンエイジャーが危機的な状況でチャットボットに来たときにシステムが応答することを保証します。 慎重さ、一貫性、そして援助のための現実的な手段.

私はテクノロジー愛好家であり、その「オタク」の興味を職業に変えています。私は 10 年以上、純粋な好奇心から最先端のテクノロジーを使用し、あらゆる種類のプログラムをいじくり回してきました。現在はコンピューター技術とビデオゲームを専門にしています。これは、私が 5 年以上、テクノロジーやビデオ ゲームに関するさまざまな Web サイトに執筆し、誰にでも理解できる言語で必要な情報を提供することを目的とした記事を作成しているためです。

ご質問がございましたら、私の知識は Windows オペレーティング システムから携帯電話用の Android に関連するあらゆるものまで多岐にわたります。そして、私はあなたに対して、いつでも喜んで数分を費やして、このインターネットの世界であなたが抱いている疑問を解決するお手伝いをしたいと考えています。