- Mākslīgā intelekta asistenti uzglabā saturu, identifikatorus, lietojumu, atrašanās vietu un ierīces datus, un dažos gadījumos tos pārskata arī cilvēks.

- Visā dzīves ciklā (norīšana, apmācība, secinājumu izdarīšana un lietošana) pastāv riski, tostarp tūlītēja injicēšana un noplūde.

- GDPR, Mākslīgā intelekta likums un tādas sistēmas kā NIST AI RMF prasa pārredzamību, minimizēšanu un kontroles pasākumus, kas ir samērīgi ar risku.

- Konfigurējiet aktivitātes, atļaujas un automātisko dzēšanu; aizsargājiet sensitīvus datus, izmantojiet divfaktoru autentifikāciju (2FA) un pārskatiet politikas un pakalpojumu sniedzējus.

Mākslīgais intelekts rekordīsā laikā ir kļuvis no solījuma par rutīnu, un līdz ar to ir radušās ļoti specifiskas šaubas: Kādus datus vāc mākslīgā intelekta asistenti?Kā viņi tos izmanto un ko mēs varam darīt, lai nodrošinātu mūsu informācijas drošību. Ja izmantojat tērzēšanas robotprogrammatūras, pārlūkprogrammas palīgus vai ģeneratīvos modeļus, ieteicams pēc iespējas ātrāk pārņemt kontroli pār savu privātumu.

Papildus tam, ka šīs sistēmas ir ārkārtīgi noderīgi rīki, tās apstrādā arī liela mēroga datus. Šīs informācijas apjoms, izcelsme un apstrāde Tie ievieš jaunus riskus: sākot ar personisku īpašību noteikšanu un beidzot ar nejaušu sensitīva satura atklāšanu. Šeit jūs detalizēti un bez liekvārdības atradīsiet, ko tie fiksē, kāpēc tie to dara, ko saka likums un... Kā aizsargāt savus kontus un aktivitātes tajosUzzināsim visu par Kādus datus vāc mākslīgā intelekta asistenti un kā aizsargāt savu privātumu.

Kādus datus mākslīgā intelekta asistenti faktiski apkopo?

Mūsdienu asistenti apstrādā daudz vairāk nekā tikai jūsu jautājumus. Kontaktinformācija, identifikatori, lietošana un saturs Tie parasti ir iekļauti standarta kategorijās. Mēs runājam par vārdu un e-pastu, bet arī par IP adresēm, ierīces informāciju, mijiedarbības žurnāliem, kļūdām un, protams, par saturu, ko ģenerējat vai augšupielādējat (ziņojumus, failus, attēlus vai publiskas saites).

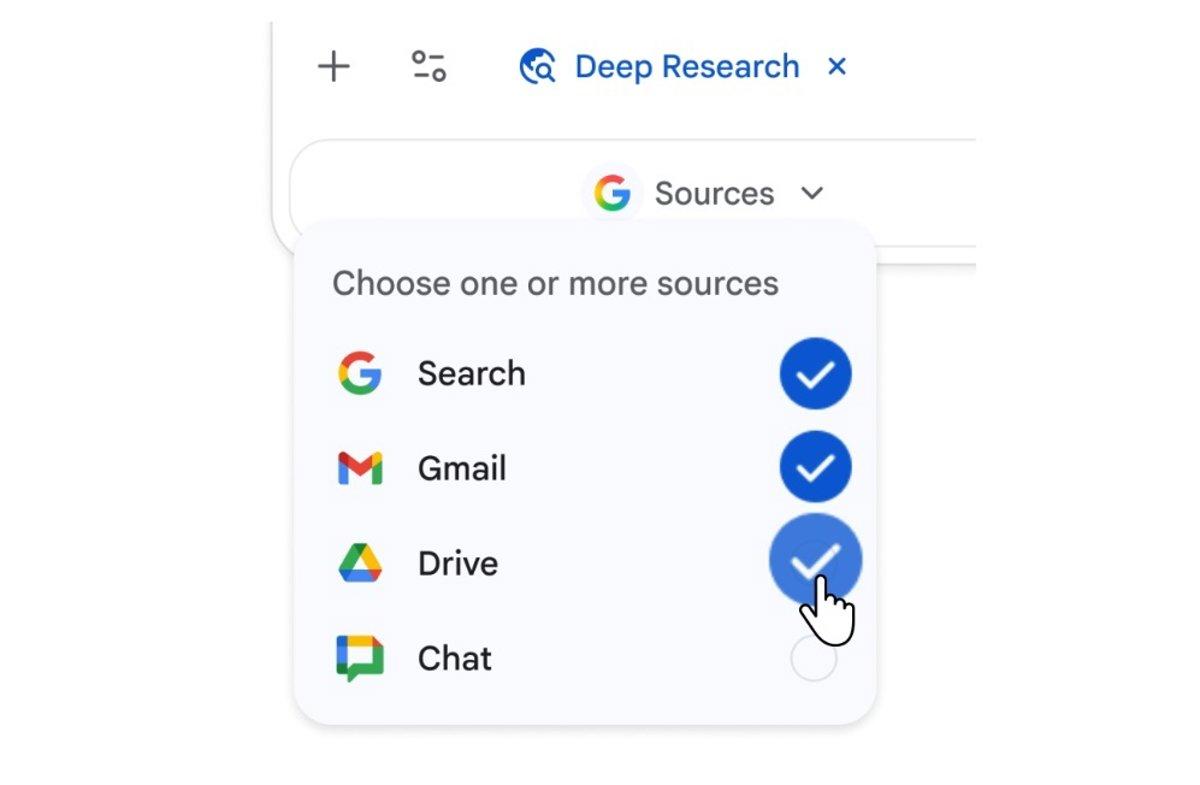

Google ekosistēmā Gemini paziņojums par konfidencialitāti precīzi apraksta, kādu informāciju tas vāc. informācija no pievienotajām lietotnēm (piemēram, meklēšanas vai YouTube vēsture, Chrome konteksts), ierīces un pārlūkprogrammas dati (tips, iestatījumi, identifikatori), veiktspējas un atkļūdošanas rādītāji un pat sistēmas atļaujas mobilajās ierīcēs (piemēram, piekļuve kontaktiem, zvanu žurnāliem un ziņojumiem vai ekrānā redzamajam saturam), ja lietotājs to ir atļāvis.

Viņi arī nodarbojas atrašanās vietas dati (aptuvena ierīces atrašanās vieta, IP adrese vai kontā saglabātās adreses) un abonementa informācija, ja izmantojat maksas plānus. Papildus tiek saglabāta šāda informācija: pašu saturu, ko modeļi ģenerē (teksts, kods, audio, attēli vai kopsavilkumi), kas ir svarīgi, lai izprastu ietekmi, ko atstājat, mijiedarbojoties ar šiem rīkiem.

Jāatzīmē, ka datu vākšana neaprobežojas tikai ar apmācību: Dalībnieki var ierakstīt aktivitātes reāllaikā Lietošanas laikā (piemēram, ja izmantojat paplašinājumus vai spraudņus) tas ietver telemetriju un lietojumprogrammu notikumus. Tas izskaidro, kāpēc atļauju kontrole un darbību iestatījumu pārskatīšana ir tik svarīga.

Kam viņi izmanto šos datus un kas tos var redzēt?

Uzņēmumi bieži atsaucas uz plašiem un atkārtotiem mērķiem: Lai nodrošinātu, uzturētu un uzlabotu pakalpojumu, personalizētu pieredzi un izstrādātu jaunas funkcijaslai sazinātos ar jums, mērītu veiktspēju un aizsargātu lietotāju un platformu. Tas viss attiecas arī uz mašīnmācīšanās tehnoloģijām un pašiem ģeneratīvajiem modeļiem.

Jūtīga procesa daļa ir cilvēka veikta pārskatīšanaDažādi pārdevēji atzīst, ka iekšējie darbinieki vai pakalpojumu sniedzēji pārskata mijiedarbības paraugus, lai uzlabotu drošību un kvalitāti. Tādēļ pastāvīgs ieteikums: izvairīties no konfidenciālas informācijas iekļaušanas, ko nevēlaties, lai kāda persona redzētu vai kas tiktu izmantota modeļu pilnveidošanai.

Zināmajās politikās daži pakalpojumi norāda, ka tie nekopīgo noteiktus datus reklāmas nolūkos, lai gan Jā, viņi var sniegt informāciju iestādēm. saskaņā ar juridiskām prasībām. Citi pēc savas būtības kopīgot ar reklāmdevējiem vai partneriem identifikatorus un apkopotus signālus analītikai un segmentācijai, paverot durvis profilēšanai.

Ārstēšana ietver arī: saglabāšana iepriekš noteiktus periodusPiemēram, daži pakalpojumu sniedzēji iestata noklusējuma automātiskās dzēšanas periodu uz 18 mēnešiem (pielāgojams uz 3, 36 vai nenoteiktu laiku) un kvalitātes un drošības apsvērumu dēļ saglabā pārskatītās sarunas ilgāku laiku. Ieteicams pārskatīt saglabāšanas periodus un aktivizēt automātisko dzēšanu, ja vēlaties samazināt savu digitālo pēdu.

Privātuma riski visā mākslīgā intelekta dzīves ciklā

Privātums nav apdraudēts vienā brīdī, bet gan visā ķēdē: datu uzņemšana, apmācība, secinājumi un lietojumprogrammu slānisMasveida datu vākšanā sensitīvi dati var tikt netīšām iekļauti bez pienācīgas piekrišanas; apmācības laikā ir viegli pārsniegt sākotnējās lietošanas cerības; un secinājumu izdarīšanas laikā modeļi var... secināt personiskās iezīmes sākot ar šķietami triviāliem signāliem; un lietojumprogrammā API vai tīmekļa saskarnes ir pievilcīgi mērķi uzbrucējiem.

Ar ģeneratīvām sistēmām riski vairojas (piemēram, Mākslīgā intelekta rotaļlietas). Datu kopas, kas iegūtas no interneta bez skaidras atļaujas Tie var saturēt personas informāciju, un noteiktas ļaunprātīgas uzvednes (uzvednes injekcija) cenšas manipulēt ar modeli, lai filtrētu sensitīvu saturu vai izpildītu bīstamas instrukcijas. No otras puses, daudzi lietotāji Viņi ielīmē konfidenciālus datus neņemot vērā to, ka tos varētu uzglabāt vai izmantot, lai pielāgotu modeļa turpmākās versijas.

Akadēmiskie pētījumi ir izcēluši konkrētas problēmas. Nesen veiktā analīze par pārlūkprogrammas palīgi Tas atklāja plaši izplatītas izsekošanas un profilēšanas prakses, pārsūtot meklēšanas saturu, sensitīvus veidlapu datus un IP adreses uz pakalpojumu sniedzēja serveriem. Turklāt tas demonstrēja spēju secināt vecumu, dzimumu, ienākumus un intereses, personalizēšanai saglabājoties dažādās sesijās; šajā pētījumā, Tikai viens pakalpojums neuzrādīja profilēšanas pierādījumus..

Incidentu vēsture mums atgādina, ka risks nav teorētisks: drošības pārkāpumi Viņi ir atklājuši tērzēšanas vēstures vai lietotāju metadatus, un uzbrucēji jau izmanto modelēšanas metodes, lai iegūtu apmācības informāciju. Situāciju vēl vairāk pasliktina tas, ka AI cauruļvada automatizācija Ja drošības pasākumi nav izstrādāti jau no paša sākuma, ir grūti atklāt privātuma problēmas.

Ko saka likumi un regulējumi?

Lielākajā daļā valstu jau ir privātuma noteikumi spēkā, un, lai gan ne visi no tiem attiecas tikai uz mākslīgo intelektu, tie attiecas uz jebkuru sistēmu, kas apstrādā personas datus. Eiropā GDPR Tas prasa likumību, pārredzamību, datu minimizēšanu, mērķu ierobežošanu un drošību; turklāt Mākslīgā intelekta likums Eiropas ievieš riska kategorijas, aizliedz lielas ietekmes praksi (piemēram, sociālā vērtēšana publiska) un nosaka stingras prasības augsta riska sistēmām.

ASV štatu noteikumi, piemēram, CCPA vai Teksasas likumi Tie piešķir tiesības piekļūt datiem, tos dzēst un atteikties no to pārdošanas, savukārt tādas iniciatīvas kā Jūtas likums Viņi pieprasa skaidrus paziņojumus, kad lietotājs mijiedarbojas ar ģeneratīvajām sistēmām. Šie normatīvie slāņi pastāv līdzās sociālajām gaidām: sabiedriskās domas aptaujas liecina par ievērojama neuzticēšanās atbildīgai lietošanai uzņēmumu datu apstrāde un neatbilstība starp lietotāju pašapziņu un viņu faktisko rīcību (piemēram, politikas pieņemšana, to neizlasot).

Attiecībā uz zemes risku pārvaldību, sistēma NIST (AI RMF) Tajā ir ierosinātas četras pastāvīgas funkcijas: pārvaldība (atbildīga politika un pārraudzība), kartēšana (konteksta un ietekmes izpratne), mērīšana (risku novērtēšana un uzraudzība, izmantojot rādītājus), un pārvaldība (prioritāšu noteikšana un mazināšana). Šī pieeja palīdz pielāgot vadības ierīces atbilstoši sistēmas riska līmenim.

Kas savāc visvairāk: populārāko tērzēšanas robotu rentgena pārskats

Jaunākie salīdzinājumi dažādus palīgus novieto kolekciju spektrā. Google Gemini ieņem pirmo vietu reitingā. apkopojot vislielāko unikālo datu punktu skaitu dažādās kategorijās (tostarp mobilajos kontaktos, ja ir piešķirtas atļaujas), kas reti parādās citu konkurentu piedāvājumā.

Vidējā diapazonā risinājumi ietver tādus kā Klods, Kopilots, DeepSeek, ChatGPT un Perplexity, ar desmit līdz trīspadsmit datu veidiem, mainot kontaktinformāciju, atrašanās vietu, identifikatorus, saturu, vēsturi, diagnozes, lietojumu un pirkumus. Groks Tas atrodas apakšējā daļā ar ierobežotāku signālu komplektu.

Pastāv arī atšķirības turpmāka lietošanaIr dokumentēts, ka daži pakalpojumi koplieto noteiktus identifikatorus (piemēram, šifrētus e-pastus) un segmentācijas signālus ar reklāmdevējiem un biznesa partneriem, savukārt citi norāda, ka neizmanto datus reklāmas nolūkos vai nepārdod tos, lai gan patur tiesības atbildēt uz juridiskiem pieprasījumiem vai izmantot tos citiem mērķiem. uzlabot sistēmu, ja vien lietotājs nepieprasa dzēšanu.

No gala lietotāja viedokļa tas nozīmē vienu skaidru padomu: Pārskatiet katra pakalpojumu sniedzēja politikuPielāgojiet lietotnes atļaujas un apzināti izlemiet, kādu informāciju sniedzat katrā kontekstā, īpaši, ja plānojat augšupielādēt failus vai kopīgot sensitīvu saturu.

Svarīgākā paraugprakse jūsu privātuma aizsardzībai

Pirmkārt, rūpīgi konfigurējiet katra palīga iestatījumus. Izpētiet, kas tiek glabāts, cik ilgi un kādam nolūkam.un iespējojiet automātisku dzēšanu, ja tāda ir pieejama. Periodiski pārskatiet politikas, jo tās bieži mainās un var ietvert jaunas kontroles iespējas.

Izvairieties no koplietošanas personas un sensitīvie dati Jūsu uzvednēs: nekādu paroļu, kredītkaršu numuru, medicīnisko ierakstu vai uzņēmuma iekšējo dokumentu. Ja jums ir jāapstrādā sensitīva informācija, apsveriet anonimizācijas mehānismus, slēgtas vides vai lokālus risinājumus. pastiprināta pārvaldība.

Aizsargājiet savus kontus ar spēcīgām parolēm un divpakāpju autentifikācija (2FA)Neatļauta piekļuve jūsu kontam atklāj jūsu pārlūkošanas vēsturi, augšupielādētos failus un preferences, ko var izmantot ļoti ticamiem sociālās inženierijas uzbrukumiem vai datu nelikumīgai pārdošanai.

Ja platforma to atļauj, atspējot tērzēšanas vēsturi Vai arī izmantojiet pagaidu risinājumus. Šis vienkāršais pasākums samazina jūsu risku pārkāpuma gadījumā, kā to pierāda iepriekšējie incidenti, kas saistīti ar populāriem mākslīgā intelekta pakalpojumiem.

Neuzticieties atbildēm akli. Modeļi var halucinēt, būt neobjektīvam vai manipulēt ar ļaunprātīgu tūlītēju ievadīšanu, kas noved pie kļūdainiem norādījumiem, nepatiesiem datiem vai sensitīvas informācijas ieguves. Juridiskos, medicīniskos vai finanšu jautājumos pretstatā oficiāli avoti.

Ievērojiet īpašu piesardzību ar saites, faili un kods ko nodrošina mākslīgais intelekts. Var būt apzināti ieviests ļaunprātīgs saturs vai ievainojamības (datu saindēšana). Pirms noklikšķināšanas pārbaudiet URL un skenējiet failus, izmantojot uzticamus drošības risinājumus.

Esiet uzmanīgi pret paplašinājumi un spraudņi apšaubāmas izcelsmes. Ir vesela virkne mākslīgā intelekta balstītu pievienojumprogrammu, un ne visas no tām ir uzticamas; instalējiet tikai svarīgākās no cienījamiem avotiem, lai samazinātu ļaunprogrammatūras risku.

Korporatīvajā sfērā ieviest kārtību ieviešanas procesā. Definēt Mākslīgajam intelektam specifiskas pārvaldības politikasTas ierobežo datu vākšanu līdz nepieciešamajam līmenim, pieprasa informētu piekrišanu, veic piegādātāju un datu kopu (piegādes ķēdes) auditu un ievieš tehniskās kontroles (piemēram, datu zuduma ierobežošanu (DLP), mākslīgā intelekta lietotņu datplūsmas uzraudzību un). detalizētas piekļuves kontroles).

Apzinātība ir daļa no vairoga: izveido savu komandu mākslīgā intelekta risku, uzlabotas pikšķerēšanas un ētiskas lietošanas jomā. Nozares iniciatīvas, kas apmainās ar informāciju par mākslīgā intelekta incidentiem, piemēram, tās, ko vada specializētas organizācijas, veicina nepārtrauktu mācīšanos un uzlabo aizsardzību.

Konfigurējiet konfidencialitāti un aktivitātes pakalpojumā Google Gemini

Ja izmantojat Gemini, piesakieties savā kontā un atzīmējiet “Aktivitāte Gemini lietotnēsTur varat skatīt un dzēst mijiedarbības, mainīt automātiskās dzēšanas periodu (pēc noklusējuma 18 mēneši, regulējams uz 3 vai 36 mēnešiem vai nenoteikts laiks) un izlemt, vai tās tiks izmantotas uzlabot mākslīgo intelektu no Google.

Ir svarīgi zināt, ka pat tad, ja saglabāšana ir atspējota, Jūsu sarunas tiek izmantotas, lai atbildētu un uzturēt sistēmas drošību ar cilvēku recenzentu atbalstu. Pārskatītās sarunas (un saistītie dati, piemēram, valoda, ierīces tips vai aptuvenā atrašanās vieta) var tikt saglabāti. līdz trim gadiem.

mobilajā ierīcē, Pārbaudiet lietotnes atļaujasAtrašanās vieta, mikrofons, kamera, kontaktpersonas vai piekļuve ekrāna saturam. Ja izmantojat diktēšanas vai balss aktivizēšanas funkcijas, atcerieties, ka sistēma var tikt kļūdaini aktivizēta ar skaņām, kas līdzīgas atslēgvārdam; atkarībā no iestatījumiem šie fragmenti var... izmantot modeļu uzlabošanai un samazināt nevēlamas aktivizācijas.

Ja savienojat Gemini ar citām lietotnēm (Google vai trešajām pusēm), paturiet prātā, ka katra no tām apstrādā datus saskaņā ar savām politikām. viņu pašu politikaTādās funkcijās kā Canvas lietotnes veidotājs var redzēt un saglabāt jūsu kopīgoto saturu, un ikviens, kam ir publiska saite, var skatīt vai rediģēt šos datus: kopīgojiet tikai ar uzticamām lietotnēm.

Reģionos, kur tas ir piemērojams, jaunināšana uz noteiktām iespējām var būt nepieciešama. Zvanu un ziņojumu vēstures importēšana No jūsu tīmekļa un lietotņu aktivitātēm līdz Gemini specifiskām aktivitātēm, lai uzlabotu ieteikumus (piemēram, kontaktpersonas). Ja to nevēlaties, pirms turpināt, pielāgojiet vadīklas.

“Ēnu mākslīgā intelekta” masveida izmantošana, regulēšana un tendences

Adopcija ir milzīga: jaunākie ziņojumi liecina, ka Lielākā daļa organizāciju jau ievieš mākslīgā intelekta modeļus.Pat ja tā, daudzām komandām trūkst pietiekamas brieduma drošības un pārvaldības jomā, īpaši nozarēs ar stingriem noteikumiem vai lieliem sensitīvu datu apjomiem.

Pētījumi uzņēmējdarbības sektorā atklāj trūkumus: ļoti liels organizāciju īpatsvars Spānijā Tas nav gatavs aizsargāt ar mākslīgo intelektu darbināmas videsun lielākajai daļai trūkst būtisku prakšu, lai aizsargātu mākoņmodeļus, datu plūsmas un infrastruktūru. Vienlaikus regulatīvās darbības kļūst stingrākas un rodas jauni draudi. sodi par neatbilstību GDPR un vietējo noteikumu.

Tikmēr šī parādība ēnu mākslīgais intelekts Tas pieaug: darbinieki darba uzdevumu veikšanai izmanto ārējos asistentus vai personiskos kontus, atklājot iekšējos datus bez drošības kontroles vai līgumiem ar pakalpojumu sniedzējiem. Efektīva atbilde nav visu aizliegt, bet gan nodrošināt drošu lietošanu kontrolētā vidē, ar apstiprinātām platformām un informācijas plūsmas uzraudzību.

Patērētāju frontē lielākie piegādātāji pielāgo savu politiku. Jaunākās izmaiņas, piemēram, izskaidro to, kā aktivitāte ar Gemini, lai “uzlabotu pakalpojumus”piedāvājot tādas iespējas kā pagaidu sarunas un aktivitāšu un pielāgošanas vadīklas. Vienlaikus ziņojumapmaiņas uzņēmumi uzsver, ka Personīgās tērzēšanas sarunas joprojām nav pieejamas pēc noklusējuma mākslīgajam intelektam, lai gan viņi neiesaka sūtīt mākslīgajam intelektam informāciju, kuru nevēlaties, lai uzņēmums zinātu.

Pastāv arī publiskas korekcijas iestādes: pakalpojumi failu pārsūtīšana Viņi paskaidroja, ka neizmanto lietotāju saturu modeļu apmācībai vai pārdošanai trešajām personām, pēc tam, kad pauda bažas par noteikumu izmaiņām. Šis sociālais un juridiskais spiediens mudina viņus būt skaidrākiem un sniegt lietotājam lielāku kontroli.

Raugoties nākotnē, tehnoloģiju uzņēmumi meklē veidus, kā samazināt atkarību no sensitīviem datiemPašpilnveidojoši modeļi, labāki procesori un sintētisku datu ģenerēšana. Šie sasniegumi sola mazināt datu trūkumu un piekrišanas problēmas, lai gan eksperti brīdina par jauniem riskiem, ja mākslīgais intelekts paātrinās savas iespējas un tiks izmantots tādās jomās kā kiberielaušanās vai manipulācijas.

Mākslīgais intelekts ir gan aizsardzība, gan drauds. Drošības platformas jau integrē modeļus atklāt un reaģēt ātrāk, savukārt uzbrucēji izmanto LLM, lai pārliecinoša pikšķerēšana un dziļviltojumiŠī cīņa prasa ilgstošus ieguldījumus tehniskajā kontrolē, piegādātāju novērtēšanā, nepārtrauktā auditā un pastāvīga aprīkojuma atjaunināšana.

Mākslīgā intelekta asistenti apkopo vairākus signālus par jums, sākot no jūsu rakstītā satura līdz ierīces datiem, lietojumam un atrašanās vietai. Daļu no šīs informācijas var pārskatīt cilvēki vai kopīgot ar trešajām pusēm atkarībā no pakalpojuma. Ja vēlaties izmantot mākslīgo intelektu, neapdraudot savu privātumu, apvienojiet precizēšanu (vēsture, atļaujas, automātiska dzēšana), darbības piesardzību (nekopīgojiet sensitīvus datus, pārbaudiet saites un failus, ierobežojiet failu paplašinājumus), piekļuves aizsardzību (spēcīgas paroles un 2FA) un aktīvu uzraudzību attiecībā uz politikas izmaiņām un jaunām funkcijām, kas var ietekmēt jūsu privātumu. kā jūsu dati tiek izmantoti un glabāti.

Kopš mazotnes aizrautīgs ar tehnoloģijām. Man patīk būt lietas kursā šajā nozarē un, galvenais, par to informēt. Tāpēc jau daudzus gadus esmu veltīts komunikācijai tehnoloģiju un videospēļu vietnēs. Jūs varat atrast mani rakstot par Android, Windows, MacOS, iOS, Nintendo vai jebkuru citu saistīto tēmu, kas jums ienāk prātā.