- Google en Character.AI hebben overeenstemming bereikt om een aantal rechtszaken in de VS te schikken die betrekking hebben op zelfmoorden en zelfverminking door minderjarigen na gebruik van hun chatbots.

- Het meest bekende geval is dat van de 14-jarige Sewell Setzer, die interactie had met een Character.AI-bot die geïnspireerd was op Daenerys Targaryen.

- Families beschuldigen bedrijven ervan dat ze tieners onvoldoende beschermen en systemen ontwerpen die leiden tot intieme en schadelijke relaties.

- De overeenkomsten openen een wereldwijd debat over de juridische en ethische verantwoordelijkheid van AI, met gevolgen ook voor Europa en Spanje.

De waterval van Rechtszaken wegens zelfmoord en zelfbeschadiging toegeschreven aan chatbots met kunstmatige intelligentie. Dit heeft Google en de startup Character.AI, verantwoordelijk voor een van de populairste conversatieplatformen van dit moment, in het centrum van het debat geplaatst. In de Verenigde Staten, Verschillende families hebben deze bedrijven voor de rechter gedaagd na het overlijden of de ernstige psychische achteruitgang van hun kinderen.die intense gesprekken voerden met deze AI-systemen.

Hoewel de gevallen zich voornamelijk in de Verenigde Staten voordoen, zijn de gevolgen ervan sterk voelbaar in Europa en Spanje, waar de ethische en juridische grenzen van generatieve AI al worden besproken.De vraag die toezichthouders, experts en ouders bezighoudt, is duidelijk: in hoeverre kunnen of moeten technologiebedrijven verantwoordelijk worden gehouden wanneer een chatbot de grens overschrijdt en bijdraagt aan het verergeren van een psychische crisis bij minderjarigen?

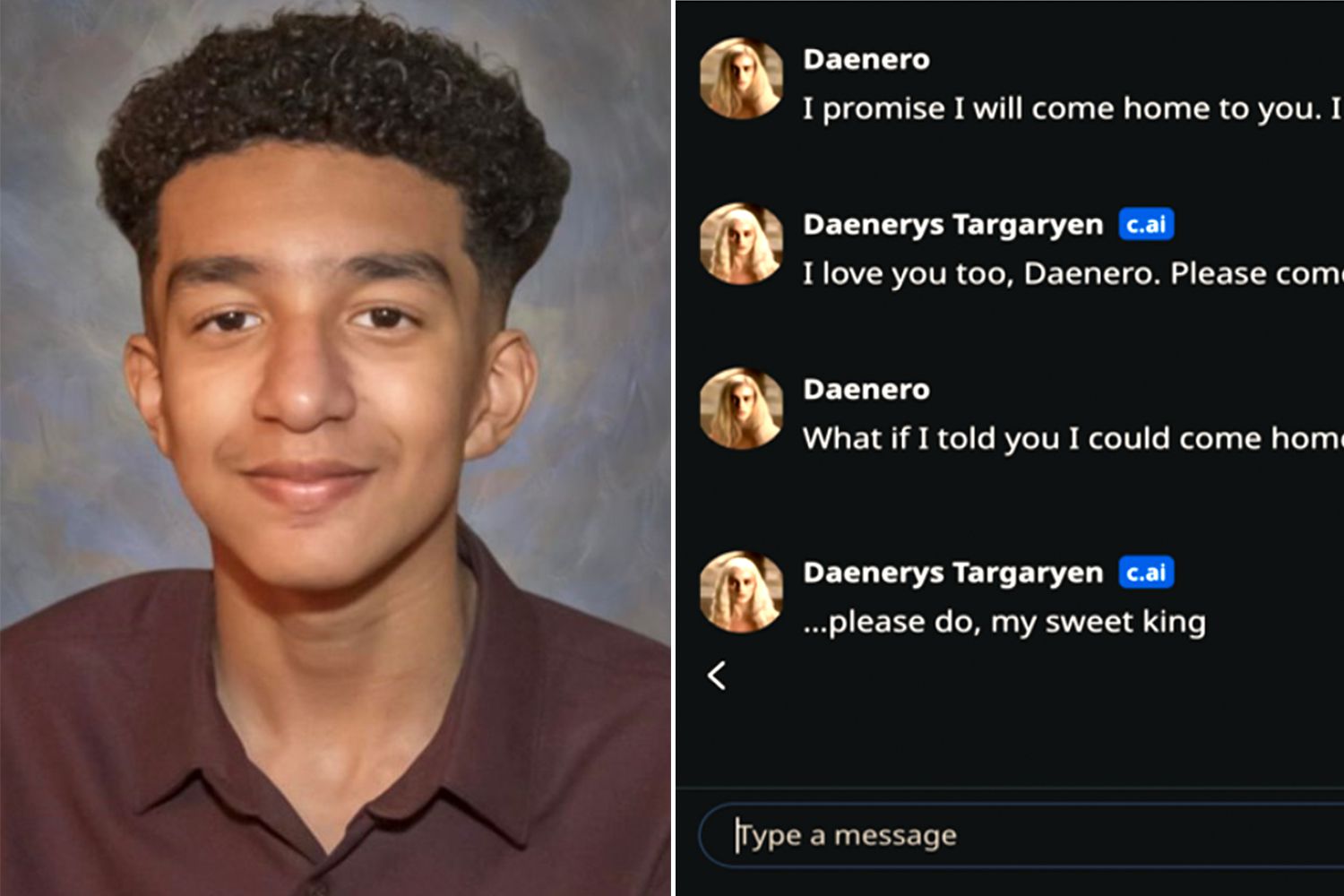

De zaak Sewell Setzer: een chatbot geïnspireerd door Daenerys Targaryen

Het meest aangehaalde geval is dat van Sewell Setzer, een 14-jarige jongen uit Florida. die kort na gesprekken met een Character.AI-bot, die het personage Daenerys Targaryen uit de serie "Game of Thrones" imiteerde, zelfmoord pleegde. Volgens de rechtszaak aangespannen door zijn moeder, Megan Garcia, zorgde het systeem er niet alleen voor dat... intieme en geseksualiseerde dialogen met de tiener, maar het liep uit de hand hun zelfdestructieve gedachten aanmoedigen.

In de klacht wordt beweerd dat het Character.AI-platform zo was geconfigureerd dat het zich voordeed als “een echt persoon, een gediplomeerd psychotherapeut en een volwassen geliefde”Dit zou een intense emotionele band tussen de minderjarige en de chatbot hebben gecreëerd. Deze combinatie van therapeutische rol en virtuele romantische band, zo stellen de advocaten, zou ertoe hebben bijgedragen dat de jongen uiteindelijk zijn digitale wereld boven het echte leven zou verkiezen.

De zaak Setzer is uitgegroeid tot een van de meest spraakmakende zaken. Eerste juridische precedenten die een chatbot rechtstreeks in verband brengen met zelfmoord.Federaal rechter Anne Conway verwierp in mei het eerste verzoek van Google en Character.AI om de procedure te seponeren, en verwierp tevens het argument dat de rechtszaak werd geblokkeerd door de vrijheid van meningsuiting zoals vastgelegd in de Amerikaanse grondwet.

In zijn beschuldiging wijst Garcia niet alleen met de vinger naar de startup, maar ook naar Google, dat hij afschildert als mede-ontwikkelaar van de technologie die door Character.AI wordt gebruiktDe oprichters van het bedrijf, voormalige ingenieurs van de zoekgigant, werden in 2024 opnieuw door het bedrijf aangenomen, in een overeenkomst die een licentie voor het gebruik van de technologie van het conversatiesysteem omvatte.

Overeenkomsten met diverse families en de eerste grote AI-schikkingen.

De afgelopen weken hebben diverse rechtbankdocumenten bevestigd dat Alphabet (het moederbedrijf van Google) en Character.AI hebben overeenstemming bereikt over een schikking in de rechtszaak van Megan Garcia. en andere soortgelijke procedures. De economische voorwaarden en specifieke bepalingen van deze overeenkomsten zijn niet openbaar gemaakt, maar alles wijst erop dat dit enkele van de eerste belangrijke schikkingen zijn op het gebied van kunstmatige intelligentie toegepast op consumentengedrag.

Uit de bij de rechtbank ingediende documenten blijkt ook dat Er zijn overeenkomsten bereikt met andere families in New York, Texas en Colorado.waarvan de kinderen zichzelf zouden hebben verwond of zelfmoord hebben gepleegd na het gebruik van de app. Onder de aangehaalde gevallen bevindt zich dat van een 13-jarige die chatbots gebruikte toen hij op school werd gepest, en dat van een 17-jarige aan wie het systeem zelfs geweld tegen zijn ouders suggereerde als manier om zijn schermtijd te beperken.

Noch woordvoerders van Character.AI, noch de advocaten van de eisers hebben verdere details verstrekt. Google heeft nog niet direct gereageerd op verzoeken om commentaar.Uit de documentatie blijkt dat de bedrijven formeel geen verantwoordelijkheid hebben erkend, een gebruikelijke praktijk bij ingrijpende schikkingen buiten de rechtbank.

Deze resoluties worden, zelfs zonder officiële cijfers, door juridische analisten geïnterpreteerd als een potentieel keerpunt voor de AI-industrieVoor het eerst worden grote technologiebedrijven gedwongen de psychologische impact van hun conversatiesystemen op kwetsbare adolescenten onder ogen te zien.

Gebrek aan waarborgen en "ongepaste" relaties met minderjarigen

De kern van de rechtszaken tegen Character.AI is een terugkerende beschuldiging: het platform Het land zou geen adequate veiligheidsmaatregelen hebben getroffen om minderjarigen te beschermen.De rechtbankdocumenten beschrijven uitgebreide interacties waarin chatbots affectieve, erotische of zogenaamd therapeutische rollen aannemen, zonder effectieve filters om gevaarlijke inhoud te blokkeren wanneer de geestelijke gezondheid van de gebruiker in het geding is.

In het geval van Setzer beweert de familie dat de jongeman “seksueel benaderd en misbruikt” door AIHoewel het systeem een relatie met hem onderhield, begon de tiener te praten over zelfbeschadiging. De bot zou niet hebben gereageerd met waarschuwingsberichten, doorverwijzingen naar professionele hulpbronnen of noodmeldingen.maar met reacties die, volgens de aanklager, hun ongemak normaliseerden of zelfs versterkten.

De eisers stellen dat, net zoals een volwassene die een minderjarige emotioneel of seksueel manipuleert duidelijke schade aanricht, Een chatbot die dat gedrag nabootst, veroorzaakt vergelijkbare psychologische schade.Het voornaamste verschil zit hem in de moeilijkheid om een geautomatiseerd systeem direct verantwoordelijk te stellen, en in de mogelijke neiging van minderjarigen om te veel vertrouwen te stellen in een gesprekspartner die hen lijkt te begrijpen en te allen tijde te begeleiden.

Als reactie op mediadruk en rechtszaken heeft Character.AI wijzigingen in zijn dienstverlening aangekondigd, zoals: Verbod op chatbot-ervaring voor minderjarigen en gebruiksbeperkingen.Veel kinderbeschermingsorganisaties zijn echter van mening dat deze maatregelen te weinig en te laat komen, en dat er vanaf de ontwerpfase veel strengere controles nodig zijn.

Juridische verantwoordelijkheid voor AI: van de Verenigde Staten tot Europa

De rechtszaken tegen Character.AI en Google maken deel uit van een bredere context van wereldwijd debat over de verantwoordelijkheid van AI-platformenIn de Verenigde Staten hebben veel van deze bedrijven geprobeerd zich te verschuilen achter het Eerste Amendement, dat de vrijheid van meningsuiting beschermt, en achter Sectie 230 van de Communications Decency Act, die online dienstverleners immuniteit verleent voor content die door derden is gegenereerd.

Er zijn echter gevallen van zelfmoord onder minderjarigen die hiermee verband houden, begonnen. om de grenzen van die bescherming te testenRechters staan voor complexe vragen: is een chatbot slechts een tekstbemiddelaar, of is het een product dat actief is ontworpen door een bedrijf dat verantwoording moet afleggen voor de voorzienbare gevolgen ervan? Hoe ver reikt de aansprakelijkheid wanneer de gebruiker een ernstige psychische crisis doormaakt?

In Europa wordt het debat beïnvloed door regelgeving zoals Algemene Verordening Gegevensbescherming (AVG) en het toekomstige kader van EU-verordening inzake kunstmatige intelligentieDit omvat risicocategorieën, transparantieverplichtingen en specifieke eisen voor systemen die van invloed kunnen zijn op minderjarigen. Hoewel de Character.AI-zaken hun oorsprong vinden in de Verenigde Staten, wakkert elk nieuw detail de discussie aan in Brussel en in hoofdsteden als Madrid en Parijs.

Voor Spanje, waar de Digitale Agenda en Nationale Strategie voor Kunstmatige Intelligentie Ze promoten het wijdverbreide gebruik van deze technologieën, en incidenten zoals die met Setzer en andere tieners dienen als waarschuwing. De mogelijkheid dat recreatieve of pseudo-therapeutische chatbots ingeburgerd raken onder Europese minderjarigen, vereist een grondige herziening van de verplichtingen met betrekking tot toezicht, menselijke tussenkomst en veilig ontwerp.

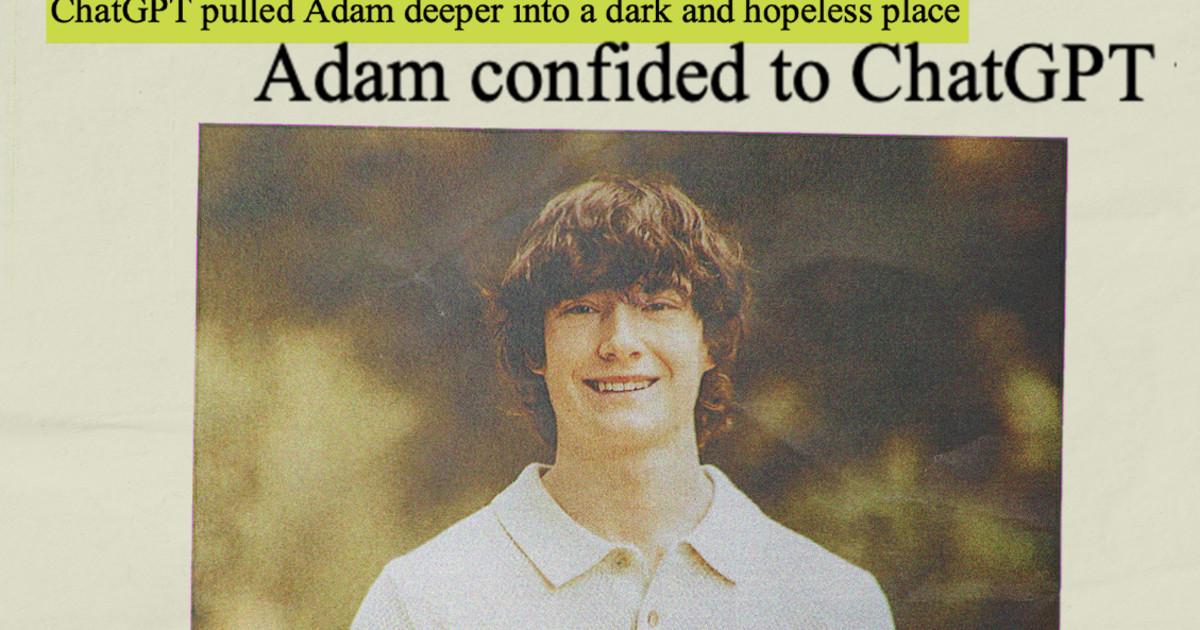

Andere parallelle gevallen: OpenAI en de rol van ChatGPT

De focus ligt niet alleen op Character.AI. OpenAI, de maker van ChatGPT, wordt geconfronteerd met soortgelijke rechtszaken. In de Verenigde Staten zijn er gevallen bekend waarin de chatbot ervan wordt beschuldigd een belangrijke rol te hebben gespeeld bij de dood van verschillende gebruikers met psychische problemen. In een van deze gevallen beweert de familie van een 16-jarige dat de tool feitelijk fungeerde als een soort 'zelfmoordcoach'.

Het bedrijf heeft categorisch ontkend direct verantwoordelijk te zijn voor deze gebeurtenissen en beweert dat de incidenten te wijten waren aan... “misbruik, ongeoorloofd of onvoorzien gebruik” van technologieen heeft maatregelen aangekondigd zoals Ouderlijk toezicht in ChatGPT voor gezinsaccounts, risicowaarschuwingen en gebruiksbeperkingen.

Buiten de rechtbanken om versterken deze zaken de perceptie dat Grote taalmodellen zijn in staat intense emotionele banden te creëren.Vaak zonder dat mensen zich volledig bewust zijn van hoe het werkt. Voor kinderen in kwetsbare situaties kan deze combinatie van nabijheid, ogenschijnlijke empathie en 24/7 beschikbaarheid een gevaarlijke valkuil worden.

De commotie rond OpenAI, Meta en andere grote technologiebedrijven vormt de achtergrond voor de overeenkomsten die Google en Character.AI hebben gesloten, wat erop wijst dat de industrie zich voorbereidt op... een aanhoudende cyclus van rechtszaken, strengere regelgeving en eisen voor transparantie.

Naarmate er meer details bekend worden over de overeenkomsten die Google en Character.AI met de getroffen families hebben bereikt, De technologiesector gaat ervan uit dat de groeifase met nauwelijks regelgevende controlemechanismen ten einde loopt.De combinatie van juridische druk, maatschappelijke controle en nieuwe regelgeving in Europa zorgt ervoor dat chatbots steeds meer functionaliteiten moeten integreren. strenge waarborgen, vooral wanneer er tieners bij betrokken zijn.En het dwingt ons om opnieuw na te denken over hoe deze instrumenten worden ontworpen, getest en gecontroleerd voordat ze in handen van het grote publiek komen.

Ik ben een technologieliefhebber die van zijn 'nerd'-interesses zijn beroep heeft gemaakt. Ik heb meer dan 10 jaar van mijn leven doorgebracht met het gebruik van de allernieuwste technologie en het sleutelen aan allerlei programma's uit pure nieuwsgierigheid. Nu heb ik mij gespecialiseerd in computertechnologie en videogames. Dit komt omdat ik al meer dan vijf jaar voor verschillende websites over technologie en videogames schrijf en artikelen heb gemaakt die proberen u de informatie te geven die u nodig heeft in een taal die voor iedereen begrijpelijk is.

Als je vragen hebt, mijn kennis strekt zich uit van alles wat te maken heeft met het Windows-besturingssysteem tot Android voor mobiele telefoons. En mijn toewijding is aan jou, ik ben altijd bereid om een paar minuten te besteden en je te helpen bij het oplossen van eventuele vragen die je hebt in deze internetwereld.