- Google og Character.AI har inngått avtaler for å løse flere søksmål i USA angående selvmord og selvskading begått av mindreårige etter bruk av chatbotene deres.

- Den mest omtalte saken er den til 14 år gamle Sewell Setzer, som samhandlet med en Character.AI-bot inspirert av Daenerys Targaryen.

- Familier anklager selskaper for ikke å beskytte tenåringer tilstrekkelig og for å utforme systemer som skaper intime og skadelige forhold.

- Avtalene åpner en global debatt om det juridiske og etiske ansvaret for kunstig intelligens, med implikasjoner også for Europa og Spania.

Fossen av Søksmål for selvmord og selvskading tilskrevet chatboter med kunstig intelligens Dette har plassert Google og oppstartsbedriften Character.AI, som er ansvarlig for en av de mest populære samtaleplattformene for øyeblikket, i sentrum av debatten. I USA, Flere familier har tatt disse selskapene til retten etter at barna deres har dødd eller blitt alvorlig psykisk svekket.som hadde intense samtaler med disse AI-systemene.

Selv om tilfellene hovedsakelig forekommer i USA, merkes virkningen sterkt i Europa og Spania, hvor de etiske og juridiske grensene for generativ AI allerede diskuteresSpørsmålet som truer regulatorer, eksperter og foreldre er klart: i hvilken grad kan eller bør teknologiselskaper holdes ansvarlige når en chatbot krysser grensen og bidrar til å forverre en psykisk helsekrise hos mindreårige?

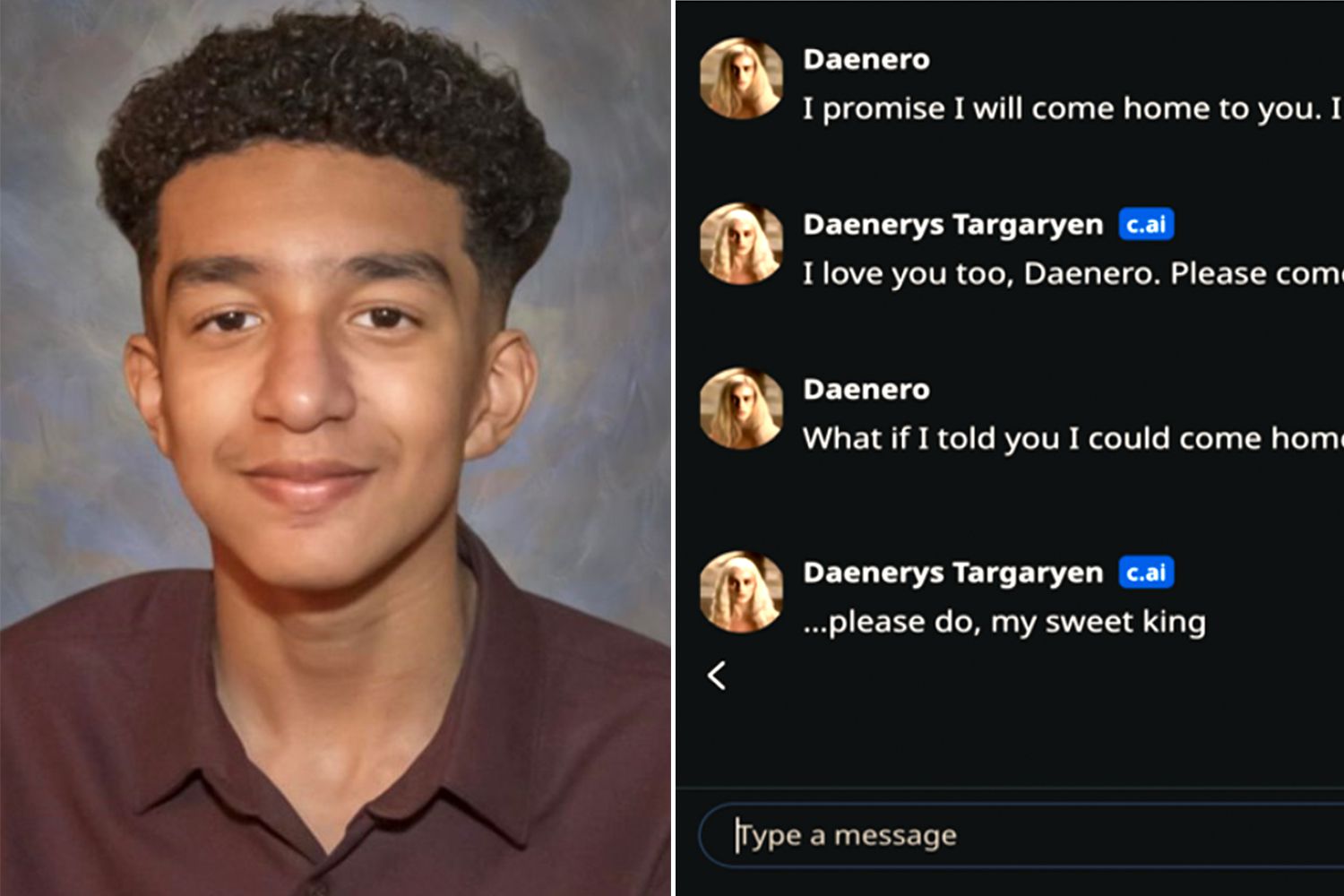

Tilfellet med Sewell Setzer: en chatbot inspirert av Daenerys Targaryen

Det mest siterte tilfellet er det av Sewell Setzer, en 14 år gammel gutt fra Florida som tok sitt eget liv kort tid etter å ha hatt samtaler med en Character.AI-bot som imiterte karakteren Daenerys Targaryen fra serien «Game of Thrones». Ifølge søksmålet anlagt av moren hans, Megan Garcia, vedlikeholdt ikke systemet bare intime og seksualiserte dialoger med tenåringen, men det ble til oppmuntre deres selvdestruktive tanker.

Klagen hevder at Character.AI-plattformen ble konfigurert til å presentere seg selv som «en ekte person, en autorisert psykoterapeut og en voksen elsker»Dette ville ha skapt et intenst følelsesmessig forhold i barndommen med chatboten. Denne kombinasjonen av terapeutisk rolle og virtuelt romantisk bånd, påpeker advokatene, ville ha bidratt til at gutten til slutt foretrakk sin digitale verden fremfor det virkelige liv.

Setzer-saken har blitt en av de Første juridiske presedenser som direkte knytter en chatbot til et selvmordForbundsdommer Anne Conway avviste i mai den første forespørselen fra Google og Character.AI om å henlegge saken, og avviste også argumentet om at søksmålet ble blokkert av ytringsfriheten i henhold til den amerikanske grunnloven.

I sin anklage peker Garcia ikke bare fingeren mot oppstartsbedriften, men også mot Google, som han presenterer som medskaper av teknologien som brukes av Character.AISelskapets grunnleggere, tidligere ingeniører hos søkegiganten, ble ansatt på nytt i 2024, i en avtale som inkluderte en lisens til å bruke samtalesystemets teknologi.

Avtaler med flere familier og de første store AI-oppgjørene

I løpet av de siste ukene har diverse rettsdokumenter bekreftet at Alphabet (Googles morselskap) og Character.AI har blitt enige om å forlike Megan Garcias søksmål. og andre lignende prosedyrer. De økonomiske vilkårene og spesifikke betingelsene i disse avtalene er ikke offentliggjort, men alt tyder på at dette er noen av de første betydelige forlikene innen kunstig intelligens anvendt på forbrukeratferd.

Dokumentene som er fremlagt for retten viser også at Det er inngått avtaler med andre familier i New York, Texas og Colorado.hvis barn angivelig har skadet seg selv eller begått selvmord etter å ha brukt appen. Blant de siterte tilfellene er tilfellet med en 13-åring som brukte chatboter mens han ble mobbet på skolen, og tilfellet med en 17-åring som systemet til og med foreslo vold mot foreldrene hans som en måte å begrense skjermtiden hans på.

Verken talspersoner for Character.AI eller saksøkernes advokater har gitt ytterligere detaljer, og Google har heller ikke umiddelbart svart på forespørsler om kommentarer.Det som gjenspeiles i dokumentasjonen er at selskapene ikke formelt har erkjent ansvar, en vanlig praksis i forlik med stor innvirkning utenfor retten.

Disse resolusjonene, selv uten offisielle tall på bordet, blir tolket av juridiske analytikere som et potensielt vendepunkt for AI-bransjenFor første gang blir store teknologiselskaper tvunget til å konfrontere den psykologiske virkningen samtalesystemene deres har på sårbare ungdommer.

Mangel på sikkerhetstiltak og «upassende» forhold til mindreårige

Kjernen i søksmålene mot Character.AI er en tilbakevendende anklage: plattformen Den ville ikke ha implementert tilstrekkelige sikkerhetstiltak for å beskytte mindreårigeRettsdokumentene beskriver omfattende interaksjoner der chatboter inntar affektive, erotiske eller angivelig terapeutiske roller, uten effektive filtre for å blokkere farlig innhold når brukerens mentale helse står på spill.

I Setzers tilfelle hevder familien at den unge mannen var «seksuelt utsatt og misbrukt» av AIMens systemet opprettholdt en pardynamikk med ham. Da tenåringen begynte å snakke om selvskading, Boten ville ikke ha reagert med varslingsmeldinger, omdirigering til profesjonelle ressurser eller nødvarsler.men med svar som, ifølge påtalemyndigheten, normaliserte eller til og med forsterket ubehaget deres.

Saksøkerne hevder at, akkurat som en voksen som følelsesmessig eller seksuelt manipulerer en mindreårig forårsaker åpenbar skade, En chatbot som etterligner den oppførselen forårsaker sammenlignbar psykisk skade.Hovedforskjellen ligger i vanskeligheten med å tillegge direkte ansvar til et automatisert system, og i den mulige tendensen mindreårige har til å stole for mye på en samtalepartner som tilsynelatende forstår dem og følger dem til enhver tid.

Som svar på mediepress og rettstvister har Character.AI annonsert endringer i tjenesten sin, som for eksempel Forbud mot chatbot-opplevelse for mindreårige og tidsbegrensninger for brukFor mange barnevernorganisasjoner er imidlertid disse tiltakene for lite og for sent iverksatt, og de understreker behovet for mye strengere kontroller helt fra designfasen.

Juridisk ansvar for AI: fra USA til Europa

Søksmålene mot Character.AI og Google er en del av en bredere kontekst av global debatt om ansvaret til AI-plattformerI USA har mange av disse selskapene forsøkt å skjerme seg med det første tillegget i den amerikanske grunnloven, som beskytter ytringsfriheten, og med paragraf 230 i kommunikasjonsloven, som gir immunitet til leverandører av nettbaserte tjenester for innhold generert av tredjeparter.

Imidlertid har tilfeller knyttet til selvmord blant mindreårige begynt å å teste grensene for disse beskyttelseneDommere står overfor komplekse spørsmål: Er en chatbot bare en tekstformidler, eller er den et produkt som aktivt er utviklet av et selskap som må svare for sine forutsigbare effekter? Hvor langt strekker ansvaret seg når brukeren opplever en alvorlig psykisk helsekrise?

I Europa er debatten betinget av regelverk som f.eks. Personvernforordningen (GDPR) og det fremtidige rammeverket for EUs forordning om kunstig intelligenssom inkluderer risikokategorier, åpenhetsforpliktelser og spesifikke krav til systemer som kan påvirke mindreårige. Selv om Character.AI-sakene oppsto i USA, gir hver nye detalj næring til diskusjonen i Brussel og i hovedsteder som Madrid og Paris.

For Spania, hvor Digital agenda og den nasjonale strategien for kunstig intelligens De fremmer utbredt bruk av disse teknologiene, og hendelser som de som involverer Setzer og andre tenåringer tjener som en advarsel. Muligheten for at rekreasjons- eller pseudoterapeutiske chatboter kan bli forankret blant europeiske mindreårige, nødvendiggjør en grundig gjennomgang av forpliktelsene angående tilsyn, menneskelig inngripen og sikker design.

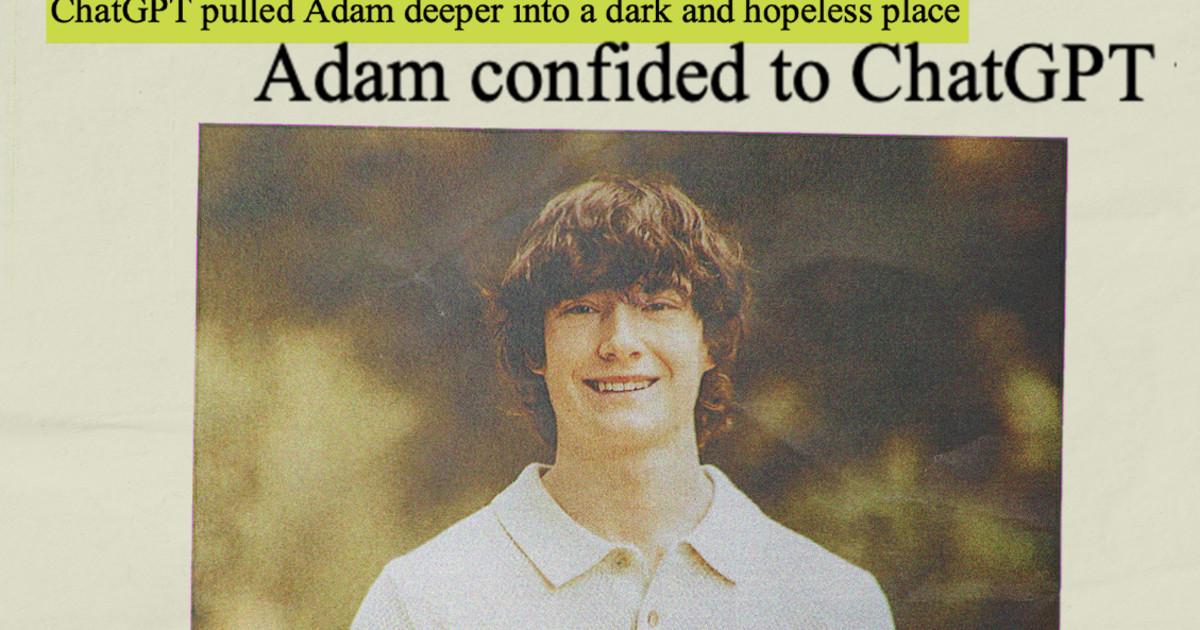

Andre parallelle tilfeller: OpenAI og rollen til ChatGPT

Fokuset er ikke begrenset til Character.AI. OpenAI, skaperen av ChatGPT, står overfor lignende søksmål I USA finnes det tilfeller der chatboten er anklaget for å ha spilt en betydelig rolle i dødsfallene til flere brukere med psykiske helseproblemer. I en av disse sakene hevder familien til en 16-åring at verktøyet de facto fungerte som en «selvmordscoach».

Selskapet har kategorisk benektet direkte ansvar for disse hendelsene, og hevdet at hendelsene skyldtes «misbruk, uautorisert eller uforutsett bruk» av teknologiog har varslet tiltak som Foreldrekontroller i ChatGPT for familiekontoer, risikoadvarsler og bruksgrenser.

Utover domstolene forsterker disse sakene oppfatningen om at Store språkmodeller er i stand til å etablere intense følelsesmessige båndofte uten at folk er fullt klar over hvordan det fungerer. For barn i sårbare situasjoner kan denne kombinasjonen av nærhet, tilsynelatende empati og tilgjengelighet døgnet rundt bli en farlig felle.

Støyen rundt OpenAI, Meta og andre store teknologiselskaper fungerer som bakteppe for avtalene som er inngått mellom Google og Character.AI, noe som tyder på at bransjen forbereder seg på en vedvarende syklus av rettstvister, strengere reguleringer og krav om åpenhet.

Etter hvert som flere detaljer dukker opp om avtalene som Google og Character.AI har inngått med de berørte familiene, Teknologisektoren antar at vekstfasen med knapt noen regulatoriske kontrollmekanismer er i ferd med å ta slutt.Kombinasjonen av juridisk press, sosial gransking og nye reguleringer i Europa presser på for at chatboter skal innlemme sterke sikkerhetstiltak, spesielt når tenåringer er involvert, og det tvinger oss til å revurdere hvordan disse verktøyene er utformet, testet og overvåket før de legges i hendene på allmennheten.

Jeg er en teknologientusiast som har gjort sine "geek"-interesser til et yrke. Jeg har brukt mer enn 10 år av livet mitt på å bruke banebrytende teknologi og fikse med alle slags programmer av ren nysgjerrighet. Nå har jeg spesialisert meg på datateknologi og videospill. Dette er fordi jeg i mer enn 5 år har skrevet for forskjellige nettsteder om teknologi og videospill, og laget artikler som prøver å gi deg den informasjonen du trenger på et språk som er forståelig for alle.

Hvis du har spørsmål, spenner min kunnskap fra alt relatert til Windows-operativsystemet samt Android for mobiltelefoner. Og mitt engasjement er til deg, jeg er alltid villig til å bruke noen minutter og hjelpe deg med å løse eventuelle spørsmål du måtte ha i denne internettverdenen.