- AI-assistenter lagrer innhold, identifikatorer, bruk, plassering og enhetsdata, med menneskelig gjennomgang i visse tilfeller.

- Det er risikoer gjennom hele livssyklusen (inntak, trening, slutning og anvendelse), inkludert rask injeksjon og lekkasje.

- GDPR, AI-loven og rammeverk som NIST AI RMF krever åpenhet, minimering og kontroller som står i forhold til risikoen.

- Konfigurer aktivitet, tillatelser og automatisk sletting; beskytt sensitive data, bruk 2FA og gjennomgå retningslinjer og leverandører.

Kunstig intelligens har gått fra å være et lovende til en rutine på rekordtid, og med den har det oppstått svært spesifikke tvilstilfeller: Hvilke data samler AI-assistenter inn?Hvordan de bruker dem og hva vi kan gjøre for å holde informasjonen vår trygg. Hvis du bruker chatboter, nettleserassistenter eller generative modeller, er det lurt å ta kontroll over personvernet ditt så snart som mulig.

I tillegg til å være enormt nyttige verktøy, lever disse systemene av storskala data. Mengden, opprinnelsen og behandlingen av denne informasjonen De introduserer nye risikoer: fra å antyde personlige trekk til utilsiktet eksponering av sensitivt innhold. Her finner du, i detalj og uten å vri deg rundt grøten, hva de fanger opp, hvorfor de gjør det, hva loven sier, og Slik beskytter du kontoene og aktiviteten dinLa oss lære alt om Hvilke data samler AI-assistenter inn, og hvordan kan de beskytte personvernet ditt?

Hvilke data samler egentlig AI-assistenter inn?

Moderne assistenter behandler mye mer enn bare spørsmålene dine. Kontaktinformasjon, identifikatorer, bruk og innhold Disse er vanligvis inkludert i standardkategoriene. Vi snakker om navn og e-postadresse, men også IP-adresser, enhetsinformasjon, interaksjonslogger, feil og selvfølgelig innholdet du genererer eller laster opp (meldinger, filer, bilder eller offentlige lenker).

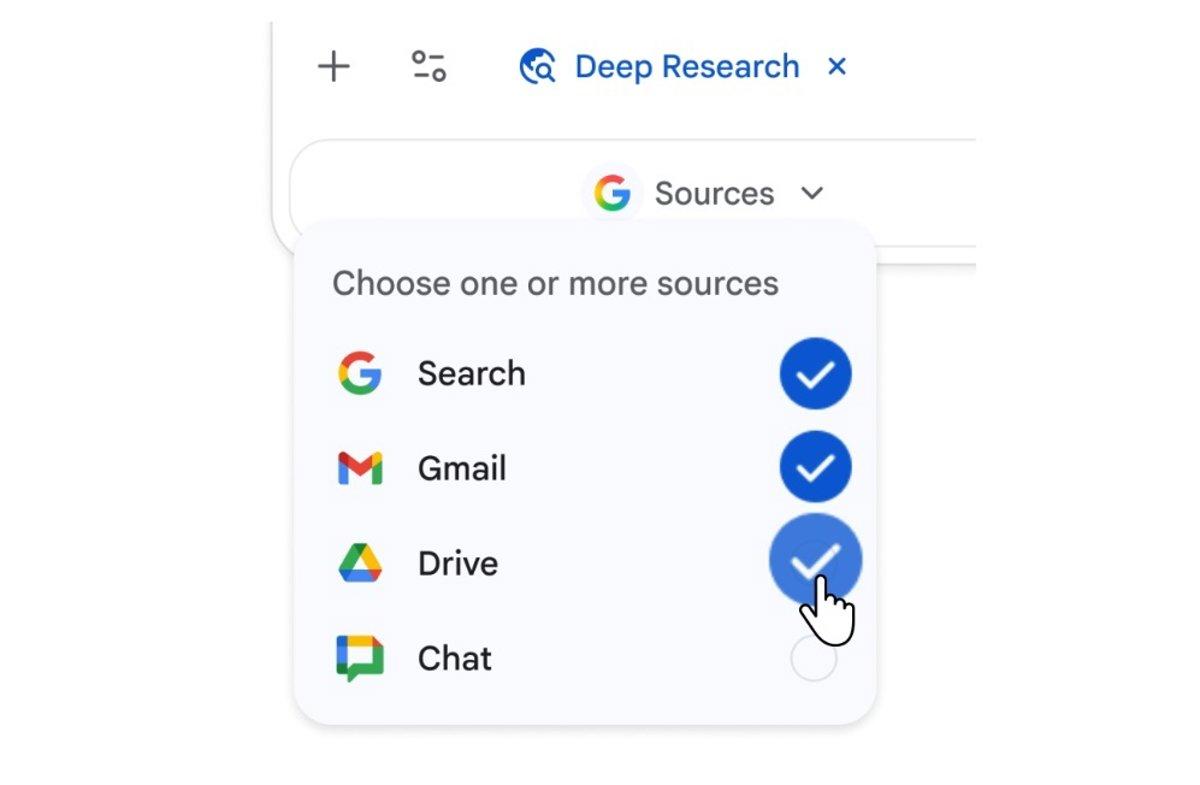

Innenfor Googles økosystem beskriver Gemini sin personvernerklæring nøyaktig hva de samler inn informasjon fra tilkoblede applikasjoner (for eksempel søke- eller YouTube-logg, Chrome-kontekst), enhets- og nettleserdata (type, innstillinger, identifikatorer), ytelses- og feilsøkingsmålinger, og til og med systemtillatelser på mobile enheter (som tilgang til kontakter, samtalelogger og meldinger eller innhold på skjermen) når brukeren har autorisert det.

De handler også plasseringsdata (omtrentlig enhetsplassering, IP-adresse eller adresser lagret i kontoen) og abonnementsdetaljer hvis du bruker betalte abonnementer. I tillegg lagres følgende: eget innhold som modellene genererer (tekst, kode, lyd, bilder eller sammendrag), noe som er nøkkelen til å forstå fotavtrykket du setter igjen når du bruker disse verktøyene.

Det skal bemerkes at datainnsamlingen ikke er begrenset til opplæring: Deltakerne kan registrere aktivitet i sanntid Under bruk (for eksempel når du er avhengig av utvidelser eller programtillegg), inkluderer dette telemetri og programhendelser. Dette forklarer hvorfor det er avgjørende å kontrollere tillatelser og gjennomgå aktivitetsinnstillinger.

Hva bruker de disse dataene til, og hvem kan se dem?

Bedrifter påberoper seg ofte brede og tilbakevendende formål: For å tilby, vedlikeholde og forbedre tjenesten, tilpasse opplevelsen og utvikle nye funksjonerå kommunisere med deg, måle ytelse og beskytte brukeren og plattformen. Alt dette gjelder også maskinlæringsteknologier og selve de generative modellene.

En sensitiv del av prosessen er menneskelig gjennomgangUlike leverandører erkjenner at interne ansatte eller tjenesteleverandører gjennomgår interaksjonseksempler for å forbedre sikkerhet og kvalitet. Derfor den gjennomgående anbefalingen: unngå å inkludere konfidensiell informasjon som du ikke ønsker at en person skal se, eller som ville blitt brukt til å forbedre modeller.

I kjente retningslinjer indikerer noen tjenester at de ikke deler visse data for reklameformål, selv om Ja, de kan gi informasjon til myndighetene. underlagt juridisk krav. Andre, etter sin natur, del med annonsører eller partnere identifikatorer og aggregerte signaler for analyser og segmentering, noe som åpner døren for profilering.

Behandlingen inkluderer også, oppbevaring i forhåndsdefinerte perioderFor eksempel setter noen leverandører en standard automatisk slettingsperiode på 18 måneder (kan justeres til 3, 36 eller ubestemt tid), og beholder gjennomgåtte samtaler i lengre perioder av kvalitets- og sikkerhetshensyn. Det anbefales å gjennomgå oppbevaringsperiodene og aktivere automatisk sletting hvis du vil minimere ditt digitale fotavtrykk.

Personvernrisikoer gjennom hele AI-livssyklusen

Personvern står ikke på spill på ett enkelt punkt, men gjennom hele kjeden: datainntak, trening, inferens og applikasjonslagVed masseinnsamling av datainnsamling kan sensitive data utilsiktet inkluderes uten tilstrekkelig samtykke; under trening er det lett at de opprinnelige bruksforventningene overskrides; og under inferens kan modeller utlede personlige trekk med utgangspunkt i tilsynelatende trivielle signaler; og i applikasjonen er API-er eller webgrensesnitt attraktive mål for angripere.

Med generative systemer mangedobles risikoene (for eksempel, AI-leker). Datasett hentet fra Internett uten uttrykkelig tillatelse De kan inneholde personlig informasjon, og visse ondsinnede forespørsler (promptinjeksjon) søker å manipulere modellen for å filtrere sensitivt innhold eller utføre farlige instruksjoner. På den annen side er det mange brukere De limer inn konfidensielle data uten å ta hensyn til at de kan lagres eller brukes til å justere fremtidige versjoner av modellen.

Akademisk forskning har avdekket spesifikke problemer. En fersk analyse av nettleserassistenter Den oppdaget utbredt sporing og profileringspraksis, med overføring av søkeinnhold, sensitive skjemadata og IP-adresser til leverandørens servere. Videre demonstrerte den evnen til å utlede alder, kjønn, inntekt og interesser, med personalisering som vedvarer på tvers av ulike økter; i den studien, Bare én tjeneste viste ingen bevis for profilering.

Hendelseshistorien minner oss om at risikoen ikke er teoretisk: brechas de seguridad De har eksponert chathistorikk eller brukermetadata, og angripere bruker allerede modelleringsteknikker for å utvinne treningsinformasjon. For å gjøre vondt verre, AI-rørledningsautomatisering Det gjør det vanskelig å oppdage personvernproblemer hvis det ikke utformes sikkerhetstiltak fra starten av.

Hva sier lovene og rammene?

De fleste land har allerede Personvernregler gjeldende, og selv om ikke alle er spesifikke for AI, gjelder de for ethvert system som behandler personopplysninger. I Europa, GDPR Det krever lovlighet, åpenhet, minimering, formålsbegrensning og sikkerhet; videre, AI Act Europeisk innfører risikokategorier, forbyr praksiser med høy innvirkning (som f.eks. social scoring offentlig) og stiller strenge krav til høyrisikosystemer.

I USA gjelder statlige forskrifter som f.eks. CCPA eller lov fra Texas De gir rettigheter til å få tilgang til, slette og reservere seg mot salg av data, mens initiativer som Utah-loven De krever tydelige varsler når brukeren samhandler med generative systemer. Disse normative lagene sameksisterer med sosiale forventninger: meningsmålinger viser en betydelig mistillit til ansvarlig bruk av data fra selskaper, og et avvik mellom brukernes selvoppfatning og deres faktiske atferd (for eksempel å godta retningslinjer uten å lese dem).

For å legge grunnlaget for risikostyring, rammeverket for NIST (AI RMF) Den foreslår fire pågående funksjoner: Styring (ansvarlig politikk og tilsyn), Kartlegging (forståelse av kontekst og virkninger), Måling (vurdering og overvåking av risikoer med målinger) og Håndtering (prioritering og avbøtende tiltak). Denne tilnærmingen hjelper med å tilpasse kontrollene i henhold til systemets risikonivå.

Hvem samler mest: en oversikt over de mest populære chatbotene

Nyere sammenligninger plasserer forskjellige assistenter på et samlingsspektrum. Googles Gemini topper rangeringen ved å samle inn det største antallet unike datapunkter på tvers av ulike kategorier (inkludert mobilkontakter, hvis tillatelser er gitt), noe som sjelden dukker opp hos andre konkurrenter.

I mellomklassen inkluderer løsninger som f.eks. Claude, Copilot, DeepSeek, ChatGPT og Perplexity, med mellom ti og tretten datatyper, som varierer i blandingen mellom kontakt, sted, identifikatorer, innhold, historikk, diagnoser, bruk og kjøp. Grok Den ligger i den nedre delen med et mer begrenset sett med signaler.

Det er også forskjeller i senere brukDet er dokumentert at noen tjenester deler visse identifikatorer (som krypterte e-poster) og signaler for segmentering med annonsører og forretningspartnere, mens andre oppgir at de ikke bruker data til reklameformål eller selger dem, selv om de forbeholder seg retten til å svare på juridiske forespørsler eller bruke dem til forbedre systemet, med mindre brukeren ber om sletting.

Fra sluttbrukerens perspektiv kan dette oversettes til ett klart råd: Gjennomgå hver leverandørs retningslinjerJuster appens tillatelser og bestem bevisst hvilken informasjon du gir bort i hver kontekst, spesielt hvis du skal laste opp filer eller dele sensitivt innhold.

Viktige beste fremgangsmåter for å beskytte personvernet ditt

Først av alt, konfigurer innstillingene nøye for hver assistent. Undersøk hva som lagres, hvor lenge og til hvilket formål.og aktiver automatisk sletting hvis tilgjengelig. Gjennomgå policyene med jevne mellomrom, da de endres ofte og kan inkludere nye kontrollalternativer.

Unngå deling personlige og sensitive data I spørsmålene dine: ingen passord, kredittkortnumre, medisinske journaler eller interne bedriftsdokumenter. Hvis du trenger å håndtere sensitiv informasjon, bør du vurdere anonymiseringsmekanismer, lukkede miljøer eller lokale løsninger. styrket styring.

Beskytt kontoene dine med sterke passord og to-trinns autentisering (2FA)Uautorisert tilgang til kontoen din eksponerer nettleserloggen din, opplastede filer og preferanser, som kan brukes til svært troverdige sosialtekniske angrep eller til ulovlig salg av data.

Hvis plattformen tillater det, deaktiver chatloggen Eller bruk midlertidige metoder. Dette enkle tiltaket reduserer eksponeringen din i tilfelle et sikkerhetsbrudd, noe som er vist ved tidligere hendelser som involverer populære AI-tjenester.

Ikke stol blindt på svarene. Modeller kan å hallusinere, å være partisk eller å bli manipulert gjennom ondsinnet umiddelbar injeksjon, som fører til feilaktige instruksjoner, falske data eller utvinning av sensitiv informasjon. For juridiske, medisinske eller økonomiske saker, kontrast til offisielle kilder.

Utvis ekstrem forsiktighet med lenker, filer og kode som leveres av AI. Det kan være skadelig innhold eller sårbarheter som med vilje er introdusert (dataforgiftning). Bekreft URL-er før du klikker, og skann filer med anerkjente sikkerhetsløsninger.

Desconfía de utvidelser og programtillegg av tvilsom opprinnelse. Det finnes et hav av AI-baserte tilleggsprogrammer, og ikke alle er pålitelige; installer bare de viktigste fra pålitelige kilder for å minimere risikoen for skadelig programvare.

I næringslivet, bring orden i adopsjonsprosessen. Definer AI-spesifikke styringspolicyerDen begrenser datainnsamlingen til det som er nødvendig, krever informert samtykke, reviderer leverandører og datasett (forsyningskjeden) og implementerer tekniske kontroller (som DLP, overvåking av trafikk til AI-apper og ...). detaljerte tilgangskontroller).

Bevissthet er en del av skjoldet: dann laget ditt innen AI-risikoer, avansert phishing og etisk bruk. Bransjeinitiativer som deler informasjon om AI-hendelser, slik som de som drives av spesialiserte organisasjoner, fremmer kontinuerlig læring og forbedret forsvar.

Konfigurer personvern og aktivitet i Google Gemini

Hvis du bruker Gemini, logg inn på kontoen din og merk av for «Aktivitet i Gemini-apperDer kan du se og slette interaksjoner, endre den automatiske slettingsperioden (standard 18 måneder, justerbar til 3 eller 36 måneder, eller ubestemt) og bestemme om de skal brukes til forbedre AI fra Google.

Det er viktig å vite at selv om lagring er deaktivert, Samtalene dine brukes til å svare og opprettholde systemsikkerhet, med støtte fra menneskelige kontrollører. Gjennomgåtte samtaler (og tilhørende data som språk, enhetstype eller omtrentlig plassering) kan bli beholdt. opptil tre år.

På mobil, Sjekk apptillatelsenePlassering, mikrofon, kamera, kontakter eller tilgang til innhold på skjermen. Hvis du er avhengig av diktat- eller stemmeaktiveringsfunksjoner, husk at systemet kan aktiveres ved en feiltakelse av lyder som ligner på nøkkelordet. Avhengig av innstillingene kan disse utdragene skal brukes til å forbedre modeller og redusere uønskede aktiveringer.

Hvis du kobler Gemini til andre apper (Google eller tredjeparter), må du huske på at hver enkelt behandler data i henhold til sine egne retningslinjer. sin egen politikkI funksjoner som Canvas kan appskaperen se og lagre det du deler, og alle med den offentlige lenken kan se eller redigere disse dataene: del bare med klarerte apper.

I regioner der det er aktuelt, kan det hende at oppgradering til visse opplevelser Importer samtale- og meldingshistorikk Fra nett- og appaktiviteten din til Gemini-spesifikk aktivitet, for å forbedre forslag (for eksempel kontakter). Hvis du ikke ønsker dette, juster kontrollene før du fortsetter.

Massebruk, regulering og trend for «skygge-AI»

Adopsjonen er overveldende: Nylige rapporter tyder på at De aller fleste organisasjoner bruker allerede AI-modellerLikevel mangler mange team tilstrekkelig modenhet innen sikkerhet og styring, spesielt i sektorer med strenge regelverk eller store mengder sensitive data.

Studier i næringslivet avdekker mangler: en svært høy andel organisasjoner i Spania Den er ikke forberedt på å beskytte AI-drevne miljøerog de fleste mangler viktige fremgangsmåter for å beskytte skymodeller, dataflyt og infrastruktur. Parallelt skjerpes regulatoriske tiltak og nye trusler dukker opp. straffer for manglende overholdelse av GDPR og lokale forskrifter.

I mellomtiden er fenomenet med shadow AI Det er økende: ansatte bruker eksterne assistenter eller personlige kontoer til arbeidsoppgaver, og eksponerer interne data uten sikkerhetskontroller eller kontrakter med leverandører. Den effektive responsen er ikke å forby alt, men aktivere sikker bruk i kontrollerte miljøer, med godkjente plattformer og overvåking av informasjonsflyt.

På forbrukerfronten justerer store leverandører retningslinjene sine. Nylige endringer forklarer for eksempel hvordan aktivitet med Gemini for å «forbedre tjenestene»tilbyr alternativer som midlertidig samtale og aktivitets- og tilpasningskontroller. Samtidig understreker meldingsselskaper at Personlige chatter er fortsatt utilgjengelige til AI-er som standard, selv om de fraråder å sende informasjon til AI-en som du ikke vil at selskapet skal vite.

Det finnes også offentlige kriminalomsorgstjenester: tjenester av filoverføring De presiserte at de ikke bruker brukerinnhold til å trene modeller eller selge det til tredjeparter, etter å ha uttrykt bekymringer om endringer i vilkårene. Dette sosiale og juridiske presset presser dem til å være tydeligere og gi brukeren mer kontroll.

Med tanke på fremtiden utforsker teknologiselskaper måter å redusere avhengigheten av sensitive dataSelvforbedrende modeller, bedre prosessorer og generering av syntetiske data. Disse fremskrittene lover å lindre datamangel og samtykkeproblemer, selv om eksperter advarer om nye risikoer hvis AI akselererer sine egne evner og brukes på områder som cybertrussel eller manipulasjon.

AI er både et forsvar og en trussel. Sikkerhetsplattformer integrerer allerede modeller for oppdage og reagere raskere, mens angripere bruker LLM-er til overbevisende phishing og deepfakesDenne dragkampen krever vedvarende investeringer i tekniske kontroller, leverandørevaluering, kontinuerlig revisjon og konstante utstyrsoppdateringer.

AI-assistenter samler inn flere signaler om deg, fra innholdet du skriver til enhetsdata, bruk og plassering. Noe av denne informasjonen kan bli gjennomgått av mennesker eller delt med tredjeparter, avhengig av tjenesten. Hvis du vil utnytte AI uten å kompromittere personvernet ditt, kan du kombinere finjustering (historikk, tillatelser, automatisk sletting), driftsmessig forsiktighet (ikke del sensitive data, bekreft lenker og filer, begrens filtyper), tilgangsbeskyttelse (sterke passord og 2FA) og aktiv overvåking av endringer i retningslinjene og nye funksjoner som kan påvirke personvernet ditt. hvordan dataene dine brukes og lagres.

Lidenskapelig opptatt av teknologi siden han var liten. Jeg elsker å være oppdatert i sektoren og fremfor alt å formidle det. Derfor har jeg vært dedikert til kommunikasjon på teknologi- og videospillnettsteder i mange år. Du kan finne meg skrive om Android, Windows, MacOS, iOS, Nintendo eller andre relaterte emner som du tenker på.