- O SAM 3 introduz a segmentação de imagens e vídeos guiada por exemplos textuais e visuais, com um vocabulário de milhões de conceitos.

- O SAM 3D permite reconstruir objetos, cenas e corpos humanos em 3D a partir de uma única imagem, utilizando modelos abertos.

- No Segment Anything Playground, é possível testar modelos sem conhecimento técnico, utilizando templates práticos e criativos.

- A Meta disponibiliza pesos, pontos de verificação e novos benchmarks para que desenvolvedores e pesquisadores na Europa e no resto do mundo possam integrar essas funcionalidades em seus projetos.

A Meta deu mais um passo em seu compromisso com inteligência artificial aplicada à visão computacional com o Lançamento do SAM 3 e do SAM 3D, dois modelos que expandem a família Segment Anything e que O objetivo deles é mudar a forma como trabalhamos com fotos e vídeos.Longe de permanecer apenas um experimento de laboratório, a empresa deseja que essas ferramentas sejam utilizadas tanto por profissionais quanto por usuários sem formação técnica.

Com essa nova geração, a Meta está se concentrando em Aprimorar a detecção e segmentação de objetos e ao trazer o reconstrução tridimensional para um público muito mais amploDesde a edição de vídeo até a visualização de produtos para e-commerce na Espanha e no resto da Europa, a empresa vislumbra um cenário em que Basta descrever em palavras o que você deseja fazer para que a IA realize a maior parte do trabalho pesado..

O que o SAM 3 oferece em comparação com as versões anteriores?

O SAM 3 é posicionado como a evolução direta. dos modelos de segmentação que a Meta apresentou em 2023 e 2024, conhecidos como SAM 1 e SAM 2. Essas primeiras versões focavam em identificar quais pixels pertenciam a cada objeto, principalmente usando pistas visuais como pontos, caixas ou máscaras e, no caso do SAM 2, seguindo os objetos ao longo de um vídeo quase em tempo real.

A principal novidade agora é que o SAM 3 entende sugestões de texto ricas e precisasNão se trata apenas de rótulos genéricos. Enquanto antes eram usados termos simples como "carro" ou "ônibus", o novo modelo é capaz de responder a descrições muito mais específicas, por exemplo, "ônibus escolar amarelo" ou "carro vermelho estacionado em fila dupla".

Na prática, isso significa que basta escrever algo como “boné de beisebol vermelho” para que o sistema possa localizar e separar todos os elementos que se encaixam nessa descrição dentro de uma imagem ou vídeo. Essa capacidade de refinar com palavras é especialmente útil em contextos de edição profissional, publicidade ou análise de conteúdo, onde muitas vezes é preciso observar detalhes muito específicos.

Além disso, o SAM 3 foi projetado para se integrar com grandes modelos de linguagem multimodalIsso permite ir além de frases simples e usar instruções complexas, como: “Pessoas sentadas, mas sem boné vermelho” ou “pedestres que estão olhando para a câmera, mas sem mochila”. Esse tipo de instrução combina condições e exclusões que, até recentemente, eram difíceis de traduzir para uma ferramenta de visão computacional.

Desempenho e escala do modelo SAM 3

Meta também queria destacar a parte menos visível, mas crucial: o escala de desempenho técnico e conhecimento do modelo. De acordo com os dados da empresa, o SAM 3 é capaz de processar uma única imagem com mais de cem objetos detectados em cerca de 30 milissegundos usando uma GPU H200, uma velocidade muito próxima da necessária para fluxos de trabalho exigentes.

No caso do vídeo, a empresa garante que o sistema mantém o desempenho. virtualmente em tempo real Ao trabalhar com cerca de cinco objetos simultâneos, torna-se viável o rastreamento e a segmentação de conteúdo em movimento, desde vídeos curtos de redes sociais até projetos de produção mais ambiciosos.

Para alcançar esse comportamento, a Meta construiu uma base de treinamento com mais de 4 milhões de conceitos únicosCombinando anotadores humanos com modelos de IA para ajudar a rotular grandes volumes de dados, essa mistura de supervisão manual e automatizada visa equilibrar precisão e escalabilidade — fundamental para garantir que o modelo responda bem a diversas entradas em contextos de mercado europeus, latino-americanos e outros.

A empresa enquadra o SAM 3 no que ela chama de Coleção Segment AnythingUma família de modelos, benchmarks e recursos projetados para expandir a compreensão visual da IA. O lançamento é acompanhado por um novo benchmark para segmentação de "vocabulário aberto", focado em medir até que ponto o sistema consegue entender praticamente qualquer conceito expresso em linguagem natural.

Integração com Edits, Vibes e outras ferramentas Meta

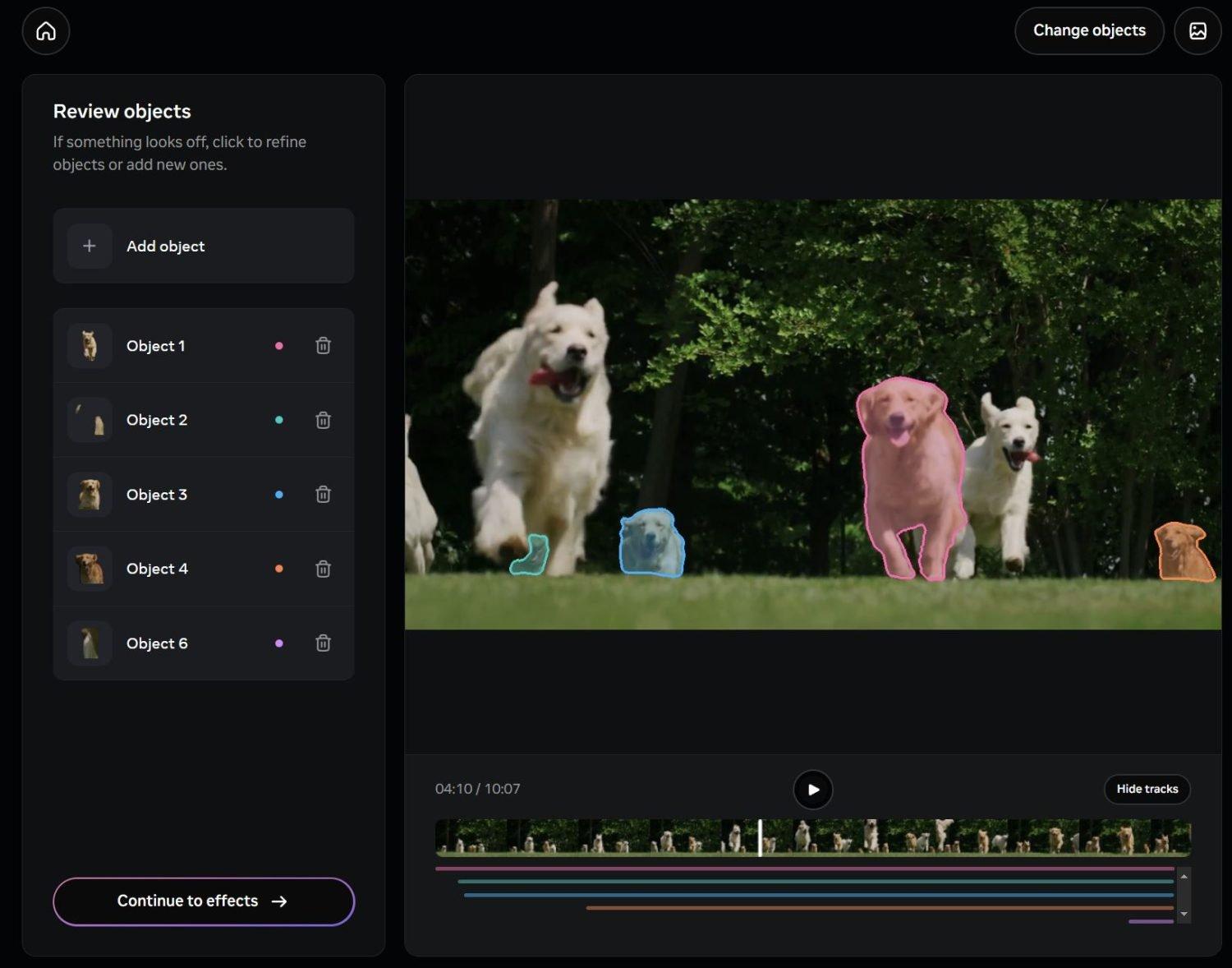

Além do componente técnico, a Meta já começou a Integrar o SAM 3 em produtos específicos que se destinam ao uso diário. Um dos primeiros destinos será Edits., seu aplicativo de criação e edição de vídeo, cuja ideia é permitir que o usuário selecione pessoas ou objetos específicos com uma descrição de texto simples e aplique efeitos, filtros ou alterações apenas nessas partes da filmagem.

Outra via para a integração será encontrada em Vibes, dentro do aplicativo Meta AI e da plataforma meta.aiNesse ambiente, a segmentação de texto será combinada com ferramentas generativas para criar novas experiências de edição e criação, como planos de fundo personalizados, efeitos de movimento ou modificações seletivas de fotos, projetadas para redes sociais muito populares na Espanha e no resto da Europa.

A proposta da empresa é que essas capacidades não se restrinjam a estudos profissionais, mas sim que alcancem... Criadores independentes, pequenas agências e usuários avançados que trabalham diariamente com conteúdo visual. A capacidade de segmentar cenas escrevendo descrições em linguagem natural reduz a curva de aprendizado em comparação com as ferramentas tradicionais baseadas em máscaras e camadas manuais.

Ao mesmo tempo, a Meta mantém uma abordagem aberta em relação a desenvolvedores externos, sugerindo que aplicativos de terceiros Desde ferramentas de edição até soluções para análise de vídeo no varejo ou segurança, todos podem confiar no SAM 3, contanto que as políticas de uso da empresa sejam respeitadas.

SAM 3D: Reconstrução tridimensional a partir de uma única imagem.

A outra grande novidade é SAM 3Dum sistema projetado para executar reconstruções tridimensionais Partindo de imagens 2D, em vez de necessitar de múltiplas capturas de diferentes ângulos, o modelo visa gerar uma representação 3D confiável a partir de uma única foto, algo especialmente interessante para quem não possui equipamentos ou fluxos de trabalho de digitalização especializados.

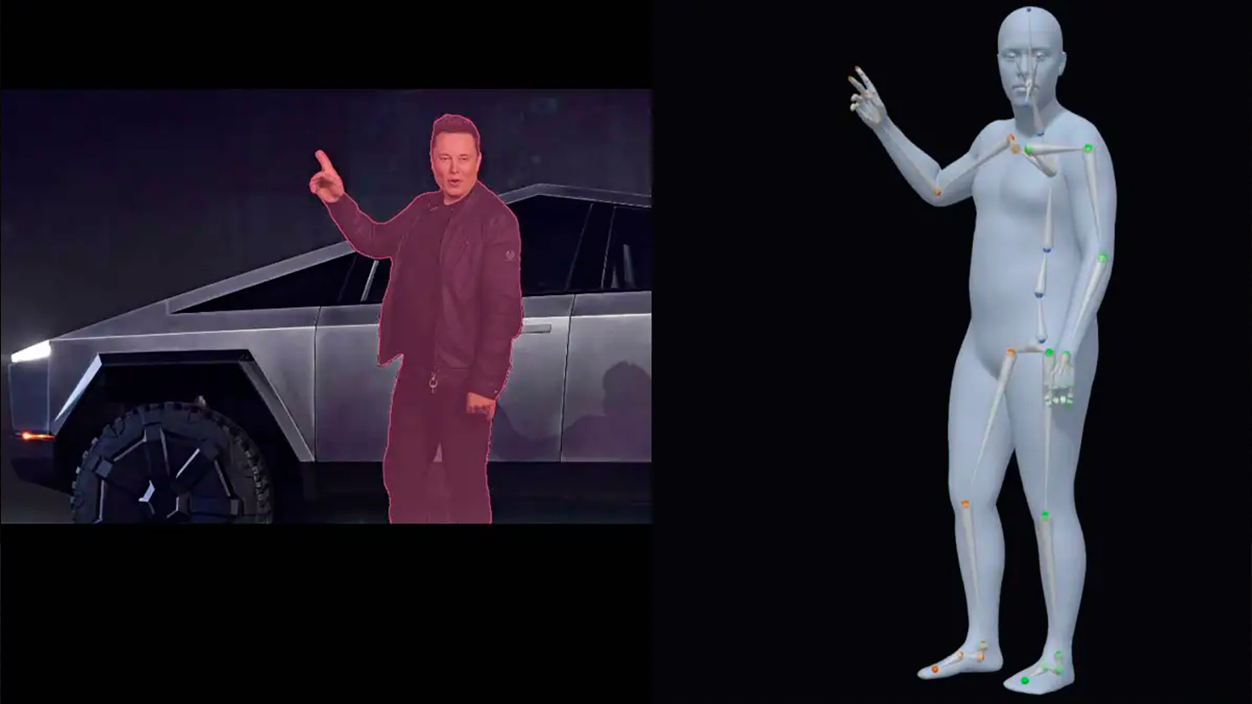

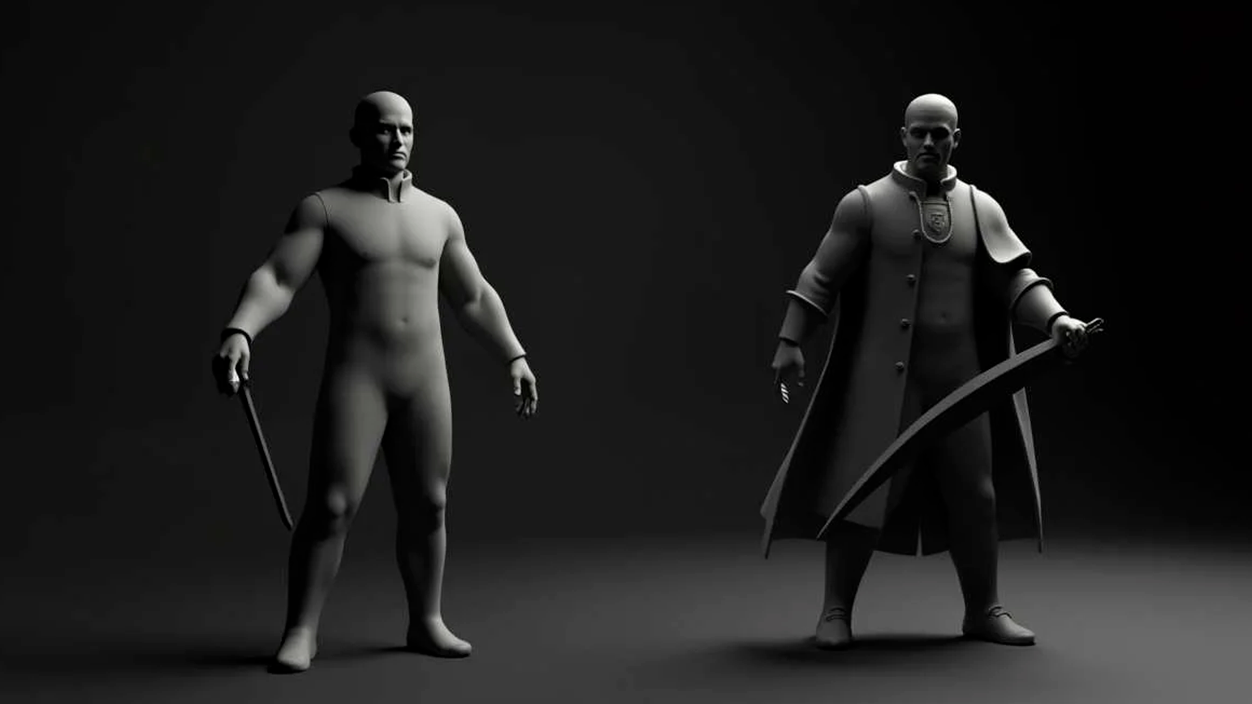

O SAM 3D consiste em dois modelos de código aberto com funções distintas: Objetos 3D SAMfocado na reconstrução de objetos e cenas, e Corpo SAM 3D, voltado para a estimativa da forma e do corpo humano. Essa separação permite que o sistema seja adaptado a casos de uso muito diferentes, desde catálogos de produtos até aplicações de saúde ou esportes.

Segundo a Meta, a SAM 3D Objects marca uma Novo padrão de desempenho em reconstrução 3D guiada por IAsuperando facilmente os métodos anteriores em métricas de qualidade essenciais. Para avaliar os resultados com mais rigor, a empresa trabalhou com artistas para criar o SAM 3D Artist Objects, um conjunto de dados especificamente projetado para avaliar a fidelidade e os detalhes das reconstruções em uma ampla variedade de imagens e objetos.

Este avanço abre caminho para aplicações práticas em áreas como: robótica, ciência, medicina esportiva ou criatividade digitalPor exemplo, na robótica, pode ajudar os sistemas a compreender melhor o volume dos objetos com os quais interagem; na pesquisa médica ou esportiva, pode auxiliar na análise da postura e dos movimentos corporais; e no design criativo, serve como base para a geração de modelos 3D para animação, videogames ou experiências imersivas.

Uma das primeiras aplicações comerciais já visíveis é a função “Vista no quarto” de Facebook Marketplaceque permite visualizar como um móvel ou objeto decorativo ficaria em um ambiente real antes de comprá-lo. Com o SAM 3D, A Meta busca aperfeiçoar esses tipos de experiências., extremamente relevante para o comércio eletrônico europeu, onde a devolução de produtos devido a expectativas não atendidas representa um custo crescente.

Segment Anything Playground: um ambiente para experimentação

Para permitir que o público teste essas funcionalidades sem precisar instalar nada, a Meta habilitou a Segmentar qualquer coisa PlaygroundÉ uma plataforma web que permite fazer upload de imagens ou vídeos e experimentar o SAM 3 e o SAM 3D diretamente do seu navegador. A ideia é que qualquer pessoa curiosa sobre IA visual possa explorar as possibilidades sem precisar de conhecimentos de programação.

No caso do SAM 3, o Playground permite segmentar objetos usando frases curtas ou instruções detalhadasCombinar texto e, se desejado, exemplos visuais. Isso simplifica tarefas comuns, como selecionar pessoas, carros, animais ou elementos específicos da cena e aplicar ações específicas a eles, desde efeitos estéticos até desfoque ou substituição de fundo.

Ao trabalhar com o SAM 3D, a plataforma torna isso possível. Explore cenas a partir de novas perspectivas.Reorganize objetos, aplique efeitos tridimensionais ou gere vistas alternativas. Para quem trabalha com design, publicidade ou conteúdo 3D, oferece uma maneira rápida de prototipar ideias sem precisar usar ferramentas técnicas complexas desde o início.

O Playground também inclui uma série de Modelos prontos para usar Essas funcionalidades são voltadas para tarefas muito específicas. Incluem opções práticas como pixelizar rostos ou placas de veículos por motivos de privacidade, e efeitos visuais como rastros de movimento, realces seletivos ou focos de luz em áreas de interesse no vídeo. Esses tipos de funções podem ser particularmente adequados para os fluxos de trabalho de criadores de conteúdo e mídia digital na Espanha, onde a produção de vídeos curtos e conteúdo para redes sociais é constante.

Recursos abertos para desenvolvedores e pesquisadores

Em linha com a estratégia que a Meta seguiu em outros lançamentos de IA, a empresa decidiu liberar uma parte significativa do Recursos técnicos associados ao SAM 3 e ao SAM 3DEm primeiro lugar, foram tornados públicos os pesos do modelo, um novo benchmark focado na segmentação de vocabulário aberto, e um documento técnico que detalha seu desenvolvimento.

No caso do SAM 3D, estão disponíveis as seguintes opções: pontos de verificação do modelo, código de inferência e um conjunto de dados de avaliação. próxima geração. Este conjunto de dados inclui uma variedade considerável de imagens e objetos que visa ir além dos pontos de referência 3D tradicionais, proporcionando maior realismo e complexidade, algo que pode ser muito útil para grupos de pesquisa europeus que trabalham em visão computacional e computação gráfica.

A Meta também anunciou colaborações com plataformas de anotação como a Roboflow, com o objetivo de permitir que desenvolvedores e empresas... Insira seus próprios dados e ajuste o SAM 3. para atender a necessidades específicas. Isso abre caminho para soluções setoriais, desde inspeções industriais até análises de tráfego urbano, incluindo projetos de patrimônio cultural onde é importante segmentar com precisão elementos arquitetônicos ou artísticos.

Ao optar por uma abordagem relativamente aberta, a empresa busca garantir que o ecossistema de desenvolvedores, universidades e startups —incluindo aquelas que operam na Espanha e no resto da Europa — podem experimentar essas tecnologias, integrá-las em seus próprios produtos e, em última instância, contribuir com casos de uso que vão além daqueles que a Meta pode desenvolver internamente.

Com o SAM 3 e o SAM 3D, a Meta pretende consolidar uma Plataforma de IA visual mais flexível e acessívelonde a segmentação guiada por texto e a reconstrução 3D a partir de uma única imagem deixam de ser capacidades exclusivas de equipes altamente especializadas. O impacto potencial se estende da edição de vídeo do dia a dia a aplicações avançadas em ciência, indústria e comércio eletrônico, em um contexto onde a combinação de linguagem, visão computacional e criatividade está se tornando uma ferramenta de trabalho padrão e não apenas uma promessa tecnológica.

Sou um entusiasta da tecnologia que transformou seus interesses “geek” em profissão. Passei mais de 10 anos da minha vida usando tecnologia de ponta e mexendo em todos os tipos de programas por pura curiosidade. Agora me especializei em informática e videogames. Isto porque há mais de 5 anos escrevo para diversos sites sobre tecnologia e videojogos, criando artigos que procuram dar-lhe a informação que necessita numa linguagem compreensível para todos.

Se você tiver alguma dúvida, meu conhecimento vai desde tudo relacionado ao sistema operacional Windows até Android para celulares. E meu compromisso é com você, estou sempre disposto a dedicar alguns minutos e te ajudar a resolver qualquer dúvida que você possa ter nesse mundo da internet.