- Asistenții cu inteligență artificială stochează conținut, identificatori, date despre utilizare, locație și date despre dispozitiv, cu verificare umană în anumite cazuri.

- Există riscuri pe întregul ciclu de viață (ingerare, instruire, inferență și aplicare), inclusiv injectarea rapidă și scurgerile.

- GDPR, Legea privind inteligența artificială și cadre precum NIST AI RMF impun transparență, minimizare și controale proporționale cu riscul.

- Configurați activitatea, permisiunile și ștergerea automată; protejați datele sensibile, utilizați 2FA și revizuiți politicile și furnizorii.

Inteligența artificială a trecut de la promisiune la rutină în timp record, iar odată cu ea au apărut îndoieli foarte specifice: Ce date colectează asistenții AI?Cum le folosesc și ce putem face pentru a ne păstra informațiile în siguranță. Dacă utilizați chatbot-uri, asistenți de browser sau modele generative, este o idee bună să preluați controlul asupra confidențialității dvs. cât mai curând posibil.

Pe lângă faptul că sunt instrumente extrem de utile, aceste sisteme se alimentează cu date la scară largă. Volumul, originea și modul de tratare a acestor informații Acestea introduc noi riscuri: de la deducerea trăsăturilor personale până la expunerea accidentală a conținutului sensibil. Aici veți găsi, în detaliu și fără ocolișuri, ce surprind, de ce o fac, ce spune legea și... Cum să vă protejați conturile și activitateaHai să învățăm totul despre Ce date colectează asistenții AI și cum vă pot proteja confidențialitatea.

Ce date colectează de fapt asistenții AI?

Asistenții moderni procesează mult mai mult decât simple întrebări. Informații de contact, identificatori, utilizare și conținut Acestea sunt de obicei incluse în categoriile standard. Vorbim despre nume și e-mail, dar și adrese IP, informații despre dispozitiv, jurnale de interacțiune, erori și, bineînțeles, conținutul pe care îl generați sau îl încărcați (mesaje, fișiere, imagini sau linkuri publice).

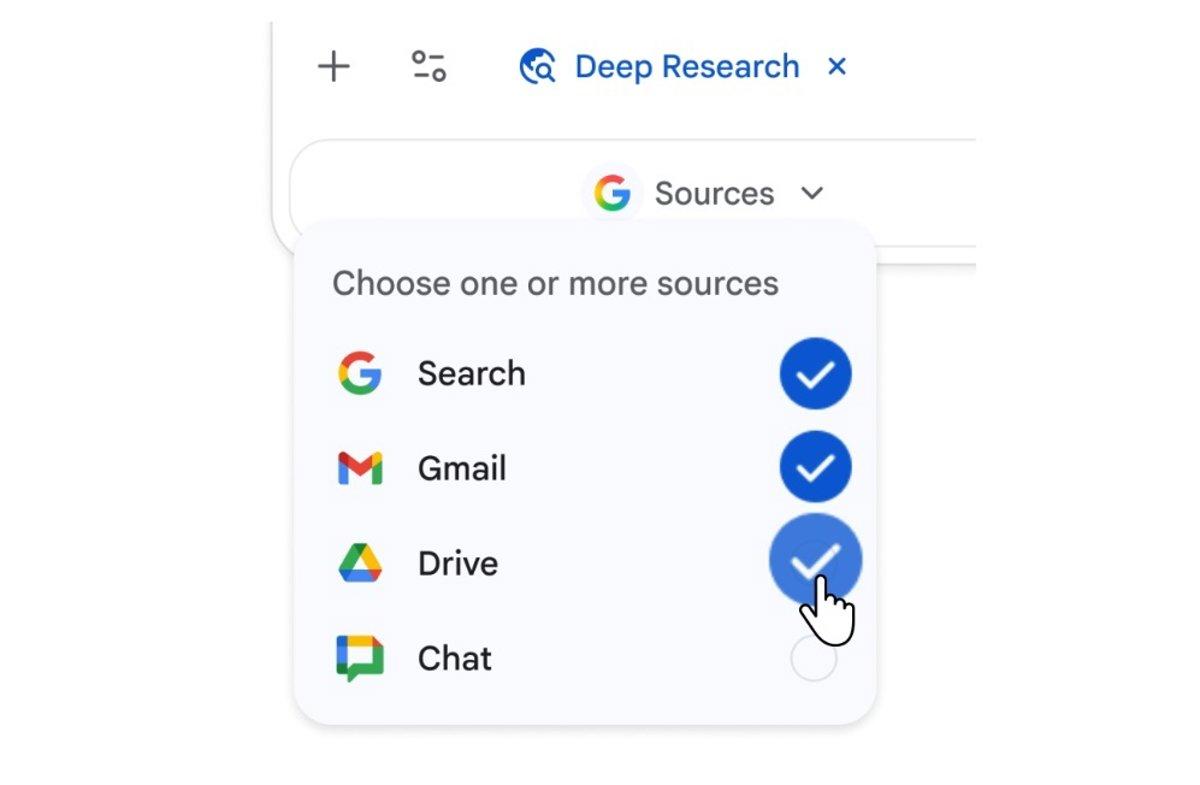

În cadrul ecosistemului Google, notificarea privind confidențialitatea Gemini descrie cu exactitate ce colectează. informații din aplicațiile conectate (de exemplu, istoricul căutărilor sau al YouTube, contextul Chrome), datele dispozitivului și ale browserului (tip, setări, identificatori), valorile de performanță și depanare și chiar permisiunile de sistem pe dispozitivele mobile (cum ar fi accesul la contacte, jurnalele de apeluri și mesaje sau conținutul de pe ecran) atunci când sunt autorizate de utilizator.

De asemenea, ei se ocupă date de localizare (locația aproximativă a dispozitivului, adresa IP sau adresele salvate în cont) și detaliile abonamentului dacă utilizați abonamente plătite. În plus, sunt stocate următoarele: conținut propriu generat de modele (text, cod, audio, imagini sau rezumate), ceva cheie pentru înțelegerea amprentei pe care o lăsați atunci când interacționați cu aceste instrumente.

Trebuie menționat că colectarea datelor nu se limitează la instruire: Participanții pot înregistra activitatea în timp real În timpul utilizării (de exemplu, când vă bazați pe extensii sau pluginuri), aceasta include telemetria și evenimentele aplicației. Aceasta explică de ce controlul permisiunilor și revizuirea setărilor de activitate sunt cruciale.

La ce folosesc aceste date și cine le poate vedea?

Companiile invocă adesea scopuri largi și recurente: Pentru a furniza, menține și îmbunătăți serviciul, a personaliza experiența și a dezvolta noi funcționalitățipentru a comunica cu dumneavoastră, a măsura performanța și a proteja utilizatorul și platforma. Toate acestea se extind și la tehnologiile de învățare automată și la modelele generative în sine.

O parte sensibilă a procesului este recenzie umanăDiverși furnizori recunosc că personalul intern sau furnizorii de servicii revizuiesc mostrele de interacțiune pentru a îmbunătăți securitatea și calitatea. De aici și recomandarea constantă: evitați includerea informațiilor confidențiale pe care nu ați dori ca o persoană să le vadă sau care ar putea fi utilizate pentru a rafina modelele.

În politicile cunoscute, unele servicii indică faptul că nu partajează anumite date în scopuri publicitare, deși Da, pot furniza informații autorităților. în baza cerințelor legale. Altele, prin natura lor, partajați cu agenții de publicitate sau partenerii identificatori și semnale agregate pentru analiză și segmentare, deschizând calea către profilare.

Tratamentul include, de asemenea, păstrarea pentru perioade predefiniteDe exemplu, unii furnizori setează o perioadă implicită de ștergere automată de 18 luni (ajustabilă la 3, 36 sau pe termen nelimitat) și păstrează conversațiile revizuite pentru perioade mai lungi din motive de calitate și securitate. Este recomandabil să revizuiți perioadele de păstrare și să activați ștergerea automată dacă doriți să minimizați amprenta digitală.

Riscuri la adresa confidențialității pe tot parcursul ciclului de viață al inteligenței artificiale

Confidențialitatea nu este în joc într-un singur punct, ci pe întregul lanț: ingerarea datelor, antrenamentul, inferența și stratul aplicațieiÎn colectarea în masă a datelor, datele sensibile pot fi incluse în mod accidental fără consimțământul corespunzător; în timpul antrenamentului, este ușor ca așteptările inițiale de utilizare să fie depășite; iar în timpul inferenței, modelele pot... deduce trăsături personale pornind de la semnale aparent banale; iar în aplicație, API-urile sau interfețele web sunt ținte atractive pentru atacatori.

În cazul sistemelor generative, riscurile se multiplică (de exemplu, Jucării cu inteligență artificială). Seturi de date extrase de pe internet fără permisiune explicită Acestea pot conține informații personale, iar anumite solicitări rău intenționate (prompt injection) urmăresc să manipuleze modelul pentru a filtra conținut sensibil sau a executa instrucțiuni periculoase. Pe de altă parte, mulți utilizatori Ei lipesc date confidențiale fără a lua în considerare faptul că acestea ar putea fi stocate sau utilizate pentru ajustarea versiunilor viitoare ale modelului.

Cercetarea academică a scos la iveală probleme specifice. O analiză recentă asupra asistenți de browser Acesta a detectat practici răspândite de urmărire și profilare, cu transmiterea de conținut de căutare, date sensibile din formulare și adrese IP către serverele furnizorului. În plus, a demonstrat capacitatea de a deduce vârsta, sexul, venitul și interesele, personalizarea persistând pe parcursul diferitelor sesiuni; în studiul respectiv, Un singur serviciu nu a prezentat nicio dovadă de profilare.

Istoricul incidentelor ne amintește că riscul nu este teoretic: breșe de securitate Au expus istoricul chaturilor sau metadatele utilizatorilor, iar atacatorii utilizează deja tehnici de modelare pentru a extrage informații de antrenament. Ca și cum lucrurile nu ar fi fost deja destul de rele, Automatizarea canalului de inteligență artificială Acest lucru face dificilă detectarea problemelor de confidențialitate dacă nu sunt concepute măsuri de siguranță de la bun început.

Ce spun legile și cadrul legislativ?

Majoritatea țărilor au deja reglementările de confidențialitate în vigoare și, deși nu toate sunt specifice inteligenței artificiale, acestea se aplică oricărui sistem care prelucrează date cu caracter personal. În Europa, RGPD Aceasta necesită legalitate, transparență, minimizare, limitare a scopului și securitate; în plus, AI Act European introduce categorii de risc, interzice practicile cu impact ridicat (cum ar fi notare socială public) și impune cerințe stricte sistemelor cu risc ridicat.

În SUA, reglementări statale precum CCPA sau legea din Texas Acestea acordă drepturi de acces, ștergere și renunțare la vânzarea datelor, în timp ce inițiative precum legea din Utah Cer notificări clare atunci când utilizatorul interacționează cu sisteme generative. Aceste straturi normative coexistă cu așteptările sociale: sondajele de opinie arată o neîncredere notabilă față de utilizarea responsabilă a datelor de către companii și o discrepanță între autopercepția utilizatorilor și comportamentul lor real (de exemplu, acceptarea politicilor fără a le citi).

Pentru a fundamenta managementul riscurilor, cadrul NIST (IA RMF) Propune patru funcții continue: Guvernare (politici responsabile și supraveghere), Cartografiere (înțelegerea contextului și a impactului), Măsurare (evaluarea și monitorizarea riscurilor cu ajutorul indicatorilor) și Gestionare (prioritizarea și atenuarea). Această abordare ajută la adaptarea controalelor în funcție de nivelul de risc al sistemului.

Cine colectează cel mai mult: o radiografie a celor mai populari chatbot-uri

Comparațiile recente plasează diferiți asistenți pe un spectru de colecții. Gemini de la Google se află în fruntea clasamentului prin colectarea celui mai mare număr de puncte de date unice din diverse categorii (inclusiv contacte mobile, dacă sunt acordate permisiuni), lucru care apare rar la alți competitori.

În gama medie, soluțiile includ, de exemplu, Claude, Copilot, DeepSeek, ChatGPT și Perplexity, cu între zece și treisprezece tipuri de date, variind în funcție de combinația dintre date de contact, locație, identificatori, conținut, istoric, diagnostice, utilizare și achiziții. grok Este situat în partea inferioară cu un set mai limitat de semnale.

Există, de asemenea, diferențe în utilizare ulterioarăS-a documentat faptul că unele servicii partajează anumiți identificatori (cum ar fi e-mailurile criptate) și semnale pentru segmentare cu agenții de publicitate și partenerii de afaceri, în timp ce altele declară că nu utilizează datele în scopuri publicitare și nu le vând, deși își rezervă dreptul de a răspunde solicitărilor legale sau de a le utiliza în scopuri... îmbunătăți sistemul, cu excepția cazului în care utilizatorul solicită ștergerea.

Din perspectiva utilizatorului final, acest lucru se traduce într-un sfat clar: Examinați politicile fiecărui furnizorAjustează permisiunile aplicației și decide în mod conștient ce informații oferi în fiecare context, mai ales dacă vei încărca fișiere sau vei partaja conținut sensibil.

Cele mai bune practici esențiale pentru a vă proteja confidențialitatea

În primul rând, configurați cu atenție setările pentru fiecare asistent. Explorează ce este stocat, pentru cât timp și în ce scop.și activați ștergerea automată, dacă este disponibilă. Revizuiți periodic politicile, deoarece acestea se schimbă frecvent și pot include noi opțiuni de control.

Evitați partajarea date personale și sensibile În solicitări: fără parole, numere de card de credit, dosare medicale sau documente interne ale companiei. Dacă trebuie să gestionați informații sensibile, luați în considerare mecanisme de anonimizare, medii închise sau soluții locale. guvernanță consolidată.

Protejați-vă conturile cu parole puternice și autentificare în doi pași (2FA)Accesul neautorizat la contul dvs. expune istoricul de navigare, fișierele încărcate și preferințele, care pot fi folosite pentru atacuri de inginerie socială extrem de credibile sau pentru vânzarea ilicită de date.

Dacă platforma o permite, dezactivați istoricul chatului Sau folosiți modalități temporare. Această măsură simplă vă reduce expunerea în cazul unei încălcări de securitate, așa cum au demonstrat incidentele anterioare care au implicat servicii populare de inteligență artificială.

Nu te încrede orbește în răspunsuri. Modelele pot a halucina, a fi părtinitor sau a fi manipulat prin injectare malițioasă de informații prompte, care duce la instrucțiuni eronate, date false sau extragerea de informații sensibile. Pentru probleme juridice, medicale sau financiare, în contrast cu surse oficiale.

Acordați o atenție deosebită linkuri, fișiere și cod care este furnizat de inteligența artificială. Este posibil să existe conținut rău intenționat sau vulnerabilități introduse în mod deliberat (otrăvire de date). Verificați adresele URL înainte de a da clic și scanați fișierele cu soluții de securitate reputate.

Neîncredere extensii și pluginuri de origine îndoielnică. Există o mare de suplimente bazate pe inteligență artificială și nu toate sunt fiabile; instalați doar cele esențiale din surse de încredere pentru a minimiza riscul de programe malware.

În sfera corporativă, aduceți ordine în procesul de adopție. Definiți Politici de guvernanță specifice inteligenței artificialeLimitează colectarea datelor la ceea ce este necesar, necesită consimțământ informat, auditează furnizorii și seturile de date (lanțul de aprovizionare) și implementează controale tehnice (cum ar fi DLP, monitorizarea traficului către aplicațiile de inteligență artificială și...). controale granulare ale accesului).

Conștientizarea face parte din scut: formează-ți echipa în ceea ce privește riscurile legate de inteligența artificială, phishing-ul avansat și utilizarea etică. Inițiativele din industrie care partajează informații despre incidentele legate de inteligența artificială, cum ar fi cele conduse de organizații specializate, promovează învățarea continuă și îmbunătățirea apărării.

Configurați confidențialitatea și activitatea în Google Gemini

Dacă folosești Gemini, conectează-te la contul tău și bifează „Activitatea în aplicațiile GeminiAcolo puteți vizualiza și șterge interacțiuni, modifica perioada de ștergere automată (implicit 18 luni, ajustabilă la 3 sau 36 de luni sau nedeterminată) și decide dacă acestea sunt utilizate pentru îmbunătățirea inteligenței artificiale de Google.

Este important de știut că, chiar și cu salvarea dezactivată, Conversațiile tale sunt folosite pentru a răspunde și să mențină securitatea sistemului, cu sprijinul unor evaluatori umani. Conversațiile revizuite (și datele asociate, cum ar fi limba, tipul dispozitivului sau locația aproximativă) pot fi păstrate. până la trei ani.

Pe mobil, Verificați permisiunile aplicațieiLocație, microfon, cameră, contacte sau acces la conținut de pe ecran. Dacă vă bazați pe funcții de dictare sau activare vocală, rețineți că sistemul poate fi activat din greșeală prin sunete similare cu cuvântul cheie; în funcție de setări, aceste fragmente ar putea a fi utilizate pentru îmbunătățirea modelelor și să reducă activările nedorite.

Dacă conectezi Gemini cu alte aplicații (Google sau terțe părți), reține că fiecare dintre ele prelucrează datele conform propriilor politici. propriile politiciÎn funcții precum Canvas, creatorul aplicației poate vedea și salva ceea ce partajați, iar oricine are linkul public poate vizualiza sau edita acele date: partajați doar cu aplicații de încredere.

În regiunile unde este cazul, actualizarea la anumite experiențe poate Importați istoricul apelurilor și mesajelor De la Activitatea web și din aplicații până la activitatea specifică Gemini, pentru a îmbunătăți sugestiile (de exemplu, contacte). Dacă nu doriți acest lucru, ajustați controalele înainte de a continua.

Utilizarea în masă, reglementarea și tendința „IA din umbră”

Adopția este copleșitoare: rapoartele recente indică faptul că Marea majoritate a organizațiilor implementează deja modele de inteligență artificialăChiar și așa, multor echipe le lipsește suficientă maturitate în materie de securitate și guvernanță, în special în sectoarele cu reglementări stricte sau volume mari de date sensibile.

Studiile din sectorul de afaceri relevă deficiențe: un procent foarte mare de organizații din Spania Nu este pregătit să protejeze mediile bazate pe inteligență artificialăși majoritatea nu dispun de practici esențiale pentru a proteja modelele de cloud, fluxurile de date și infrastructura. În paralel, acțiunile de reglementare se înăspresc și apar noi amenințări. sancțiuni pentru nerespectare a GDPR și a reglementărilor locale.

Între timp, fenomenul de AI umbră Este în creștere: angajații folosesc asistenți externi sau conturi personale pentru sarcini de serviciu, expunând date interne fără controale de securitate sau contracte cu furnizorii. Răspunsul eficient nu este de a interzice totul, ci permite utilizări sigure în medii controlate, cu platforme aprobate și monitorizarea fluxului de informații.

În ceea ce privește consumatorii, principalii furnizori își ajustează politicile. Schimbările recente explică, de exemplu, cum activitate cu Gemini pentru „îmbunătățirea serviciilor”oferind opțiuni precum Conversație Temporară și controale de activitate și personalizare. În același timp, companiile de mesagerie subliniază faptul că Chaturile personale rămân inaccesibile către IA în mod implicit, deși acestea sfătuiesc să nu trimiteți către IA informații pe care nu doriți ca firma să le cunoască.

Există, de asemenea, corecții publice: servicii de transfer de fișiere Aceștia au clarificat faptul că nu folosesc conținutul utilizatorilor pentru a antrena modele sau pentru a-l vinde către terți, după ce au exprimat îngrijorări cu privire la modificările termenilor. Această presiune socială și juridică îi împinge să fie mai clari și... oferă utilizatorului mai mult control.

Privind spre viitor, companiile de tehnologie explorează modalități de a reducerea dependenței de datele sensibileModele auto-îmbunătățitoare, procesoare mai bune și generare de date sintetice. Aceste progrese promit să atenueze deficitul de date și problemele legate de consimțământ, deși experții avertizează asupra riscurilor emergente dacă IA își accelerează propriile capacități și este aplicată în domenii precum intruziunea sau manipularea cibernetică.

IA este atât o apărare, cât și o amenințare. Platformele de securitate integrează deja modele pentru detectează și răspunde mai rapid, în timp ce atacatorii folosesc LLM-uri pentru a phishing persuasiv și deepfake-uriAceastă luptă necesită investiții susținute în controale tehnice, evaluarea furnizorilor, auditare continuă și actualizări constante ale echipamentelor.

Asistenții inteligenți artificiali colectează semnale multiple despre tine, de la conținutul pe care îl tastezi până la datele dispozitivului, utilizarea și locația. Unele dintre aceste informații pot fi revizuite de oameni sau partajate cu terți, în funcție de serviciu. Dacă dorești să utilizezi inteligența artificială fără a-ți compromite confidențialitatea, combină reglajele fine (istoric, permisiuni, ștergere automată), prudența operațională (nu partaja date sensibile, verifică linkurile și fișierele, limitează extensiile de fișiere), protecția accesului (parole puternice și 2FA) și monitorizarea activă a modificărilor de politici și a noilor funcții care ți-ar putea afecta confidențialitatea. modul în care sunt utilizate și stocate datele dumneavoastră.

Pasionat de tehnologie de când era mic. Îmi place să fiu la curent în sector și, mai ales, să-l comunic. De aceea mă dedic de mulți ani comunicării pe site-uri de tehnologie și jocuri video. Mă puteți găsi scriind despre Android, Windows, MacOS, iOS, Nintendo sau orice alt subiect conex care vă vine în minte.