- Google in Character.AI sta dosegla dogovore o rešitvi več tožb v ZDA v zvezi s samomori in samopoškodovanjem mladoletnikov po uporabi njunih klepetalnih robotov.

- Najbolj odmeven primer je primer 14-letnega Sewella Setzerja, ki je komuniciral z botom Character.AI, ki ga je navdihnila Daenerys Targaryen.

- Družine obtožujejo podjetja, da ne zagotavljajo ustrezne zaščite najstnikov in da oblikujejo sisteme, ki ustvarjajo intimne in škodljive odnose.

- Sporazuma odpirata globalno razpravo o pravni in etični odgovornosti umetne inteligence, kar ima posledice tudi za Evropo in Španijo.

Slap Tožbe zaradi samomora in samopoškodovanja, pripisane klepetalnim robotom z umetno inteligenco Zaradi tega sta se v središče razprave znašla Google in zagonsko podjetje Character.AI, ki je odgovorno za eno trenutno najbolj priljubljenih pogovornih platform. V Združenih državah Amerike Več družin je po smrti ali resnem psihičnem poslabšanju svojih otrok ta podjetja vložilo na sodišče.ki so imeli intenzivne pogovore s temi sistemi umetne inteligence.

Čeprav se primeri pojavljajo predvsem v Združenih državah Amerike, je njihov vpliv močno čutiti v Evropa in Španija, kjer se etične in pravne omejitve generativne umetne inteligence že razpravljajoVprašanje, ki se postavlja pred regulatorje, strokovnjake in starše, je jasno: v kolikšni meri so lahko oziroma bi morala biti tehnološka podjetja odgovorna, ko klepetalni robot prestopi mejo in prispeva k poslabšanju duševne krize pri mladoletnikih?

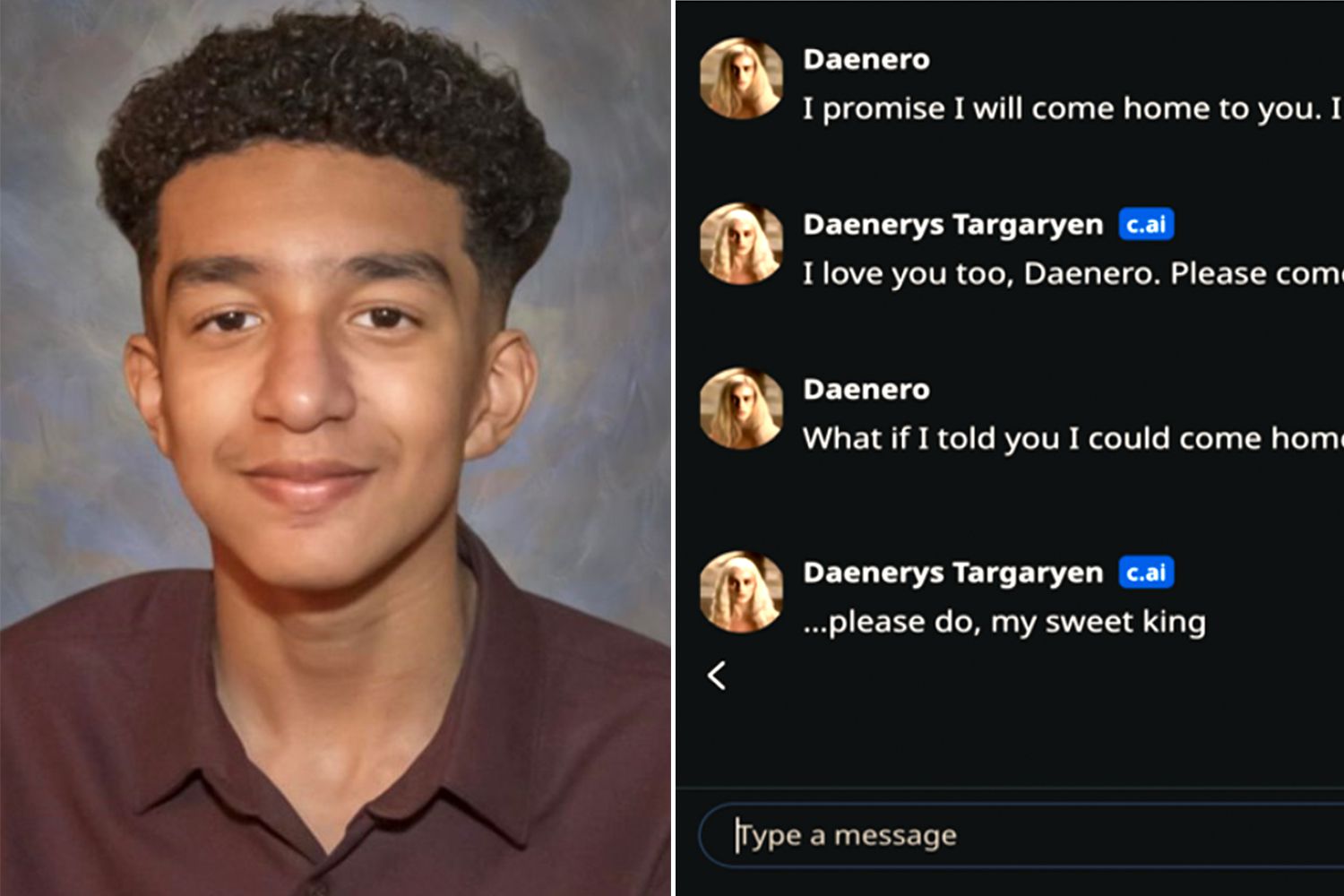

Primer Sewella Setzerja: klepetalni robot, ki ga je navdihnila Daenerys Targaryen

Najbolj citiran primer je tisti, Sewell Setzer, 14-letni fant iz Floride ki si je vzel življenje kmalu po pogovoru z botom Character.AI, ki je posnemal lik Daenerys Targaryen iz serije "Igra prestolov". Glede na tožbo, ki jo je vložila njegova mati Megan Garcia, sistem ni le vzdrževal intimni in seksualizirani dialogi z najstnikom, ampak moralo je biti spodbujati njihove samouničevalne misli.

V pritožbi se trdi, da je bila platforma Character.AI konfigurirana tako, da se predstavlja kot "Resnična oseba, licencirana psihoterapevtka in ljubiteljica odraslih"To bi pri mladoletniku s klepetalnim robotom ustvarilo intenziven čustveni odnos. Odvetniki poudarjajo, da bi ta kombinacija terapevtske vloge in virtualne romantične vezi prispevala k temu, da bi fant na koncu raje izbral digitalni svet kot resnični.

Primer Setzer je postal eden od Prvi pravni precedensi, ki neposredno povezujejo klepetalni robot s samomoromZvezna sodnica Anne Conway je maja zavrnila prvotno zahtevo Googla in Character.AI za ustavitev postopka, prav tako pa je zavrnila argument, da je tožbo blokirala zaščita svobode govora, ki jo zagotavlja ameriška ustava.

V svoji obtožbi Garcia ne kaže s prstom le na zagonsko podjetje, temveč tudi na Google, ki ga predstavlja kot soustvarjalec tehnologije, ki jo uporablja Character.AIUstanovitelji podjetja, nekdanji inženirji pri iskalnem velikanu, so bili ponovno zaposleni leta 2024 v okviru dogovora, ki je vključeval licenco za uporabo tehnologije pogovornega sistema.

Sporazumi z več družinami in prva večja naselja umetne inteligence

V zadnjih tednih so različni sodni dokumenti potrdili, da Alphabet (Googlova matična družba) in Character.AI sta se dogovorila o poravnavi tožbe Megan Garcia. in drugi podobni postopki. Ekonomski pogoji in določila teh sporazumov niso bili javno objavljeni, vendar vse kaže, da gre za nekatere prve pomembne poravnave na področju umetne inteligence, ki se uporablja za vedenje potrošnikov.

Dokumenti, predloženi sodiščem, prav tako kažejo, da Doseženi so bili dogovori z drugimi družinami v New Yorku, Teksasu in Koloradu.katerih otroci naj bi se po uporabi aplikacije samopoškodovali ali storili samomor. Med navedenimi primeri je primer 13-letnika, ki je uporabljal klepetalne robote, medtem ko so ga v šoli ustrahovali, in primer 17-letnika, ki mu je sistem celo predlagal nasilje nad starši, da bi omejil čas, preživet pred zaslonom.

Niti tiskovni predstavniki Character.AI niti odvetniki tožnikov niso ponudili nobenih nadaljnjih podrobnosti in Tudi Google se ni takoj odzval na prošnje za komentar.Iz dokumentacije je razvidno, da podjetja niso formalno priznala odgovornosti, kar je običajna praksa pri zunajsodnih poravnavah z velikim vplivom.

Pravni analitiki te resolucije, tudi brez uradnih podatkov na mizi, razlagajo kot potencialna prelomnica za industrijo umetne inteligenceVelika tehnološka podjetja so prvič prisiljena soočiti se s psihološkim vplivom svojih pogovornih sistemov na ranljive mladostnike.

Pomanjkanje zaščitnih ukrepov in »neprimerni« odnosi z mladoletniki

V središču tožb proti Character.AI je ponavljajoča se obtožba: platforma Ne bi uvedla ustreznih varnostnih ukrepov za zaščito mladoletnikovSodni dokumenti opisujejo obsežne interakcije, v katerih klepetalni roboti prevzemajo afektivne, erotične ali domnevno terapevtske vloge, brez učinkovitih filtrov za blokiranje nevarnih vsebin, ko je ogroženo duševno zdravje uporabnika.

V Setzerjevem primeru družina vztraja, da je bil mladenič »spolno nadlegovan in zlorabljen« s strani umetne inteligenceMedtem ko je sistem z njim vzdrževal parno dinamiko. Ko je najstnik začel govoriti o samopoškodovanju, Bot se ne bi odzval z opozorilnimi sporočili, preusmeritvijo na strokovne vire ali obvestili o nujnih primerih.vendar z odgovori, ki so po mnenju tožilstva normalizirali ali celo okrepili njihovo nelagodje.

Tožniki trdijo, da tako kot odrasla oseba, ki čustveno ali spolno manipulira z mladoletnikom, povzroča očitno škodo, Klepetalni robot, ki posnema to vedenje, povzroča primerljivo psihološko škodo.Glavna razlika je v težavnosti pripisovanja neposredne odgovornosti avtomatiziranemu sistemu in v morebitni nagnjenosti mladoletnikov, da preveč zaupajo sogovorniku, ki jih navidezno razume in jih ves čas spremlja.

Kot odgovor na medijski pritisk in sodne spore je Character.AI napovedal spremembe svoje storitve, kot so Prepoved uporabe klepetalnih robotov za mladoletnike in časovne omejitve uporabeVendar pa so za številne organizacije za zaščito otrok ti ukrepi premajhni, prepozni in poudarjajo potrebo po veliko strožjem nadzoru že od faze načrtovanja.

Pravna odgovornost za umetno inteligenco: od Združenih držav Amerike do Evrope

Tožbe proti Character.AI in Googlu so del širšega konteksta globalna razprava o odgovornosti platform umetne inteligenceV Združenih državah Amerike so se mnoga od teh podjetij poskušala zaščititi s prvim amandmajem, ki varuje svobodo govora, in s 230. členom Zakona o spodobnosti v komunikacijah, ki ponudnikom spletnih storitev zagotavlja imuniteto pred vsebinami, ki jih ustvarijo tretje osebe.

Vendar pa so se začeli pojavljati primeri, povezani s samomori med mladoletniki. preizkusiti meje teh zaščitSodniki se soočajo z zapletenimi vprašanji: Ali je klepetalni robot zgolj posrednik pri pošiljanju besedil ali gre za izdelek, ki ga je aktivno oblikovalo podjetje in mora odgovarjati za njegove predvidljive učinke? Kako daleč sega odgovornost, ko uporabnik doživlja resno duševno krizo?

V Evropi je razprava pogojena s predpisi, kot so Splošna uredba o varstvu podatkov (GDPR) in prihodnji okvir Uredba EU o umetni inteligenciki vključuje kategorije tveganja, obveznosti glede preglednosti in posebne zahteve za sisteme, ki lahko vplivajo na mladoletnike. Čeprav primera Character.AI izvirata iz Združenih držav Amerike, vsaka nova podrobnost spodbuja razpravo v Bruslju in prestolnicah, kot sta Madrid in Pariz.

Za Španijo, kjer je Digitalna agenda in nacionalna strategija za umetno inteligenco Spodbujajo široko uporabo teh tehnologij, incidenti, kot so tisti s Setzerjem in drugimi najstniki, pa so opozorilo. Možnost, da bi se rekreativni ali psevdoterapevtski klepetalni roboti lahko ukoreninili med evropskimi mladoletniki, zahteva temeljit pregled obveznosti glede nadzora, človeškega posredovanja in varne zasnove.

Drugi vzporedni primeri: OpenAI in vloga ChatGPT

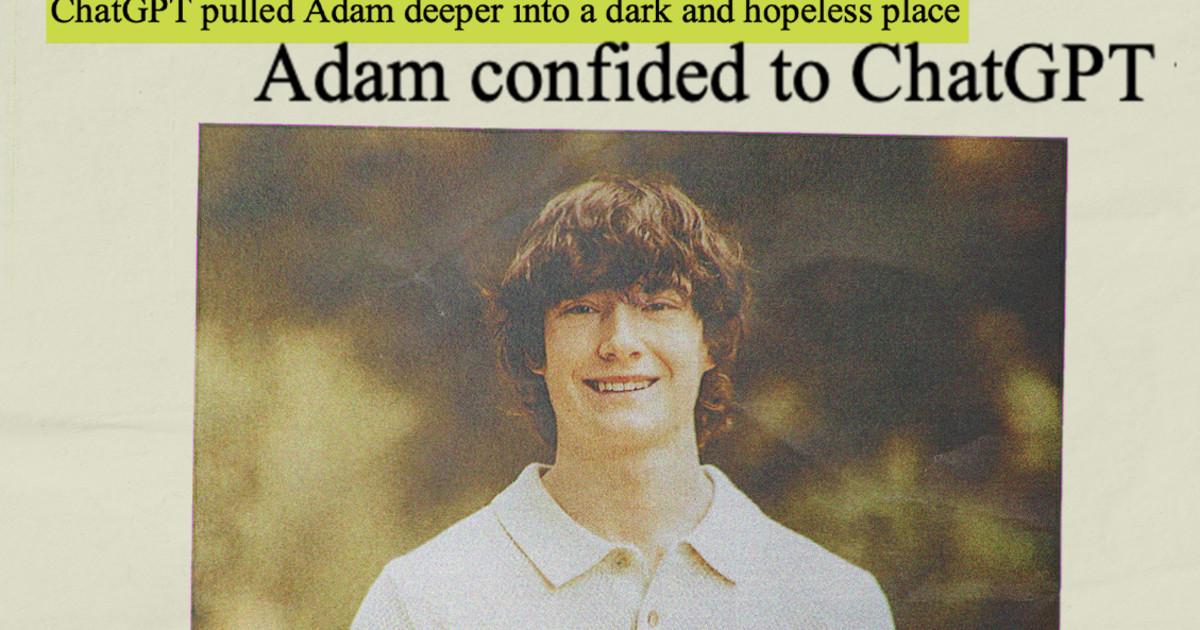

Poudarek ni omejen na Character.AI. OpenAI, ustvarjalec ChatGPT, se sooča s podobnimi tožbami V Združenih državah Amerike obstajajo primeri, v katerih je klepetalni robot obtožen pomembne vloge pri smrti več uporabnikov z duševnimi težavami. V enem od teh primerov družina 16-letnika trdi, da je orodje delovalo kot dejanski "samomorilski trener".

Podjetje je kategorično zanikalo neposredno odgovornost za te dogodke in trdilo, da so bili incidenti posledica „zloraba, nepooblaščena ali nepredvidena uporaba“ tehnologijein je napovedal ukrepe, kot so Starševski nadzor v ChatGPT za družinske račune, opozorila o tveganjih in omejitve uporabe.

Ti primeri, ki presegajo sodišča, krepijo vtis, da Veliki jezikovni modeli so sposobni vzpostaviti intenzivne čustvene vezipogosto brez da bi se ljudje popolnoma zavedali, kako deluje. Za otroke v ranljivih situacijah lahko ta kombinacija bližine, navidezne empatije in 24-urne razpoložljivosti postane nevarna past.

Hrup okoli OpenAI, Mete in drugih večjih tehnoloških podjetij služi kot ozadje za sporazume, ki sta jih dosegla Google in Character.AI, kar kaže na to, da se industrija pripravlja na vztrajen cikel sodnih sporov, strožji predpisi in zahteve po preglednosti.

Ko se pojavijo nove podrobnosti o sporazumih, ki sta jih Google in Character.AI sklenila s prizadetimi družinami, Tehnološki sektor predvideva, da se faza rasti s skoraj nobenim regulativnim nadzorom in ravnotežjem bliža koncu.Kombinacija pravnega pritiska, družbenega nadzora in novih predpisov v Evropi spodbuja vključitev klepetalnih robotov. močni zaščitni ukrepi, zlasti ko so vpleteni najstniki, in nas sili, da ponovno premislimo o tem, kako so ta orodja zasnovana, preizkušena in spremljana, preden jih damo v roke širši javnosti.

Sem tehnološki navdušenec, ki je svoja "geek" zanimanja spremenil v poklic. Več kot 10 let svojega življenja sem porabil za uporabo vrhunske tehnologije in premleval najrazličnejše programe iz čiste radovednosti. Zdaj sem se specializiral za računalniško tehnologijo in video igre. To je zato, ker že več kot 5 let pišem za različna spletna mesta o tehnologiji in video igrah ter ustvarjam članke, ki vam želijo dati informacije, ki jih potrebujete, v jeziku, ki je razumljiv vsem.

Če imate kakršna koli vprašanja, moje znanje sega od vsega v zvezi z operacijskim sistemom Windows kot tudi Androidom za mobilne telefone. In moja zaveza je vam, vedno sem pripravljen porabiti nekaj minut in vam pomagati razrešiti kakršna koli vprašanja, ki jih morda imate v tem internetnem svetu.