- SAM 3 introducerar bild- och videosegmentering vägledd av text och visuella exempel, med ett ordförråd bestående av miljontals koncept.

- Med SAM 3D kan du rekonstruera objekt, scener och människokroppar i 3D från en enda bild med hjälp av öppna modeller.

- Modeller kan testas utan teknisk kunskap i Segment Anything Playground, med praktiska och kreativa mallar.

- Meta släpper vikter, kontrollpunkter och nya riktmärken så att utvecklare och forskare i Europa och resten av världen kan integrera dessa funktioner i sina projekt.

Meta har tagit ytterligare ett steg i sitt engagemang för artificiell intelligens tillämpad på datorseende med den lansering av SAM 3 och SAM 3D, två modeller som utökar Segment Anything-familjen och som De siktar på att förändra hur vi arbetar med foton och videorLångt ifrån att förbli ett laboratorieexperiment vill företaget att dessa verktyg ska användas av både yrkesverksamma och användare utan teknisk bakgrund.

Med den här nya generationen fokuserar Meta på förbättra objektdetektering och segmentering och genom att föra fram tredimensionell rekonstruktion till en mycket bredare publikFrån videoredigering till produktvisualisering för e-handel i Spanien och resten av Europa, föreställer sig företaget ett scenario där Att bara beskriva vad du vill göra med ord räcker för att AI ska kunna göra det mesta av det tunga arbetet..

Vad erbjuder SAM 3 jämfört med tidigare versioner?

SAM 3 är positionerad som den direkta utvecklingen av de segmenteringsmodeller som Meta presenterade 2023 och 2024, kända som SAM 1 och SAM 2. Dessa tidiga versioner fokuserade på att identifiera vilka pixlar som tillhörde varje objekt, främst med hjälp av visuella ledtrådar som prickar, rutor eller masker, och i fallet med SAM 2, att följa objekt genom en video nästan i realtid.

Den viktigaste nya utvecklingen nu är att SAM 3 förstår rika och precisa textmeddelandeninte bara allmänna etiketter. Medan enkla termer som "bil" eller "buss" tidigare användes, kan den nya modellen svara på mycket mer specifika beskrivningar, till exempel "gul skolbuss" eller "röd bil dubbelparkerad".

I praktiken betyder det att det räcker med att skriva något i stil med "röd basebollkeps" så att systemet kan hitta och separera alla element som passar den beskrivningen i en bild eller video. Denna möjlighet att förfina med ord är särskilt användbar i professionella redigeringssammanhang, reklam eller innehållsanalys, där man ofta måste titta på väldigt specifika detaljer.

Dessutom har SAM 3 utformats för att integreras med stora multimodala språkmodellerDetta gör att du kan gå bortom enkla fraser och använda komplexa instruktioner som: "Folk som sitter ner men inte bär röd mössa" eller ”fotgängare som tittar in i kameran men utan ryggsäck.” Denna typ av instruktion kombinerar villkor och undantag som fram till nyligen var svåra att översätta till ett datorseendeverktyg.

Prestanda och skala för SAM 3-modellen

Meta ville också lyfta fram den mindre synliga men avgörande delen: teknisk prestanda och kunskapsskala av modellen. Enligt företagets data kan SAM 3 bearbeta en enda bild med fler än hundra detekterade objekt på cirka 30 millisekunder med hjälp av en H200 GPU, en hastighet som ligger mycket nära vad som behövs för krävande arbetsflöden.

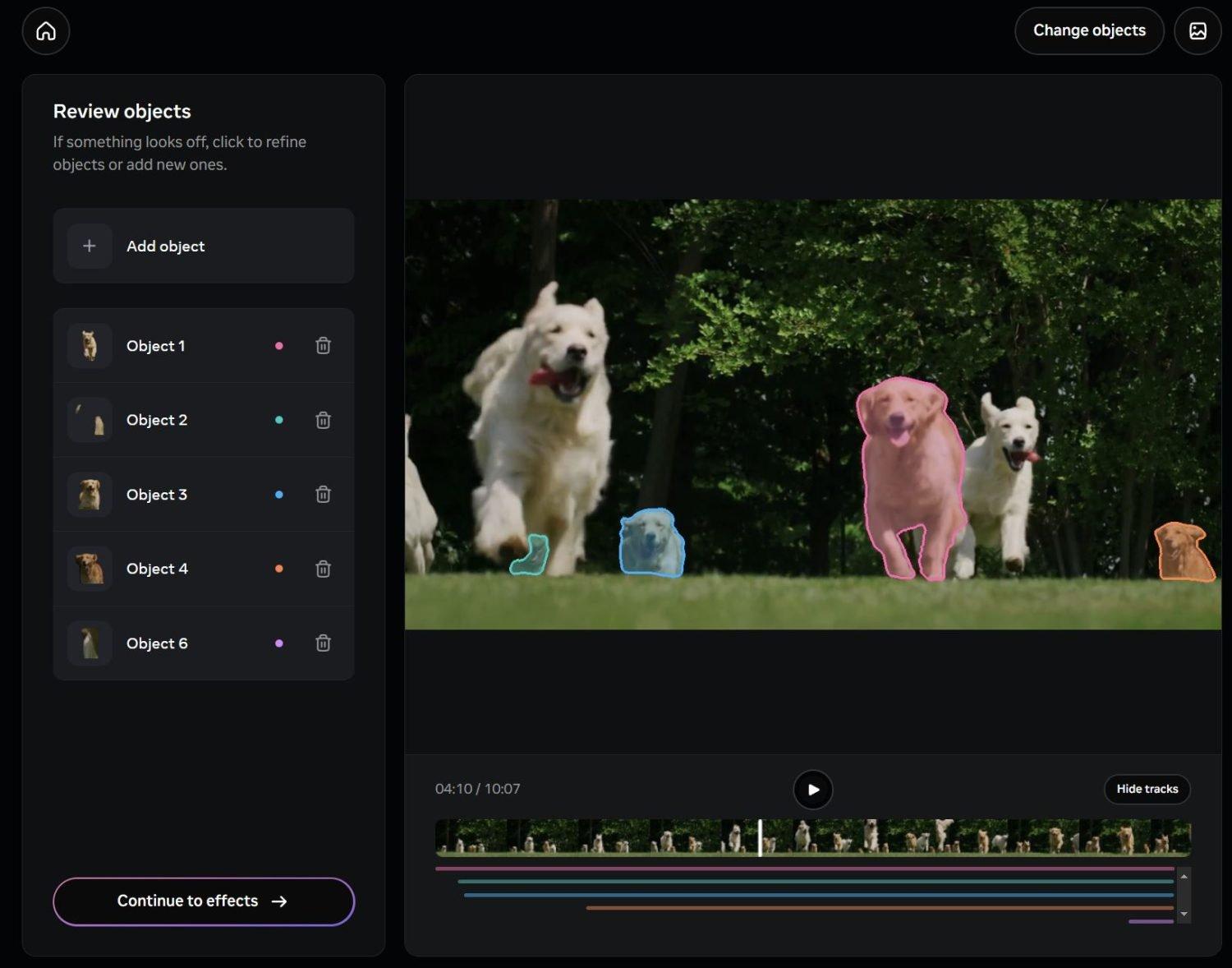

När det gäller videon försäkrar företaget att systemet bibehåller prestandan. praktiskt taget i realtid när man arbetar med cirka fem samtidiga objekt, vilket gör det möjligt att spåra och segmentera rörligt innehåll, från korta klipp på sociala medier till mer ambitiösa produktionsprojekt.

För att uppnå detta beteende har Meta byggt en träningsbas med mer än 4 miljoner unika konceptGenom att kombinera mänskliga annotatorer med AI-modeller för att märka stora datamängder syftar denna blandning av manuell och automatiserad övervakning till att balansera noggrannhet och skala – avgörande för att säkerställa att modellen svarar väl på olika input i europeiska, latinamerikanska och andra marknadssammanhang.

Företaget ramar in SAM 3 inom vad de kallar Segment Anything-samlingenEn familj av modeller, riktmärken och resurser utformade för att utöka AI:s visuella förståelse. Lanseringen åtföljs av ett nytt riktmärke för segmentering av "öppen vokabulär", fokuserat på att mäta i vilken utsträckning systemet kan förstå nästan alla koncept som uttrycks i naturligt språk.

Integration med Edits, Vibes och andra Meta-verktyg

Utöver den tekniska komponenten har Meta redan börjat integrera SAM 3 i specifika produkter som är avsedda för vardagsbruk. En av de första destinationerna kommer att vara Edits, deras program för videoskapande och redigering, där idén är att användaren kan välja specifika personer eller objekt med en enkel textbeskrivning och tillämpa effekter, filter eller ändringar endast på de delarna av filmen.

En annan väg till integration finns i Vibes, inom Meta AI-appen och meta.ai-plattformenI den här miljön kommer textsegmentering att kombineras med generativa verktyg för att skapa nya redigerings- och kreativa upplevelser, såsom anpassade bakgrunder, rörelseeffekter eller selektiva fotomodifieringar utformade för sociala nätverk som är mycket populära i Spanien och resten av Europa.

Företagets förslag är att dessa förmågor inte ska begränsas till yrkesstudier, utan snarare omfatta... oberoende kreatörer, små byråer och avancerade användare som dagligen arbetar med visuellt innehåll. Möjligheten att segmentera scener genom att skriva beskrivningar på naturligt språk minskar inlärningskurvan jämfört med traditionella verktyg baserade på manuella masker och lager.

Samtidigt har Meta en öppen inställning gentemot externa utvecklare och föreslår att tredjepartsapplikationer – från redigeringsverktyg till lösningar för videoanalys inom detaljhandel eller säkerhet – kan lita på SAM 3 så länge företagets användningspolicyer respekteras.

SAM 3D: Tredimensionell rekonstruktion från en enda bild

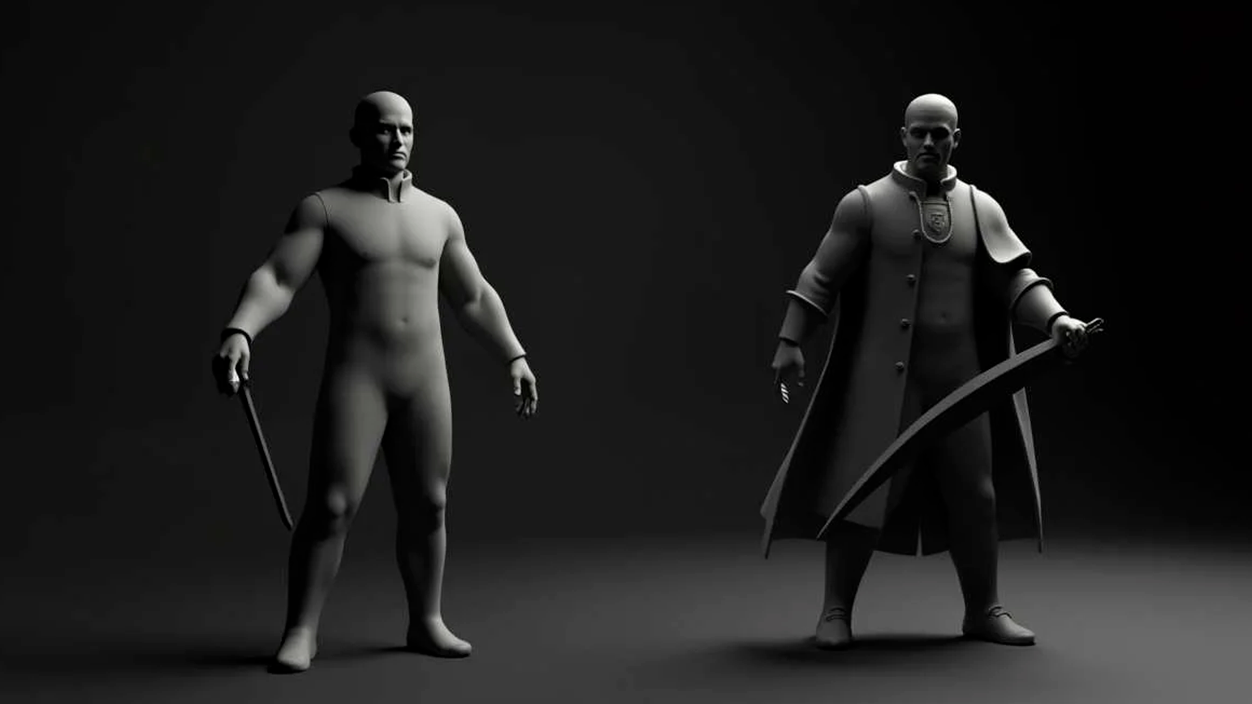

Den andra stora nyheten är SAM 3Dett system utformat för att utföra tredimensionella rekonstruktioner med utgångspunkt i 2D-bilder. Istället för att behöva flera bilder från olika vinklar, syftar modellen till att generera en tillförlitlig 3D-representation från ett enda foto, något som är särskilt intressant för dem som inte har specialiserad skanningsutrustning eller arbetsflöden.

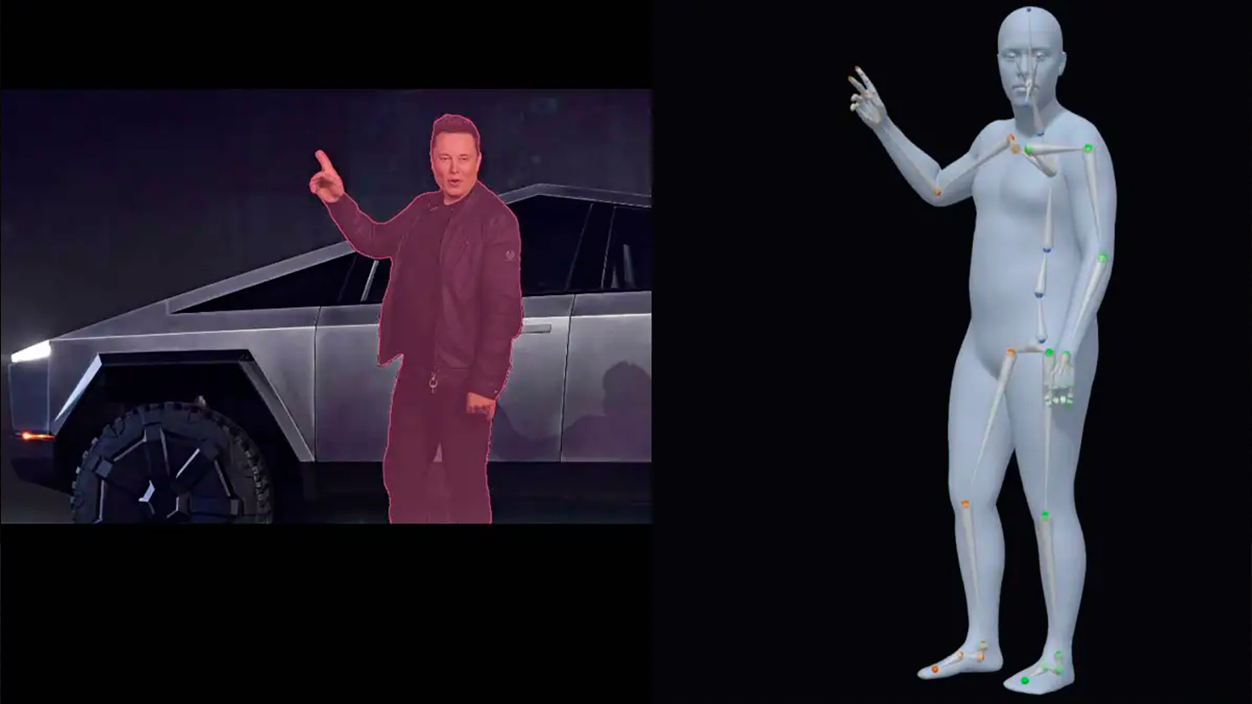

SAM 3D består av två modeller med öppen källkod med olika funktioner: SAM 3D-objektfokuserade på att rekonstruera objekt och scener, och SAM 3D-kropp, inriktad på att uppskatta mänsklig form och kropp. Denna separation gör att systemet kan anpassas till mycket olika användningsområden, från produktkataloger till hälso- eller sportapplikationer.

Enligt Meta markerar SAM 3D Objects en Nytt prestandamåttstock inom AI-guidad 3D-rekonstruktionvilket lätt överträffar tidigare metoder inom viktiga kvalitetsmått. För att mer rigoröst utvärdera resultaten har företaget samarbetat med konstnärer för att skapa SAM 3D Artist Objects, en datauppsättning som är specifikt utformad för att bedöma återgivningens naturtrohet och detaljer över en mängd olika bilder och objekt.

Detta framsteg öppnar dörren för praktiska tillämpningar inom områden som robotik, vetenskap, idrottsmedicin eller digital kreativitetInom robotik kan det till exempel hjälpa system att bättre förstå volymen på de objekt de interagerar med; inom medicinsk eller sportforskning kan det hjälpa till att analysera kroppshållning och rörelser; och inom kreativ design fungerar det som en grund för att generera 3D-modeller för animation, videospel eller immersiva upplevelser.

En av de första kommersiella tillämpningarna som redan syns är funktionen "Utsikt i rummet" de Facebook Marketplacevilket gör att du kan visualisera hur en möbel eller ett dekorativt föremål skulle se ut i ett verkligt rum innan du köper det. Med SAM 3D, Meta strävar efter att fullända den här typen av upplevelser, mycket relevant för europeisk e-handel, där returer av produkter på grund av ouppfyllda förväntningar innebär en ökande kostnad.

Segment Anything Playground: en miljö för experiment

För att allmänheten ska kunna testa dessa funktioner utan att installera något har Meta aktiverat Segmentera vad som helst LekplatsDet är en webbplattform som låter dig ladda upp bilder eller videor och experimentera med SAM 3 och SAM 3D direkt från din webbläsare. Tanken är att alla som är nyfikna på visuell AI kan utforska vad som är möjligt utan några programmeringskunskaper.

När det gäller SAM 3 tillåter Playground segmentering av objekt med hjälp av korta fraser eller detaljerade instruktionerKombinera text och, om så önskas, visuella exempel. Detta förenklar vanliga uppgifter som att välja personer, bilar, djur eller specifika element i scenen och tillämpa specifika åtgärder på dem, från estetiska effekter till oskärpa eller bakgrundsersättning.

När man arbetar med SAM 3D gör plattformen det möjligt Utforska scener från nya perspektivomorganisera objekt, tillämpa tredimensionella effekter eller generera alternativa vyer. För de som arbetar med design, reklam eller 3D-innehåll erbjuder det ett snabbt sätt att prototypa idéer utan att behöva använda komplexa tekniska verktyg från början.

Lekplatsen innehåller också en serie plantillas listas para usar Dessa funktioner är inriktade på mycket specifika uppgifter. De inkluderar praktiska alternativ som att pixelera ansikten eller registreringsskyltar av integritetsskäl, och visuella effekter som rörelsespår, selektiva markeringar eller spotlights på intressanta områden i videon. Den här typen av funktioner kan vara särskilt bra för arbetsflödena för digitala medier och innehållsskapare i Spanien, där produktionen av korta videor och innehåll för sociala medier är konstant.

Öppna resurser för utvecklare och forskare

I linje med den strategi Meta har följt i andra AI-utgåvor har företaget beslutat att släppa en betydande del av tekniska resurser relaterade till SAM 3 och SAM 3DFör det första har modellviktningarna, ett nytt riktmärke fokuserat på öppen ordförrådssegmentering och ett tekniskt dokument som beskriver dess utveckling offentliggjorts.

När det gäller SAM 3D är följande tillgängliga: modellkontrollpunkter, inferenskod och en utvärderingsdatauppsättning nästa generation. Denna datamängd innehåller en betydande variation av bilder och objekt som syftar till att gå utöver traditionella 3D-referenspunkter och ge större realism och komplexitet, något som kan vara mycket användbart för europeiska forskargrupper som arbetar med datorseende och grafik.

Meta har också tillkännagivit samarbeten med annoteringsplattformar som Roboflow, med målet att göra det möjligt för utvecklare och företag att Ange dina egna uppgifter och justera SAM 3 till specifika behov. Detta öppnar dörren för sektorspecifika lösningar, från industriell inspektion till analys av stadstrafik, inklusive kulturarvsprojekt där det är viktigt att noggrant segmentera arkitektoniska eller konstnärliga element.

Genom att välja en relativt öppen strategi strävar företaget efter att säkerställa att utvecklarnas ekosystem, universitet och startups – inklusive de som är verksamma i Spanien och resten av Europa – kan experimentera med dessa tekniker, integrera dem i sina egna produkter och i slutändan bidra med användningsfall som går utöver de som Meta kan utveckla internt.

Med SAM 3 och SAM 3D strävar Meta efter att befästa en mer flexibel och tillgänglig visuell AI-plattformdär textstyrd segmentering och 3D-rekonstruktion från en enda bild inte längre är funktioner som är reserverade för högspecialiserade team. Den potentiella effekten sträcker sig från vardaglig videoredigering till avancerade tillämpningar inom vetenskap, industri och e-handel, i ett sammanhang där kombinationen av språk, datorseende och kreativitet håller på att bli ett standardiserat arbetsverktyg och inte bara ett tekniskt löfte.

Jag är en teknikentusiast som har gjort sina "nördar"-intressen till ett yrke. Jag har tillbringat mer än 10 år av mitt liv med att använda den senaste tekniken och mixtrat med alla typer av program av ren nyfikenhet. Nu har jag specialiserat mig på datateknik och tv-spel. Detta beror på att jag i mer än 5 år har arbetat med att skriva för olika webbplatser om teknik och videospel, skapa artiklar som försöker ge dig den information du behöver på ett språk som är begripligt för alla.

Om du har några frågor sträcker sig min kunskap från allt som rör operativsystemet Windows samt Android för mobiltelefoner. Och mitt engagemang är för dig, jag är alltid villig att spendera några minuter och hjälpa dig att lösa alla frågor du kan ha i den här internetvärlden.