- Nemotron 3 är en öppen familj av modeller, data och bibliotek fokuserade på agentisk AI och multiagentsystem.

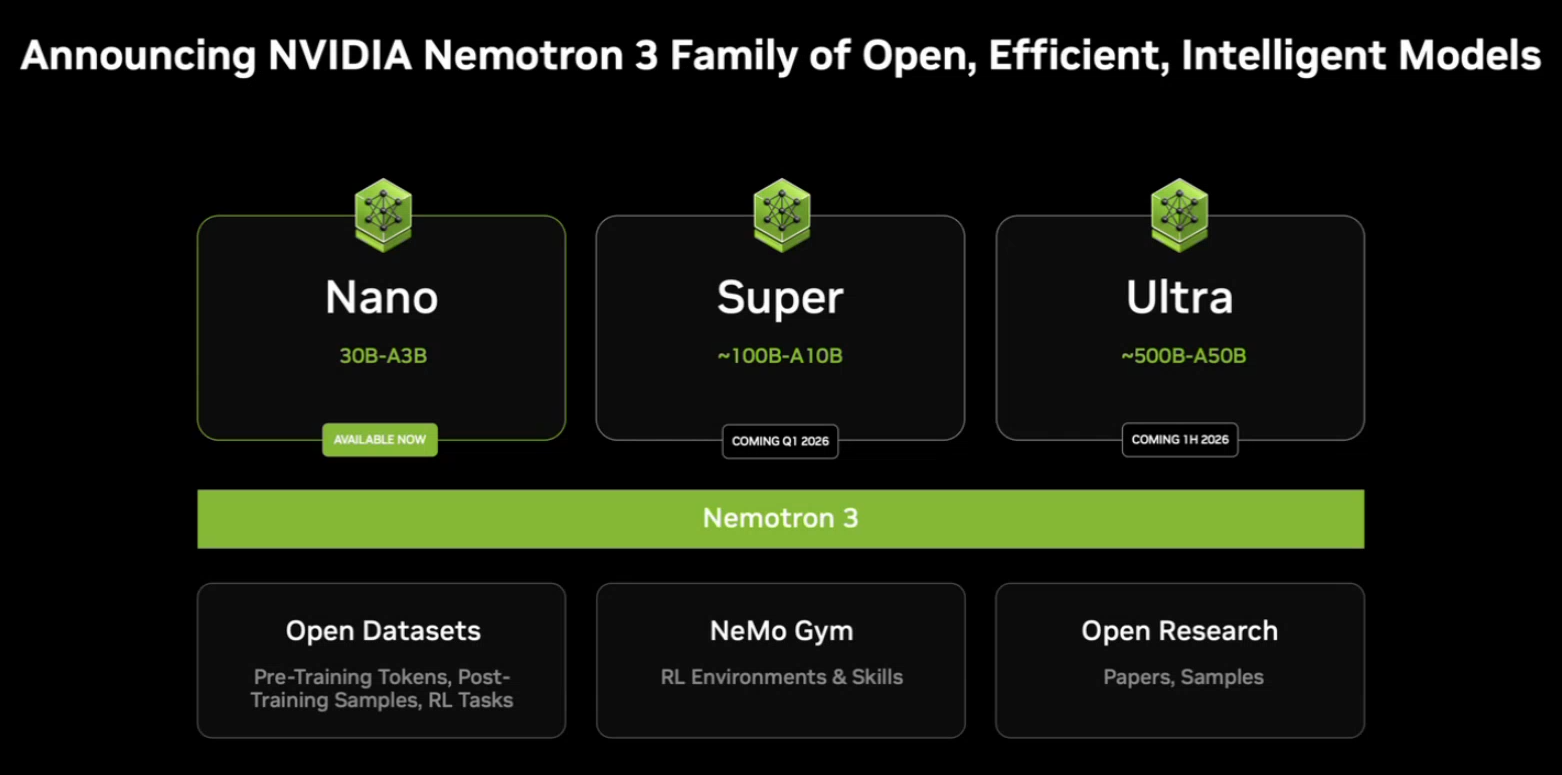

- Den inkluderar tre MoE-storlekar (Nano, Super och Ultra) med hybridarkitektur och effektiv 4-bitarsträning på NVIDIA Blackwell.

- Nemotron 3 Nano är nu tillgängligt i Europa via Hugging Face, publika moln och som en NIM-mikrotjänst, med ett fönster på 1 miljon tokens.

- Ekosystemet kompletteras med massiva datamängder, NeMo Gym, NeMo RL och Evaluator för att utbilda, finjustera och granska suveräna AI-agenter.

Kapplöpningen om artificiell intelligens går från enkla, isolerade chattrobotar till agentsystem som samarbetar med varandra, hanterar långa arbetsflöden och behöver vara granskningsbara. I detta nya scenario, NVIDIA har beslutat att ta ett ganska tydligt steg: att öppna inte bara modeller, utan även data och verktygså att företag, offentliga förvaltningar och forskningscentra kan bygga sina egna AI-plattformar med mer kontroll.

Den rörelsen materialiseras i Nemotron 3, en familj av öppna modeller inriktade på AI med flera agenter Den strävar efter att kombinera hög prestanda, låga inferenskostnader och transparens. Förslaget är inte avsett som bara ytterligare en allmän chatbot, utan som en bas för att utplacera agenter som resonerar, planerar och utför komplexa uppgifter inom reglerade sektorerDetta är särskilt relevant i Europa och Spanien, där datasuveränitet och regelefterlevnad är viktiga.

En öppen familj av modeller för agentisk och suverän AI

Nemotron 3 presenteras som ett komplett ekosystem: modeller, datamängder, bibliotek och träningsrecept under öppna licenser. NVIDIAs idé är att organisationer inte bara konsumerar AI som en ogenomskinlig tjänst, utan kan inspektera vad som finns inuti, anpassa modellerna till sina domäner och distribuera dem på sin egen infrastruktur, oavsett om det är i molnet eller i lokala datacenter.

Företaget utformar denna strategi inom ramen för sitt åtagande att Suverän AIRegeringar och företag i Europa, Sydkorea och andra regioner söker öppna alternativ till slutna eller utländska system, vilka ofta inte överensstämmer väl med deras dataskyddslagar eller revisionskrav. Nemotron 3 syftar till att vara den tekniska grunden för att bygga nationella, sektoriella eller företagsmodeller med större synlighet och kontroll.

Parallellt, NVIDIA stärker sin position bortom hårdvaraFram tills nu var det främst en referensleverantör av GPU:er; med Nemotron 3 positionerar det sig också i modellerings- och träningsverktygslagret och konkurrerar mer direkt med aktörer som OpenAI, Google, Anthropic eller till och med Meta, och mot premiummodeller som SuperGrok HeavyMeta har minskat sitt engagemang för öppen källkod under de senaste generationerna av Llama.

För det europeiska forsknings- och startup-ekosystemet – som är starkt beroende av öppna modeller som finns på plattformar som Hugging Face – representerar tillgången till vikter, syntetiska data och bibliotek under öppna licenser ett kraftfullt alternativ till kinesiska modeller och amerikaner som dominerar popularitets- och benchmarkrankningarna.

Hybrid MoE-arkitektur: effektivitet för storskaliga agenter

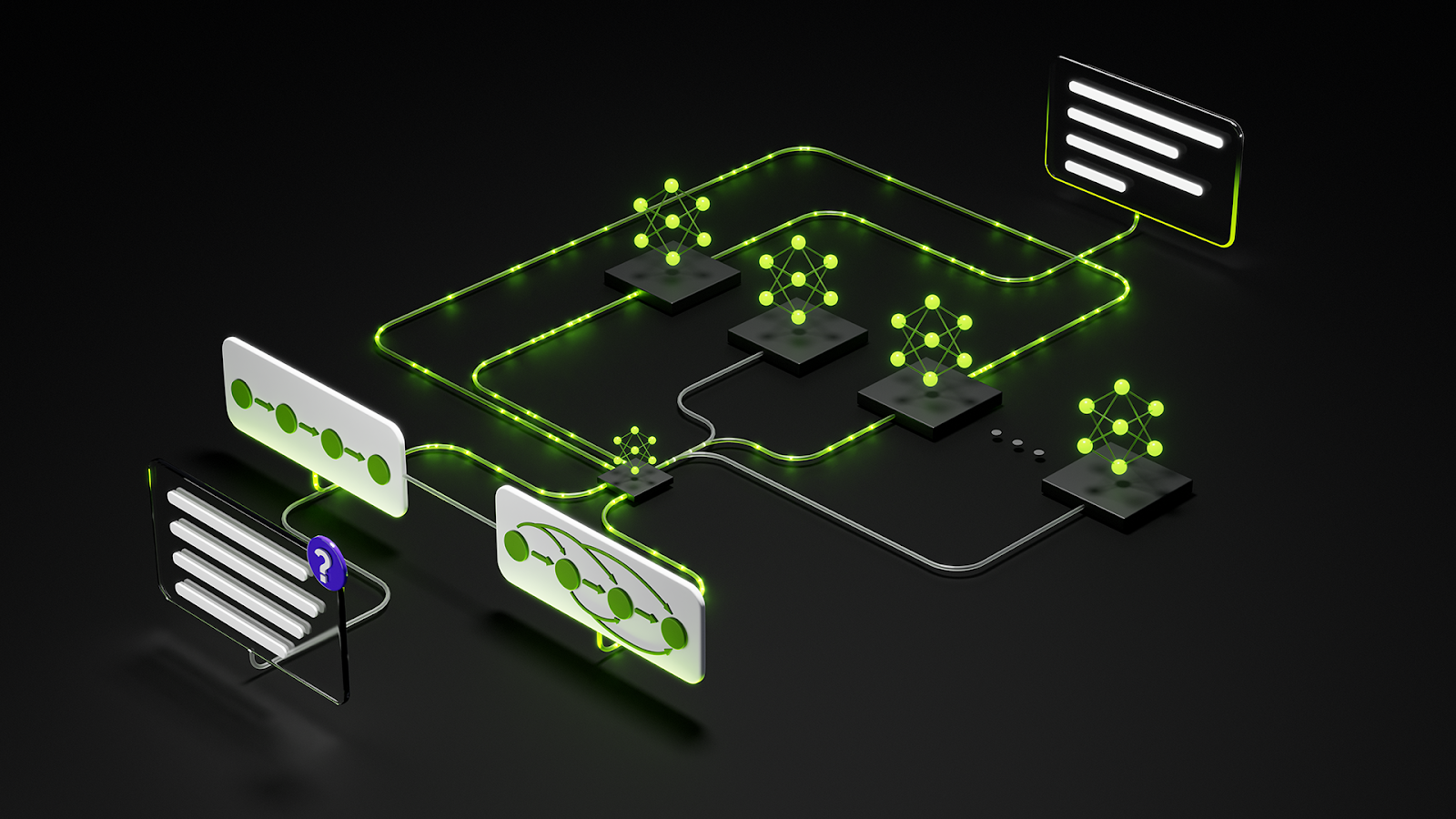

Den centrala tekniska funktionen hos Nemotron 3 är en Hybridarkitektur av latent expertmix (MoE)Istället för att aktivera alla modellens parametrar i varje inferens, aktiveras endast en bråkdel av dem, den delmängd av experter som är mest relevanta för uppgiften eller tokenet i fråga.

Denna metod tillåter drastiskt minska beräkningskostnader och minnesförbrukningDetta ökar också token-genomströmningen. För arkitekturer med flera agenter, där dussintals eller hundratals agenter kontinuerligt utbyter meddelanden, är denna effektivitet nyckeln till att förhindra att systemet blir ohållbart vad gäller GPU- och molnkostnader.

Enligt data som delats av NVIDIA och oberoende riktmärken uppnår Nemotron 3 Nano upp till fyra gånger fler tokens per sekund Jämfört med sin föregångare, Nemotron 2 Nano, minskar den genereringen av onödiga resonemangstokens med cirka 60 %. I praktiken innebär detta lika eller till och med mer exakta svar, men med mindre "ordlighet" och en lägre kostnad per fråga.

Hybridarkitekturen för MoE, i kombination med specifika träningstekniker, har lett till Många av de mest avancerade öppna modellerna använder expertschemanNemotron 3 ansluter sig till denna trend, men fokuserar specifikt på agentisk AI: interna rutter utformade för samordning mellan agenter, användning av verktyg, hantering av långa tillstånd och stegvis planering.

Tre storlekar: Nano, Super och Ultra för olika arbetsbelastningar

Nemotron 3-familjen är organiserad i tre huvudstorlekar av MoE-modellen, alla öppna och med reducerade aktiva parametrar tack vare expertarkitekturen:

- Nemotron 3 Nanocirka 30.000 miljarder parametrar totalt, med cirka 3.000 miljarder tillgångar per tokenDen är utformad för riktade uppgifter där effektivitet är viktigt: felsökning av programvara, dokumentsammanfattning, informationshämtning, systemövervakning eller specialiserade AI-assistenter.

- Nemotron 3 Superungefär 100.000 miljarder parametrar, med 10.000 miljarder i tillgångar vid varje steg. Den är inriktad på Avancerat resonemang i arkitekturer med flera agentermed låg latens även när flera agenter samarbetar för att lösa komplexa flöden.

- Nemotron 3 Ultraden övre nivån, med cirka 500.000 miljarder parametrar och upp till 50.000 miljarder tillgångar per tokenDen fungerar som en kraftfull resonemangsmotor för forskning, strategisk planering, beslutsstöd på hög nivå och särskilt krävande AI-system.

I praktiken gör detta det möjligt för organisationer Välj modellstorlek efter din budget och dina behovNano för massiva, intensiva arbetsbelastningar och snäva kostnader; Super när mer djupgående resonemang behövs med många samarbetande agenter; och Ultra för fall där kvalitet och lång kontext överväger GPU-kostnaden.

För tillfället, Endast Nemotron 3 Nano är tillgänglig för omedelbar användning.Super- och Ultra-varianterna är planerade till första halvåret 2026, vilket ger europeiska företag och laboratorier tid att först experimentera med Nano, etablera pipelines och senare migrera fall som kräver större kapacitet.

Nemotron 3 Nano: 1 miljon token-fönster och begränsad kostnad

Nemotron 3 Nano är, från och med idag, familjens praktiska spjutspetsNVIDIA beskriver den som den mest beräkningsmässigt kostnadseffektiva modellen i serien, optimerad för att leverera maximal prestanda i arbetsflöden med flera agenter och intensiva men repetitiva uppgifter.

Bland dess tekniska egenskaper utmärker sig följande: kontextfönster på upp till en miljon tokensDetta möjliggör minneslagring för omfattande dokument, hela koddatabaser eller affärsprocesser i flera steg. För europeiska tillämpningar inom bank, sjukvård eller offentlig förvaltning, där dokument kan vara omfattande, är denna långsiktiga kontextfunktion särskilt värdefull.

Riktmärkena för den oberoende organisationen Artificiell analys placerar Nemotron 3 Nano som en av de mest balanserade modellerna med öppen källkod Den kombinerar intelligens, noggrannhet och hastighet, med genomströmningshastigheter på hundratals tokens per sekund. Denna kombination gör den attraktiv för AI-integratörer och tjänsteleverantörer i Spanien som behöver en bra användarupplevelse utan att infrastrukturkostnaderna stiger i höjden.

När det gäller användningsfall riktar NVIDIA in sig på Nano på Innehållssammanfattning, programvarufelsökning, informationshämtning och AI-assistenter för företagTack vare minskningen av redundanta resonemangstokens är det möjligt att köra agenter som upprätthåller långa samtal med användare eller system utan att kostnaderna för slutledningar skjuter i höjden.

Öppna data och bibliotek: NeMo Gym, NeMo RL och Evaluator

En av de mest utmärkande egenskaperna hos Nemotron 3 är att Det är inte begränsat till att släppa modellvikterNVIDIA kompletterar familjen med en omfattande uppsättning öppna resurser för utbildning, finjustering och utvärdering av agenter.

Å ena sidan tillgängliggör den en syntetisk korpus av flera biljoner tokens av data före, efter träning och förstärkningDessa datamängder, fokuserade på resonemang, kodning och arbetsflöden i flera steg, gör det möjligt för företag och forskningscentra att generera sina egna domänspecifika varianter av Nemotron (t.ex. juridik, hälso- och sjukvård eller industri) utan att börja från början.

Bland dessa resurser utmärker sig följande: Nemotron Agentic Safety-datasetDen samlar in telemetridata om agenters beteende i verkliga scenarier. Målet är att hjälpa team att mäta och stärka säkerheten i komplexa autonoma system: från vilka åtgärder en agent vidtar när den stöter på känslig data, till hur den reagerar på tvetydiga eller potentiellt skadliga kommandon.

Angående verktygssektionen lanserar NVIDIA NeMo Gym och NeMo RL som bibliotek med öppen källkod för förstärkningsträning och efterträning, tillsammans med NeMo Evaluator för bedömning av säkerhet och prestanda. Dessa bibliotek tillhandahåller färdiga simuleringsmiljöer och pipelines med Nemotron-familjen, men kan utökas till andra modeller.

Allt detta material – vikter, datamängder och kod – distribueras via GitHub och Hugging Face är licensierade under NVIDIA Open Model License.så att europeiska team sömlöst kan integrera det i sina egna MLOps. Företag som Prime Intellect och Unsloth integrerar redan NeMo Gym direkt i sina arbetsflöden för att förenkla förstärkningsinlärning på Nemotron.

Tillgänglighet i publika moln och det europeiska ekosystemet

Nemotron 3 Nano finns nu tillgänglig på Kramande ansikte y GitHubsåväl som genom inferensleverantörer som Baseten, DeepInfra, Fireworks, FriendliAI, OpenRouter och Together AI. Detta öppnar dörren för utvecklingsteam i Spanien att testa modellen via API eller distribuera den på sina egna infrastrukturer utan överdriven komplexitet.

På molnfronten, Nemotron 3 Nano ansluter sig till AWS via Amazon Bedrock för serverlös inferens och har meddelat stöd för Google Cloud, CoreWeave, Crusoe, Microsoft Foundry, Nebius, Nscale och Yotta. För europeiska organisationer som redan arbetar med dessa plattformar gör detta det enklare att anamma Nemotron utan drastiska förändringar i deras arkitektur.

Förutom det publika molnet marknadsför NVIDIA användningen av Nemotron 3 Nano som NIM-mikrotjänst kan distribueras på vilken NVIDIA-accelererad infrastruktur som helstDetta möjliggör hybridscenarier: en del av belastningen i internationella moln och en del i lokala datacenter eller i europeiska moln som prioriterar datalagring i EU.

Versioner Nemotron 3 Super och Ultra, inriktade på extrema resonemangsbelastningar och storskaliga system med flera agenter, är planerad till första halvåret 2026Denna tidslinje ger det europeiska forsknings- och affärsekosystemet tid att experimentera med nano, validera användningsfall och utforma migreringsstrategier till större modeller vid behov.

Nemotron 3 positionerar NVIDIA som en av de ledande leverantörerna av avancerade öppna modeller inriktade på agent AIMed ett förslag som kombinerar teknisk effektivitet (hybrid MoE, NVFP4, massivt sammanhang), öppenhet (vikter, datamängder och tillgängliga bibliotek) och ett tydligt fokus på datasuveränitet och transparens, aspekter som är särskilt känsliga i Spanien och resten av Europa, där reglering och tryck att granska AI blir allt större.

Jag är en teknikentusiast som har gjort sina "nördar"-intressen till ett yrke. Jag har tillbringat mer än 10 år av mitt liv med att använda den senaste tekniken och mixtrat med alla typer av program av ren nyfikenhet. Nu har jag specialiserat mig på datateknik och tv-spel. Detta beror på att jag i mer än 5 år har arbetat med att skriva för olika webbplatser om teknik och videospel, skapa artiklar som försöker ge dig den information du behöver på ett språk som är begripligt för alla.

Om du har några frågor sträcker sig min kunskap från allt som rör operativsystemet Windows samt Android för mobiltelefoner. Och mitt engagemang är för dig, jag är alltid villig att spendera några minuter och hjälpa dig att lösa alla frågor du kan ha i den här internetvärlden.