- Ipinakikilala ng SAM 3 ang segmentasyon ng larawan at video na ginagabayan ng mga text at visual na halimbawa, na may bokabularyo ng milyun-milyong konsepto.

- Binibigyang-daan ka ng SAM 3D na buuin muli ang mga bagay, eksena, at katawan ng tao sa 3D mula sa isang larawan, gamit ang mga bukas na modelo.

- Maaaring subukan ang mga modelo nang walang teknikal na kaalaman sa Segment Anything Playground, na may praktikal at malikhaing template.

- Ang Meta ay naglalabas ng mga timbang, checkpoint, at mga bagong benchmark upang maisama ng mga developer at mananaliksik sa Europe at sa iba pang bahagi ng mundo ang mga kakayahan na ito sa kanilang mga proyekto.

Ang Meta ay gumawa ng isa pang hakbang sa kanyang pangako sa inilapat ang artificial intelligence sa computer vision sa paglulunsad ng SAM 3 at SAM 3D, dalawang modelo na nagpapalawak sa pamilya ng Segment Anything at iyon Nilalayon nilang baguhin ang paraan ng paggawa namin sa mga larawan at videoMalayo sa pananatiling isang eksperimento sa laboratoryo, gusto ng kumpanya na gamitin ang mga tool na ito ng parehong mga propesyonal at user na walang teknikal na background.

Sa bagong henerasyong ito, nakatuon ang Meta pagbutihin ang pagtuklas at pagse-segment ng bagay at sa pagdadala ng three-dimensional na muling pagtatayo sa mas malawak na madlaMula sa pag-edit ng video hanggang sa visualization ng produkto para sa e-commerce sa Spain at sa iba pang bahagi ng Europe, ang kumpanya ay nag-iisip ng isang senaryo kung saan Ang simpleng paglalarawan kung ano ang gusto mong gawin sa mga salita ay sapat na para magawa ng AI ang karamihan sa mabibigat na pag-angat..

Ano ang inaalok ng SAM 3 kumpara sa mga nakaraang bersyon?

Ang SAM 3 ay nakaposisyon bilang direktang ebolusyon ng mga modelo ng pagse-segment na ipinakita ng Meta noong 2023 at 2024, na kilala bilang SAM 1 at SAM 2. Ang mga naunang bersyong iyon ay nakatuon sa pagtukoy kung aling mga pixel ang pag-aari ng bawat bagay, pangunahin ang paggamit ng mga visual na cue gaya ng mga tuldok, kahon o mask, at sa kaso ng SAM 2, na sinusundan ang mga bagay sa kabuuan ng isang video nang halos real time.

Ang pangunahing bagong pag-unlad ngayon ay naiintindihan ng SAM 3 mayaman at tumpak na text prompthindi lamang mga pangkalahatang label. Samantalang bago ginamit ang mga simpleng termino tulad ng "kotse" o "bus," ang bagong modelo ay may kakayahang tumugon sa mas tiyak na mga paglalarawan, halimbawa "dilaw na school bus" o "pulang kotseng naka-double-park".

Sa pagsasagawa, ito ay nangangahulugan na ito ay sapat na upang magsulat ng isang bagay tulad ng “pulang baseball cap” upang mahanap at mapaghiwalay ng system ang lahat ng elementong akma sa paglalarawang iyon sa loob ng isang larawan o video. Ang kakayahang ito na pinuhin gamit ang mga salita ay lalong kapaki-pakinabang sa propesyonal na konteksto sa pag-edit, pag-advertise o pagsusuri ng nilalaman, kung saan madalas mong kailanganing tumingin sa mga partikular na detalye.

Higit pa rito, ang SAM 3 ay idinisenyo upang maisama sa malalaking multimodal na modelo ng wikaNagbibigay-daan ito sa iyo na lumampas sa mga simpleng parirala at gumamit ng mga kumplikadong tagubilin gaya ng: “Mga taong nakaupo ngunit hindi nakasuot ng pulang sumbrero” o "mga naglalakad na tumitingin sa camera ngunit walang backpack." Pinagsasama ng ganitong uri ng pagtuturo ang mga kundisyon at pagbubukod na hanggang kamakailan ay mahirap isalin sa isang tool sa computer vision.

Pagganap at sukat ng modelong SAM 3

Nais ding i-highlight ng Meta ang hindi gaanong nakikita ngunit mahalagang bahagi: ang teknikal na pagganap at sukat ng kaalaman ng modelo. Ayon sa data ng kumpanya, ang SAM 3 ay may kakayahang magproseso ng isang larawan na may higit sa isang daang natukoy na mga bagay sa humigit-kumulang 30 millisecond gamit ang isang H200 GPU, isang bilis na napakalapit sa kung ano ang kinakailangan para sa mga hinihingi na daloy ng trabaho.

Sa kaso ng video, tinitiyak ng kompanya na pinapanatili ng system ang pagganap halos sa real time kapag nagtatrabaho sa halos limang sabay-sabay na bagay, ginagawa itong mabubuhay para sa pagsubaybay at pagse-segment ng gumagalaw na nilalaman, mula sa maiikling social media clip hanggang sa mas mapaghangad na mga proyekto sa produksyon.

Upang makamit ang pag-uugaling ito, bumuo ang Meta ng isang base ng pagsasanay na may higit sa 4 milyong natatanging konseptoAng pagsasama-sama ng mga annotator ng tao sa mga modelo ng AI upang tumulong sa pag-label ng malalaking volume ng data, ang timpla ng manu-mano at awtomatikong pangangasiwa na ito ay naglalayong balansehin ang katumpakan at sukat—susi upang matiyak na mahusay ang pagtugon ng modelo sa magkakaibang input sa European, Latin American, at iba pang konteksto ng merkado.

Kino-frame ng kumpanya ang SAM 3 sa kung ano ang tawag nito I-segment ang Koleksyon ng Kahit anoIsang pamilya ng mga modelo, benchmark, at mapagkukunan na idinisenyo upang palawakin ang visual na pang-unawa ng AI. Ang paglunsad ay sinamahan ng isang bagong benchmark para sa "bukas na bokabularyo" na pagse-segment, na nakatuon sa pagsukat sa lawak kung saan naiintindihan ng system ang halos anumang konsepto na ipinahayag sa natural na wika.

Pagsasama sa Mga Pag-edit, Vibes, at iba pang mga tool sa Meta

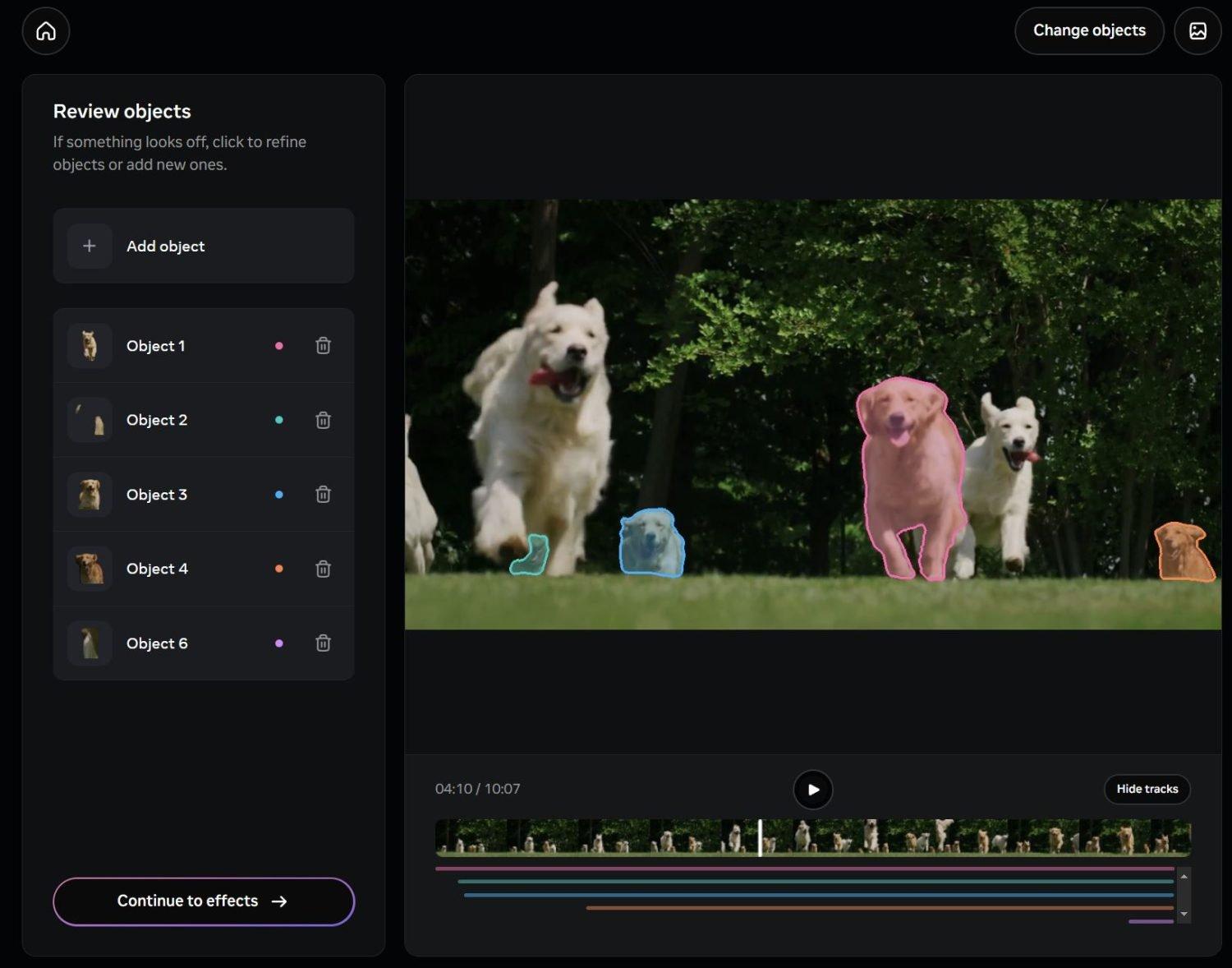

Higit pa sa teknikal na bahagi, nagsimula na ang Meta isama ang SAM 3 sa mga partikular na produkto na inilaan para sa pang-araw-araw na paggamit. Ang isa sa mga unang destinasyon ay ang Mga Pag-edit, ang kanilang application sa paggawa at pag-edit ng video, kung saan ang ideya ay maaaring pumili ang user ng mga partikular na tao o bagay na may simpleng paglalarawan ng teksto at maglapat ng mga epekto, filter o pagbabago lamang sa mga bahaging iyon ng footage.

Ang isa pang paraan para sa pagsasama ay makikita sa Vibes, sa loob ng Meta AI app at sa meta.ai platformSa ganitong kapaligiran, ang pagse-segment ng teksto ay isasama sa mga generative na tool upang lumikha ng mga bagong pag-edit at malikhaing karanasan, tulad ng mga custom na background, mga epekto ng paggalaw, o mga piling pagbabago sa larawan na idinisenyo para sa mga social network na napakasikat sa Spain at sa iba pang bahagi ng Europe.

Ang mungkahi ng kumpanya ay ang mga kakayahan na ito ay hindi limitado sa mga propesyonal na pag-aaral, ngunit sa halip ay maabot... mga independiyenteng tagalikha, maliliit na ahensya, at mga advanced na user na nagtatrabaho araw-araw na may visual na nilalaman. Ang kakayahang mag-segment ng mga eksena sa pamamagitan ng pagsusulat ng mga paglalarawan sa natural na wika ay nagpapababa sa kurba ng pagkatuto kumpara sa mga tradisyunal na tool batay sa mga manu-manong mask at layer.

Kasabay nito, ang Meta ay nagpapanatili ng isang bukas na diskarte patungo sa mga panlabas na developer, na nagmumungkahi na mga application ng third party -mula sa mga tool sa pag-edit hanggang sa mga solusyon para sa video analytics sa retail o seguridad- ay maaaring umasa sa SAM 3 hangga't iginagalang ang mga patakaran sa paggamit ng kumpanya.

SAM 3D: Three-dimensional na muling pagtatayo mula sa isang larawan

Ang iba pang malaking balita ay SAM 3Disang sistema na idinisenyo upang gumanap tatlong-dimensional na muling pagtatayo simula sa mga 2D na larawan. Sa halip na mangailangan ng maraming pagkuha mula sa iba't ibang anggulo, ang modelo ay naglalayong bumuo ng isang maaasahang 3D na representasyon mula sa isang larawan, isang bagay na partikular na kawili-wili para sa mga walang espesyal na kagamitan sa pag-scan o mga daloy ng trabaho.

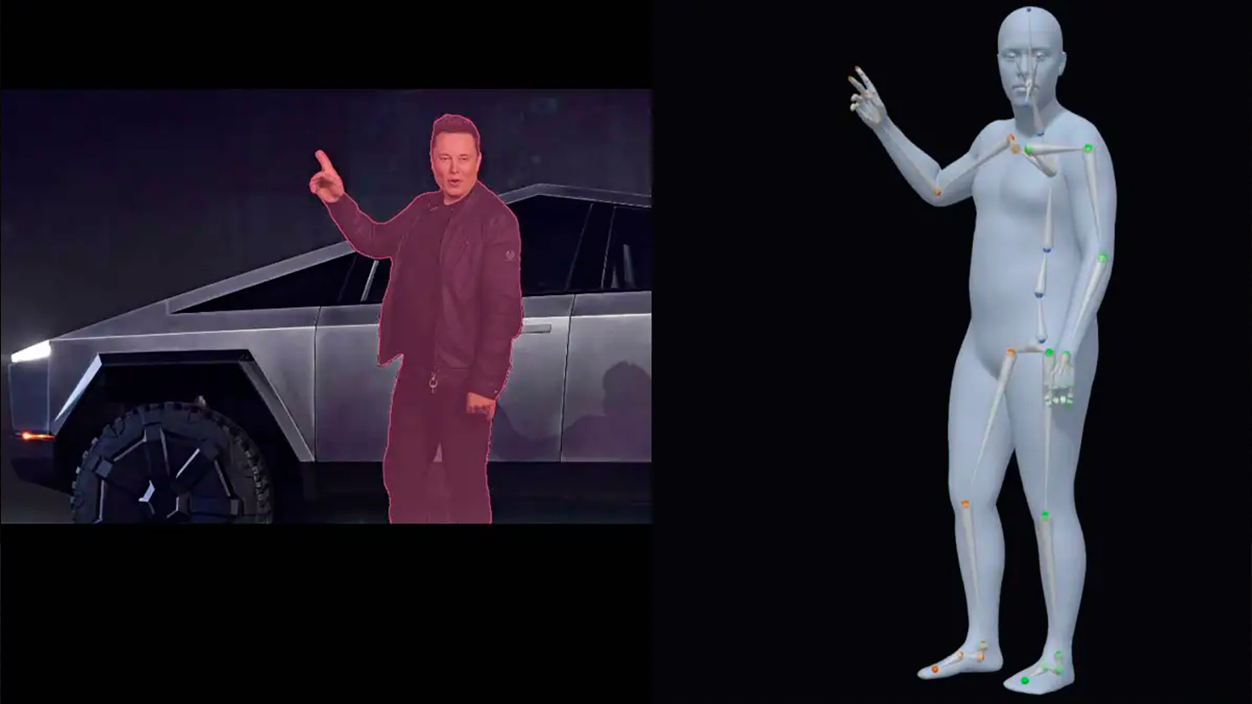

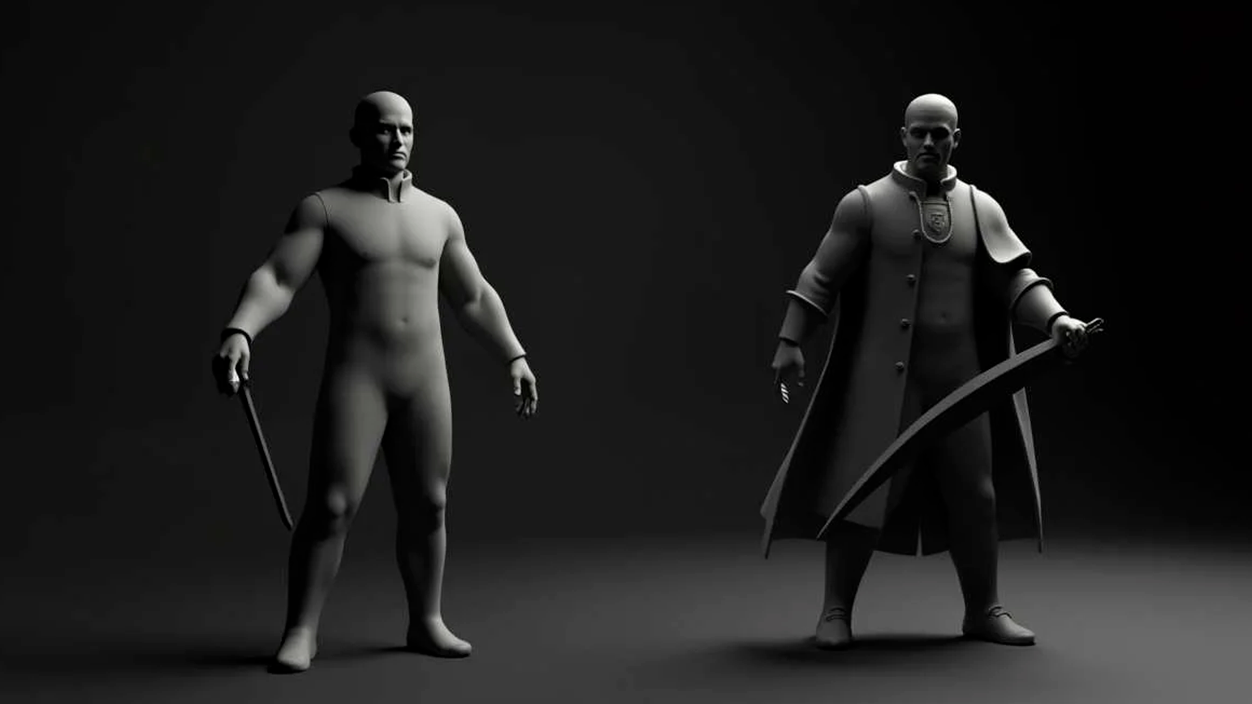

Ang SAM 3D ay binubuo ng dalawang open-source na mga modelo na may natatanging mga function: Mga SAM 3D na Bagaynakatutok sa muling pagtatayo ng mga bagay at eksena, at SAM 3D Body, na nakatuon sa pagtatantya ng hugis at katawan ng tao. Ang paghihiwalay na ito ay nagbibigay-daan sa system na maiangkop sa ibang-iba na mga kaso ng paggamit, mula sa mga katalogo ng produkto hanggang sa mga aplikasyon sa kalusugan o sports.

Ayon sa Meta, ang SAM 3D Objects ay nagmamarka ng a Bagong benchmark ng performance sa AI-guided 3D reconstructionmadaling lampasan ang mga naunang pamamaraan sa mga pangunahing sukatan ng kalidad. Upang mas mahigpit na suriin ang mga resulta, nakipagtulungan ang kumpanya sa mga artist upang lumikha ng SAM 3D Artist Objects, isang dataset na partikular na idinisenyo upang masuri ang katapatan at detalye ng mga muling pagtatayo sa iba't ibang uri ng mga larawan at bagay.

Ang advance na ito ay nagbubukas ng pinto sa mga praktikal na aplikasyon sa mga lugar tulad ng robotics, science, sports medicine, o digital creativityHalimbawa, sa robotics makakatulong ito sa mga system na mas maunawaan ang dami ng mga bagay na nakikipag-ugnayan sa kanila; sa medikal o sports research, makakatulong ito sa pagsusuri ng postura at paggalaw ng katawan; at sa malikhaing disenyo, nagsisilbi itong batayan para sa pagbuo ng mga 3D na modelo para sa animation, video game, o nakaka-engganyong karanasan.

Isa sa mga unang komersyal na application na nakikita na ay ang function "Tingnan sa Kwarto" de Facebook Marketplacena nagbibigay-daan sa iyo upang mailarawan kung ano ang magiging hitsura ng isang piraso ng muwebles o pandekorasyon na bagay sa isang tunay na silid bago ito bilhin. Gamit ang SAM 3D, Hinahangad ng Meta na gawing perpekto ang mga ganitong uri ng karanasan, lubos na nauugnay para sa European e-commerce, kung saan ang mga nagbabalik na produkto dahil sa hindi naabot na mga inaasahan ay kumakatawan sa pagtaas ng gastos.

I-segment ang Anything Playground: isang kapaligiran para sa pag-eksperimento

Upang payagan ang publiko na subukan ang mga kakayahan na ito nang hindi nag-i-install ng anuman, pinagana ng Meta ang I-segment ang Anything PlaygroundIto ay isang web platform na nagbibigay-daan sa iyong mag-upload ng mga larawan o video at mag-eksperimento sa SAM 3 at SAM 3D nang direkta mula sa iyong browser. Ang ideya ay ang sinumang mausisa tungkol sa visual AI ay maaaring tuklasin kung ano ang posible nang walang anumang kaalaman sa programming.

Sa kaso ng SAM 3, pinapayagan ng Playground ang pagse-segment ng mga bagay gamit maikling parirala o detalyadong tagubilinPagsasama-sama ng teksto at, kung ninanais, mga visual na halimbawa. Pinapasimple nito ang mga karaniwang gawain gaya ng pagpili ng mga tao, kotse, hayop, o partikular na elemento ng eksena at paglalapat ng mga partikular na aksyon sa kanila, mula sa mga aesthetic effect hanggang sa pag-blur o pagpapalit ng background.

Kapag nagtatrabaho sa SAM 3D, ginagawang posible ng platform Galugarin ang mga eksena mula sa mga bagong pananawmuling ayusin ang mga bagay, maglapat ng mga three-dimensional na epekto, o bumuo ng mga alternatibong view. Para sa mga nagtatrabaho sa disenyo, advertising, o 3D na nilalaman, nag-aalok ito ng mabilis na paraan upang magprototype ng mga ideya nang hindi kinakailangang gumamit ng mga kumplikadong teknikal na tool mula sa simula.

Kasama rin sa Playground ang isang serye ng mga template na handa nang gamitin Ang mga tampok na ito ay nakatuon sa mga partikular na gawain. Kasama sa mga ito ang mga praktikal na opsyon gaya ng mga pixelating na mukha o license plate para sa privacy, at mga visual effect tulad ng motion trails, selective highlight, o spotlight sa mga lugar ng interes sa video. Ang mga uri ng function na ito ay maaaring maging isang partikular na angkop para sa mga daloy ng trabaho ng digital media at mga tagalikha ng nilalaman sa Spain, kung saan ang paggawa ng mga maiikling video at nilalaman ng social media ay pare-pareho.

Buksan ang mga mapagkukunan para sa mga developer at mananaliksik

Alinsunod sa diskarte na sinundan ng Meta sa iba pang mga paglabas ng AI, nagpasya ang kumpanya na maglabas ng malaking bahagi ng mga teknikal na mapagkukunang nauugnay sa SAM 3 at SAM 3DPara sa una, ang mga timbang ng modelo, isang bagong benchmark na nakatuon sa bukas na pagse-segment ng bokabularyo, at isang teknikal na dokumento na nagdedetalye sa pagbuo nito ay ginawang pampubliko.

Sa kaso ng SAM 3D, available ang mga sumusunod: mga checkpoint ng modelo, inference code, at isang dataset ng pagsusuri susunod na henerasyon. Kasama sa dataset na ito ang maraming iba't ibang larawan at bagay na naglalayong lumampas sa tradisyonal na 3D na mga reference point, na nagbibigay ng higit na pagiging totoo at kumplikado, isang bagay na maaaring maging lubhang kapaki-pakinabang para sa mga European research group na nagtatrabaho sa computer vision at graphics.

Nag-anunsyo rin ang Meta ng mga pakikipagtulungan sa mga platform ng anotasyon tulad ng Roboflow, na may layuning bigyang-daan ang mga developer at kumpanya na Ilagay ang iyong sariling data at ayusin ang SAM 3 sa mga tiyak na pangangailangan. Binubuksan nito ang pinto sa mga solusyong partikular sa sektor, mula sa pang-industriyang inspeksyon hanggang sa pagsusuri sa trapiko sa lungsod, kabilang ang mga proyektong pamana ng kultura kung saan mahalagang i-segment nang tumpak ang mga elemento ng arkitektura o artistikong.

Sa pamamagitan ng pagpili para sa isang medyo bukas na diskarte, ang kumpanya ay naglalayong tiyakin na ang developer ecosystem, unibersidad at mga startup -kabilang ang mga nagpapatakbo sa Spain at sa iba pang bahagi ng Europe- ay maaaring mag-eksperimento sa mga teknolohiyang ito, isama ang mga ito sa sarili nilang mga produkto at, sa huli, mag-ambag ng mga kaso ng paggamit na higit pa sa mga maaaring mabuo ng Meta sa loob.

Sa SAM 3 at SAM 3D, nilalayon ng Meta na pagsamahin ang a mas nababaluktot at naa-access na visual AI platformkung saan ang text-guided segmentation at 3D reconstruction mula sa isang larawan ay hindi na nakalaan para sa mga highly specialized team. Ang potensyal na epekto ay umaabot mula sa pang-araw-araw na pag-edit ng video hanggang sa mga advanced na application sa agham, industriya, at e-commerce, sa isang konteksto kung saan ang kumbinasyon ng wika, computer vision, at pagkamalikhain ay nagiging isang karaniwang tool sa pagtatrabaho at hindi lamang isang teknolohikal na pangako.

Isa akong mahilig sa teknolohiya na ginawang propesyon ang kanyang mga "geek" na interes. Ako ay gumugol ng higit sa 10 taon ng aking buhay sa paggamit ng makabagong teknolohiya at pag-iisip sa lahat ng uri ng mga programa dahil sa purong kuryusidad. Ngayon ay nagdadalubhasa na ako sa teknolohiya ng kompyuter at mga video game. Ito ay dahil sa higit sa 5 taon na ako ay sumusulat para sa iba't ibang mga website sa teknolohiya at mga video game, na lumilikha ng mga artikulo na naglalayong ibigay sa iyo ang impormasyong kailangan mo sa isang wika na naiintindihan ng lahat.

Kung mayroon kang anumang mga katanungan, ang aking kaalaman ay mula sa lahat ng nauugnay sa Windows operating system pati na rin ang Android para sa mga mobile phone. At ang aking pangako ay sa iyo, lagi akong handang gumugol ng ilang minuto at tulungan kang lutasin ang anumang mga katanungan na maaaring mayroon ka sa mundo ng internet na ito.