- Ollama 易于安装,占用资源少,非常适合普通 PC

- LM Studio 提供更多模型种类和高级集成选项

- 选择取决于您优先考虑简单性(Ollama)还是灵活性(LM Studio)

选择的 LM工作室 vs 奥拉马 这是希望运行 大型语言模型(法学硕士) 在普通的计算机上。虽然生成人工智能正在突飞猛进,但仍有大量人对在本地使用这些模型感兴趣,而无需大量的硬件资源,从而节省成本并保持对数据的控制。

因此,在 LM Studio 和 Ollama 之间选择正确的工具,可以带来很大的不同 根据您的个人设备的具体情况,提供性能、易用性和兼容性。 为了帮助您做出正确的选择,我们从最相关的来源汇总了关键信息,并为要求苛刻的用户补充了必要的技术细节,并分享了我们在本地人工智能方面的专业知识。

什么是 LM Studio 和 Ollama?

这两个应用程序的设计目的都是 在本地运行语言模型 无需依赖外部云服务,即可在您的计算机上完成。此功能对于保护隐私、节省成本以及尝试自定义模板和工作流程至关重要。

- 奥拉马 它因提供非常简单的安装过程而脱颖而出,其中包含快速开始使用 LLM 模型所需的一切,无需复杂的配置。

- LM工作室 它在模型管理方面更先进一些,具有更直观的界面以及下载或选择模型时更广泛的选项。

易于安装和配置

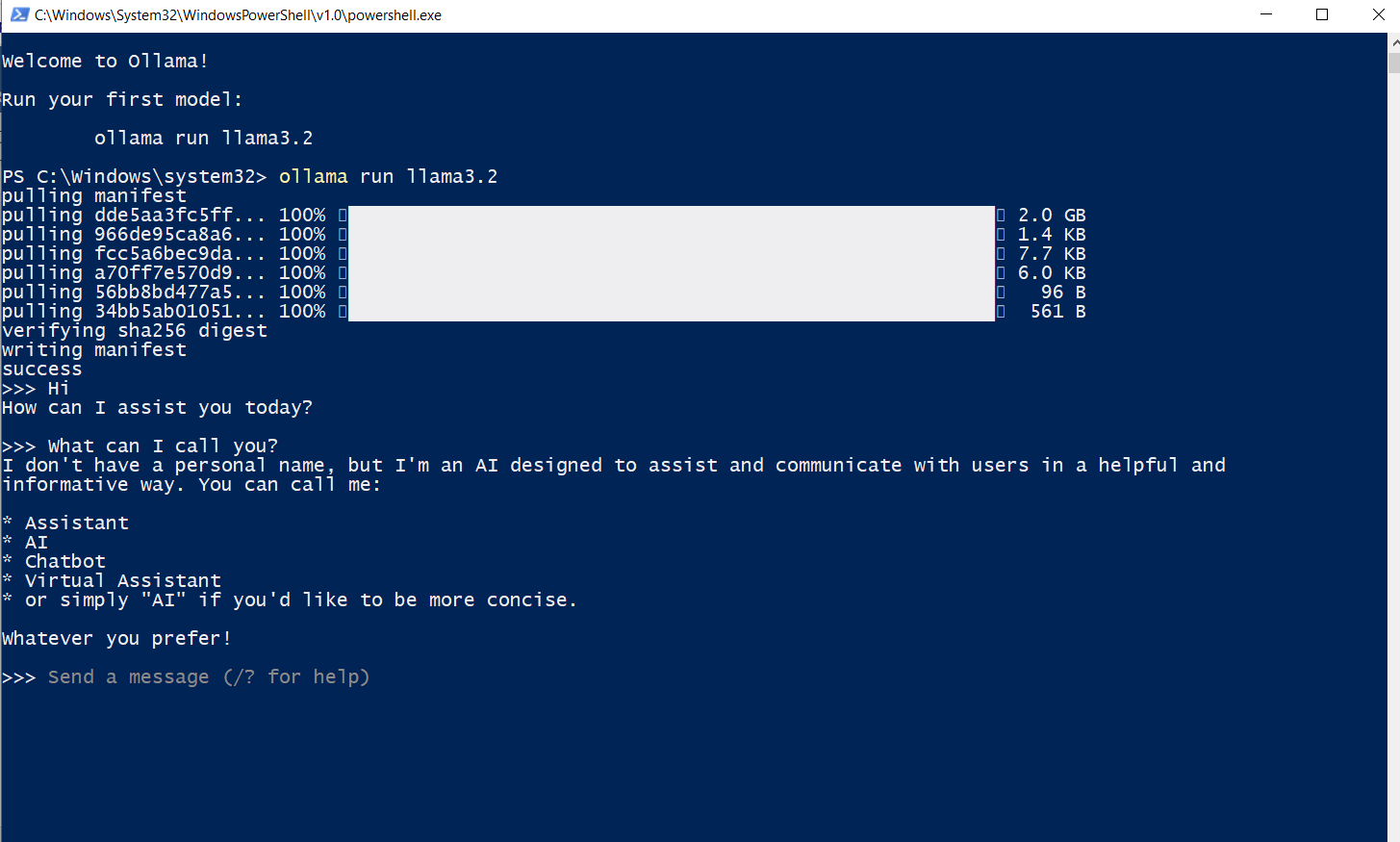

对于电脑配置一般的用户来说,简单的设置至关重要。这里, Ollama 的特点是其直接安装程序就像安装任何其他常规软件一样。这使得没有技术经验的人更容易使用。此外, Ollama 包含预集成模型,允许立即进行测试。

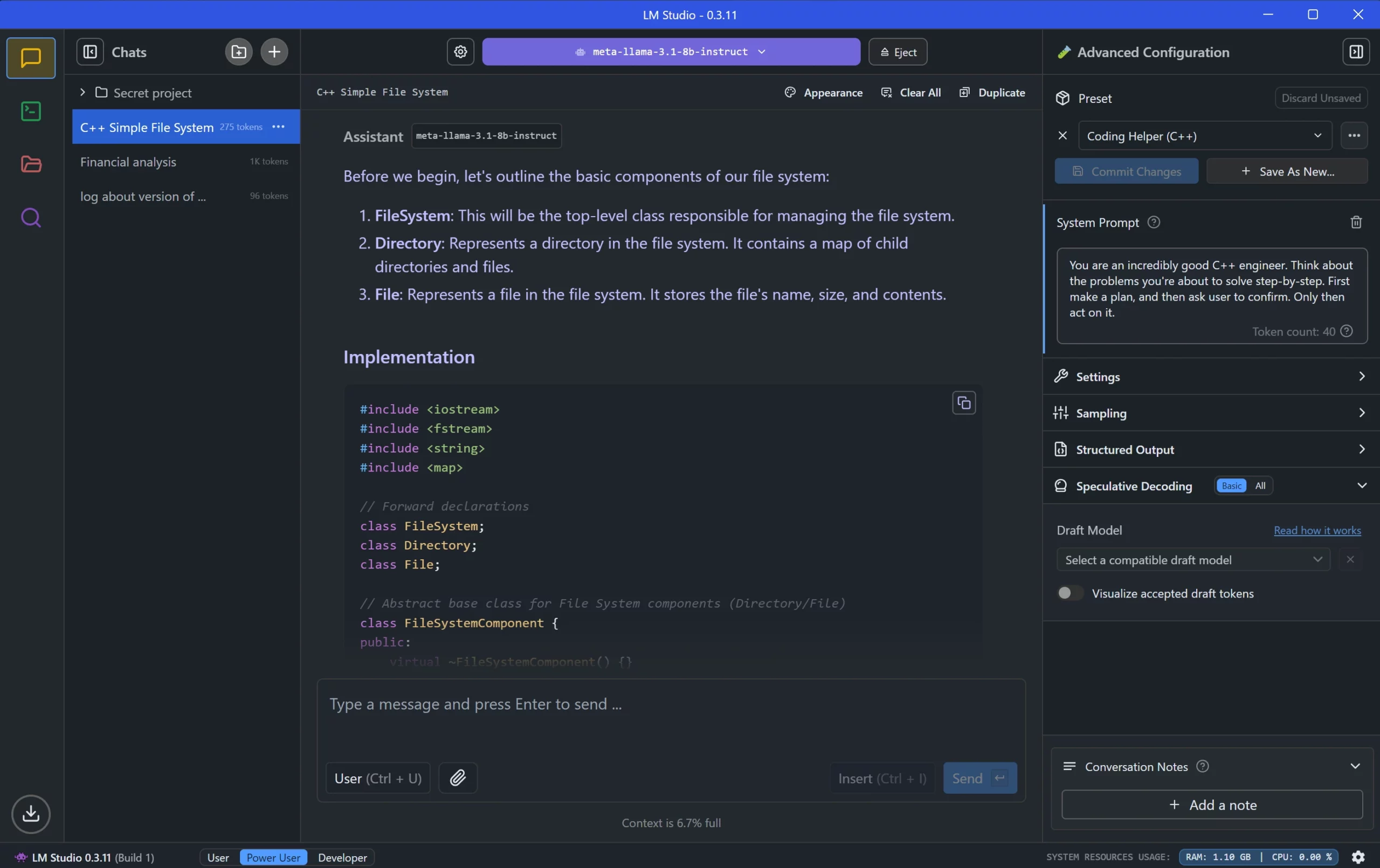

就其本身而言, LM Studio 还提供简单的设置尽管它的环境更高级一些。它允许你探索一些功能,例如从 Hugging Face 运行模型或集成为本地 OpenAI 服务器,这可能需要一些额外的配置,但扩展了它的可能性。

普通电脑上的性能和资源消耗

在绩效有限的团队中,每一份资源都至关重要。Ollama 在这方面成功将自己定位为一个高效的选择,其 资源消耗极低,非常适合较旧的设备或硬件有限的设备。

然而, LM Studio 紧随其后开发人员已优化其性能,使其无需极高的配置即可在本地运行模型,不过,根据模型的不同,可能需要更多内存。它还提供限制上下文大小或线程使用量的工具,让您能够根据计算机的性能进行性能微调。

用途多样、灵活

Ollama 因其在本地和云模型之间切换的能力而脱颖而出为想要测试不同场景的用户提供更大的灵活性。此功能对于追求模型管理速度和多样性的开发人员和用户都非常有用。

相反, LM Studio 专注于本地下载和运行模型。这使得它非常适合那些希望在自己的计算机上托管所有流程或通过将本地服务器与 OpenAI API 集成来创建自定义解决方案的用户。由于支持从 Hugging Face 存储库导入,其模型目录也得到了扩展,方便访问多个版本和选项。

用户界面和用户体验

La LM Studio 界面专为中级和高级用户设计,拥有赏心悦目的直观视觉设计。其集成的聊天功能可轻松与模型进行交互,模型下载透明且可自定义,让实验变得轻松便捷。

相反, Ollama 选择了一个非常简单的界面它的菜单和选项简洁,帮助用户避免繁琐的操作,专注于核心功能:轻松与 LLM 模型交互。虽然深度定制功能有所限制,但对于追求快速结果的用户来说,它仍具有优势。

可用模型和来源的目录

如果你想 兼容型号多样LM Studio 因其与 拥抱脸它提供了一个庞大的预训练模型库,涵盖了从类似 GPT 到专门用于特定任务的模型。这使得它成为一个非常灵活的选择,可用于尝试不同的架构。

此外, Ollama 提供针对您的平台优化的精选模型虽然品种有限,但质量和性能非常好,响应时间快,精度有竞争力。

集成、端点和连接

本地法学硕士模型的一个重要方面是能够 通过端点与其他服务交互端点是发送请求以获取模型响应的地址,方便与外部应用程序或 AI 代理的集成。

En 奥拉马,默认本地端点通常在 http://127.0.0.1:11434只要 Ollama 正在运行,它就可以轻松连接到其他工具(例如 AnythingLLM)。此功能对于团队合作或自动响应非常有用。

LM工作室 它还可以充当与 OpenAI API 兼容的服务器,允许跨不同项目进行更高级和定制的集成。

许多用户希望定义 自定义环境 或者将不同的模型分配给不同的任务。主要区别在于:

- 奥拉马 提供非常简单和快速的体验,具有较低级别的高级定制。

- LM工作室 允许您创建多个工作区并为每个工作区分配特定的模型,使其适合 多学科团队 或具有不同需求的项目。

支持适度硬件

通过使用这些工具 资源有限的 PC,优化性能并减少资源使用至关重要。Ollama 因其 低功耗且在旧硬件上具有良好的性能LM Studio虽然功能更全面,但也提供了调整参数和避免过载的选项,可以很好地适应功能有限的计算机。

最后,我们必须注意 技术支持和用户社区这对于故障排除至关重要。Ollama 拥有官方资源和活跃的社区,并在 Reddit 等论坛上提供解决方案。LM Studio 拥有一个技术社区,分享针对不同型号和配置的技巧和解决方案。

对于普通 PC,该选择哪一款?

那么,在 LM Studio 与 Ollama 的困境中,哪个才是最佳选择?如果你正在寻找 易于使用、低功耗、快速设置Ollama 是最推荐的选项。它允许你轻松测试 LLM 模型并立即获得结果。但是,如果你需要 更多模型、更大的灵活性和集成可能性,LM Studio将为您提供更完整的定制和扩展环境。

选择取决于您的具体需求: 奥拉马 对于那些希望它能够顺利运行的人来说, LM工作室 对于那些想要深入探索和定制语言模型的人来说,理想情况下,你应该在团队中尝试这两种方法,以确定哪种方法最适合你的需求和偏好,并在每个项目中充分利用每种方法的优势。

专门研究技术和互联网问题的编辑,在不同数字媒体领域拥有十多年的经验。我曾在电子商务、通讯、在线营销和广告公司担任编辑和内容创作者。我还在经济、金融和其他领域的网站上撰写过文章。我的工作也是我的热情所在。现在,通过我的文章 Tecnobits,我尝试探索技术世界每天为我们提供的所有新闻和新机会,以改善我们的生活。