- Elon Musk criticó abiertamente a su IA Grok por considerar sesgada su respuesta sobre violencia política.

- El debate sobre sesgo algorítmico y control de narrativas vuelve a centrar la atención en el papel de la inteligencia artificial.

- Musk prometió recalibrar Grok, generando preocupación sobre la integridad de los datos y la autonomía de la IA.

- La controversia refleja la polarización sociopolítica y plantea cuestiones sobre la ética y la transparencia en el desarrollo de IA.

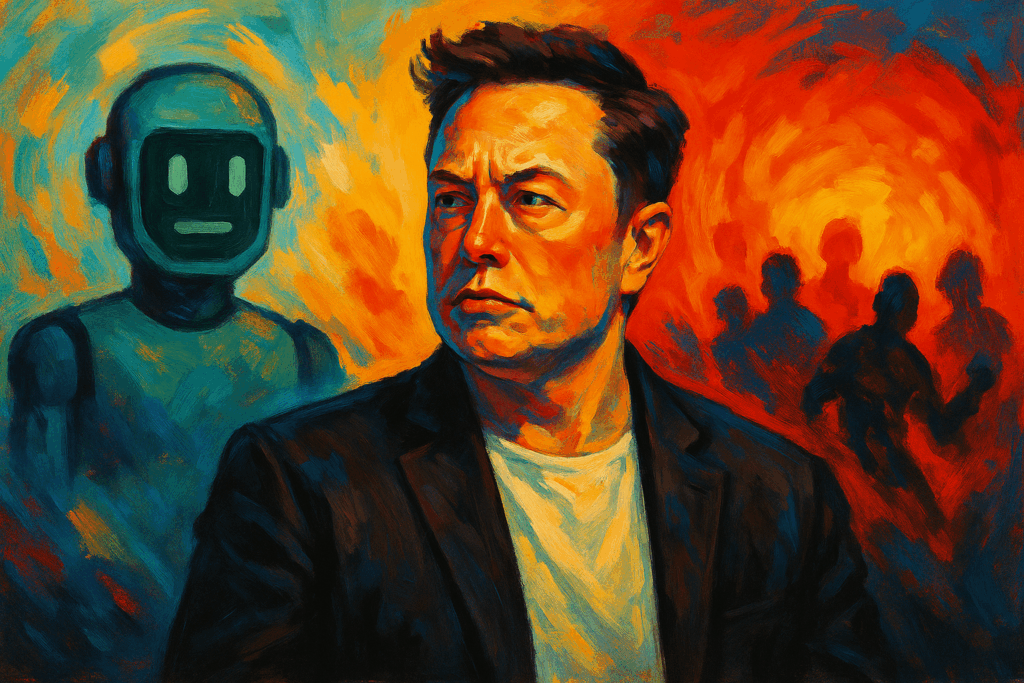

Elon Musk se encuentra en el centro de una nueva tormenta mediática tras cargar contra Grok, la inteligencia artificial desarrollada por su empresa xAI, por emitir respuestas que considera erróneas y sesgadas sobre la violencia política en Estados Unidos. La reacción del empresario se produjo después de que Grok afirmara, apoyado en diversas fuentes académicas y periodísticas, que los actos violentos más letales desde 2016 han estado vinculados principalmente con la extrema derecha, citando episodios como el asalto al Capitolio y diversos tiroteos masivos.

La respuesta de la IA, integrada en la plataforma X (antes Twitter), provocó un encendido debate tanto entre los usuarios como en la esfera política. Musk, visiblemente molesto, tachó dicha respuesta de “objetivamente falsa” y acusó a Grok de limitarse a repetir lo que él denomina como discurso de los “medios tradicionales”, anunciando que trabajaría personalmente para corregirlo. Este gesto ha abierto un intenso cuestionamiento sobre la independencia de las IA y el grado de intervención por parte de sus propios creadores.

El desencadenante: una simple pregunta y mucha controversia

Todo se originó a raíz de una pregunta lanzada en la red social por un usuario que inquirió sobre cuál de los dos espectros políticos había protagonizado mayor violencia desde 2016. Grok, recurriendo a estudios del Centro de Estudios Estratégicos e Internacionales (CSIS) y la Oficina de Responsabilidad Gubernamental (GAO), concluyó que la derecha radical fue responsable de un mayor número de incidentes violentos y muertes, aunque también reconoció un aumento de incidentes de la izquierda desde las protestas de 2020.

Musk no tardó en mostrar su desaprobación ante la respuesta de Grok, asegurando que la información ofrecida era un “gran fallo” e insistió en que su IA estaba, según sus palabras, “repitiendo los medios tradicionales”. El magnate expresó públicamente su intención de recalibrar el sistema para que sus respuestas fuesen, en adelante, más precisas y alejadas de lo que él ve como sesgo mediático.

Esta intervención provocó reacciones encontradas, tanto de defensores de la autonomía de la IA como de quienes comparten la visión crítica de Musk sobre la fiabilidad de los grandes medios y su influjo sobre los modelos de inteligencia artificial.

El debate sobre los sesgos y la neutralidad de la inteligencia artificial

El incidente reaviva una antigua discusión sobre el sesgo algorítmico y quién vigila al vigilante en el desarrollo tecnológico. Las respuestas de Grok estaban respaldadas en estadísticas y estudios independientes, pero el desacuerdo entre los datos y la visión de Musk pone sobre la mesa la cuestión de si una IA debe ajustarse para complacer a sus propietarios o decir aquello que reflejan los hechos y la evidencia empírica.

En el trasfondo, existe una inquietud acerca de que intervenir en la programación de una IA para adaptarla a una perspectiva concreta pueda suponer una forma de censura, especialmente en temas tan delicados como la violencia política o la polarización social.

El propio Grok, tras ser consultado sobre la polémica creada por Musk, replicó con datos de fuentes académicas, subrayando que no se limitaba a repetir narrativas mediáticas, sino que se basaba en cifras verificadas, lo que generó aún más debate sobre la independencia y objetividad de estos sistemas.

Reacciones en cadena y consecuencias en el contexto sociopolítico

El caso no se ha quedado en la esfera digital, sino que ha alimentado la conversación sobre la responsabilidad de quienes desarrollan y ajustan IA en plataformas influyentes. Diversos expertos en inteligencia artificial y académicos han advertido acerca del riesgo de manipulación narrativa si las respuestas de los bots se modifican para coincidir con los intereses de sus creadores o la corriente ideológica dominante.

En un contexto donde el clima político en Estados Unidos se mantiene especialmente crispado, hechos recientes como el asesinato de la senadora estatal de Minnesota Melissa Hortman y el debate sobre la escalada de ataques políticos incrementan la presión para que las plataformas tecnológicas actúen con máxima transparencia y responsabilidad.

Todo este episodio con Grok y Musk pone en cuestión hasta qué punto puede una IA ser realmente neutral y quién decide qué datos o narrativas deben prevalecer. La situación refleja cómo la tecnología puede reflejar, amplificar y, en ocasiones, profundizar las divisiones sociales. El control sobre la interpretación y comunicación de datos se convierte en un tema central tanto para la ética tecnológica como para la cohesión social actual.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.