- Anonimizar documentos antes de usar IA protege datos personales, propiedad intelectual y ventaja competitiva, alineando el uso de modelos con RGPD y futura AI Act.

- La anonimización eficaz va mucho más allá de borrar nombres: exige tratar identificadores directos e indirectos, evitar falsas “tachaduras” y diferenciar bien entre seudonimización y anonimización real.

- Las soluciones basadas en IA combinan detección automática de PII, técnicas avanzadas de enmascaramiento y revisión humana, reduciendo hasta un 80 % el tiempo dedicado a limpiar contratos, expedientes y grandes volúmenes documentales.

- Etiquetar el contenido generado por IA y establecer políticas claras de uso, bloqueo de rastreadores y formación interna permite aprovechar la IA con transparencia y minimizar riesgos legales y reputacionales.

Subir un contrato, un informe médico o un briefing comercial a ChatGPT sin retocar nada o simplemente copiar y pegar documentos en un chatbot se ha vuelto tan habitual que a veces ni nos paramos a pensar qué implica. La IA nos ahorra horas de trabajo, pero cada vez que volcamos documentos reales en un modelo, estamos enseñándole trocitos de nuestra estrategia, de nuestros clientes y, en muchos casos, de nuestra vida privada. Por eso, en un contexto de RGPD, LOPDGDD y futura AI Act europea, anonimizar documentos se ha vuelto un asunto muy serio.

Es importante hacer esto con nuestros documentos antes de pasarlos a una IA. No es una manía de “paranoicos de la privacidad”, es una necesidad de negocio, de cumplimiento legal y de pura supervivencia competitiva. Muchísimos profesionales copian y pegan acuerdos, listados de clientes, historiales de compras o expedientes jurídicos en herramientas de IA generativa como si nada. Luego nos sorprende que se hable tanto de filtraciones, entrenamiento con datos de terceros y pérdida de control sobre la información.

Por qué es crítico anonimizar documentos antes de usar IA

Las grandes plataformas de IA (OpenAI, Google, Anthropic, etc.) insisten en que no usan tus datos para entrenar modelos en ciertos planes, pero eso no significa que no exista riesgo. Aunque el proveedor prometa no almacenar tu información, el mero hecho de subir documentos con datos personales o know-how interno es ya un tratamiento de datos que debe cumplir el RGPD y puede exponer tu ventaja competitiva si no se gestiona bien.

En entornos B2B y jurídicos el problema es todavía más sensible: contratos, actas, demandas, dictámenes, pólizas, documentos internos de RR. HH., historiales de cliente… todo eso incluye nombres, DNIs, direcciones, emails, teléfonos, condiciones económicas y estrategias comerciales. Si se suben tal cual a una IA pública o a un modelo en la nube sin garantías, se abren dos frentes: posible incumplimiento normativo y fuga de información crítica.

Anonimizar bien permite trabajar con IA sin exponer datos reales. Sigues aprovechando la estructura de tus documentos, tu forma de negociar, tus plantillas de contratos o tus flujos de atención al cliente, pero “desconectas” esos textos de personas identificables y de detalles que revelan tu estrategia. Es la diferencia entre entrenar un GPT interno para ventas B2B con tus modelos de propuestas y subir el PDF íntegro con nombres de clientes, tarifas concretas y condiciones especiales.

Además, la anonimización adecuada encaja de lleno con el RGPD y la futura AI Act. El RGPD deja claro que los datos correctamente anonimizados dejan de ser datos personales; salen del ámbito de aplicación del reglamento. La AI Act, por su parte, empuja a que los sistemas de IA utilicen técnicas de minimización y anonimización de datos. No se trata solo de “no meter la pata”, sino de demostrar diligencia proactiva ante clientes, autoridades y socios.

Errores habituales al anonimizar documentos (y por qué no bastan los “XXX”)

Uno de los fallos más frecuentes es pensar que anonimizar equivale a borrar nombres y ya. Reemplazar “Juan Pérez” por “XXX” o por “” es un paso, pero si dejas en el texto frases como “el gerente de la sucursal de Sevilla que firmó el acuerdo con Iberdrola en marzo de 2023” cualquiera con contexto (y desde luego un modelo potente) puede deducir de quién se trata.

El problema no son solo los identificadores directos (nombre, DNI, email), sino el conjunto de elementos que, combinados, permiten reidentificar: cargo, ubicación, fechas concretas, clientes emblemáticos, proyectos muy singulares, referencias a familiares (“hermano del alcalde”), etc. Anonimizar exige revisar el contexto completo, no limitarse a pasar un buscar-reemplazar sobre nombres propios.

Otro error es esconder solo los datos personales y dejar al descubierto la estrategia de negocio. Muchas empresas ocultan nombres de clientes, pero mantienen visibles modelos de facturación, descuentos especiales, cláusulas de éxito o estructura de precios. Desde el punto de vista de privacidad quizá se cumple, pero desde la óptica de propiedad intelectual y ventaja competitiva, estás regalando oro.

También es frecuente confundir “tachar visualmente” con anonimizar. Poner un recuadro negro sobre un párrafo en un PDF, si no se elimina realmente el texto subyacente, es una falsa anonimización: a menudo basta con copiar y pegar para ver la información original. Este tipo de chapuzas se ha visto demasiadas veces en documentos públicos y puede suponer una exposición gravísima de datos personales o estratégicos.

Por último, muchas organizaciones se quedan en la seudonimización pensando que es suficiente: cambian nombres por códigos, pero conservan en otra tabla la clave que los vincula. Legalmente, eso sigue siendo un tratamiento de datos personales. Si quieres que el documento quede fuera del RGPD y se pueda compartir sin restricciones, la anonimización tiene que ser irreversible según el estándar del Considerando 26 del reglamento (no reidentificable con medios razonables).

Impacto en negocio, cumplimiento y gestión del riesgo

Cuando se anonimiza de forma sistemática con apoyo de IA, los beneficios se notan en varias capas. Por un lado, se gana una velocidad enorme: puedes preparar lotes enteros de documentación para formación, due diligence, auditorías internas, proyectos de datos o colaboración con terceros sin bloquear al equipo jurídico durante semanas.

Por otro lado, baja drásticamente la tasa de errores humanos. La IA no se cansa en la página 42, no se salta un nombre en una nota al pie ni olvida que en el anexo VII había un listado de teléfonos. Si el modelo está bien afinado, detecta patrones, formatos de NIF, direcciones postales, correos electrónicos, referencias cruzadas… y lo hace igual de bien en el primer documento que en el número 300.

Todo esto tiene un impacto directo en el riesgo regulatorio y reputacional. La Agencia Española de Protección de Datos impone cada año cientos de sanciones por tratamientos indebidos; muchas se derivan de malas prácticas en gestión documental, filtraciones o anonimización deficiente. Un proceso robusto de anonimización aporta una capa extra de seguridad y prueba de diligencia si algún día tienes que justificar ante un regulador qué hiciste para proteger la información.

Además, la automatización abre la puerta a responder mejor a derechos de los interesados bajo el RGPD (acceso, supresión, limitación del tratamiento…). Cuando alguien pide acceso a su expediente, a menudo hay que revisar mucha documentación donde también aparecen terceros. Si cuentas con una herramienta capaz de anonimizar de forma rápida y fiable, los plazos se cumplen más fácilmente y con menos estrés para los equipos implicados.

Por último, desde el punto de vista corporativo, la anonimización bien montada libera datos para innovación. Puedes entrenar modelos internos, hacer analítica avanzada, probar copilotos de ventas o de compliance, compartir casos con partners tecnológicos… todo ello usando documentos ricos en contexto pero neutros en términos de identificación personal o estratégica.

Tecnologías y técnicas clave para anonimizar con IA

Debajo de estas soluciones hay dos grandes piezas: modelos de lenguaje potentes y técnicas específicas de privacidad. Los LLM (Large Language Models) tipo GPT-4, Llama 2 o modelos legales especializados son los que entienden el lenguaje natural, detectan entidades y sostienen textos coherentes después de borrar trozos. Encima de ellos se montan capas de reglas, reconocimiento de entidades (NER) y motores de enmascaramiento.

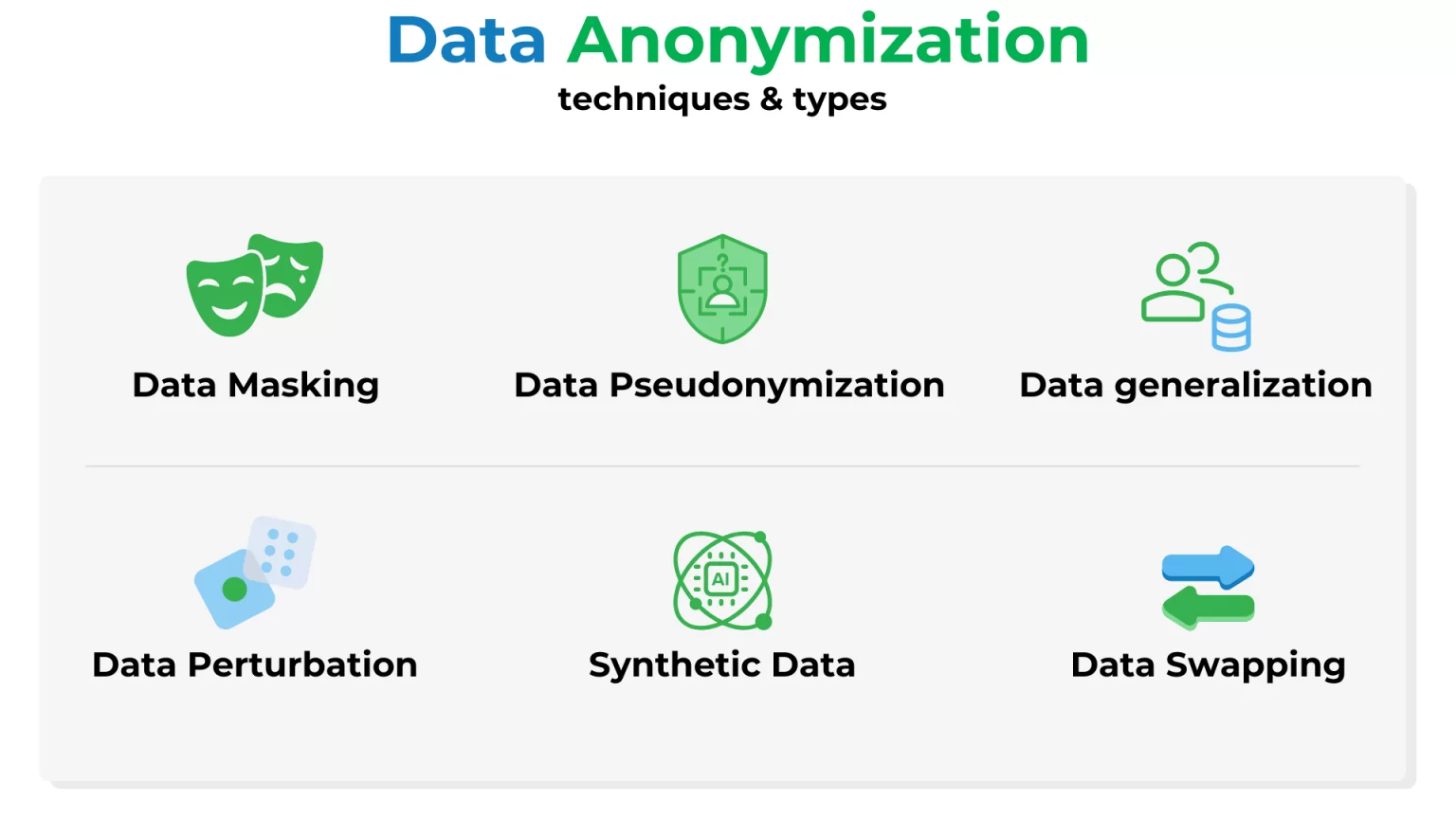

En la práctica, la anonimización se apoya en varias técnicas complementarias:

- Enmascaramiento de datos: reemplazar información sensible por valores ficticios pero consistentes (por ejemplo, cambiar DNIs por otros con el mismo formato, o sustituir un nombre por un código).

- Pseudonimización: sustituir identificadores directos por pseudónimos o códigos, manteniendo una tabla de equivalencias aparte (útil cuando necesitas volver a reidentificar dentro de la organización).

- Generación de datos sintéticos: crear conjuntos de datos artificiales que conservan las propiedades estadísticas del original, pero sin contener registros reales.

- Privacidad diferencial: añadir ruido matemático a los datos o a los resultados para impedir la identificación individual preservando patrones generales.

- Generalización y supresión: reducir el nivel de detalle (edad exacta → rango de edad, dirección concreta → ciudad) o eliminar por completo ciertos atributos de alto riesgo.

Junto a estas técnicas, hay un pequeño “zoo” de herramientas profesionales de anonimización. Algunas están muy orientadas a data warehouses y entornos de Big Data (K2view, Privitar, ARX, Anonos, IBM InfoSphere Optim), otras se centran en documentación jurídica y textual (Nymiz, Vincent AI, soluciones tipo Maite o Legora, etc.). En todos los casos, la clave está en combinar automatización con reglas de negocio propias y revisión humana.

En el terreno del texto jurídico, lo que mejor funciona hoy es una arquitectura en dos fases: primero, detección automática de PII (personally identifiable information) mediante modelos NER y patrones; segundo, reescritura o enmascaramiento controlado con un LLM que respete la estructura original. Presidio de Microsoft es un ejemplo de componente de detección ampliamente usado, que muchas soluciones integran para identificar nombres, direcciones, identificadores, tarjetas, etc.

Todo esto solo tiene sentido si se despliega en un entorno técnicamente seguro. Muchos despachos y empresas optan por nubes privadas o instancias dedicadas (por ejemplo, Azure OpenAI con garantías contractuales de no reutilización de datos) o incluso por modelos on-premises basados en LLMs open source (Llama 2, Mistral, etc.). La idea es que los documentos no salgan del perímetro controlado de la organización y no se mezclen con datos de otros clientes.

Marco jurídico: RGPD, seudonimización, anonimización y AI Act

Legalmente, el uso de IA para anonimizar tiene dos grandes frentes: cómo tratas los datos durante el proceso y qué pasa con el resultado. Mientras subes documentos con datos personales a una plataforma de IA, estás realizando un tratamiento regulado por el RGPD. Eso implica analizar si el proveedor actúa como encargado de tratamiento, firmar las cláusulas contractuales adecuadas y verificar dónde se alojan los datos (transferencias internacionales, subencargados, etc.).

Muchas voces en el sector legal insisten en no introducir datos protegidos en herramientas de consumo general mientras no haya garantías claras. Algunos colegios profesionales recomiendan usar solo soluciones específicas para el ámbito jurídico, con acuerdos de tratamiento, logs, control de acceso y, cuando sea posible, despliegues locales o en nubes europeas.

Respecto al resultado, la gran distinción es entre seudonimización y anonimización. El RGPD define la seudonimización como un tratamiento reversible si dispones de la información adicional (tabla de códigos, claves). Es una buena medida de seguridad, pero los datos siguen siendo personales. La anonimización, en cambio, rompe el vínculo de manera irreversible: si se ejecuta bien, el documento ya no se considera dato personal y sale del ámbito del RGPD.

El Considerando 26 RGPD deja claro que la clave está en la reidentificación “con medios razonables”. No basta con que sea un poco difícil; debe ser impracticable sin un esfuerzo desproporcionado. De ahí que la anonimización real no se limite a cambiar nombres, sino a neutralizar combinaciones de datos que, cruzadas con otras fuentes, podrían señalar a una persona concreta.

En paralelo, la Unión Europea está desplegando el Reglamento de IA (AI Act), que no prohíbe usar IA para estas tareas, pero sí exige principios de transparencia, gobernanza de datos y minimización. Curiosamente, muchas de las obligaciones para sistemas de alto riesgo pasan precisamente por diseñarlos de forma que usen datos seudonimizados o anonimizados siempre que sea posible.

La AI Act también entra en el terreno del etiquetado de contenidos generados por IA. En contextos como desinformación, publicidad política, deepfakes o contenidos sintéticos que puedan confundir al público, las organizaciones tendrán que marcar de forma clara que detrás hay una IA. Además, se impulsan estándares técnicos como C2PA (Coalition for Content Provenance and Authenticity) y tecnologías de watermarking tipo SynthID para imágenes y vídeos.

Etiquetado de contenido generado por IA: qué marcar y por qué

La tendencia regulatoria es clara: los usuarios deben saber cuándo están ante contenido generado o manipulado por IA. La AI Act, junto con el Digital Services Act (DSA), impulsa obligaciones para plataformas y grandes servicios en línea, pero también va calando como buena práctica para empresas y profesionales que usan IA en su día a día.

En la práctica, conviene etiquetar siempre que un contenido relevante se haya creado total o parcialmente con IA, sobre todo si puede influir en decisiones de terceros (informes, materiales formativos, piezas de marketing, contenidos audiovisuales, etc.). No se habla de corregir una tilde con Grammarly, pero sí de informes enteros, creatividades o vídeos generados a partir de prompts.

Para texto, la forma más sencilla es indicar en algún punto del documento algo tipo “contenido generado con ayuda de IA”. En imágenes y vídeos, lo ideal es combinar esa mención visible (por ejemplo, en la descripción de una publicación en redes) con metadatos técnicos incrustados mediante estándares como C2PA o las Content Credentials de Adobe.

La razón no es solo cumplir con Bruselas: también es una cuestión de confianza. Clientes, alumnos, lectores o usuarios tienen derecho a saber cuál es el grado de intervención humana. Y para las empresas, ser transparentes reduce el riesgo reputacional si en algún momento se cuestiona el origen de un contenido o se producirse un uso malicioso de deepfakes.

Las sanciones por incumplir estos requerimientos pueden ser importantes para grandes plataformas, pero incluso para organizaciones más pequeñas es fácil terminar con contenido bloqueado, campañas retiradas o advertencias regulatorias si se considera que se está engañando al usuario sobre la naturaleza del material.

Cómo proteger tus datos frente a la “IA que rastrea” la red

Más allá de lo que tú subes voluntariamente a una IA, existe el problema del rastreo masivo de contenido público. Muchos modelos se entrenan con grandes cantidades de texto e imágenes obtenidas mediante crawlers. Si tienes una web, un blog o un portfolio visual, es bastante probable que parte de tu material ya esté en datasets de entrenamiento de algún modelo generativo.

Para limitar esto, han surgido mecanismos de exclusión específicos para bots de IA. Igual que se hace con Googlebot en el archivo robots.txt, puedes bloquear agentes como GPTBot (OpenAI), Google-Extended (Gemini y Vertex AI), CCBot, Anthropic-ia, Cohere-ai, etc. Esto no borra lo ya entrenado, pero puede frenar futuros usos.

Otra línea de defensa es la configuración de privacidad en servicios que ya usas. Adobe, Google, OpenAI, Anthropic y otros ofrecen opciones de exclusión para que tus interacciones o archivos no se utilicen en el entrenamiento de nuevos modelos. No siempre están activadas por defecto, así que conviene revisar bien cada panel de control.

En el mundo de la imagen y el audio, empiezan a proliferar herramientas para comprobar si tus obras han sido usadas en datasets. Servicios como “Have I Been Trained?” permiten buscar tu trabajo visual en colecciones de entrenamiento conocidas y, en algunos casos, solicitar exclusión. No es perfecto, pero pone algo de control en manos de los creadores.

Para empresas, todo esto debería integrarse en una política de IA responsable: qué se comparte con qué proveedores, qué se bloquea vía robots.txt y firewalls, qué canales están autorizados para subir documentación sensible, qué cuentas de IA se usan (Free, Plus, Teams, Enterprise) y bajo qué condiciones. La formación a empleados en este punto es clave; de nada sirve una política impecable si el comercial de turno sigue subiendo listados de clientes al primer chatbot que pilla.

Estrategias prácticas para anonimizar documentos con IA sin perder utilidad

Cuando trabajas con modelos generalistas tipo ChatGPT, Gemini o Claude, el truco está en “enseñarles” exactamente qué esperas. Un buen prompt puede marcar la diferencia entre una anonimización chapucera y un documento verdaderamente limpio y aprovechable.

- Definir el alcance con claridad: pedir algo como “anonimiza este documento” es demasiado vago. Tiene mucho más sentido algo así (adaptado a tu caso): indicar que se eliminen o sustituyan todos los datos personales de personas físicas (nombres, apellidos, DNIs, direcciones, correos, teléfonos, matrículas, fechas de nacimiento, etc.), que se sustituyan por etiquetas entre corchetes y que se mantenga todo lo demás sin modificación.

- Aportar contexto jurídico o de negocio: aclarar que se trata de un contrato laboral español, una sentencia penal, un dictamen civil, un acuerdo de confidencialidad, un expediente médico, etc. e incluso mencionar normas de referencia (“cumpliendo definiciones del art. 4 RGPD”) hace que el modelo se tome la tarea con un sesgo más riguroso.

- Dividir la tarea en pasos. Puedes pedir primero que el modelo liste todos los datos personales que detecta, con una pequeña explicación de por qué los considera sensibles. Una vez validada esa lista, se le pide la versión anonimizada final. Esta doble pasada aumenta mucho la fiabilidad y, de paso, te sirve de checklist de revisión.

- Fijar el formato de salida. Conviene decirle explícitamente que devuelva el texto íntegro respetando párrafos, encabezados, viñetas y numeraciones, y que solo cambie lo estrictamente necesario. Cuanto más “editor” y menos “escritor creativo” se comporte, menos riesgo habrá de que se invente contenidos o modifique el sentido jurídico del documento.

Por último, por muy buena que sea la IA, el cierre siempre debería hacerlo un humano. Una revisión rápida buscando patrones típicos (DNIs, correos, números de teléfono, nombres propios, códigos postales, etc.), comprobando que no queden datos en metadatos del archivo y asegurando que las etiquetas usadas no dan pistas indebidas, es parte irrenunciable del proceso. De cara a auditorías, además, es muy útil documentar el flujo (herramienta usada, reglas aplicadas, fecha de anonimización).

La combinación de anonimización técnica, buenas prácticas organizativas y respeto a las nuevas reglas de transparencia en contenidos generados por IA marca la diferencia entre usar la inteligencia artificial como un atajo peligroso o como un aliado estratégico sólido, tanto para cumplir la ley como para proteger lo que hace única a cada empresa: su información, su experiencia y su manera de trabajar.

Redactor especializado en temas de tecnología e internet con más de diez años de experiencia en diferentes medios digitales. He trabajado como editor y creador de contenidos para empresas de comercio electrónico, comunicación, marketing online y publicidad. También he escrito en webs de economía, finanzas y otros sectores. Mi trabajo es también mi pasión. Ahora, a través de mis artículos en Tecnobits, intento explorar todas las novedades y nuevas oportunidades que el mundo de la tecnología nos ofrece día a día para mejorar nuestras vidas.