- Gemini estrena funciones agénticas en Android para controlar apps y automatizar tareas de varios pasos.

- Las primeras pruebas llegan en beta a Samsung Galaxy S26 y Google Pixel 10, inicialmente en EE. UU. y Corea del Sur.

- Android 16 y 17 incorporan AppFunctions y un marco de automatización de interfaz para conectar Gemini con aplicaciones.

- Gemini también impulsa seguridad con detección de estafas telefónicas y mejora búsquedas visuales como "Busca con un círculo".

La integración de Gemini en Android acaba de subir varios peldaños con la llegada de funciones capaces de manejar aplicaciones y completar tareas complejas sin que el usuario tenga que estar pendiente de cada paso. Lo que hasta ahora era un asistente conversacional se está convirtiendo poco a poco en un agente que actúa dentro del móvil, con especial protagonismo en los últimos buques insignia de Samsung y Google.

Aunque por ahora el despliegue se centra en Estados Unidos y Corea del Sur, y en una fase de pruebas limitada, lo que está perfilando Google anticipa cambios profundos en la forma de usar un smartphone Android: desde pedir un taxi o hacer la compra hasta navegar por diferentes apps, todo gestionado en segundo plano por la IA, con un fuerte foco en privacidad, seguridad y control del usuario.

Gemini como agente: control directo de tus apps en Android

Google ha confirmado que Gemini empezará a incorporar capacidades agénticas, es decir, funciones que le permiten tomar el mando de aplicaciones instaladas en el móvil para ejecutar encargos que antes exigían varias interacciones manuales. En la práctica, esto significa que el usuario podrá formular una sola petición por voz o texto y dejar que la IA se ocupe del resto.

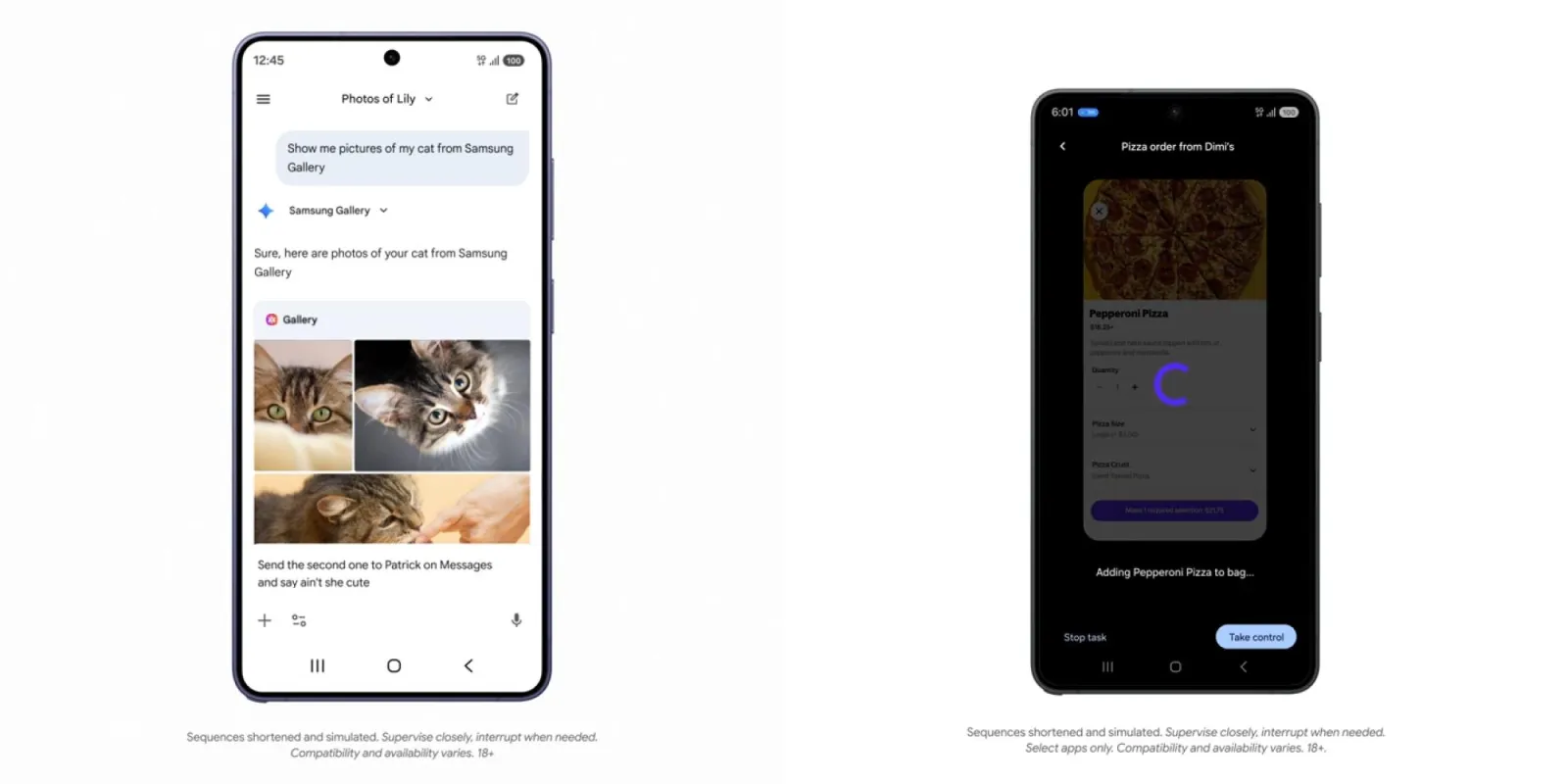

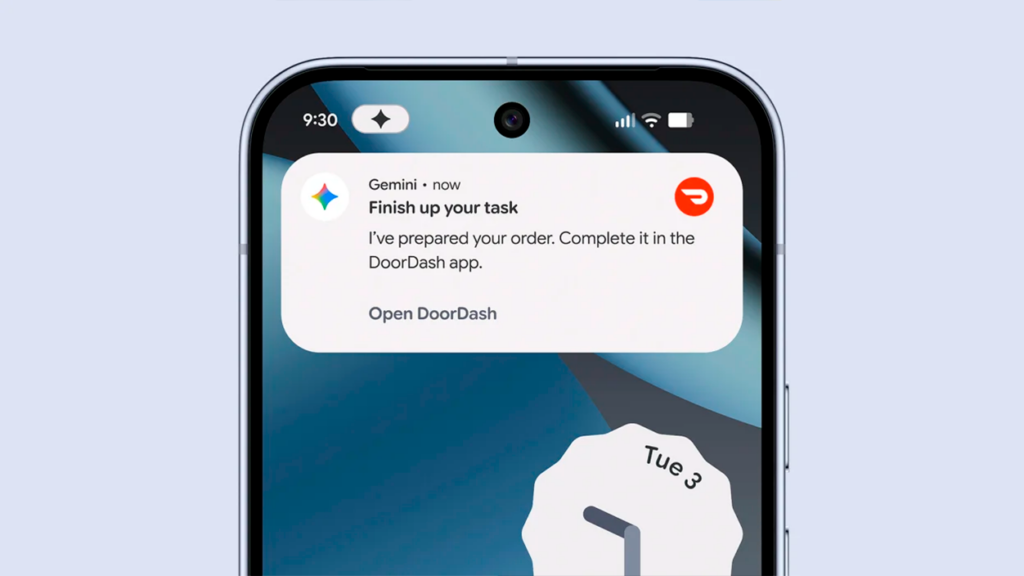

Entre los ejemplos más claros se encuentran tareas como pedir un transporte a través de una aplicación de movilidad, encargar comida a domicilio en una plataforma de delivery o preparar la lista de la compra en un servicio de supermercado. Todo el flujo, desde abrir la app adecuada hasta confirmar el pedido, quedará en manos de Gemini.

Un aspecto clave es que estas acciones se ejecutan en segundo plano, de modo que puedes seguir usando el teléfono con normalidad: chatear, revisar el correo o navegar, mientras el asistente se mueve por la app correspondiente y va completando los pasos necesarios sin interrumpir lo que estabas haciendo.

Para evitar que el proceso se sienta opaco, Android mostrará notificaciones con el progreso de la tarea, en una experiencia similar a las Live Activities de otros sistemas. Desde ahí, el usuario puede seguir cada etapa, intervenir si algo no le cuadra o detener la automatización en cualquier momento.

Google también ha introducido una capa técnica pensada para la tranquilidad del usuario: las acciones de Gemini se ejecutan en una ventana virtual aislada dentro del smartphone. Esa especie de “sandbox” limita lo que la IA puede hacer a la app o tarea concreta que se le ha pedido, reduciendo el riesgo de accesos indebidos al resto del sistema o a otras aplicaciones sensibles.

Disponibilidad: beta limitada en Galaxy S26 y Pixel 10

Las nuevas funciones de Gemini apps Android no llegarán de golpe a todo el ecosistema. Google ha optado por un lanzamiento escalonado en forma de versión beta, empezando por una lista reducida de dispositivos de gama alta donde puede probar la tecnología con más control.

Entre los primeros equipos confirmados están los nuevos Samsung Galaxy S26 y los Google Pixel 10. En estos teléfonos, la app de Gemini incluirá la opción de delegar en la IA tareas largas y repetitivas, con especial foco en aplicaciones de comida, compras y transporte. De momento no se ha publicado un listado completo de apps compatibles, pero sí se ha dejado claro que la selección será limitada al inicio.

Otra restricción importante es la edad del titular de la cuenta de Google: el control de aplicaciones por parte de Gemini solo estará disponible para usuarios mayores de 18 años. Este filtro busca evitar escenarios delicados con menores, especialmente al tratarse de funciones que pueden implicar pagos, servicios de movilidad o recopilación de información sensible.

Por ahora, el despliegue geográfico se centra exclusivamente en Estados Unidos y Corea del Sur. No hay fechas concretas para su llegada a España u otros países europeos, pero el movimiento encaja con la estrategia habitual de Google: primero un piloto reducido, y más adelante expansión progresiva cuando la tecnología y la regulación lo permitan.

Mientras la función va madurando, la compañía insiste en que todo este sistema está diseñado con privacidad y seguridad como prioridades. La beta servirá tanto para ajustar la experiencia como para recabar feedback de usuarios y desarrolladores antes de extender las capacidades a más mercados y modelos de móvil.

AppFunctions y automatización de interfaz: lo que hay bajo el capó

Para que Gemini pueda moverse por las aplicaciones y realizar acciones significativas, Android está incorporando una serie de herramientas pensadas para que las apps se comuniquen con los agentes de IA de forma estructurada y segura. El primer gran pilar de esta arquitectura se llama AppFunctions.

AppFunctions es una característica de la plataforma Android 16, complementada por una librería Jetpack, que permite a los desarrolladores exponer funciones concretas de sus aplicaciones como “herramientas” que pueda usar un agente, como Gemini, directamente en el dispositivo. La idea recuerda a los sistemas de herramientas tipo MCP (Model Context Protocol), pero en este caso todo ocurre localmente en el móvil, sin depender en exclusiva de servicios remotos.

Con este enfoque, una app puede declarar capacidades como crear tareas, gestionar una lista de la compra, componer una lista de reproducción o añadir eventos al calendario. Gemini, u otro asistente compatible, puede entonces invocar esas funciones de forma controlada, aprovechando el contexto de la petición del usuario para rellenar los datos necesarios.

Los ejemplos que maneja Google van desde recordatorios sencillos ─“recuérdame recoger el paquete en el trabajo a las cinco”─ hasta flujos más elaborados, como buscar un correo con una receta concreta y, a partir de ese contenido, trasladar los ingredientes a una aplicación de lista de compras. Todo ello pasando por varias apps pero sin que el usuario tenga que abrirlas una por una.

Además de AppFunctions, Android está preparando un marco de automatización de la interfaz de usuario que servirá de segunda vía de integración. Esta capa permite a los agentes ejecutar tareas más genéricas en aplicaciones que todavía no hayan implementado funciones específicas, cubriendo así el enorme hueco que supone el ecosistema de apps que no están adaptadas a la nueva era de la IA.

Este marco de automatización de la interfaz hace el “trabajo pesado” por detrás y está pensado para que los desarrolladores obtengan integración con agentes sin necesidad de escribir demasiado código. En la práctica, da a las apps un primer nivel de compatibilidad con Gemini sin exigir grandes inversiones de ingeniería desde el primer día.

Google ya ha avanzado que Android 17 ampliará estas capacidades, con el objetivo de que lleguen a más usuarios, fabricantes y desarrolladores. Por ahora, la compañía está trabajando con un grupo reducido de socios para pulir la experiencia y promete compartir más detalles sobre cómo aprovechar AppFunctions y la automatización de interfaz a lo largo de este año.

Ejemplos concretos: de la galería de fotos a tareas del día a día

Algunos casos de uso empiezan a ilustrar qué significa esta nueva capa de inteligencia en un móvil Android moderno. Uno de ellos es la integración con Samsung Gallery en el Galaxy S26, donde Gemini puede interactuar con la aplicación de fotos del fabricante sin que el usuario tenga que buscar manualmente.

Basta con pedir algo del estilo “muéstrame fotos de mi gato en la galería” para que Gemini identifique la función adecuada dentro de Samsung Gallery, la active y presente directamente las imágenes relevantes dentro de la propia app de Gemini. Este proceso puede hacerse tanto por voz como mediante texto, y las fotos resultantes se pueden reutilizar al instante en una conversación, por ejemplo enviándolas por mensaje a un contacto.

Según explica Google, la aplicación de Gemini ya está utilizando AppFunctions de forma interna para alimentar integraciones con Calendario, Notas y Tareas tanto en sus propias apps como en valores predeterminados de algunos fabricantes. Esto permite, por ejemplo, crear eventos, generar recordatorios o gestionar listas sin que el usuario tenga que ir saltando de pantalla en pantalla.

En el ámbito de la productividad, los casos de uso se amplían rápidamente: desde gestión de citas y planificación hasta creación de listas de reproducción musicales basadas en criterios como “los mejores álbumes de jazz de este año”, pasando por flujos entre aplicaciones que cruzan correo, notas y listas de compra.

Todo ello apunta a un escenario donde el usuario deja de pensar tanto en “abrir tal o cual app” y pasa a formular objetivos o tareas en lenguaje natural, mientras la IA se encarga de orquestar la interacción entre las distintas piezas del ecosistema Android.

Más allá de la automatización: seguridad, búsqueda visual y futuro del ecosistema

Las nuevas capacidades de Gemini apps Android no se quedan solo en la automatización de tareas. Google también está reforzando el papel de la IA como capa de seguridad y asistencia contextual dentro del sistema operativo, con funciones que van desde la detección de estafas hasta mejoras en la búsqueda visual.

En los Galaxy S26, por ejemplo, Gemini se integra con la aplicación Samsung Phone para ayudar a detectar posibles estafas telefónicas. Aunque de momento esta opción solo está disponible en inglés y en Estados Unidos, la idea es que la IA analice en tiempo real las llamadas y pueda advertir al usuario si detecta patrones sospechosos, complementando a los filtros tradicionales.

Android también ha actualizado la protección frente a fraudes en la app de Mensajes de Google, de nuevo apoyándose en modelos de IA que identifican mensajes potencialmente maliciosos. Todo ello se alinea con un enfoque en el que Gemini no solo sirve para automatizar, sino también para vigilar y prevenir riesgos en la comunicación diaria.

Otra función que se ve reforzada por estas mejoras es “Busca con un círculo”, la herramienta que permite obtener más información sobre cualquier elemento que aparezca en pantalla simplemente rodeándolo con un gesto. En los Galaxy S26 y Pixel 10, esta capacidad se amplía para localizar conjuntos de ropa completos en una sola búsqueda, combinando imagen, contexto y resultados comerciales sin que el usuario tenga que escribir ni una palabra.

De fondo, todas estas piezas apuntan a una misma dirección: convertir a Gemini en el núcleo inteligente de la experiencia Android, capaz de entender lo que ocurre en el dispositivo, actuar en nombre del usuario cuando se le pide y, al mismo tiempo, servir como escudo ante intentos de fraude o contenidos dudosos. Para orientaciones prácticas sobre seguridad en asistentes y chatbots, conviene revisar listas como esta sobre checklist de seguridad en chatbots.

Queda por ver cómo se adaptará todo este despliegue a los requisitos regulatorios y de privacidad de regiones como la Unión Europea, donde el tratamiento automatizado de datos y el control sobre las decisiones de la IA están especialmente vigilados. En cualquier caso, la apuesta de Google por un modelo basado en ventanas virtuales, permisos claros y funciones acotadas indica que el debate legal y técnico seguirá muy presente en los próximos meses.

Con este giro hacia la automatización avanzada, la combinación de Gemini y Android dibuja un escenario en el que el móvil pasa de ser solo una colección de aplicaciones a comportarse como un asistente operativo capaz de encargarse de encargos completos, pero sin perder de vista la supervisión humana. A medida que la beta se expanda a más dispositivos y países, incluyendo previsiblemente España y otros mercados europeos, será cuando se podrá comprobar hasta qué punto los usuarios están dispuestos a ceder parte del control diario de sus apps a la inteligencia artificial y cómo encaja esa nueva dinámica en su rutina tecnológica.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.