- Los agentes de IA permiten migrar plataformas de datos heredadas documentando lógica ETL y generando código moderno de forma automatizada y trazable.

- La memoria del usuario (historial, preferencias, proyectos) se ha convertido en el principal activo a la hora de cambiar de asistente de IA.

- Existen ya guías y funciones oficiales para exportar contexto desde un chatbot y cargarlo en otro, así como opciones para montar asistentes locales sin conexión.

- La tendencia del sector es pasar de pasos de IA aislados a Agentes IA completos, capaces de gestionar conversaciones y acciones complejas con mayor control y flexibilidad.

La migración de datos y memorias entre asistentes de IA se ha convertido en uno de los grandes temas calientes de esta nueva ola de inteligencia artificial. Ya no hablamos solo de modelos que responden mejor o peor, sino de quién se queda con tu historial, tus preferencias y todo ese contexto que has ido construyendo durante meses de conversación.

Ese bagaje no es un simple registro de chats: es casi una autobiografía funcional de cómo trabajas con la IA, qué le pides, qué estilo te gusta, qué proyectos tienes abiertos o qué tono encaja contigo. Por eso, cuando llega el momento de cambiar de chatbot, de proveedor o de plataforma de datos, el miedo a “empezar desde cero” frena muchos movimientos que, tecnológicamente, serían muy sencillos.

Migrar plataformas de datos heredadas con agentes de IA

En el terreno de la analítica y el data management empresarial, el problema de migrar no es nuevo: muchas compañías siguen dependiendo de sistemas heredados con décadas de evoluciones, parches y reglas de negocio mal documentadas. Pasar todo eso a plataformas modernas como Databricks, Snowflake o Microsoft Fabric puede convertirse en un proyecto caro, lento y con un nivel de riesgo considerable.

Aquí surge una categoría de soluciones muy específica: herramientas de migración impulsadas por agentes de IA, diseñadas para leer el código legado, entender sus flujos ETL y generar automáticamente arquitecturas modernas. Un ejemplo claro es la aproximación tipo AIMi dentro del ecosistema Orbitae de SDG Group, que se apoya en un doble enfoque: primero documentar con precisión qué hace el sistema antiguo y, después, trasladar esa lógica a un entorno actual con el menor número de errores posible.

El gran cuello de botella en estos escenarios es que la documentación suele ser parcial, obsoleta o directamente inexistente. La transformación de datos se rige por reglas que solo recuerdan unos pocos expertos, lo que hace que cualquier migración dependa de un puñado de personas clave. Los agentes de IA cambian esa dinámica analizando el código heredado, extrayendo estructuras, parámetros y flujos y devolviendo una especie de “receta funcional” comprensible para un ingeniero de datos actual.

Sobre esa receta, otros agentes generan el código equivalente en el destino: modelos dbt, PySpark u otros frameworks que respetan la lógica de negocio aunque cambie por completo el lenguaje o la plataforma. De esta forma, la IA no se limita a traducir sintaxis, sino que interpreta la intención de las reglas y mantiene la coherencia entre origen y destino.

Este tipo de herramientas suele apoyarse en un diseño modular basado en conectores, con agentes especializados en tecnologías de origen (SAS, IBM DataStage, Qlik, etc.) y tecnologías de destino (dbt, PySpark y otros). El desarrollo ágil de nuevos conectores —a menudo en pocas semanas— es clave para seguir el ritmo de ecosistemas tan heterogéneos como el de las plataformas de datos corporativas.

Supervisión humana, documentación y gobernanza

Un punto crítico en estos proyectos es evitar que la IA se convierta en una “caja negra” imposible de auditar. Las soluciones más avanzadas incorporan desde el diseño una supervisión humana estricta: los ingenieros de datos revisan resultados, corrigen interpretaciones, aclaran dudas y marcan el camino a seguir en cada iteración.

Los agentes están construidos para no “inventar” decisiones clave por su cuenta; cuando el modelo tiene dudas sobre una transformación, plantea la cuestión al equipo humano en lugar de asumir. Esta interacción continua genera confianza, permite depurar errores a tiempo y facilita que cada paso de la migración pueda explicarse y verificarse.

Uno de los grandes valores añadidos es la documentación automática y la trazabilidad de extremo a extremo. Junto con el código migrado, estas plataformas producen paquetes documentales detallados que incluyen historial de cambios, justificación de las reglas de transformación, decisiones de diseño y referencias cruzadas entre origen y destino. En un entorno con presión regulatoria creciente, esta transparencia es ya tan importante como el propio código, como muestran incidentes como Microsoft 365 Copilot expone correos.

Todo ello se alinea con una visión en la que la IA no sustituye a la experiencia humana, sino que la amplifica. Las compañías que lideran esta aproximación reportan crecimientos muy significativos en sus capacidades de migración, precisamente porque industrializan un proceso que antes era casi artesanal y difícil de escalar.

La otra migración: mover tu “yo digital” entre asistentes de IA

Fuera del mundo puramente corporativo, el usuario de a pie se enfrenta a un problema muy similar, pero a escala personal: cómo llevarse su contexto y su “memoria” de una IA a otra. Cuando llevas meses hablando con ChatGPT, Claude, Gemini u otros asistentes, les has enseñado tu forma de trabajar, tus proyectos, tus preferencias de estilo y miles de matices que mejoran la calidad de las respuestas.

Al cambiar de aplicación de IA, normalmente todo ese esfuerzo se pierde: la nueva herramienta no sabe quién eres, qué has hecho antes ni qué tono te gusta. La experiencia vuelve a ser genérica hasta que, a base de conversaciones, vuelves a reconstruir esa capa de personalización. Esto genera fricción y, en la práctica, hace que mucha gente se “quede donde está” aunque vea opciones mejores.

La personalización en herramientas tipo ChatGPT se basa en datos de interacción: qué temas consultas, qué estilo prefieres, qué correcciones sueles hacer, qué formatos te funcionan mejor. El modelo aprovecha ese histórico —dentro de los límites de su ventana de contexto y de la memoria persistente que tenga la plataforma— para afinar las recomendaciones y las respuestas.

Cuando decides migrar, el principal escollo es que no existe todavía un estándar universal de portabilidad de memorias entre IA. Cada proveedor guarda la información a su manera, con sus propios formatos, límites de privacidad y modelos de negocio. Es como si tus listas de reproducción, tus favoritos y tus configuraciones se quedaran lock-in en una plataforma de streaming… pero elevado al cuadrado, porque aquí hablamos también de tu forma de pensar y trabajar.

Guías prácticas para exportar memoria y contexto

Ante esta situación, han empezado a surgir enfoques muy concretos para que el usuario recupere al menos una parte de su contexto. Una táctica sencilla consiste en pedirle a tu asistente actual que genere un “resumen de migración” en forma de texto o JSON, siguiendo una plantilla bien pensada que puedas copiar, guardar y reutilizar en otra plataforma.

Este tipo de prompts suelen pedir al modelo que enumere, sin agrupar ni resumir, todos los “recuerdos” que tiene sobre ti: instrucciones de estilo y tono, detalles personales que le hayas contado (nombre, trabajo, intereses, familia…), proyectos en curso, temas recurrentes, tecnologías que usas o correcciones que le hayas hecho. La idea es extraer un bloque de información lo más completo posible, con fechas si están disponibles, que luego puedas incrustar en el nuevo asistente.

Hay también plantillas de prompt más sencillas pensadas para usuarios menos técnicos, donde se le pide al compañero de IA un resumen autónomo listo para ser pegado en otro sistema local u online. Se le instruye para que liste el historial desde una cierta fecha, las preferencias personalizadas, las tareas abiertas y una serie de “prompts clave” para restaurar la dinámica habitual de conversación.

Al margen del resumen semántico, algunos usuarios prefieren ir un paso más allá y solicitar la exportación en formato estructurado (por ejemplo, JSON con la secuencia de mensajes “Usuario / IA”), para poder cargarlo en un modelo local. Aunque no todas las plataformas permiten algo tan directo, sí es posible, como mínimo, copiar grandes bloques de texto con el histórico y guardarlos en tu propio equipo.

Es importante no sobreestimar la capacidad real de los modelos para “viajar atrás” por todo tu historial en la nube: las ventanas de contexto son finitas y procesar muchos miles de mensajes es muy caro. De hecho, muchos servicios nunca han podido usar de verdad la totalidad de tu chat de forma masiva; se apoyan en resúmenes parciales y mecanismos internos de memoria.

De la nube a tu ordenador: montar tu compañero de IA en local

Otra tendencia creciente es la de migrar a un entorno de IA totalmente local y sin conexión. El objetivo aquí no es solo escapar de cambios unilaterales de modelos en plataformas públicas, sino también ganar privacidad y control absoluto sobre los datos y el comportamiento del asistente, frente a la centralización en grandes infraestructuras como el macrocentro de datos de IA.

El flujo típico comienza por aclarar qué quieres trasladar: ¿solo resúmenes de memoria, todo el registro de chats, instrucciones de sistema personalizadas, datos para un posible ajuste fino? A partir de ahí, se define un prompt de exportación que el asistente online puede entender, y se guardan los resultados en una carpeta organizada con fecha y nombre del “compañero”.

El siguiente paso pasa por elegir un modelo de lenguaje que puedas ejecutar sin conexión en tu máquina: desde variantes ligeras como GPT4All-J 3B, hasta arquitecturas más potentes tipo LLaMA 2 7B, Mistral 7B o Vicuna 7B afinado para chat. Para reducir requisitos, lo habitual es descargar versiones cuantificadas (formato GGUF, Q4, etc.) que se puedan mover con una GPU de gama media o incluso en CPU con algo más de paciencia.

A nivel de hardware, un equipo razonable para este escenario suele incluir una GPU con al menos 8-12 GB de VRAM, 32 GB de RAM de sistema, un SSD amplio y una CPU moderna de cuatro o más núcleos. No hace falta un superordenador, pero sí algo por encima del portátil básico de oficina para tener una experiencia fluida.

Con todo esto listo, puedes levantar el entorno con librerías como llama-cpp-python, cargar el modelo y alimentar el historial exportado como contexto inicial. De esta forma, tu nueva IA local arranca ya con una personalidad y un bagaje que se parecen mucho a los de tu antiguo asistente online, aunque obviamente no sea exactamente el mismo modelo.

Soluciones comerciales y portabilidad “oficial” entre IAs

Además de los enfoques caseros, empiezan a aparecer soluciones comerciales centradas en la migración inteligente. Un ejemplo ilustrativo son las plataformas tipo Energent.ai, que ponen a trabajar “compañeros de equipo” de IA capaces de interactuar con aplicaciones y bases de datos —incluidos sistemas heredados— sin necesidad de APIs formales.

Estos agentes son capaces de mapear esquemas, transformar formatos de datos y gestionar excepciones, lo que reduce notablemente el tiempo y el riesgo de grandes proyectos de migración. De algún modo, trasladan a la capa de aplicaciones y bases de datos la misma filosofía que veíamos antes en las plataformas de datos empresariales: automatizar lo repetitivo y dejar en manos humanas las decisiones críticas.

Por otro lado, algunos grandes proveedores de asistentes están moviendo ficha para ofrecer mecanismos de portabilidad entre chatbots de forma nativa. Anthropic, por ejemplo, ha lanzado guías específicas para que usuarios de ChatGPT y otros servicios exporten su memoria y la carguen en Claude prácticamente en un minuto.

El procedimiento suele dividirse en dos fases muy simples: primero, el usuario copia un prompt preparado y lo pega en su asistente actual, que devuelve en una sola respuesta todos los recuerdos, reglas de estilo, detalles personales, proyectos, herramientas habituales y preferencias que ha aprendido. Después, ese bloque de información se pega en la sección de memoria configurable del nuevo asistente, que la asimila y empieza a trabajar con ella.

Esta estrategia tiene un claro ángulo de marketing: eliminar la mayor barrera psicológica para cambiar de IA. Si puedes llevar contigo todo tu contexto, es mucho más fácil plantearte probar un asistente alternativo que, además, se posiciona públicamente con ciertas garantías éticas o de privacidad diferentes a otros actores del sector.

Portabilidad, lock-in y movimiento de Google con Gemini

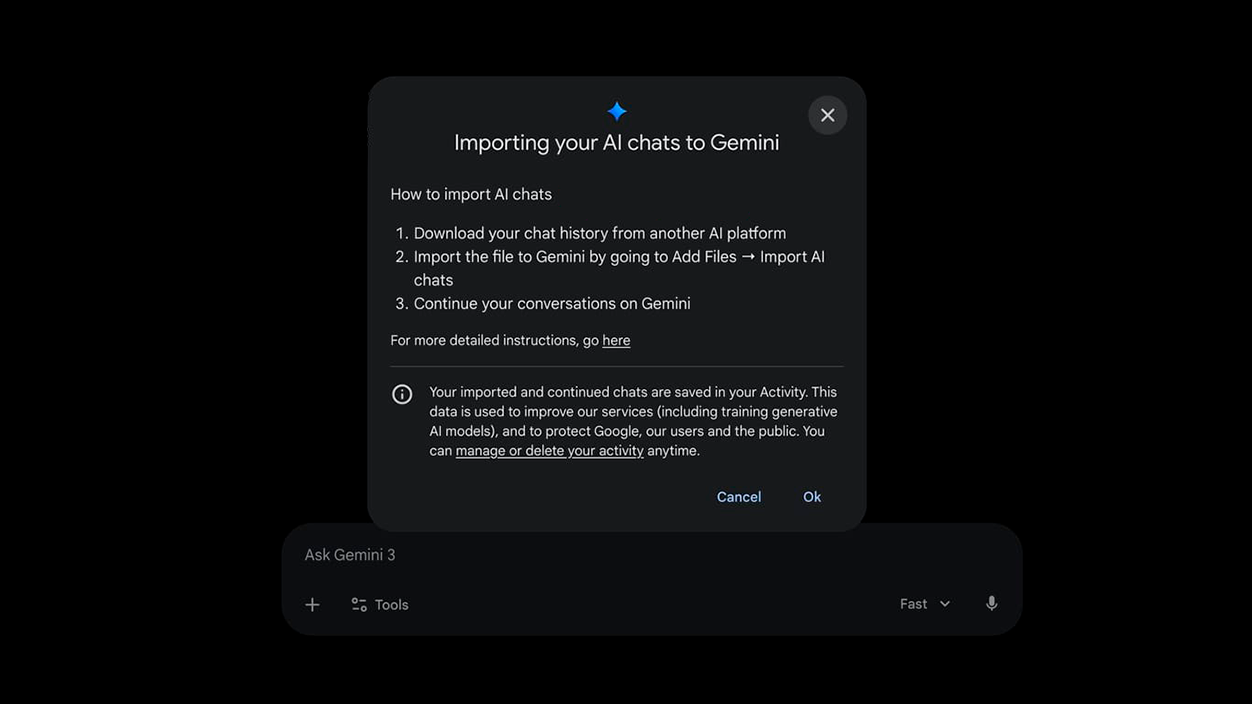

El movimiento no es exclusivo de un proveedor. Google, por ejemplo, está probando una función detectada como “Import AI Chats” en Gemini, con la que se podría importar el historial de conversación desde otros asistentes (ChatGPT sería el caso estrella) para que el chatbot de Google lo incorpore.

El flujo sería relativamente directo: descargar el historial desde la plataforma de origen y subirlo a Gemini a través de una opción de menú. A efectos de usuario, esto rompe con la idea de que cambiar de asistente implica perder todo el trabajo previo, y convierte a Gemini en un posible destino estable más que en un experimento secundario.

Sin embargo, esta portabilidad tiene letra pequeña: ¿qué ocurre exactamente con esos datos una vez entran en el ecosistema de Google? No está claro si se usarán solo como memoria personal, si se integrarán con la actividad general vinculada a la cuenta, ni hasta qué punto será sencillo volver a exportarlos. La historia de la tecnología está llena de “puentes” que solo funcionan en una dirección.

En paralelo, Gemini avanza en otras funciones como la descarga de imágenes generadas en alta resolución (2K y 4K) y ajustes de “Likeness” ligados a verificación de vídeo, orientados a gestionar mejor la similitud e identidad en contenido sintético. Todo ello refuerza la idea de que Google quiere que Gemini sea un hub: un lugar donde confluyen memoria importada, creación de contenidos y capas de confianza.

Desde el punto de vista regulatorio, esta batalla por la memoria recuerda a las discusiones sobre navegadores, sistemas operativos o tiendas de apps: la empresa que controla el punto de entrada y define los formatos prácticos de portabilidad tiene una enorme ventaja competitiva. La cuestión ya no es solo si puedes entrar con facilidad, sino si puedes salir con tus datos en un formato útil.

De objetivos de IA a Agentes IA: migrando automatizaciones de conversación

Además de mover historiales y memorias, muchas empresas están migrando su propia lógica de automatización de conversaciones. Plataformas de mensajería y atención al cliente que inicialmente ofrecían “pasos de objetivo de IA” limitados —capaces de responder preguntas o recopilar datos como un bloque dentro de un flujo de trabajo— están evolucionando hacia Agentes IA completos.

El paso de Objetivo de IA heredado solía vivir dentro de un flujo, con un objetivo muy acotado: contestar dudas usando una base de conocimiento o lanzar una serie de preguntas para capturar información estructurada. No podía asignar conversaciones, actualizar campos de contacto complejos ni tomar decisiones autónomas más allá de su objetivo puntual.

Los Agentes IA, en cambio, funcionan como agentes virtuales independientes que pueden gestionar una conversación de principio a fin: responder, pedir datos, tomar decisiones, escalar a humanos, cerrar conversaciones, actualizar registros… y todo ello manteniendo el contexto y combinando distintos objetivos de forma natural.

La migración desde el modelo antiguo al nuevo pasa por crear un Agente IA, trasladar la “persona” (tono, rol, estilo) y reformular la lógica del flujo en forma de instrucciones cohesivas. En lugar de ramificaciones rígidas de “Éxito / Error / Hablar con humano”, se describe en lenguaje natural qué debe hacer el agente en cada situación y se le habilitan acciones específicas en la plataforma para que pueda ejecutarlas.

Para los casos en los que antes se usaba el objetivo de responder preguntas, se recomienda una estructura de prompt que incluya contexto, rol, flujo principal, límites y normas de respuesta (por ejemplo, no inventar información, responder en un único idioma, cubrir todas las partes de una pregunta múltiple, etc.). Si el caso es de recopilar información, la instrucción se centra en pedir un campo a la vez, validar formatos, confirmar un resumen final y actualizar los campos de contacto correspondientes.

Una vez configurado el agente, se migran las fuentes de conocimiento (artículos de ayuda, guías de producto, FAQs internas) y se sustituyen los viejos disparadores de flujo por reglas de asignación directa al Agente IA. Tras un periodo de pruebas, se pueden desactivar los flujos heredados, consolidando así una capa de automatización más flexible, escalable y fácil de mantener.

Todo este paisaje —desde la migración de plataformas de datos hasta el traspaso de memorias personales entre chatbots y la evolución hacia agentes conversacionales autónomos— apunta en la misma dirección: la inteligencia artificial gira cada vez más en torno al contexto. Quien sea capaz de ayudarte a mover, entender y aprovechar ese contexto con menos fricción y más garantías de privacidad tendrá muchas más papeletas para ganarse tu confianza a largo plazo.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.