- El memory lock-in en IA surge cuando tu contexto y preferencias quedan atrapados en un único asistente, elevando el coste de cambiar de modelo.

- Anthropic, con Claude, ha lanzado memoria para usuarios gratuitos y una función de importación que migra memorias desde ChatGPT o Gemini.

- La importación se basa en destilar lo que el modelo origen sabe de ti, integrarlo en la memoria estructurada de Claude y respetar privacidad y control.

- En paralelo, el “memory lock” clásico en sistemas operativos fija páginas en RAM para tiempo real, mostrando otro sentido técnico del término.

Si llevas meses usando un asistente de IA, ya sabes que no solo estás escribiendo mensajes sueltos: estás construyendo, poco a poco, una especie de memoria compartida llena de contexto, preferencias y proyectos. Tu forma de trabajar, tu tono de escritura, tus correcciones y tus manías se quedan ahí dentro, como si la máquina te fuera conociendo cada día un poco mejor.

El problema es que, hoy por hoy, esa memoria suele estar encerrada dentro de cada plataforma y se convierte en un potente “memory lock-in”: si quieres cambiar de modelo o de proveedor, te toca empezar de cero. En este artículo vamos a desgranar qué es exactamente el lock-in de memoria, por qué es tan importante a nivel técnico, de producto y hasta político, y cómo iniciativas como la importación de memoria de Claude o propuestas de estándares abiertos intentan darle la vuelta a este juego.

Qué es el “memory lock-in” en asistentes de IA

En el contexto de los asistentes de IA modernos, el “memory lock-in” se refiere a que toda la historia que has generado con un modelo queda atrapada en ese servicio, sin una forma sencilla, nativa y estandarizada de llevártela a otro. No hablamos solo del histórico de chats, sino de algo mucho más valioso: el contexto largo plazo.

Con el tiempo, un asistente como ChatGPT, Gemini o Claude aprende cómo te gusta que te respondan, qué tipo de lenguaje usas, qué proyectos tienes en marcha, qué frameworks técnicos utilizas, qué cosas le has dicho que haga siempre y qué debe evitar. Eso es el verdadero “capital” que acumulas.

Sin embargo, la mayoría de plataformas diseñan sus productos de forma que no exista un estándar sencillo para portar esa memoria a otro modelo competidor. Aunque puedas guardar o exportar conversaciones, la estructura interna de la memoria (las preferencias destiladas que el sistema ha inferido) no suele ser interoperable. El resultado práctico: si llevas un año entrenando un asistente, te lo piensas dos veces antes de probar otro, porque sabes que vas a perder ese “entendimiento mutuo”.

Este efecto no es casual. Para muchas empresas, el lock-in de memoria actúa como un muro que retiene usuarios incluso cuando existen alternativas potencialmente mejores. El rendimiento de los modelos se está igualando, así que el diferencial competitivo pasa a ser quién consigue que salgas lo menos posible de su ecosistema.

Por qué tu contexto vale oro (y debería ser portátil)

Detrás de cada sesión de chat hay mucho más que un simple intercambio de preguntas y respuestas: estás invirtiendo tiempo en refinar instrucciones, en depurar workflows y en enseñar a la IA cómo trabajas. Ese trabajo no es trivial, y en muchos casos se acumula durante meses.

Cuando redactas un buen prompt de sistema, diseñas un flujo de trabajo para programar, o vas puliendo la forma en la que el modelo documenta tus proyectos, en realidad estás construyendo una “capa de contexto” propia, ligada a ti y a tu organización. Esa capa es una especie de memoria ampliada: contiene tu historia, tu forma de pensar, tu stack tecnológico y tu manera de comunicar.

El gran problema es que la industria, en general, trata esa capa como si fuera desechable. Si decides probar otro modelo, rara vez te ofrecen una vía sencilla para trasladar esa memoria. Lo habitual es tener que reexplicarlo todo: quién eres, qué haces, qué tics de estilo tienes, cómo quieres que te hable, qué proyectos tienes encima de la mesa.

De ahí surge la reivindicación creciente de que los usuarios deberían tener “memoria nativa portátil”: un mecanismo estándar y directo para mover la memoria personal entre herramientas, del mismo modo que hoy enviamos un PDF o migramos un documento de un editor a otro. La idea es que tu contexto no pertenezca a la plataforma, sino a ti.

Propuestas de comunidad: hacia un estándar abierto de memoria

En paralelo al movimiento de las grandes empresas, han empezado a surgir voces en la comunidad que reclaman un estándar abierto para la portabilidad de la memoria. El planteamiento es claro: si todos los proveedores adoptan un formato común para describir el contexto de usuario a largo plazo, cambiar de modelo sería tan trivial como subir un archivo.

Algunas personas y equipos ya se están organizando para firmar peticiones formales dirigidas a los principales laboratorios de IA, pidiendo precisamente esto: que se reconozca el derecho de los usuarios a conservar y mover su memoria. Como mínimo, se reclama una función de “recarga” en las interfaces, que permita reenviar todo tu contexto de golpe, sin tener que reconstruirlo manualmente cada vez.

En este contexto han aparecido herramientas puente, como ciertas soluciones que actúan de “forja de memoria”, con las que puedes extraer parte del contexto de un modelo y prepararlo para otro. Sus propios creadores reconocen que su objetivo último no es vender un parche, sino presionar para que estas funciones acaben siendo nativas y no un extra de pago. La idea es que portar tu memoria sea un derecho de base, no un complemento de nicho.

El movimiento de Anthropic: memoria para todos e importación desde ChatGPT y Gemini

Mientras tanto, los grandes actores del sector se han dado cuenta de que el “memory lock-in” es un arma de doble filo: sirve para retener usuarios, pero también puede ser una gran oportunidad para atraer a quienes están hartos de depender de un solo proveedor. Aquí entra en escena Anthropic con Claude.

Anthropic ha decidido abrir la memoria de Claude a todos los usuarios, incluyendo la capa gratuita, y lanzar una función específica para importar la memoria procedente de ChatGPT, Gemini y otros asistentes. Lo interesante no es solo que den memoria a los free users, sino que declaran abiertamente la guerra al coste de cambio entre plataformas.

Cualquiera que haya pasado meses trabajando con un asistente sabe lo que duele arrancar desde cero: hay que repetir el contexto del negocio, el tono de voz, los detalles de proyectos, las preferencias de formato, las herramientas que utilizas a diario… Esa “pereza de migrar” es exactamente el lock-in que muchas compañías han cultivado sin decirlo.

Con la nueva función, Anthropic ofrece algo muy directo: rellenar gratis ese foso que separa a los usuarios de otros modelos. En lugar de resignarte a perderlo todo, puedes llevarte el núcleo de tu memoria de un modelo a Claude con un proceso relativamente simple. Según medios especializados, la función empezó a probarse tiempo atrás, pero ahora se ha desplegado a gran escala con capacidades mejoradas.

Este movimiento llega justo en un momento en que los modelos punteros (GPT‑4, Gemini, Claude 3.5 Sonnet, etc.) se han acercado mucho en rendimiento para tareas generales. Cuando el nivel técnico se homogeneiza, la batalla deja de ser quién tiene más parámetros y pasa a ser quién reduce más fricciones a los usuarios, especialmente a los que ya tienen contexto acumulado en otro sitio.

Cómo funciona la memoria personalizada de Claude en la práctica

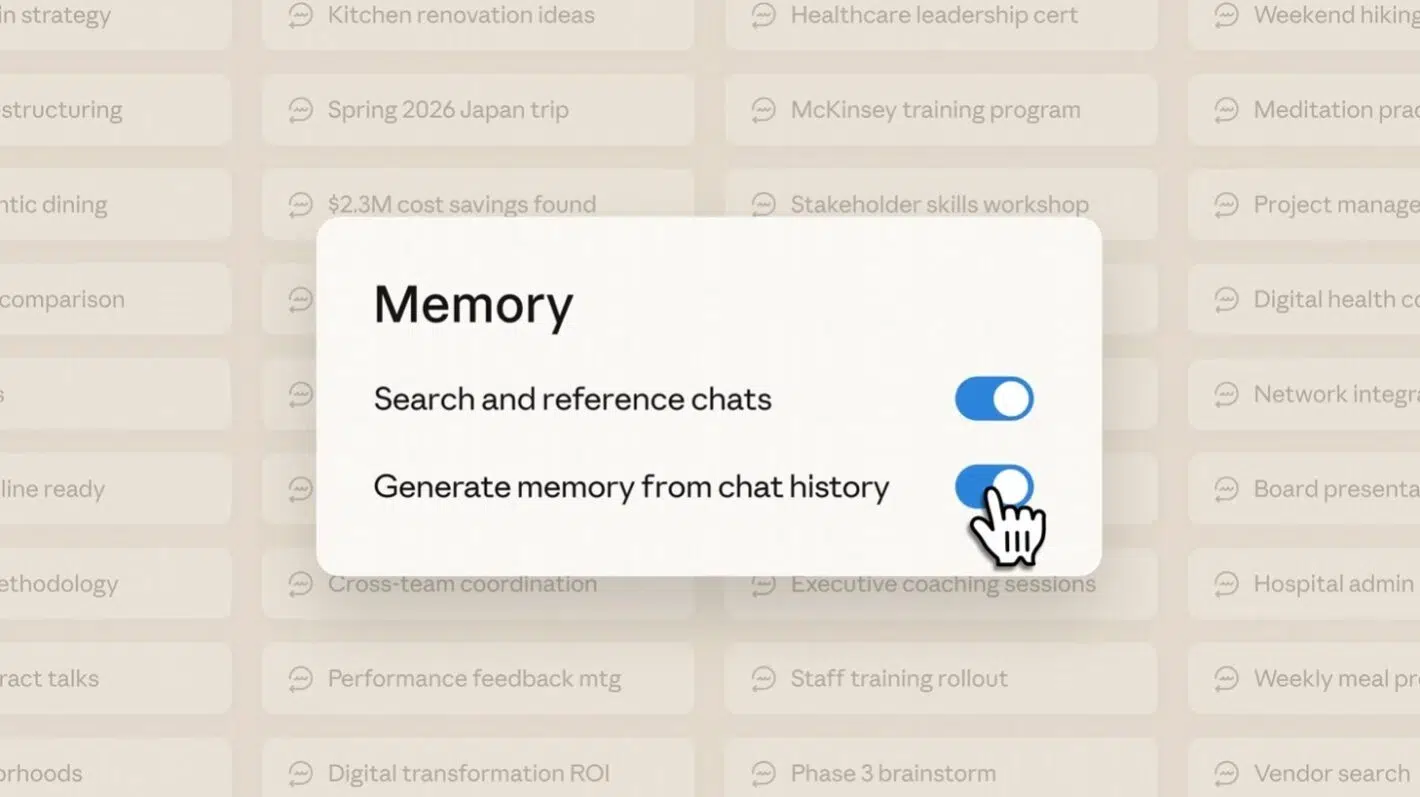

Claude incorpora una memoria personalizada que le permite recordar detalles relevantes sobre cada usuario a lo largo del tiempo, de forma que no tengas que repetir siempre lo mismo. Esta memoria se alimenta tanto de interacciones normales como de la nueva función de importación.

La importación está pensada para ser lo menos traumática posible: el flujo típico consiste en exportar o extraer tus preferencias y contexto desde el otro asistente y pegarlos en una interfaz específica de Claude. A partir de ahí, el sistema analiza ese texto, identifica los datos clave y los integra en su propia representación estructurada de memoria.

Entre las cosas que Claude es capaz de recordar se incluyen tu estilo de comunicación, el tono con el que quieres que te responda, datos profesionales y de negocio, proyectos que tengas en marcha, formatos preferidos para los entregables o información técnica relevante sobre tu stack de herramientas.

Esta memoria, además, no se queda congelada en el tiempo. A medida que usas Claude, se va actualizando y refinando en función de nuevos datos, cambios de prioridades o ajustes que le vayas indicando. De este modo, la importación es solo el punto de partida; la relación evoluciona con el uso.

En los planes de pago orientados a usuarios intensivos y equipos (Pro y Team), esta capacidad de memoria se convierte en una ventaja operativa clara para startups, equipos técnicos y organizaciones que basan gran parte de su trabajo diario en la IA. Permite construir una especie de “perfil persistente” que hace que el asistente se parezca cada vez más a un colaborador que ya está metido en tus temas.

Ventajas para startups y equipos técnicos

Para fundadores, CTOs y equipos de producto que viven pegados a modelos de IA, la memoria personalizada tiene un impacto directo en la operativa diaria: reduce fricción, mejora la consistencia y facilita la colaboración interna.

Por un lado, ya no tienes que repetir en cada conversación el contexto de negocio, la arquitectura de tu producto o los objetivos de cada sprint. Claude puede dar por sentado muchos de esos datos, y usarlos desde la primera respuesta. Esto se traduce en menos tiempo perdido contextualizando y más tiempo recibiendo sugerencias accionables.

Por otro, cuando el asistente recuerda que tu startup usa, por ejemplo, Next.js, cierto estilo de documentación, y que prefieres respuestas concisas orientadas a acción, el nivel de ajuste a tus necesidades es mucho mayor. No arranca desde cero cada vez, sino que parte de un perfil bastante afinado.

En los planes de equipo, además, se puede compartir parte de esa memoria contextual entre varios miembros. Esto evita que cada persona tenga que “entrenar” al asistente desde cero y ayuda a alinear el tono y el nivel de detalle entre distintas áreas (producto, marketing, ventas, soporte).

Casos de uso en los que la importación de memoria marca la diferencia

Hay una serie de escenarios donde la importación de memoria, tal y como la plantea Anthropic, puede ofrecer beneficios inmediatos y muy visibles en el día a día de una empresa o profesional.

Migración de flujos de redacción y comunicación

Si hasta ahora utilizabas otro asistente para crear contenido (posts, newsletters, comunicaciones con inversores, documentación interna), habrás invertido tiempo en ajustar tono, estructura, longitud, ejemplos típicos, referencias de marca, etc. Importar la memoria a Claude permite seguir casi donde lo dejaste, con un estilo similar pero beneficiándote de las fortalezas del nuevo modelo.

Continuidad en análisis de datos y reporting

Quienes usan la IA para interpretar métricas, analizar feedback de usuarios o preparar resúmenes periódicos suelen enseñar al asistente qué KPIs importan, qué números son ruido, cómo estructurar los informes y qué formato de visualización prefieren. Con la importación de memoria, Claude puede incorporar directamente esos criterios y evitar semanas de reajuste.

Desarrollo de producto y programación asistida

En entornos de desarrollo, es habitual que el asistente “aprenda” cosas como el stack de la empresa, convenciones de código, patrones de arquitectura, librerías preferidas o decisiones de diseño ya tomadas. Llevarse esa información a otro modelo marca la diferencia entre tener un “junior” al otro lado o alguien que ya viene rodado en tu proyecto.

Detalles técnicos y de privacidad en la memoria de Claude

Una de las preocupaciones lógicas al hablar de portabilidad de memoria es qué pasa con los datos una vez dentro del nuevo sistema. Anthropic ha publicado lineamientos claros sobre cómo se almacena y se gestiona la memoria personalizada en Claude, que resultan especialmente relevantes para startups que manejan información sensible.

La memoria se conserva de forma encriptada y controlable por el usuario: puedes revisar, editar o eliminar en cualquier momento los datos que el asistente ha retenido sobre ti. Esto da la posibilidad de auditar qué se ha guardado y ajustar el nivel de detalle si algo te incomoda, y frente a incidentes públicos (por ejemplo, hacker usó Claude) conviene prestar atención a las políticas de retención.

En entornos multiusuario, la compañía establece que la memoria no se comparte entre organizaciones distintas dentro de los planes de equipo. Es decir, cada organización mantiene un ámbito separado, evitando mezclas indeseadas de contexto entre clientes.

Un punto relevante es que Anthropic mantiene una política explícita de no usar la memoria personalizada de los usuarios para reentrenar sus modelos base. Esto, combinado con la opción de borrado selectivo, reduce el riesgo de que información sensible termine influenciando respuestas fuera de tu entorno.

Cómo funciona exactamente la función “Memory Import”

La función de importación de memoria se apoya en una idea bastante ingeniosa: usar un prompt estándar para que el modelo origen liste, de forma estructurada, todo lo que ha aprendido sobre ti. No hace falta que exista un API oficial de exportación de memoria; se explota el propio comportamiento del modelo.

El proceso consta, a grandes rasgos, de dos pasos. En el primero, copias un texto preparado por Anthropic y lo pegas en tu asistente actual (por ejemplo, ChatGPT). Ese texto le pide de forma muy detallada que saque a la luz todas las “memorias” almacenadas sobre ti: desde instrucciones de estilo, tono y formato, hasta datos personales (nombre, ubicación, trabajo, familia, intereses), proyectos y objetivos recurrentes, herramientas, lenguajes y frameworks que utilizas.

En ese mensaje también se le exige al modelo origen que devuelva la información en un bloque claramente copiable, con un formato consistente por registro (fecha, si la tiene, más el contenido de la memoria) y que no omita nada ni agrupe excesivamente la información. La idea es obtener un listado lo más exhaustivo posible de todo lo que el sistema cree saber de ti.

En el segundo paso, tomas ese bloque de texto y lo pegas en la página de configuración de memoria de Claude. Desde ahí, el sistema procesa la información, la estandariza y la integra en su propio esquema interno. No hace un volcado literal, sino una traducción a su formato de memoria estructurada.

Anthropic advierte que la memoria importada no se activa de golpe, sino que puede tardar hasta 24 horas en estar plenamente integrada. El motivo es que Claude actualiza sus memorias mediante un mecanismo de síntesis diaria, en lugar de escribir en tiempo real cada dato. Otro detalle importante es que la importación no pisa lo que Claude ya sabía de ti, sino que intenta hacer una fusión inteligente de ambas fuentes.

Conviene subrayar que este proceso es independiente de cualquier API o integración oficial con otros proveedores. OpenAI, por ejemplo, no ofrece una interfaz de exportación de memoria propia, así que Anthropic se las apaña mediante instrucciones estándar que cualquier usuario puede copiar y pegar. Es una forma de, literalmente, rodear las barreras de plataforma sin violar sus términos.

Comparativa con otras aproximaciones: chats vs memoria destilada

En paralelo a la propuesta de Anthropic, otros proveedores han empezado a explorar funciones de importación centradas principalmente en traer historiales de conversación completos. Un ejemplo es la prueba de ciertas características de “Import AI Chats” en modelos como Gemini.

La diferencia clave es que los historiales brutos incluyen todo: dudas puntuales, pruebas rápidas, charlas irrelevantes y un montón de ruido que no necesariamente interesa mantener como memoria estable. Si alimentarás el contexto del modelo con todo ese material sin filtrar, puedes acabar empeorando su comportamiento en lugar de mejorarlo.

La propuesta de Anthropic se centra en algo distinto: una memoria “destilada” en forma de resumen estructurado de lo que el modelo ha aprendido de ti. No trae cada conversación palabra por palabra, sino la esencia útil para personalizar respuestas futuras. Eso hace que la importación sea más manejable, más privada y menos propensa a saturar el contexto del modelo.

El impacto estratégico: atacar el lock-in de OpenAI y cambiar el mercado

Todo esto no ocurre en el vacío. La jugada de Anthropic se interpreta ampliamente como un ataque directo al foso competitivo que OpenAI ha construido en torno a ChatGPT, especialmente en el mercado masivo.

Históricamente, OpenAI se ha posicionado como la cara más visible de la IA de consumo: llegada a millones de usuarios en tiempo récord, presencia mediática constante, un CEO omnipresente en giras y conferencias. Su fuerza reside tanto en la calidad técnica de sus modelos como en la costumbre: la gente ya está ahí, con su historia y sus flujos de trabajo montados.

Anthropic, en cambio, se ha presentado como un actor más discreto y centrado en clientes empresariales con altísimas exigencias de seguridad y control: bancos, firmas legales, organizaciones de investigación. Su relato ha girado en torno a la fiabilidad y la seguridad, no tanto a la masificación.

En los últimos tiempos, sin embargo, el relato público se ha movido. Decisiones políticas y acuerdos con organismos gubernamentales han generado críticas hacia OpenAI y simpatía hacia Anthropic en ciertos segmentos de usuarios. En ese caldo de cultivo, la función de importación de memoria actúa como un “golpe quirúrgico”: justo cuando muchos se plantean irse, se les ofrece una vía de escape que minimiza el coste de cambiar.

El resultado es que OpenAI ya no puede confiar tanto en el “la gente se queda porque ya está acostumbrada”. Si portar la memoria deja de ser una odisea y se convierte en un trámite de dos pasos, el peso real se desplaza hacia la calidad de cada modelo en cada iteración. El lock-in emocional y de contexto pierde fuerza como defensa de cuota de mercado.

Memory lock-in en sistemas operativos y tiempo real: el otro sentido del término

Conviene aclarar que “memory lock-in” también tiene una acepción técnica clásica en sistemas operativos y programación de tiempo real, que no tiene tanto que ver con asistentes de IA, pero sí con cómo se gestiona la memoria en procesos críticos.

En sistemas como SunOS y derivados, las aplicaciones en tiempo real necesitan garantizar que ciertas páginas de memoria permanezcan residentes en RAM, para evitar que el sistema operativo las intercambie al disco (paginación o swapping) y para diagnósticos, como el archivo memory.dmp. Si la memoria necesaria para una tarea de baja latencia se va al disco, se incrementa el tiempo de acceso y se rompe cualquier garantía de respuesta determinista.

Para ello existen llamadas de biblioteca como mlock(3C), munlock(3C) o mlockall(3C), que permiten a procesos con privilegios de superusuario fijar segmentos concretos de su espacio de direcciones en memoria física. Al bloquear esas páginas, el sistema incrementa un contador de bloqueo; mientras ese contador sea mayor que cero, la página queda excluida de la paginación normal.

Un mismo bloque de memoria puede estar bloqueado por varios procesos o múltiples veces a través de distintos mapeos. En la práctica, el sistema mantiene un contador por página que va sumando bloqueos. Cuando se liberan todos (por ejemplo, al llamar a munlock), el contador vuelve a cero y la página vuelve a ser candidata a ser desplazada a disco.

Si un proceso elimina el mapeo mediante el cual había bloqueado una página (por cerrar o truncar un fichero mapeado, por ejemplo), el sistema desbloquea implícitamente ese segmento. Del mismo modo, si una página se borra porque el fichero subyacente desaparece, deja de estar fija en memoria.

Es importante notar que estos bloqueos no se heredan tras un fork(2): si un proceso con memoria bloqueada crea un hijo, este debe ejecutar sus propias llamadas de bloqueo si quiere garantizar residencia. De lo contrario, sufrirá fallos de página por copia en escritura u otros impactos típicos de los procesos duplicados.

Los sistemas operativos suelen imponer un límite global al número de páginas que se pueden mantener bloqueadas simultáneamente. Este límite se calcula en el arranque, normalmente como una fracción del número total de marcos de página disponibles, dejando un margen (por ejemplo, un 10 %) para no saturar el sistema. Superar ese cupo suele conducir a errores en las llamadas de bloqueo.

Existe incluso la figura de los llamados “sticky locks”: páginas cuyo contador de bloqueo llega a un valor máximo (por ejemplo, 65535 o 0xFFFF) y se consideran bloqueadas permanentemente. Esas páginas no pueden liberarse de forma normal, y la única forma práctica de recuperarlas es reiniciando el sistema, lo que subraya la necesidad de usar estos mecanismos con cuidado.

En resumen, en el plano de sistemas, “memory lock” alude a asegurar la residencia de memoria para cumplir requisitos de tiempo real y minimizar latencias, mientras que en el contexto de productos de IA hablamos de otra cosa: el bloqueo del usuario en una plataforma debido a la memoria personal acumulada. Son dos mundos distintos unidos por la misma metáfora: fijar algo en memoria y hacer que cueste mucho moverse.

Un cambio de paradigma en cómo entendemos la memoria de la IA

Todo este movimiento alrededor del “memory lock-in” está obligando a replantear qué es la memoria en los sistemas de IA, a quién pertenece y cómo debería moverse entre herramientas. Lo que antes veíamos como simples chats ahora se percibe como un activo acumulado que genera dependencia y, al mismo tiempo, ofrece una enorme oportunidad si se hace portable.

Las propuestas de memoria nativa portátil, las peticiones de estándares abiertos, las herramientas puente y jugadas como la importación de memoria de Claude apuntan en la misma dirección: dejar de tratar tu historia con la IA como un residuo y empezar a verla como un bien trasladable. A medida que más usuarios exijan control sobre ese activo, será más difícil que los proveedores se aferren al lock-in como estrategia principal.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.