- Anthropic filtró por error el código fuente interno de Claude Code tras publicar un paquete npm con un mapa de fuentes que permitía reconstruir unas 512.000 líneas de código.

- El leak destapa la arquitectura completa del agente, módulos secretos como Buddy, Kairos y Ultraplan y referencias a modelos no anunciados como Capybara/Fennec/Numbat.

- La empresa asegura que no se expusieron datos de clientes, pero la comunidad alerta de nuevos vectores de ataque y de la dificultad de retirar el material una vez replicado en mirrors y plataformas descentralizadas.

- La filtración reabre el debate legal y de seguridad sobre código escrito en parte por IA, la eficacia de la DMCA y los riesgos para empresas europeas que integran agentes de código en su día a día.

En cuestión de horas, miles de desarrolladores y expertos en seguridad de todo el mundo —incluida Europa— descargaron, analizaron y comenzaron a diseccionar el material. Más allá del impacto inmediato sobre Anthropic, el incidente abre un debate incómodo sobre seguridad, propiedad intelectual y riesgos sistémicos en un sector que se mueve a una velocidad vertiginosa.

Cómo se filtró el código de Claude Code y qué se expuso realmente

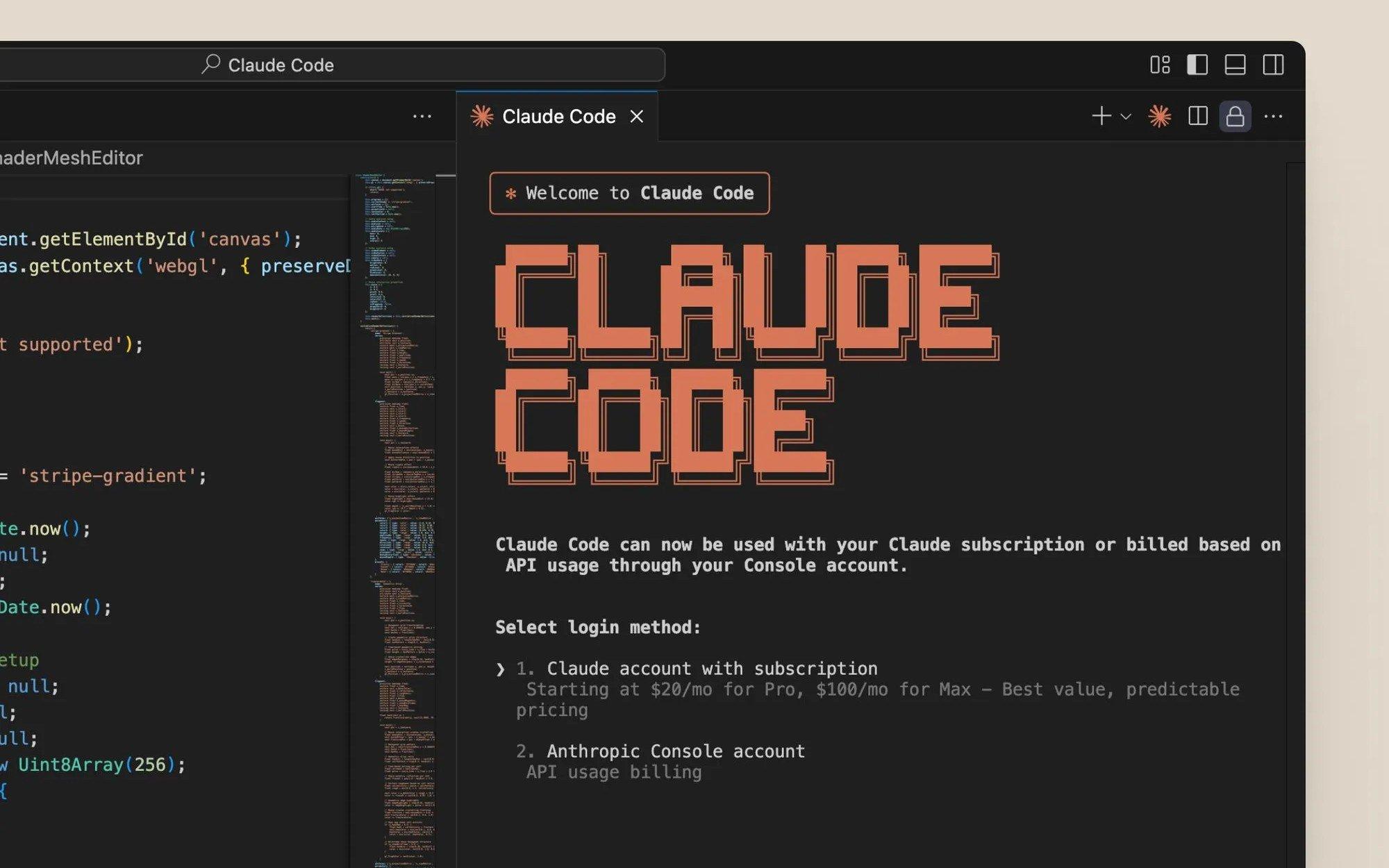

El origen del problema fue una actualización de Claude Code (versión 2.1.88) publicada en el registro npm bajo el paquete @anthropic-ai/claude-code. Entre los ficheros incluidos se coló un mapa de fuentes de JavaScript de casi 60 MB, un archivo de depuración que, bien utilizado, permite reconstruir el código original a partir del bundle minimizado que llega al usuario final.

El investigador Chaofan Shou, de Solayer Labs, fue uno de los primeros en detectar el archivo y avisar en X a primera hora de la mañana (hora de la costa este de EE. UU.). Para cuando Anthropic retiró el paquete de npm, Internet ya había replicado el contenido (consulta cómo recibir alertas automáticas cuando tus datos aparecen en una filtración): unas 512.000 líneas de código distribuidas en aproximadamente 1.900 ficheros, que corresponderían al núcleo del agente y a múltiples módulos internos.

En un comunicado remitido a medios especializados, la compañía insistió en que no se vieron comprometidos datos de clientes ni credenciales sensibles. La firma atribuye el episodio a un simple error humano en la configuración de empaquetado y sostiene que no se trató de una intrusión externa, sino de un fallo interno en el ciclo de despliegue, y subrayó la necesidad de anonimizar documentos antes de pasarlos a una IA.

Sin embargo, diversos análisis independientes apuntan a que el alcance de la filtración va bastante más allá de un desliz puntual. En paralelo a este incidente, medios como Fortune habían informado ya de miles de documentos expuestos, incluyendo referencias a modelos avanzados en desarrollo y borradores internos, lo que dibuja un patrón de fragilidad operativa en el manejo de activos críticos.

Arquitectura de Claude Code: un agente mucho más complejo de lo que parecía

Las primeras revisiones del material filtrado confirman que Claude Code está lejos de ser un simple “chat para el terminal”. El producto se apoya en un motor central de más de 46.000 líneas que se encarga de orquestar todas las interacciones con los modelos de Anthropic, gestionando acciones, comandos internos, memoria y coordinación entre agentes.

En concreto, se han identificado alrededor de 40 tipos de acciones que el agente puede ejecutar (lectura y escritura de archivos, ejecución de comandos, edición de código, gestión de repositorios, etc.) y unos 85 comandos internos especializados para tareas como revisión de cambios, integración con Git o reestructuración de proyectos. Esta estructura ayuda a explicar por qué muchos desarrolladores describían a Claude Code como un “trabajador autónomo” más que como un autocompletador sofisticado.

La filtración también destapa una estrategia de memoria en varias capas, pensada para mantener sesiones largas sin que el agente se pierda. Entre los elementos visibles destacan un índice de memoria (MEMORY.md) con referencias temáticas, un sistema de recuperación bajo demanda por tópicos y una disciplina estricta de escritura que busca reducir al mínimo las alucinaciones y las incoherencias a lo largo del tiempo.

Este diseño, ahora al desnudo, se ha convertido en un inesperado manual de arquitectura para competidores y startups europeas que están intentando construir sus propios agentes autónomos para código. Las prácticas de Anthropic —desde la orquestación de tareas hasta la limpieza de contexto— quedan documentadas con un nivel de detalle que difícilmente habría salido a la luz sin un leak de este calibre.

Funciones ocultas: Buddy, Kairos, Ultraplan y el “Modo Encubierto”

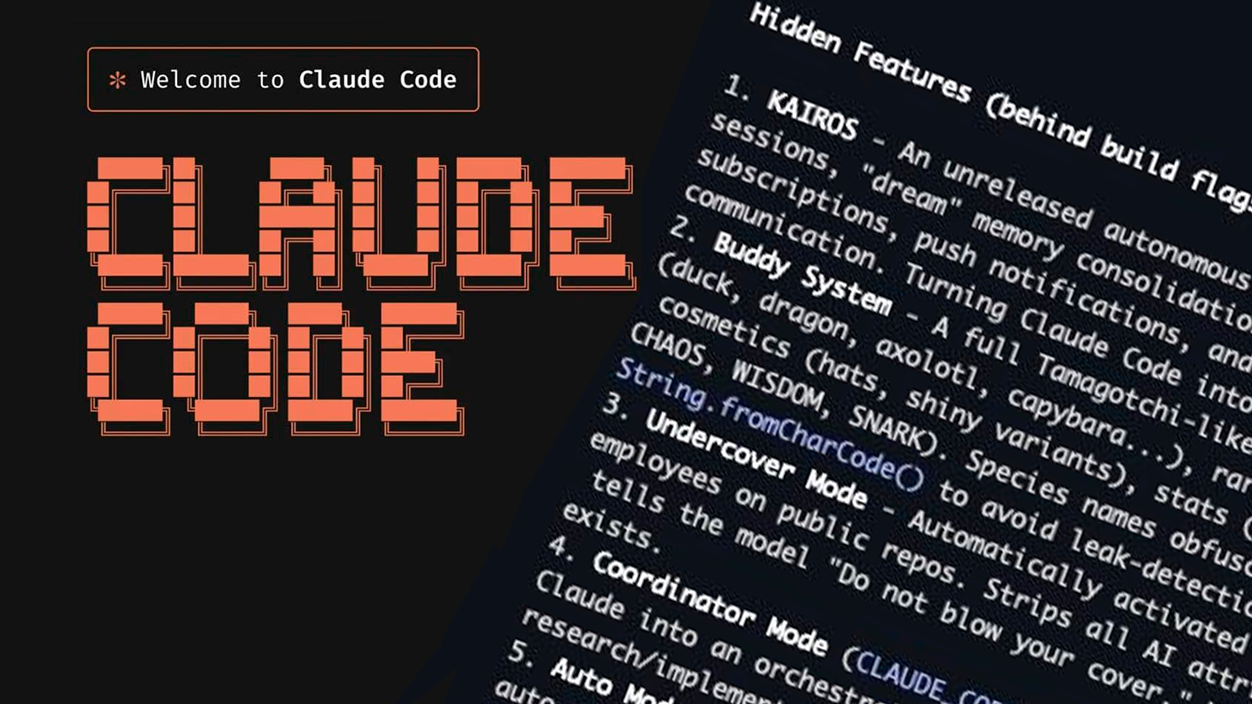

Si algo ha generado titulares en la comunidad técnica han sido las características aún no anunciadas que aparecen referenciadas en el código. La más llamativa quizá sea Buddy, una especie de mascota virtual tipo Tamagotchi integrada en la interfaz de Claude Code.

Los ficheros filtrados describen a Buddy como un acompañante que aparecería en una burbuja junto al cuadro de texto, disponible en 18 variantes (pato, dragón, ajolote, capibara, fantasma y otras criaturas) con niveles de rareza y estadísticas propias, incluyendo atributos tan curiosos como “depuración”, “paciencia”, “caos” o “sabiduría”. El plan de despliegue filtrado situaba su presentación entre el 1 y el 7 de abril, con un lanzamiento más amplio previsto para las semanas posteriores.

Otra pieza clave es Kairos, descrito como un daemon siempre activo que no espera a que el usuario escriba. Este módulo se ejecuta en segundo plano, registra eventos y decisiones a lo largo del día y realiza, durante la noche, un proceso de “sueños” o consolidación de memoria para limpiar contradicciones y reordenar el contexto de cara a la siguiente sesión de trabajo.

El código también revela Ultraplan, un modo que habilita sesiones de planificación intensiva en la nube, de hasta 30 minutos, pensado para tareas de arquitectura compleja o refactorizaciones profundas. Junto a Ultraplan aparece un modo coordinador de múltiples agentes, que permite a una instancia de Claude dirigir varias copias especializadas trabajando en paralelo sobre un mismo proyecto.

Entre las curiosidades más comentadas está el llamado “Undercover Mode” o modo encubierto, un subsistema completo destinado a evitar que Claude filtre por accidente nombres internos de proyectos, alias de modelos y referencias confidenciales al contribuir en repositorios de código abierto. Parte de los prompts del sistema incluían instrucciones explícitas del tipo: «No reveles tu identidad», algo que en foros como Hacker News dio pie a bromas sobre una IA programada para mantenerse “de incógnito”.

Modelos internos: Capybara, Fennec, Numbat y el fantasma de Mythos

Junto a las funciones ocultas de la herramienta, el leak pone sobre la mesa referencias a modelos de Anthropic aún no presentados públicamente. Entre los nombres en clave que aparecen en el código destacan Capybara, Fennec y Numbat, vinculados, según los fragmentos analizados, a variantes de la familia Claude 4.6.

Capybara figura como una variante específica de Claude 4.6, orientada presumiblemente a tareas de código y seguridad; Fennec se asocia a una versión denominada internamente Opus 4.6, mientras que Numbat aparece como un modelo todavía en fase de pruebas, sin especificaciones claras de uso final. Estas denominaciones encajan con filtraciones previas que apuntaban a un modelo avanzado bautizado internamente como Mythos, al que algunos documentos relacionaban con capacidades de razonamiento profundo y análisis de infraestructuras críticas.

Informes de medios estadounidenses han descrito Mythos/Capybara como un sistema capaz de detectar vulnerabilidades en código fuente a gran escala, diseñar exploits y ejecutar estrategias de ataque de forma casi autónoma, hasta el punto de que Anthropic habría decidido pausar o ralentizar su despliegue comercial por temor a los riesgos de ciberseguridad. La filtración de código de Claude Code, que alude a estos modelos, refuerza la percepción de que la compañía camina sobre una delgada línea entre innovación y prudencia.

Para Europa y España, donde la regulación tecnológica y la protección de infraestructuras críticas son temas especialmente sensibles, la idea de agentes con semejante capacidad ofensiva no es menor. Los reguladores comunitarios ya vigilan de cerca a los grandes modelos fundacionales, y episodios como este podrían alimentar el debate sobre limitaciones específicas a modelos con potencial de ciberrar ataque.

Consecuencias legales: DMCA, reescrituras en Python y el limbo del código generado por IA

Una vez detectado el problema, Anthropic comenzó a enviar avisos de retirada bajo la DMCA contra repositorios de GitHub y otros mirrors que alojaban directamente los archivos originales. Varias de esas copias fueron eliminadas con rapidez, pero no todas las iniciativas de la comunidad siguieron ese patrón.

Un desarrollador coreano, conocido como Sigrid Jin, decidió aprovechar la ventana de tiempo en la que el código estaba accesible para reescribir desde cero la arquitectura central en Python, utilizando una herramienta de orquestación de IA llamada oh-my-codex. El resultado fue un proyecto alternativo, apodado claw-code, que replicaba la lógica de Claude Code pero en otro lenguaje y con un código técnicamente nuevo.

Desde el punto de vista jurídico, esta jugada plantea un escenario incómodo: si la nueva base de código es una obra derivada escrita de cero, sin copiar literalmente el texto original, ¿hasta qué punto puede una reclamación DMCA obligar a retirarla? Voces como la de Gergely Orosz, autor del boletín The Pragmatic Engineer, han calificado la maniobra de “brillante o aterradora”, precisamente por su aparente resistencia a las herramientas tradicionales de retirada de contenido.

El debate se complica todavía más al considerar que parte del código original de Claude Code habría sido generado por los propios modelos de Anthropic. Los tribunales estadounidenses han avanzado recientemente hacia la idea de que el contenido creado exclusivamente por IA no goza de la misma protección automática que las obras humanas, lo que podría debilitar las reclamaciones de copyright sobre segmentos generados sintéticamente.

A todo esto se suma la dimensión de la infraestructura descentralizada. Copias del código original habrían acabado en plataformas como Gitlawb, basadas en redes distribuidas donde no existe un único punto de control. En este tipo de entornos, los avisos DMCA pierden buena parte de su eficacia: la cuestión ya no es si es posible retirar un archivo, sino cuántos mirrors hay y en qué sistemas residen.

Riesgos de seguridad para usuarios y empresas: del reverso de la arquitectura a la cadena de suministro

Más allá del bochorno reputacional, el mayor efecto práctico del incidente es que la lógica interna de Claude Code es ahora pública. Esto permite a investigadores legítimos aprender de su diseño, pero también da a potenciales atacantes un mapa muy detallado de cómo se comporta el agente, qué supuestos hace y dónde podrían existir puntos débiles.

Entre los riesgos señalados se incluyen la posibilidad de explotar flujos de acciones internas, abusar de comandos poco documentados o diseñar patrones de entrada específicos para forzar al agente a realizar operaciones no previstas. Varios expertos han subrayado que conocer al detalle la secuencia de comprobaciones, filtros y validaciones facilita el trabajo de quienes intentan saltarse esas barreras.

Al mismo tiempo, el caso ha coincidido con problemas en la cadena de suministro de software, como versiones maliciosas de dependencias ampliamente usadas (por ejemplo, variantes contaminadas de axios o librerías de cifrado). La combinación de un agente muy extendido, cuyo código está expuesto, y un ecosistema de dependencias a veces poco auditadas, dibuja un escenario complejo para equipos de ciberseguridad en empresas y administraciones públicas europeas. Por ejemplo, conviene comprobar si tu Windows 11 es vulnerable a ciertas técnicas

Los consejos que se repiten entre profesionales pasan por evitar durante un tiempo la instalación o actualización de Claude Code vía npm en entornos sensibles, migrar cuando sea posible a instaladores nativos controlados por la propia empresa y revisar con lupa versiones específicas de dependencias señaladas en los informes técnicos. Medidas como la rotación de claves, el endurecimiento de permisos y un seguimiento más estrecho de la actividad del agente se han vuelto recomendación casi obligatoria.

Este tipo de incidente también ha encendido las alarmas en departamentos de TI que ya venían preocupados por el uso masivo de herramientas de IA sin supervisión. Informes recientes apuntan a que alrededor del 70 % de empleados utiliza algún sistema de IA en el trabajo, muchas veces sin conocimiento del área de sistemas, lo que aumenta la superficie de ataque y la exposición involuntaria de código y datos corporativos. En este sentido, los riesgos de apps Android que usan IA en la nube ilustran bien los problemas de control.

Lecciones para España y Europa: velocidad, control y evaluación independiente

La experiencia de Claude Code llega en un momento en que muchas compañías españolas y europeas están incorporando agentes de código en sus flujos de desarrollo, tanto en grandes bancos y aseguradoras como en consultoras, startups y administraciones. La promesa de productividad es evidente, pero el caso Anthropic ilustra que los riesgos de seguridad y cumplimiento normativo no son un detalle secundario.

Laboratorios como F5 Labs han empezado a publicar tableros de seguimiento —AI Security Leaderboards— que evalúan periódicamente los principales modelos y agentes de IA según su exposición a ataques reales y fugas de datos. Herramientas como el Comprehensive AI Security Index (CASI) y el Agentic Resilience Score (ARS) buscan ofrecer a los responsables de seguridad métricas técnicas independientes, alejadas del ruido del marketing.

En ese contexto, el tropiezo de Anthropic se interpreta como un ejemplo de cómo la presión por sacar productos cada vez más avanzados puede dejar en segundo plano controles básicos: revisiones de empaquetado, políticas de acceso, auditorías de dependencias o procedimientos de revisión previa al despliegue. Para organizaciones que operan bajo el paraguas de normativas europeas —desde el Reglamento de IA al marco NIS2—, estos aspectos ya no son optativos.

La filtración también invita a replantear la relación entre proveedores de IA y clientes corporativos. Empresas que integran agentes como Claude Code en cadenas de desarrollo críticas empiezan a exigir no solo promesas de rendimiento, sino compromisos claros de gobernanza, transparencia y respuesta ante incidentes. Es previsible que, a partir de episodios como este, los contratos incluyan cláusulas más duras sobre notificación de fallos, auditorías externas y gestión de código sensible.

Para el ecosistema europeo de startups de IA, el caso sirve como referencia involuntaria: buena parte de las técnicas que han convertido a Claude Code en un agente puntero están ahora expuestas, pero también quedan al descubierto los costes de un error aparentemente menor. Quien quiera competir en este terreno tendrá que aprender tanto de la arquitectura como de los fallos de procedimiento que han quedado a la vista.

En conjunto, la filtración del código de Claude Code muestra hasta qué punto los agentes de programación se han vuelto infraestructura crítica de la economía digital: un solo fichero mal empaquetado ha revelado planes de producto, modelos internos, estrategias de memoria y modos secretos, al tiempo que ha activado debates legales, de seguridad y de regulación que afectan directamente a Europa. Para empresas, desarrolladores y reguladores, el episodio es un recordatorio de que la carrera por la IA no se libra solo en quién lanza antes la próxima función espectacular, sino en quién es capaz de combinar esa velocidad con un control férreo sobre el código que ya se ha convertido en el nuevo esqueleto de nuestro trabajo diario.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.