- Gemma 4 AI es una familia de modelos abiertos basada en la tecnología de Gemini, con variantes desde 2B hasta 31B parámetros.

- Está pensada para ejecutarse de forma local en móviles, dispositivos edge y estaciones de trabajo, con fuerte apuesta por la privacidad.

- Ofrece capacidades avanzadas de razonamiento, multimodalidad, agentes y generación de código, con compatibilidad con ecosistemas open source.

- Su licencia Apache 2.0 permite usos comerciales sin restricciones, abriendo oportunidades para startups y empresas en Europa y España.

La llegada de Gemma 4 AI, la nueva generación de modelos abiertos de Google DeepMind, marca un punto de inflexión en cómo entendemos la inteligencia artificial que se ejecuta directamente en nuestros dispositivos. Más allá de ser un simple modelo de texto, se trata de una familia completa de sistemas diseñados para combinar buen rendimiento, eficiencia y posibilidades de despliegue tanto en la nube como en local.

Este lanzamiento consolida la apuesta de Google por una IA más cercana al usuario, capaz de funcionar en móviles, dispositivos edge y estaciones de trabajo personales sin depender siempre de servidores remotos. Para España y Europa, donde la protección de datos y el cumplimiento normativo son claves, la combinación de ejecución local, código abierto y licencia permisiva coloca a Gemma 4 en una posición especialmente relevante para empresas, administraciones públicas y startups tecnológicas.

Qué es Gemma 4 AI y cómo se estructura su familia de modelos

Gemma 4 AI es una suite de modelos de lenguaje abiertos desarrollada por Google DeepMind y construida sobre la misma base tecnológica que Gemini 3. El objetivo es ofrecer más inteligencia por parámetro, es decir, obtener resultados competitivos con modelos más compactos y fáciles de desplegar que muchas de las alternativas cerradas de gran tamaño.

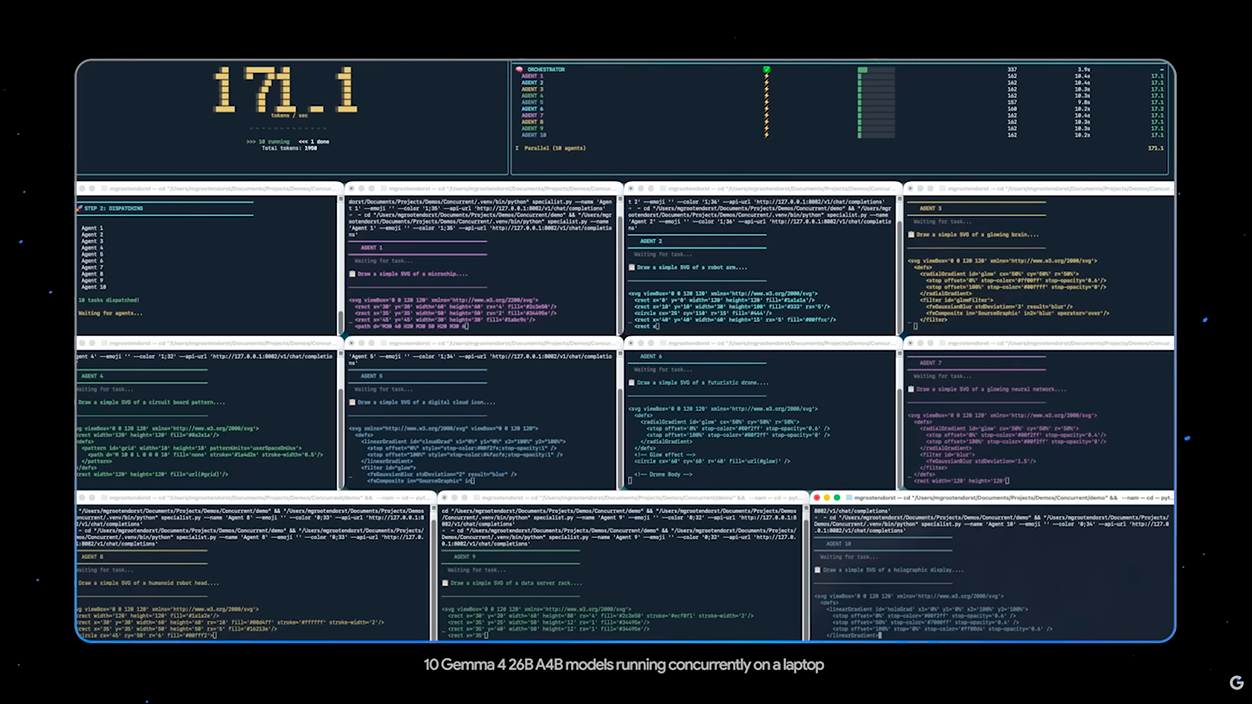

La familia se organiza en cuatro variantes principales: E2B, E4B, 26B MoE y 31B Dense. Los dos modelos Edge de menor tamaño (E2B y E4B) están pensados para ejecutarse en dispositivos con recursos limitados, incluyendo móviles, hardware embebido e incluso pequeños ordenadores como placas tipo Raspberry Pi o equipos compactos. Las versiones de 26B y 31B parámetros, por su parte, se dirigen a estaciones de trabajo potentes y servidores, situándose en la franja alta de los rankings de modelos abiertos, con el 31B entre los líderes de Arena AI.

Esta diversidad permite cubrir desde casos de uso ultra móviles hasta despliegues empresariales. En lugar de un único gran modelo, Gemma 4 propone un catálogo escalable para que desarrolladores y compañías europeas elijan la variante que mejor se ajuste a sus requisitos de coste, latencia y capacidad de cómputo.

El enfoque de Google con Gemma 4 no es solo publicar pesos abiertos, sino ofrecer un ecosistema coherente: documentación técnica unificada, herramientas de evaluación y recursos pensados para que tanto equipos pequeños como organizaciones grandes puedan integrar los modelos de forma relativamente rápida.

Ejecución local: IA on-device en móviles, edge y ordenadores personales

Uno de los aspectos más llamativos de Gemma 4 es su énfasis en la ejecución on-device, es decir, directamente en el dispositivo del usuario. Los modelos Edge E2B y E4B han sido optimizados para funcionar con baja latencia en smartphones Android recientes, dispositivos edge y equipos con memoria limitada, manteniendo un consumo de energía contenido.

En el ecosistema de Google, la pieza clave para acercar Gemma 4 al usuario final es la aplicación Google AI Edge Gallery, disponible para iOS y Android. A través de esta app, es posible descargar e instalar los modelos Gemma 4 compatibles y utilizarlos sin conexión a internet. De esta manera, las funciones de asistente, análisis de texto, resumen de documentos o interpretación básica de imágenes se realizan íntegramente en el teléfono.

La idea es que muchas tareas cotidianas de IA —resumir un informe, responder dudas sobre un archivo, traducir contenido o generar borradores de texto— se puedan resolver sin enviar datos a la nube. Para usos más exigentes o modelos de mayor tamaño, sigue siendo posible recurrir a servidores locales, centros de datos propios o nubes públicas, pero la capa diaria de interacción se queda en el dispositivo.

En pruebas reales con Gemma 4 E4B sobre teléfonos con aceleradores de IA, la experiencia se acerca bastante a la de un asistente conectado a la nube en tareas de uso diario. No sustituye por completo a modelos de frontera para razonamientos muy complejos, pero cubre gran parte de las necesidades habituales sin penalizar privacidad ni depender de la calidad de la conexión móvil.

Capacidades avanzadas: razonamiento, código, agentes y multimodalidad

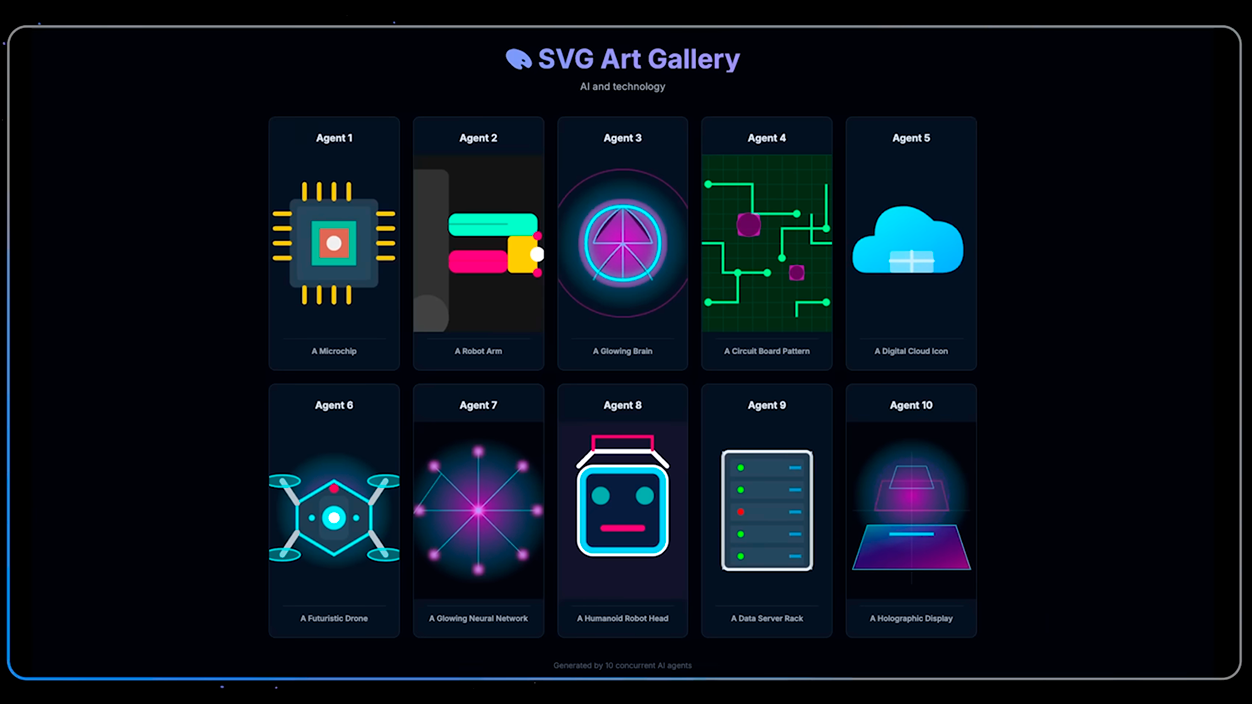

Más allá del tamaño, Gemma 4 introduce mejoras técnicas relevantes en varias áreas. En primer lugar, se ha reforzado el razonamiento multietapa, lo que le permite abordar problemas que requieren cadenas de pasos lógicos, planificación y análisis detallado de contextos largos, incluyendo escenarios de agentes autónomos y flujos de trabajo encadenados.

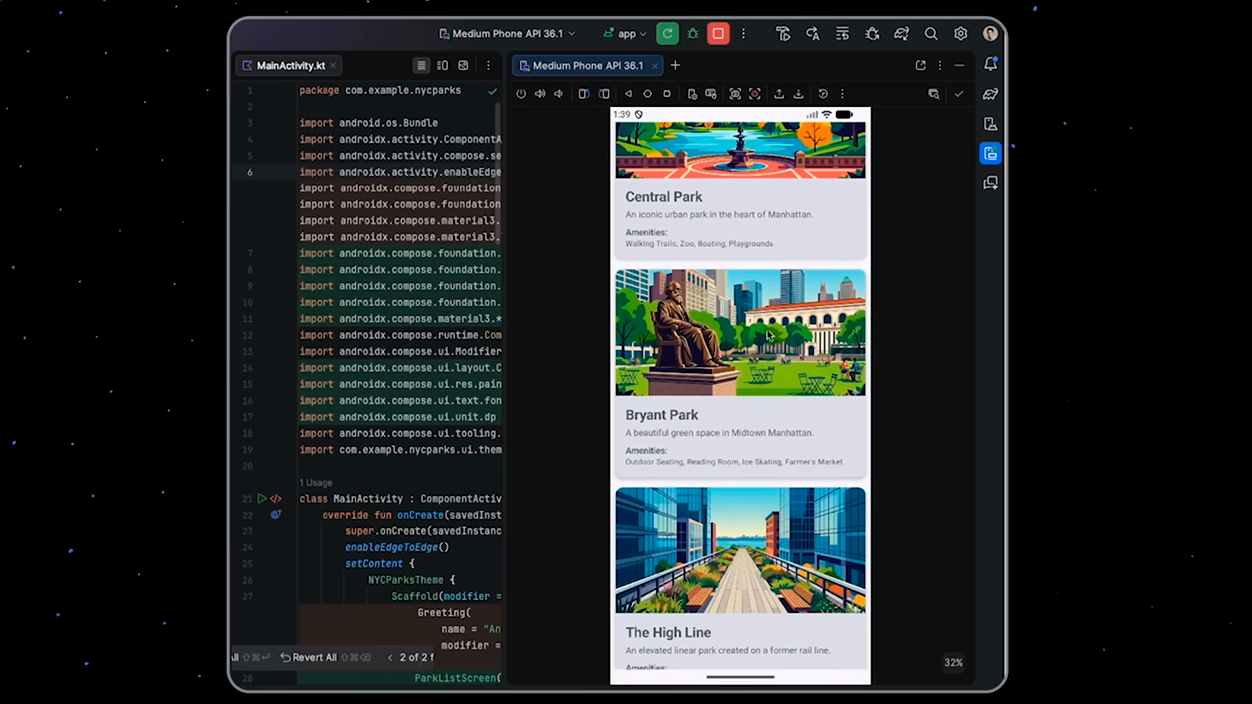

En el terreno del desarrollo de software, Gemma 4 incorpora capacidades avanzadas de generación de código offline. Esto permite a programadores y equipos técnicos trabajar con asistentes de programación que sugieren funciones, explican fragmentos de código o ayudan en la depuración, incluso cuando no hay conexión a internet, siempre que el modelo se ejecute en local.

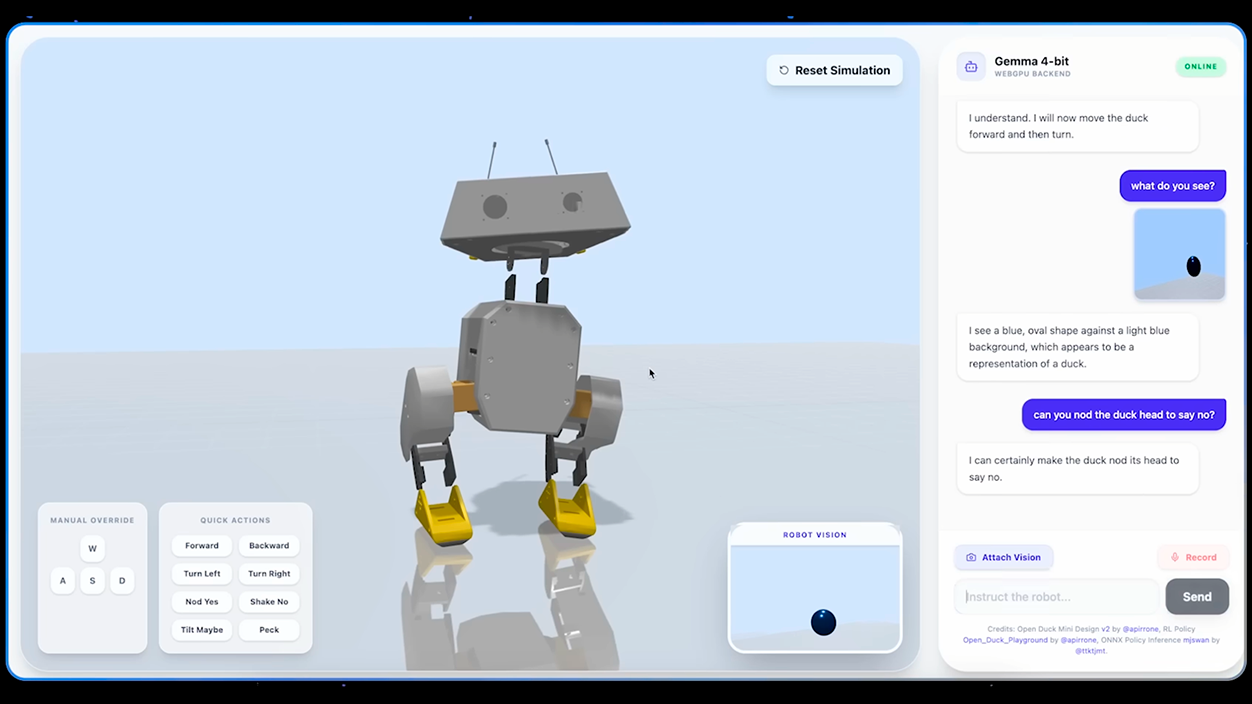

Otro punto clave es el soporte nativo para llamadas a funciones e integración con APIs. Mediante salidas estructuradas en JSON, los modelos pueden interactuar con servicios externos, ejecutar acciones concretas en aplicaciones o activar componentes de software sin necesidad de capas adicionales muy complejas. Esto facilita la creación de agentes que no solo respondan, sino que también actúen en nombre del usuario.

Gemma 4 es, además, un modelo multimodal: puede procesar texto, imagen, vídeo y audio en distintas combinaciones, lo que abre la puerta a soluciones de productividad que mezclan documentos, capturas de pantalla, fotografías, grabaciones de voz e incluso clips de vídeo. Esta capacidad resulta especialmente interesante para sectores como media, educación, formación corporativa o análisis de datos visuales.

Ventanas de contexto amplias y soporte multilingüe global

Una de las mejoras técnicas más visibles es la ampliación de la ventana de contexto hasta 256K tokens en las variantes más avanzadas. En la práctica, esto permite trabajar con documentos extensos, hilos de conversación largos, repositorios de código o conjuntos de datos descriptivos sin tener que fragmentarlos constantemente.

En entornos europeos, donde abundan los documentos normativos extensos, contratos complejos o informes técnicos largos, esta amplitud de contexto facilita tareas como resumir legislación, comparar versiones de contratos o extraer puntos clave de dossieres completos sin perder coherencia.

Gemma 4 también se ha diseñado con una clara orientación global: ofrece soporte para más de 140 idiomas, incluyendo el español y otras lenguas usadas en España y la Unión Europea. Esto permite crear asistentes y herramientas alineadas con los matices lingüísticos locales, algo especialmente útil para atención al cliente, formación y servicios públicos.

Para empresas con presencia en varios países europeos, disponer de un único modelo capaz de adaptarse a múltiples idiomas facilita mantener una experiencia de usuario coherente sin depender de infraestructuras separadas por idioma o región, y reduce el esfuerzo de mantenimiento de sistemas multilingües.

Integración con ecosistemas open source y herramientas de desarrollo

Gemma 4 se ha lanzado con un claro enfoque en la compatibilidad con herramientas y plataformas abiertas. Los modelos se pueden usar con LM Studio, Ollama, Hugging Face, Docker y frameworks de machine learning como TensorFlow, PyTorch o JAX, lo que simplifica la adopción para desarrolladores que ya trabajan con estas tecnologías.

La colaboración de Google con Hugging Face es especialmente relevante, ya que facilita que desde el primer día los modelos Gemma 4 estén accesibles, documentados y listos para pruebas, fine-tuning y despliegue en infraestructuras on-premise o en nubes populares. Para equipos técnicos europeos, acostumbrados a ecosistemas abiertos y a requisitos regulatorios exigentes, este enfoque encaja bien con las necesidades de auditoría y control.

En el ámbito del ordenador personal, Gemma 4 puede ejecutarse en estaciones de trabajo con GPUs NVIDIA u otros aceleradores, así como en máquinas más modestas para las variantes ligeras. Esto hace viable que pequeñas empresas o equipos de innovación dentro de organizaciones públicas experimenten con IA avanzada sin tener que hacer grandes inversiones en hardware especializado.

Para quienes prefieren soluciones empaquetadas, la compatibilidad con contenedores Docker y herramientas como Ollama simplifica la puesta en marcha de entornos de prueba en cuestión de minutos, tanto en Linux como en Windows y macOS, algo útil para pilotos internos o laboratorios de IA corporativos.

Privacidad, cumplimiento normativo y ventaja de la ejecución offline

En Europa, donde el RGPD y las normativas de protección de datos condicionan el despliegue de soluciones basadas en IA, la posibilidad de ejecutar Gemma 4 directamente en el dispositivo o en infraestructuras locales controladas se convierte en un argumento de peso. Al evitar el envío sistemático de información sensible a servidores externos, se reducen riesgos y se simplifica la gestión del cumplimiento.

La ejecución completamente offline ofrece además ventajas prácticas claras: la IA sigue funcionando en situaciones de falta de conectividad (viajes, zonas rurales, edificios con mala cobertura), y las respuestas suelen ser más rápidas al eliminar la latencia de red. En algunos casos, el consumo energético también mejora, con reducciones de hasta un 60 % respecto a generaciones anteriores en determinados escenarios de uso móvil.

Para sectores sensibles como salud, educación, banca o administración pública en España, este enfoque permite diseñar aplicaciones que trabajan con datos altamente confidenciales sin que abandonen el perímetro de la institución o el dispositivo del paciente, alumno o ciudadano. Esto encaja con las directrices europeas sobre seguridad, soberanía digital y uso responsable de la IA.

Además, el hecho de poder seleccionar exactamente qué se ejecuta en local y qué se delega a la nube permite plantear arquitecturas híbridas en las que solo determinados procesos muy complejos o costosos se deriven a infraestructuras remotas, manteniendo el grueso de las interacciones en el entorno local.

Licencia Apache 2.0 y oportunidades para startups y empresas europeas

Un elemento central de Gemma 4 AI es su licencia Apache 2.0, considerada una de las más permisivas dentro del ecosistema open source. Esta licencia permite usos comerciales, modificaciones y redistribución, siempre que se respeten las condiciones básicas de atribución y avisos de licencia, sin imponer restricciones fuertes sobre cómo integrar el modelo en productos o servicios.

Para startups europeas, esto significa que pueden monetizar soluciones basadas en Gemma 4 sin pagar licencias de uso del propio modelo, centrando los costes en infraestructura, desarrollo y mantenimiento. También permite crear soluciones verticales adaptadas a sectores regulados —finanzas, seguros, salud— en las que el control sobre el flujo de datos y el entorno de ejecución es determinante.

El carácter open-weight, que pone a disposición los pesos del modelo, facilita procesos de fine-tuning y especialización con datos propios, algo clave para compañías que necesitan asistentes entrenados con su terminología interna, bases documentales específicas o contenidos corporativos. Esto es aplicable tanto a pymes como a grandes grupos empresariales con presencia multinacional.

En el contexto español, donde el tejido emprendedor tecnológico convive con grandes empresas tradicionales en plena digitalización, Gemma 4 ofrece una vía para desarrollar productos de IA competitivos manteniendo soberanía tecnológica, ajustando costes y cumpliendo con las exigencias regulatorias europeas sin depender por completo de modelos cerrados de proveedores externos.

El panorama que dibuja Gemma 4 AI es el de una inteligencia artificial más distribuida, abierta y controlable, que combina ejecución local, capacidades avanzadas de razonamiento y una licencia flexible para que tanto startups como organizaciones consolidadas en España y Europa puedan explorar nuevos casos de uso, automatizar procesos y crear servicios más inteligentes sin renunciar al control de sus datos ni a la transparencia tecnológica.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.