- OpenAI y Jony Ive trabajan en un dispositivo de IA compacto y sin pantalla, pensado como tercer dispositivo junto al móvil y el portátil.

- El gadget se basará en ChatGPT, será consciente del contexto del usuario y priorizará la voz y los sensores frente a la interacción táctil.

- El lanzamiento apunta a partir de 2027, con producción fuera de China y una estrategia para distribuir decenas de millones de unidades.

- Este proyecto desafía el modelo de Apple y Google, y se enmarca en una ofensiva más amplia de OpenAI para dominar la IA física.

El supuesto “smartphone OpenAI” está generando un revuelo enorme pese a que, irónicamente, todo apunta a que no será un móvil como tal. La alianza de Sam Altman con Jony Ive, el histórico diseñador de Apple, ha encendido todas las alarmas en el sector: OpenAI quiere llevar ChatGPT fuera de la pantalla y meterlo en un dispositivo físico propio, capaz de acompañarte a todas partes como un compañero de IA siempre presente.

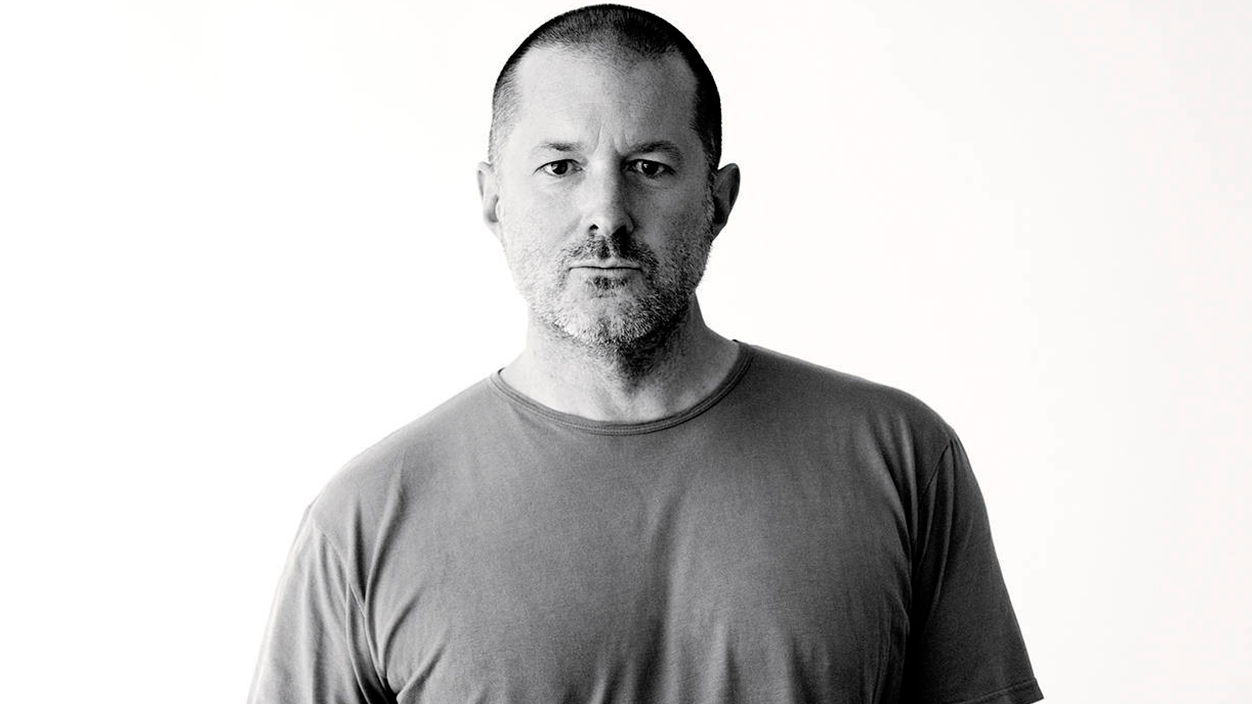

En las últimas horas se ha confirmado la compra de la empresa de Jony Ive (io) por parte de OpenAI, por unos 6.400-6.500 millones de dólares, un movimiento que no es solo una operación millonaria más entre grandes tecnológicas. Es, en la práctica, la llave que permite a OpenAI entrar de lleno en el mundo del hardware y preparar una nueva categoría de dispositivo, que muchos ya llaman de forma genérica “AI companion”, y que algunos usuarios buscan bajo el término “smartphone OpenAI”.

Un dispositivo con OpenAI y Jony Ive: contexto de un fichaje histórico

La colaboración entre Ive y OpenAI no nace como un simple proyecto de diseño, sino como una alianza estratégica de largo recorrido. Jony Ive, responsable de iconos como el iPod, el iPhone o el Apple Watch, fundó la firma creativa LoveFrom y la start-up de hardware io. OpenAI ha decidido adquirir io e integrar a Ive como cabeza visible del diseño de todos sus futuros productos físicos.

Sam Altman ha definido esta unión como “la oportunidad de hacer lo más grande” que ha afrontado nunca OpenAI. Según filtraciones internas recogidas por medios como The Wall Street Journal y The Information, la compañía ve en este dispositivo -y en la familia de productos que puede derivarse de él- una posible fuente de hasta un billón de dólares en valor añadido a medio plazo, en un contexto en el que OpenAI no espera ser rentable hasta cerca de 2029 y prevé acumular grandes pérdidas en el camino.

El objetivo declarado es desarrollar una nueva generación de ordenadores impulsados por IA, una familia de dispositivos que cambie la forma en la que nos relacionamos con la inteligencia artificial. La idea no es solo poner ChatGPT en otro cacharro, sino reimaginar la relación entre persona, entorno y asistente inteligente, con un diseño discreto, centrado en la voz y la comprensión del contexto real del usuario.

No será un móvil: por qué no es un “smartphone OpenAI” al uso

Uno de los pocos puntos en los que tanto Altman como Ive han sido tajantes es que no están diseñando un teléfono móvil tradicional. Aunque mucha gente lo busque como “smartphone OpenAI”, el propio CEO de OpenAI ha repetido en varias ocasiones que la compañía no quiere hacer “otro smartphone más”, sino algo distinto de lo que ya tenemos en el bolsillo.

La visión de Altman es que el paradigma actual está agotado: para hablar con la IA hoy tienes que sacar un portátil o el móvil, abrir el navegador o la app, escribir o tocar varias veces y esperar respuesta. En su opinión, eso limita el potencial de una “inteligencia mágica en la nube” como ChatGPT. La ambición es eliminar parte de esa fricción creando un dispositivo que siempre esté listo, te entienda de forma natural y pueda actuar teniendo en cuenta lo que pasa a tu alrededor.

Por eso, la idea no es “matar al móvil”, sino crear una tercera categoría de producto, un complemento que conviva con el smartphone y el ordenador portátil. Altman lo describe como ese tercer objeto que pones sobre la mesa junto al portátil y el teléfono, pero con una relación muy diferente con el usuario: menos pantalla, menos toques, más conversación y contexto.

Un proyecto envuelto en secretismo: lo poco (y lo mucho) que se sabe

Oficialmente, la información confirmada se limita básicamente a una carta conjunta de Altman e Ive publicada en la web de OpenAI y a algunos comentarios en eventos y reuniones internas. A partir de ahí, la mayoría son filtraciones y análisis de insiders como Ming-Chi Kuo o M.G. Siegler, pero todas las piezas empiezan a encajar en una misma dirección.

Sam Altman ha dejado claro que el secretismo es estratégico. Considera que el dispositivo es lo bastante singular como para que los competidores se apresuren a copiarlo si se filtra antes de tiempo. Por eso, no quieren enseñar prototipos en público ni desvelar detalles clave hasta estar muy cerca del lanzamiento comercial, aunque internamente ya se han mostrado bocetos y demos a empleados.

En paralelo, OpenAI ya ha contactado con fabricantes y proveedores para planificar la producción. Su intención no es distribuir literalmente 100 millones de unidades el primer día, pero sí llegar a esa cifra más rápido que ninguna otra compañía al lanzar una nueva categoría de producto, algo que encaja con las expectativas gigantes que manejan para este AI companion.

Diseño y factor forma: del “no wearable” al tamaño Tamagotchi

Uno de los aspectos más curiosos es que Jony Ive nunca ha sido especialmente entusiasta de los wearables clásicos como relojes o gafas inteligentes incrustadas en el cuerpo. Informaciones filtradas indican que Ive se ha mostrado escéptico con gafas tipo Google Glass o con productos demasiado intrusivos físicamente.

Por eso, todo apunta a que el dispositivo de OpenAI no será un reloj, ni unas gafas, ni un móvil. Diversos rumores coinciden en que estaríamos ante un gadget pequeño, de tamaño similar a un Tamagotchi o incluso a un iPod Shuffle, con un diseño compacto y elegante marca de la casa Ive. Se habla de un objeto que podrías llevar colgado del cuello, guardado en el bolsillo o colocado sobre la mesa junto al portátil y el smartphone.

El analista Ming-Chi Kuo ha llegado a detallar que el prototipo actual sería ligeramente más grande que el Humane AI Pin, con un acabado minimalista y sin pantalla. Este enfoque sin panel táctil es toda una declaración de intenciones: liberar al usuario de otra pantalla más y apostar por la voz, el audio y la percepción visual como canales principales de interacción.

Aunque no haya pantalla, las filtraciones sugieren que sí contaría con cámaras y micrófonos integrados para comprender el entorno, capturar imágenes o vídeo bajo demanda y escuchar al usuario en cualquier momento. A nivel de conectividad, todo indica que se apoyará en Bluetooth y quizá WiFi para enlazarse con el móvil y el portátil, que seguirán siendo los dispositivos donde verás contenido más complejo o realizarás acciones que requieran interfaz gráfica.

Cómo funcionaría: un compañero de IA siempre a tu lado

El corazón del proyecto es convertir a ChatGPT en un compañero de IA omnipresente, un asistente que no se limite a contestar preguntas sueltas, sino que entienda tu día a día y actúe con contexto. Para eso, el dispositivo necesita algo más que un micrófono: requiere sensores y capacidad de “ver” y “oír” constantemente lo que ocurre alrededor.

Los planes filtrados hablan de capturar información del entorno de forma continua (o al menos frecuente): qué estás haciendo, dónde estás, con quién hablas, qué hay en la habitación. Esto permitiría que la IA no solo responda a tus comandos, sino que también pueda sugerir acciones, avisarte de algo importante o filtrar notificaciones de forma mucho más inteligente.

OpenAI ha reorganizado equipos de ingeniería, producto e investigación para reforzar sus modelos de audio y voz, lo que encaja con que la interfaz principal vaya a ser la conversación. Se espera que puedas hablarle al dispositivo, recibir respuestas por voz a través de un pequeño altavoz o de tus auriculares, e incluso usar gestos mínimos o toques básicos en el propio gadget para activar funciones rápidas.

Entre las ideas que circulan está la capacidad de entender el contexto real de tu actividad: cuántos pasos das, si estás caminando, si estás sentado trabajando, si estás en una reunión o en un restaurante. Con esto, el AI companion podría decidir cuándo es buen momento para interrumpirte, cómo presentarte la información o cuándo esperar a que estés libre para proponerte algo.

Más allá del dispositivo principal: altavoz, gafas y hasta una lámpara

La estrategia de OpenAI no se limitaría a un único aparato. Según The Information, hay más de 200 ingenieros trabajando en varios proyectos de hardware relacionados: un altavoz inteligente, unas posibles gafas con IA y hasta una lámpara con capacidades avanzadas.

El altavoz sería una especie de evolución del asistente de voz tradicional, pero con cámara integrada capaz de reconocer objetos, entender qué ocurre en una habitación e incluso identificar rostros. Entre las funciones que se barajan está la posibilidad de usar reconocimiento facial para autorizar pagos, de forma similar a Face ID en los iPhone.

Las gafas inteligentes irían más allá en cuanto a superponer información y ayudar en tareas del día a día, pero los planes son a más largo plazo. Los rumores hablan de una ventana temporal en torno a 2028 para este tipo de producto, y de prototipos de lámparas con IA que podrían haberse desarrollado internamente sin garantías de llegar al mercado.

Todo este ecosistema, si termina saliendo adelante, dibuja una apuesta clara por la “IA física” integrada en el hogar y en la vida diaria, en línea con lo que grandes actores como Nvidia o Amazon están impulsando: que la inteligencia artificial abandone la mera app en el móvil y se convierta en algo tangible y ubicuo.

Fechas de lanzamiento y producción: de los primeros anuncios a 2027

En los primeros compases del proyecto, Altman llegó a sugerir internamente que podríamos ver el nuevo dispositivo a partir de la segunda mitad de 2026, con intención de empezar a producir y distribuir decenas de millones de unidades en un tiempo récord.

Sin embargo, documentos judiciales y filtraciones más recientes apuntan a que el lanzamiento se retrasará al menos hasta febrero de 2027. Entre las causas se encontrarían problemas para definir la “personalidad” del dispositivo, cómo se va a gestionar la privacidad de los datos que recopila continuamente y qué infraestructura de computación se necesita detrás para que todo funcione con la fluidez que se promete.

También se ha mencionado que la producción en masa podría iniciarse en 2027 fuera de China, con Vietnam como una de las candidatas más fuertes. Esto no solo responde a cuestiones logísticas y de costes, sino también a la creciente tensión geopolítica y a la necesidad de diversificar la cadena de suministro en tecnología de alto valor añadido.

En cuanto al nombre comercial, parece descartado que el aparato se llame “io” por un conflicto de marca con una empresa de audífonos llamada iYo. Así que, de momento, solo se habla de “OpenAI device”, “AI companion” o directamente se le asocia erróneamente con la idea de un “smartphone OpenAI”.

Por qué OpenAI se mete en hardware: estrategia, dinero y narrativa

Detrás de este salto al hardware hay una combinación de ambición tecnológica y necesidad de negocio. Por un lado, la IA generativa ya está integrada en mil herramientas, pero casi siempre como software secundario. El siguiente paso lógico para OpenAI es darle un cuerpo propio, un dispositivo que saque partido de la IA 24/7 y que demuestre lo que puede hacer más allá de un navegador.

Por otro lado, el modelo actual de OpenAI, basado en suscripciones, licencias de API y acuerdos empresariales, no basta para sostener las inversiones gigantes en infraestructura y desarrollo. Un dispositivo de consumo masivo abre la puerta a una nueva fuente de ingresos: venta de hardware, servicios asociados, posibles planes premium y, en definitiva, un ecosistema propietario al estilo de lo que Apple logró con el iPhone.

Altman ha llegado a plantear que la adquisición de io podría aportar hasta un billón de dólares de valor adicional a la compañía a largo plazo. En un escenario en el que se espera que OpenAI pierda decenas de miles de millones antes de ser rentable, el hardware se convierte casi en una apuesta obligada si quiere mantenerse competitiva frente a gigantes como Google o Amazon, que controlan tanto el software como los dispositivos.

Además, el anuncio de la alianza con Jony Ive no fue casual en cuanto a su calendario. Analistas como Ming-Chi Kuo señalan que se hizo coincidir deliberadamente con el Google I/O, la gran conferencia de desarrolladores de Google, en la que la compañía mostró una integración muy profunda de la IA en todo su ecosistema. Sin un sistema operativo propio en móviles, OpenAI necesita otro “relato” que le permita seguir siendo protagonista, y el nuevo dispositivo es una forma potente de conseguirlo.

Cómo quiere cambiar la interacción con la tecnología: menos Times Square, más cabaña en el lago

Altman ha utilizado una metáfora muy gráfica para explicar lo que no le gusta de los dispositivos actuales. Dice que usar móviles y ordenadores hoy es como caminar por Times Square: luces que parpadean, ruido constante, notificaciones que te asaltan, gente chocando contigo. Un entorno caótico que, según él, no favorece una vida tranquila ni una relación sana con la tecnología.

El objetivo del AI companion de OpenAI sería ofrecer una experiencia más parecida a estar en una cabaña tranquila junto a un lago, donde solo pasa lo importante y en el momento adecuado. Para lograrlo, el dispositivo filtraría información por ti, decidiría cuándo hablarte y cuándo callar, y aprendería poco a poco a ganarse tu confianza gestionando tu atención con cuidado.

Esta visión implica un cambio profundo: pasar de dispositivos centrados en pantallas y toques a un objeto sin pantalla, que se comunica por voz y mediante señales contextuales. Donde ahora tienes que abrir ChatGPT manualmente, la idea es que simplemente le hables o, incluso, que el propio aparato se adelante a algunas de tus necesidades sin pedir permiso cada vez.

Comparación con Humane AI Pin, Rabbit R1 y otros intentos fallidos

No es la primera vez que alguien intenta crear un dispositivo dedicado a la IA que pretenda ir más allá del móvil. Humane AI Pin y Rabbit R1 se adelantaron con propuestas similares: gadgets pequeños, de bolsillo o solapa, orientados a interactuar con asistentes inteligentes sin necesidad de sacar el teléfono.

El problema es que ambos productos terminaron siendo fracasos comerciales. En buena medida, porque gran parte de lo que ofrecían se podía conseguir con cualquier app de chatbot y un móvil en el bolsillo, sin pagar un nuevo hardware caro ni asumir la limitación de un aparato tan de nicho.

Jony Ive ha sido especialmente crítico con estos intentos, calificándolos de “productos pobres” y carentes de ideas verdaderamente nuevas. Su intención con OpenAI sería justo lo contrario: que el dispositivo no se limite a replicar lo que ya hace una app, sino que aporte algo diferencial gracias a su diseño, a la integración total con ChatGPT y a ese enfoque radical en la voz y el contexto.

Ming-Chi Kuo señala que el aparato de OpenAI sería algo mayor que Humane AI Pin y con cierto aire al iPod Shuffle, pero sin pantalla y sin la vocación de sustituir al smartphone. Esa combinación de forma reconocible, uso manos libres y fuerte personalidad de la IA es lo que, sobre el papel, podría marcar la diferencia frente a los primeros AI companions que no cuajaron.

Un nuevo desafío para Google y un problema añadido para Apple

El movimiento de OpenAI se interpreta también como un golpe directo al modelo de negocio de Apple y Google, profundamente basados en pantallas e interfaces táctiles. Si triunfa un dispositivo centrado en la voz, sin pantalla y con una IA que filtra e intermedia todo, parte del protagonismo de iOS y Android se diluiría a favor del asistente de OpenAI.

Apple se encuentra en una posición incómoda. Por un lado, va claramente retrasada en la carrera pública de la IA generativa. Por otro, depende como pocas compañías de los ingresos del iPhone, que verían amenazado su papel central si una parte importante de la interacción diaria con la tecnología pasa a un AI companion externo. Además, la presión de nuevos aranceles y tensiones comerciales añade incertidumbre al futuro del móvil estrella de la compañía.

No es casual que se espere que Apple mueva ficha en IA en eventos como la WWDC, donde podría presentar mejoras profundas de Siri, nuevas funciones basadas en modelos generativos y quizá alguna pista de cómo piensa responder a un mundo donde el dispositivo clave no tiene por qué ser un teléfono con pantalla.

En conjunto, todo este proyecto de dispositivo tipo “smartphone OpenAI” -aunque no vaya a ser un smartphone propiamente dicho- refleja un intento serio de redefinir cómo nos relacionamos con la IA y con la tecnología cotidiana: un objeto pequeño, probablemente sin pantalla, centrado en la voz y en la comprensión de nuestro entorno, que se apoye en ChatGPT como cerebro, conviva con móvil y ordenador como un tercer dispositivo imprescindible y abra la puerta a una familia completa de gadgets de IA física que compitan, de tú a tú, con el dominio actual de Apple, Google y el resto de gigantes.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.