- Las alternativas modernas a Codex van mucho más allá del autocompletado y abarcan agentes, IDEs y CLIs capaces de entender repositorios completos y automatizar tareas complejas.

- Modelos como Claude Sonnet 4.5, Opus 4.6, GPT‑5.3‑Codex, Kimi K2.5 o GLM‑4.7 ofrecen distintos equilibrios entre potencia, coste, apertura y posibilidad de ejecución local.

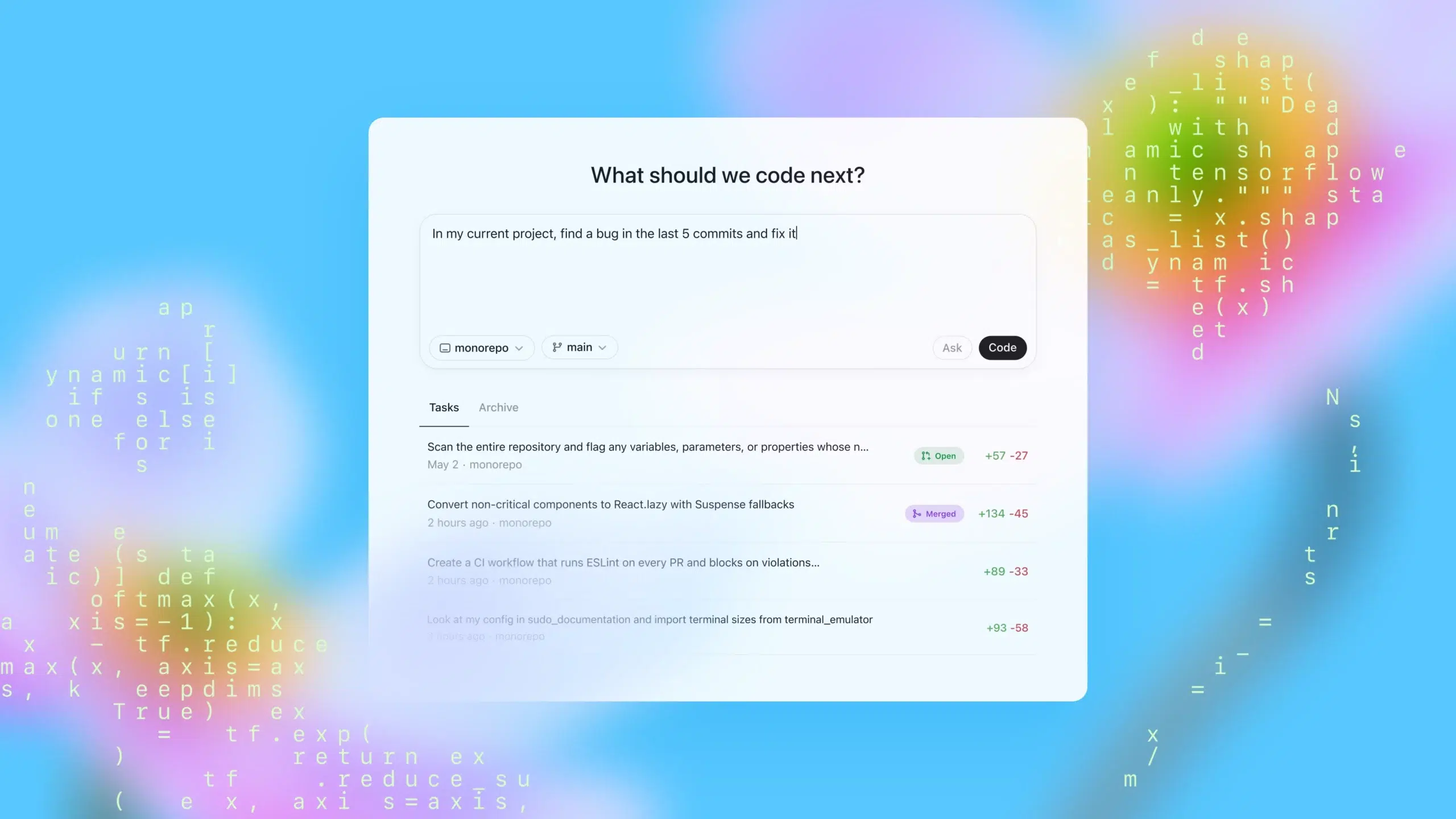

- Herramientas como GitHub Copilot, Claude Code, Cursor, Aider o eesel AI muestran cómo la capa herramienta y los agentes especializados se adaptan tanto a desarrollo como a soporte técnico.

- La clave ya no es una única “mejor IA”, sino elegir la combinación de modelos y herramientas que encaje con tu flujo de trabajo, tu stack tecnológico y tus requisitos de seguridad.

Buscar alternativas a Codex para programar con IA ya no va de encontrar un simple autocompletado de código: va de elegir agentes completos capaces de leer repositorios enteros, abrir pull requests y, en muchos casos, ejecutar tareas de desarrollo casi de forma autónoma. El ecosistema se ha llenado de asistentes, IDEs con IA integrada, CLIs súper potentes y modelos open source que puedes correr en tu propia GPU.

Si te sientes un poco abrumado, es normal: hoy conviven modelos propietarios como GPT‑5.3‑Codex u Opus con gigantes open source como Kimi K2.5 o GLM‑4.7 y con herramientas de desarrollador como Claude Code, Cursor, Copilot o Aider. Además, la cosa ya no va solo de escribir código: también hablamos de seguridad, cumplimiento, despliegue on‑premise, trabajo multi‑agente y hasta de agentes que gestionan tu equipo de soporte.

Qué entendemos hoy por “alternativas a Codex”

Para situarnos, hay que distinguir dos cosas: el Codex original que alimentaba el primer GitHub Copilot (ya retirado) y todo lo que hoy se mete en el mismo saco cuando alguien dice “Codex”: agentes del ecosistema OpenAI orientados a desarrollo (como GPT‑5.3‑Codex) o herramientas tipo “Codex CLI” que viven en la terminal. Llamamos alternativas a cualquier solución de IA que te ayude a escribir, revisar, refactorizar, entender y automatizar código: desde modelos base hasta herramientas concretas integradas en tu IDE o tu CLI.

La gracia está en que ya no se trata solo de programar más rápido. Los nuevos asistentes y agentes de código entienden repositorios completos, coordinan sub‑agentes, ejecutan pruebas, tocan múltiples archivos a la vez y suelen integrarse con Git, CI/CD o help desks. Mientras los devs disfrutan de estos superpoderes, muchos equipos de soporte siguen en el carril lento, con herramientas de hace diez años. Esa brecha también se está empezando a cerrar con agentes especializados para atención al cliente técnica.

Cómo evaluar alternativas a Codex: criterios que importan de verdad

No tiene sentido elegir herramienta solo por hype o por un benchmark aislado. Cuando comparas opciones, lo que realmente marca la diferencia en el día a día suele ser algo bastante más mundano:

- Ajuste al flujo de trabajo: ¿La herramienta vive donde tú trabajas (IDE, terminal, navegador, GitHub) o te obliga a saltar entre ventanas?

- Conciencia de la base de código: ¿Tiene contexto de todo el repo o solo ve el archivo actual? ¿Puede tocar varios ficheros, abrir PRs, refactorizar proyectos enteros?

- Capacidades de agente: ¿Le puedes soltar “actualiza este microservicio a la nueva API” y dejarle trabajar con un plan razonado, o se limita a generar fragmentos sueltos?

- Flexibilidad de modelos: ¿Estás atado a un único LLM o puedes enchufar modelos de Anthropic, OpenAI, Google, Meta o tus propios modelos locales via API (Ollama, etc.)?

- Seguridad y cumplimiento: ¿Tiene SOC 2, ISO/IEC 42001, opciones de auto‑hosting, CMEK, aislamiento de datos y políticas claras de no‑entrenamiento con tu código? riesgos de copiar documentos en un chatbot

- Precio y límites: ¿Tarifa plana por asiento, créditos, pago por token, planes free reales o todo a base de “pruebas” muy limitadas que cortan tu flujo?

Si te pasas por Reddit o Hacker News verás un patrón claro: la gente pide herramientas open source, locales y agnósticas de modelo, que no te aten a un único proveedor y te dejen controlar datos y costes. Al mismo tiempo, las empresas grandes buscan certificaciones, controles de seguridad y modelos que escalen con bases de código gigantes y fuertes requisitos de cumplimiento.

Los grandes asistentes de programación: “la capa herramienta”

GitHub Copilot: el estándar integrado en el ecosistema Microsoft

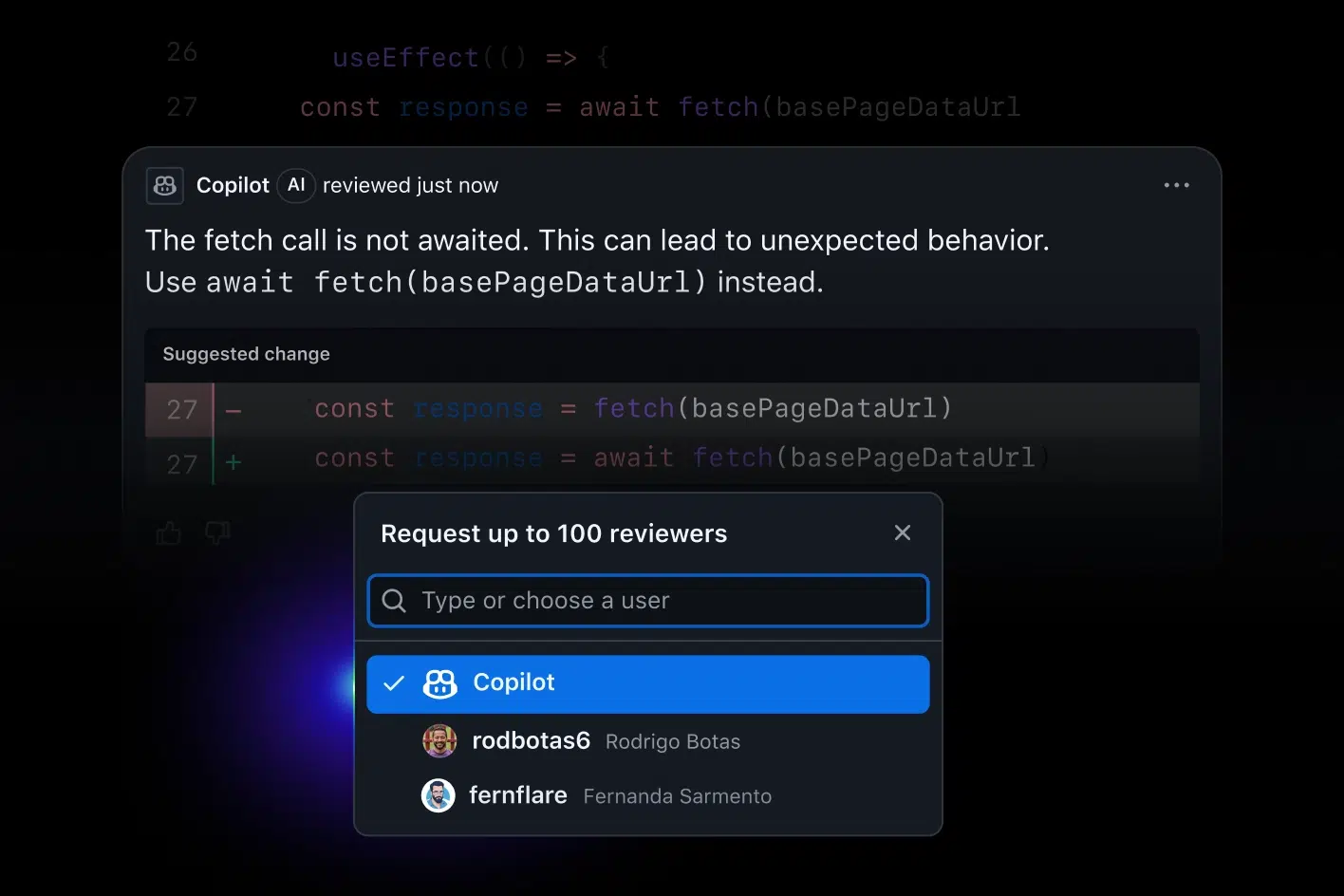

Copilot nació como autocompletado avanzado y se ha convertido en un ecosistema completo: sugerencias in‑line, Copilot Chat en el IDE, integración con la CLI gh, resúmenes de PR en GitHub.com y modo agente capaz de acometer tareas de varios pasos. Funciona especialmente bien si vives ya en GitHub, VS Code o Visual Studio.

A nivel de modelos, ahora soporta varios LLM (OpenAI, Anthropic, Google, etc.), lo que le da cierta flexibilidad, aunque no está pensado para que enchufes fácilmente tu LLM casero. El gran plus es la integración end‑to‑end con el ciclo de vida del desarrollo: desde escribir código hasta revisar pull requests y comentar issues.

En precio, tiene desde un plan gratuito limitado (unas 2000 terminaciones y 50 chats/mes) hasta Pro, Pro+, Business y Enterprise, moviéndose entre los 10 y 39 dólares por usuario/mes según volumen y controles empresariales. El principal contra, más allá del coste, es que te ata aún más al universo Microsoft/GitHub y no prioriza modelos locales u open source.

Claude Code: Anthropic llevado al extremo en la terminal

Claude Code es el asistente de programación CLI de Anthropic, centrado en devs que adoran la terminal. Usa los modelos más recientes (Claude 3.5 Sonnet, Opus, etc.) y está optimizado para entender repositorios completos, generar planes de cambio, editar archivos, ejecutar comandos y crear commits y PRs directamente desde tu shell.

Su gran baza es la capacidad de razonamiento en tareas largas y complejas: refactorizaciones a lo bestia, debug de sistemas enrevesados, lectura de codebases enormes. Su “búsqueda agéntica” puede mapear un repo en segundos, sacar resúmenes y localizar las partes relevantes para un bug o una feature. El lado negativo es que sigue en vista previa y es puramente de terminal, así que si eres de ratón e IDE puede que no sea lo tuyo.

En cuanto a precios, el acceso llega vía planes de Anthropic: Pro (~20 $/mes), Max (desde 100 $/mes) y Team con asientos “Premium” (~150 $/usuario/mes) para empresas que necesitan más cuota y los modelos más potentes.

Cursor: el IDE “AI‑first” basado en VS Code

Cursor es un fork de VS Code al que le han metido la IA directamente en el corazón del editor. No es un plugin: es un IDE completo que mantiene la mayoría de extensiones y atajos (aunque alguno cambia) e incorpora chat, edición multi‑línea, refactorizaciones guiadas y modos de agente integrados en la interfaz.

Destaca por un flujo de trabajo extremadamente rápido para editar bloques enteros de código, preguntar por el comportamiento de un módulo, generar tests o pedir refactorizaciones sobre varios archivos sin salir del editor. Soporta múltiples modelos (OpenAI, Anthropic…) y ofrece un “Privacy Mode” para evitar guardar tu código en sus servidores.

Lado menos bonito: al ser un fork a veces va por detrás de VS Code, puede romper alguna extensión marginal y su enfoque en el IDE deja fuera aspectos como integración nativa con pipelines CI/CD. En precio, se mueve desde un plan Hobby gratuito (con límites y prueba Pro de dos semanas) hasta Pro, Pro+, Ultra y Teams, con rangos de 20-200 $/mes por usuario según consumo y prestaciones empresariales.

Aider: la alternativa open source, terminal‑friendly y agnóstica de modelo

Aider es un asistente de programación de línea de comandos muy apreciado en comunidades de código abierto. Trabaja sobre Git, está pensado para un estilo conversacional (“haz esto”, “revierte aquello”) y soporta cualquier LLM al que puedas acceder vía API, incluidos modelos locales servidos con Ollama u otras herramientas.

Su filosofía es clara: control para el desarrollador y trazabilidad total. Apuntas Aider a un repo, él genera cambios y los va comiteando con mensajes razonables, de modo que revisar, aceptar o revertir su trabajo es trivial. No hay vendor lock‑in de modelo y el proyecto en sí es open source y muy hackeable.

El peaje es que no es tan “bonito” ni plug‑and‑play como las soluciones comerciales: hay que saber lidiar con claves de API, configuraciones y terminal. Pero si te gusta ese mundo, tienes una herramienta gratuita donde el único coste son los tokens del modelo que elijas (o cero si corres el LLM en local).

Otros asistentes más especializados

Además de los grandes cuatro anteriores, tienes una buena colección de asistentes más nicho o con enfoque muy empresarial:

- Augment Code: diseñado para grandes empresas reguladas (finanzas, salud). Fuerte en seguridad (SOC 2 Tipo II, ISO/IEC 42001, CMEK), con un “Context Engine” que mapea bases de código enormes y un pricing por créditos orientado a despliegues serios.

- Cody (Sourcegraph): brilla cuando tu problema es entender y navegar repositorios gigantes. Responde preguntas sobre tu base de código, sugiere cambios y genera código conociendo todo el grafo de dependencias. Versión personal gratuita y planes enterprise caros (a partir de miles de dólares al año).

- Amazon CodeWhisperer: alternativo a Copilot, muy centrado en AWS. Sugiere código optimizado para SDKs de Amazon, incluye escáner de seguridad y sistema de trazado a código open source para temas de licencias. Plan individual gratis y plan profesional de pago.

- Google Bard / Gemini para devs: aunque Gemini 3 Pro pinta muy bien en benchmarks, la comunidad lo percibe irregular para programar. Aun así, funciona decentemente en tareas multimodales (visión + código) y generación de UI, y se integra con los IDE de JetBrains.

Modelos de IA punteros para programar: “la capa LLM”

Debajo de muchas de esas herramientas viven modelos especializados o especialmente buenos en código. Entender sus diferencias te ayuda a elegir tanto servicios de terceros como qué modelo enchufar a tus propias herramientas (Aider, scripts internos, agentes personalizados, etc.).

Claude Sonnet 4.5: relación calidad‑precio casi imbatible

Claude 3.5 Sonnet 4.5 se ha ganado la fama de ser “el mejor modelo de código por euro gastado”. En SWE‑Bench Verified ronda el 77,2 % de aciertos, llegando al 82 % con computación paralela, y cuesta aproximadamente una quinta parte que Opus por millón de tokens (unos 3 $ de entrada y 15 $ de salida).

Lo relevante no es solo la cifra, sino que rinde alrededor del 90 % de Opus en la mayoría de tareas de desarrollo: generar funciones, refactorizar, escribir tests, revisar code, etc. Replit y Cognition (Devin) han reportado saltos brutales en fiabilidad y planificación al pasar de Sonnet 4 a 4.5, con caídas en su tasa interna de errores hasta el 0 % en ciertas ediciones de código. También destaca la apuesta de Anthropic por un modelo sin anuncios que prioriza privacidad y uso profesional, según análisis sobre la plataforma .

Técnicamente, combina razonamiento híbrido (modo rápido vs pensamiento extendido), ventanas de contexto enormes (200K tokens, con opción de 1M en beta), salida de hasta 64K, sub‑agentes paralelos y autonomía suficiente para tareas largas (más de 30 horas de trabajo continuo con checkpoints). Es el “daily driver” lógico si quieres algo muy bueno sin pagar precios de tope de gama.

Claude Opus 4.6: cuando necesitas un “colega senior” autónomo

Si Sonnet 4.5 es el caballo de batalla, Opus 4.6 es el buque insignia. Sube el listón en SWE‑Bench (≈80,8 %), lidera Terminal‑Bench 2.0 como agente de terminal y se dispara en tests de razonamiento abstracto como ARC‑AGI‑2 con casi el doble de puntuación respecto a su versión anterior.

Lo que se nota al usarlo es que “piensa más profundo” y se corrige a sí mismo. Puede tardar algo más en tareas triviales, pero brilla en problemas gordos: refactorizar un sistema legacy, migrar arquitecturas, investigar bugs esquivos repartidos por medio repo. Su ventana de contexto de 1M tokens permite literalmente meter un proyecto entero en una sola conversación, con documentación, configs y dependencias. Puedes leer un análisis detallado del nuevo modelo Opus 4.6 en este artículo sobre Opus 4.6.

Incluye controles de /effort para ajustar cuánto razona, “adaptive thinking” para no gastar tokens de más cuando no hace falta y una integración estrecha con Claude Code y herramientas externas. Es caro (15 $ entrada, 75 $ salida por millón de tokens), pero para tech leads o equipos que abordan proyectos muy complejos la mejora de productividad puede compensar con creces.

OpenAI GPT‑5.3‑Codex: potencia bruta y ambición multi‑tarea

GPT‑5.3‑Codex combina el cerebro generalista de GPT‑5.2 con un afino específico para programación y trabajo agéntico. Lidera benchmarks como SWE‑Bench Pro y HumanEval+ (en torno al 94 %), con especial fortaleza en programación algorítmica y depuración de problemas difíciles.

Su propuesta no es solo “escribir código mejor”: quiere ser un agente de trabajo completo. Además de programar, genera y actualiza documentación, crea tickets en Jira, prepara presentaciones, toca pipelines DevOps y coordina herramientas varias. La ventana de 400K tokens y la salida de hasta 128K, junto con mecanismos de “Perfect Recall”, ayudan a que gestione contextos amplios sin olvidar partes intermedias.

Comparado con Opus, suele parecer algo menos intuitivo en ciertas refactorizaciones o fixes contextuales, pero está muy fuerte en detección de bugs sutiles y en tareas que mezclan código con trabajo de conocimiento (docs, gestión, etc.). En precio orientativo, anda por los 7-8 $ de entrada y 35-40 $ de salida por millón de tokens.

Moonshot Kimi K2.5: open source con enjambre de agentes

Kimi K2.5 ha sacudido la escena open source: alrededor de un billón de parámetros en arquitectura Mixture‑of‑Experts, con unos 32B activos por token. Publicado bajo licencia MIT, está entrenado multimodal desde el principio (texto + imagen) y logra números de infarto: ~76,8 % en SWE‑Bench, 85 % en LiveCodeBench y más de 96 % en AIME 2025.

Su feature estrella es el Agent Swarm: puede desplegar hasta 100 sub‑agentes coordinados en paralelo, cada uno con responsabilidades distintas (backend, base de datos, tests, docs…). Esto permite acelerar tareas grandes hasta 4,5 veces respecto a un enfoque secuencial, con hasta 1500 llamadas a herramientas en paralelo.

En precio vía API es tremendamente agresivo: unos 0,60 $ por millón de tokens de entrada y 2,5-3 $ por millón de salida, muy por debajo de muchos modelos propietarios. El contrapeso es que el modelo completo pide hardware serio para auto‑hosting, aunque existen variantes Flash más ligeras.

Gemini 3 Pro: gran en benchmarks, irregular en código real

Gemini 3 Pro llegó con números espectaculares en tests (SWE‑Bench alrededor del 76 %, puntuaciones Elo muy altas en LiveCodeBench y 100 % en AIME 2025 con ejecución de código). Pero en uso real, la comunidad de developers de Google ha reportado regresiones: pérdida de contexto en conversaciones largas, modo agente que ignora herramientas disponibles y una sensación general de que la versión anterior iba mejor para programar.

Sigue siendo fuerte en razonamiento matemático y tareas multimodales (interpretar diseños visuales, convertir bocetos en código, etc.), y su integración en IDEs de JetBrains tiene buena acogida en tareas de frontend y generación de interfaces. Si te interesa probar funciones experimentales de Gemini, hay recursos sobre laboratorio de funciones experimentales que explican su enfoque.

Otros modelos y herramientas de la “fauna IA para código”

Además de los grandes nombres, hay todo un zoo de modelos y herramientas más específicas que cubren desde completado de código básico hasta análisis de seguridad y generación de documentación:

- Code Llama (Meta): familia open source derivada de Llama 2, especializada en código (versiones general, Python e Instruct) con contextos de hasta 100K tokens y uso comercial permitido.

- Stable Code 3B (Stability AI): modelo compacto de 3B parámetros enfocado en completado de código en tiempo real en portátiles sin GPU, entrenado en varios lenguajes y datos de ingeniería de software.

- Tabnine: motor de autocompletado multi‑lenguaje que puede correr local o en cloud, con modelos personalizados entrenados sobre tu propio repositorio para sugerir código alineado con tu estilo y libs internas.

- CodeT5, Polycoder, AIXcoder, Ponicode, Jedi, Wing, Smol Developer, Plandex… proyectos open source o comerciales que cubren generación de código, explicación, pair programming, descomposición de tareas multi‑archivo, etc.

Y luego están los actores clásicos reconvertidos en asistentes más “IA” (Visual Studio IntelliCode, PyCharm/JetBrains AI) que combinan auto‑completado avanzado, refactorización inteligente, análisis estático y, cada vez más, integración con modelos LLM externos.

Herramientas IA para calidad, seguridad y mantenimiento de código

No todo va de escribir código nuevo. Buena parte del valor de la IA en desarrollo está en revisar, asegurar y mantener lo que ya existe. Aquí destacan varias categorías:

- Análisis estático y seguridad: herramientas como Snyk, Codiga, Deepcode o integraciones nuevas de CodeWhisperer y otros asistentes analizan dependencias, patrones de vulnerabilidad, problemas de licencia open source y malas prácticas, proponiendo fixes concretos.

- Refactorización y limpieza: soluciones como Sourcery ayudan a eliminar duplicidades, simplificar funciones, mejorar legibilidad y aplicar patrones consistentes en Python y otros lenguajes.

- Tests y calidad: productos tipo CodiumAI generan tests automáticamente, analizan cobertura de comportamiento y señalan escenarios no probados, ayudando a reforzar la suite de tests sin quemar horas manuales.

- Auditoría y revisión de PR: servicios como CodeRabbit u otros bots con Sonnet/Opus integrados hacen review automático de cambios, detectan bugs, sugieren mejoras y priorizan comentarios para los reviewers humanos.

La idea es muy clara: dejar que la IA se coma la parte pesada de revisiones y “peinar” bases de código, reservando el criterio humano para decisiones de diseño, trade‑offs de arquitectura y validación de cambios sensibles.

Más allá del código: agentes de IA para soporte y otros equipos

Mientras los desarrolladores se acostumbran a tener asistentes que leen repos completos y abren PRs, muchos equipos de soporte siguen buscando entre wikis, tickets antiguos y PDFs para contestar preguntas técnicas de usuarios. Eso genera un cuello de botella curioso: el producto evoluciona muy rápido gracias a la IA, pero el soporte se queda atrás.

Aquí es donde surgen plataformas como eesel AI, que aplican el mismo enfoque agéntico al mundo del servicio al cliente y el soporte técnico. En lugar de leer código, estos agentes leen:

- Todo tu conocimiento interno: centros de ayuda, tickets pasados, Confluence, Google Docs, wikis, manuales internos, etc.

- Tus herramientas de soporte: integraciones de un clic con Zendesk, Intercom, Slack y otros help desks para vivir en el mismo flujo donde trabaja tu equipo.

- APIs de tu producto: para ejecutar acciones reales: clasificar tickets, consultar pedidos, escalar a la persona adecuada o incluso resolver tareas repetitivas de backoffice.

Un punto muy interesante es que puedes simular su comportamiento en tickets históricos antes de ponerlo en producción. Eso te da métricas reales de acierto, tono y seguridad sin arriesgar conversaciones con clientes. Al final, es el mismo concepto que las alternativas a Codex traen al desarrollo, aplicado al dominio del soporte. Si te preocupa la integración segura de agentes con sistemas internos, consulta guías sobre cómo conectar agentes a sistemas internos.

Beneficios reales de integrar IA en tu flujo de desarrollo

Más allá del efecto “juguete nuevo”, usar estas herramientas a diario cambia cómo trabajas como dev:

- Velocidad de prototipado: sacar un MVP, un script de automatización o una PoC se vuelve cosa de horas en lugar de días.

- Menos trabajo repetitivo: boilerplate, tests básicos, mapeos de DTOs, documentación inicial… todo eso lo puede preparar la IA.

- Mejor calidad inicial: muchos errores de principiante, fallos de sintaxis o vulnerabilidades típicas se atrapan antes de que lleguen a producción.

- Aprendizaje continuo: tener un “mentor” 24/7 al que preguntarle por librerías nuevas, patrones o formas idiomáticas de hacer algo en un lenguaje concreto acorta brutalmente la curva de aprendizaje.

- Foco en lo que importa: te permite dedicar más tiempo a arquitectura, diseño de producto y discusiones con negocio, en vez de perderte en detalles mecánicos.

Eso sí, la responsabilidad final sigue siendo tuya. El código que entra en main lo firmas tú, no la IA. Revisar, testear y entender lo que hace el asistente es innegociable, sobre todo en contextos críticos (salud, finanzas, infraestructuras).

Con todo este panorama, tienes ante ti un abanico enorme de alternativas a Codex: desde asistentes integrados como Copilot o Cursor, pasando por herramientas CLI como Claude Code o Aider, hasta modelos base ultrapotentes y opciones open source que puedes desplegar en tu propia máquina. La clave ya no es encontrar “la mejor IA” en abstracto, sino combinar las piezas que mejor encajan con tu flujo de trabajo, tu presupuesto y tus requisitos de seguridad, y aprender a usarlas como una extensión natural de tu forma de desarrollar software.

Redactor especializado en temas de tecnología e internet con más de diez años de experiencia en diferentes medios digitales. He trabajado como editor y creador de contenidos para empresas de comercio electrónico, comunicación, marketing online y publicidad. También he escrito en webs de economía, finanzas y otros sectores. Mi trabajo es también mi pasión. Ahora, a través de mis artículos en Tecnobits, intento explorar todas las novedades y nuevas oportunidades que el mundo de la tecnología nos ofrece día a día para mejorar nuestras vidas.