- OpenAI activa en ChatGPT un modelo de predicción de edad para detectar posibles menores de 18 años y aplicar más filtros de seguridad.

- El sistema analiza señales de comportamiento y datos de la cuenta, y permite corregir errores mediante verificación con selfie y documento oficial a través de Persona.

- Cuando se identifica una cuenta de menor, se limita el acceso a contenido sensible como violencia gráfica, juegos de rol sexuales o retos virales peligrosos.

- El despliegue es global y llegará a la Unión Europea en las próximas semanas, en un contexto de mayor presión regulatoria y planes para un futuro “modo adulto”.

OpenAI ha empezado a desplegar en ChatGPT un sistema de predicción de edad que cambia de forma notable la forma en la que el chatbot trata a los usuarios menores de 18 años. La compañía busca ajustar automáticamente la experiencia y las medidas de seguridad en función de si una cuenta parece pertenecer a un adolescente o a un adulto.

La decisión llega en un momento delicado, con creciente presión regulatoria sobre el impacto de la IA en menores y demandas en marcha contra la empresa y su consejero delegado, Sam Altman, por casos en los que se investiga el papel del asistente conversacional en situaciones de alto riesgo. A la vez, la firma quiere preparar el terreno para nuevas modalidades de contenido sin dejar desprotegido al público más joven.

Cómo funciona el modelo de predicción de edad de ChatGPT

La nueva función se basa en un modelo de inteligencia artificial capaz de estimar si una cuenta pertenece a alguien menor de 18 años, apoyándose en múltiples señales que ya genera el propio uso del servicio. No se trata solo de lo que el usuario declara al registrarse, sino de una combinación de indicadores que permiten deducir el perfil de edad con mayor precisión.

Según explica OpenAI, el sistema tiene en cuenta la antigüedad de la cuenta, los horarios típicos de actividad, los patrones de uso a lo largo del tiempo y la edad que el usuario introdujo al crear el perfil. Con el despliegue masivo, la empresa pretende identificar qué factores son más fiables para seguir puliendo el modelo y reducir los errores.

El planteamiento supone pasar de un enfoque basado casi exclusivamente en la autodeclaración de la edad, fácil de esquivar, a un sistema más automatizado que activa protecciones adicionales cuando hay dudas razonables. Es, en la práctica, una capa extra que complementa los ya existentes controles parentales y las opciones de configuración familiar.

OpenAI insiste en que ningún sistema de predicción de edad es infalible. Reconoce que habrá casos en los que un adulto sea tratado como menor o, a la inversa, escenarios en los que la IA no detecte a tiempo que está interactuando con un adolescente. Por eso, la compañía plantea un mecanismo de verificación adicional para corregir estos fallos.

Qué cambia para los menores: límites al contenido sensible

Cuando el modelo considera que una cuenta probablemente pertenece a un menor de 18 años, ChatGPT activa de forma automática una experiencia más protegida. El objetivo es reducir la exposición a determinados tipos de contenido que, según la literatura sobre desarrollo infantil, pueden tener un mayor impacto en adolescentes.

En ese contexto, la plataforma aplicará filtros adicionales sobre violencia gráfica, escenas gore o descripciones especialmente crudas, además de restringir la participación en juegos de rol con componentes sexuales, románticos o violentos. También se limitarán los retos virales que puedan fomentar conductas de riesgo o dañinas.

Otro de los frentes en los que OpenAI quiere pisar el freno es el contenido que refuerza estándares de belleza extremos, dietas poco saludables o narrativas que faciliten la humillación corporal. Estas temáticas se abordarán con más cautela o directamente se bloquearán si el sistema considera que el usuario es demasiado joven.

Estas salvaguardas adicionales se suman a los controles de seguridad que ChatGPT ya aplicaba a todos los usuarios, independientemente de su edad. El propio asistente recuerda que no genera pornografía ni descripciones sexuales explícitas, evita instrucciones sobre autolesión o suicidio, no explica cómo cometer delitos ni facilita datos personales de terceros.

En temas como salud, sexualidad básica, violencia o política, el chatbot ya operaba con un enfoque educativo y neutral, alejándose de tonos sensacionalistas o de cualquier intención de persuasión. La diferencia ahora es que, si la cuenta parece de un menor, determinados asuntos se tratarán con todavía más prudencia o se filtrarán de raíz.

Verificar la edad con Persona: selfie y documento oficial

Para los casos en los que la IA se equivoque, OpenAI ofrece un proceso de verificación de edad a través de Persona, un proveedor externo especializado en verificación de identidad. La idea es que un adulto que haya sido clasificado por error como menor pueda recuperar el acceso completo a las funciones de ChatGPT.

El procedimiento se inicia desde los ajustes del servicio, en la sección de cuenta, donde aparece la opción de “Verificación de edad”. A partir de ahí, el usuario es redirigido a Persona, que puede solicitar un selfie en vivo utilizando la cámara del móvil o del ordenador para confirmar que la persona cumple la mayoría de edad.

En función del país, el sistema puede requerir además un documento oficial de identidad, como el DNI, el pasaporte o el permiso de conducir. Con esa información, Persona verifica si el usuario tiene 18 años o más y comunica a OpenAI únicamente el resultado, sin compartir las imágenes ni los documentos originales.

Una vez superada la comprobación, se eliminan las restricciones extra asociadas a la experiencia para menores y la cuenta pasa a funcionar como la de cualquier adulto, dentro de los límites de seguridad generales. OpenAI advierte de que este cambio puede tardar un poco en reflejarse en todos los servicios y dispositivos vinculados.

En materia de privacidad, la compañía subraya que Persona borra el selfie y los documentos en un plazo máximo de siete días y que OpenAI no accede a esos archivos. Solo recibe la fecha de nacimiento o una señal equivalente de mayoría de edad, suficiente para desactivar la predicción en esa cuenta en el futuro.

Un movimiento en plena presión regulatoria y con Europa en el punto de mira

La puesta en marcha de la predicción de edad no se entiende sin el contexto regulatorio. OpenAI reconoce que la medida responde tanto a la necesidad de adaptar ChatGPT a la realidad de los adolescentes como a las exigencias de autoridades y legisladores que piden más garantías para los menores en servicios de IA.

En Estados Unidos, la Comisión Federal de Comercio (FTC) mantiene investigaciones abiertas sobre el efecto de estas tecnologías en usuarios jóvenes, mientras la compañía se enfrenta a demandas en las que se debate el grado de responsabilidad del chatbot en situaciones de riesgo extremo. Las nuevas salvaguardas buscan rebajar esas tensiones y mostrar un compromiso activo con la seguridad.

En la Unión Europea, el despliegue del sistema llegará “en las próximas semanas”, ya que OpenAI debe tener en cuenta requisitos regionales adicionales derivados de la normativa comunitaria sobre protección de datos y servicios digitales. Europa se ha mostrado especialmente estricta con el tratamiento de menores en plataformas en línea, incluidos los sistemas de IA generativa.

La medida también se alinea con prácticas de otras plataformas, como YouTube, que utiliza verificación de edad adicional cuando sospecha que detrás de una cuenta puede haber un menor. En este caso, ChatGPT imita en parte ese enfoque, pero con un modelo que intenta anticiparse antes de que se produzca una exposición a contenido delicado.

OpenAI afirma que el diseño del sistema se ha realizado con la participación de expertos en desarrollo infantil y apoyándose en estudios académicos sobre las diferencias entre adolescentes y adultos en aspectos como la percepción del riesgo, el control de impulsos o la vulnerabilidad a ciertos tipos de mensajes.

800 millones de usuarios, futuro “modo adulto” y necesidad de control

El anuncio de la predicción de edad coincide con un momento de fuerte expansión de ChatGPT. OpenAI calcula que el servicio cuenta ya con unos 800 millones de usuarios activos a la semana, una escala que obliga a poner orden en cómo se ofrece y se limita el contenido en función de quién está al otro lado.

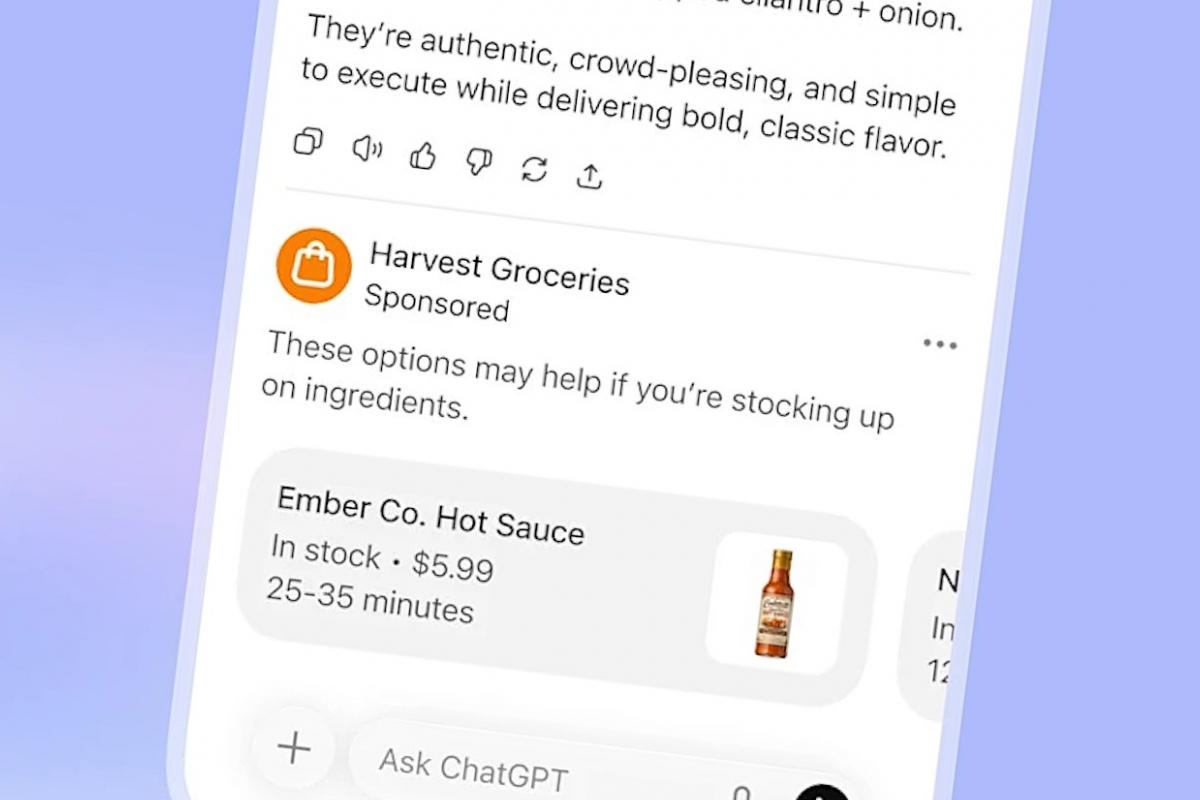

La compañía también ha avanzado en las últimas semanas que empezará a mostrar anuncios en la versión gratuita de ChatGPT para algunos usuarios de Estados Unidos, mientras mantiene sin publicidad las suscripciones de pago más caras. El movimiento forma parte de una estrategia más amplia para aumentar los ingresos.

De hecho, la propia empresa ha señalado que sus ingresos anualizados habrían superado los 20.000 millones de dólares en 2025, frente a los 6.000 millones estimados un año antes, impulsados por la expansión de su capacidad de cómputo y el crecimiento del uso de sus modelos.

En paralelo, OpenAI trabaja en un futuro “modo adulto” para ChatGPT, que permitiría acceder a categorías de contenido más sensibles siempre que el usuario verifique su edad. La directora de aplicaciones de la compañía, Fidji Simo, situó su llegada en el primer trimestre de 2026, condicionada a que existan salvaguardas robustas para bloquear esa opción a los menores.

La predicción de edad encaja en ese plan como la pieza necesaria para separar, con cierto margen de seguridad, la experiencia adolescente de la adulta. Sin esa separación, habilitar un modo con contenidos más explícitos resultaría difícil de justificar ante reguladores y opinión pública.

Una infraestructura invisible que marcará el uso de la IA por parte de menores

Más allá del titular, la predicción de edad en ChatGPT funciona como infraestructura silenciosa que condicionará el día a día de millones de usuarios jóvenes. El sistema decide qué se ve y qué no, qué conversaciones son posibles y cuáles se limitan, incluso cuando el adolescente no haya declarado abiertamente su edad.

El éxito de esta apuesta dependerá de dos factores: la precisión del modelo y el nivel de fricción que introduzca. Si etiqueta erróneamente a demasiados adultos, las quejas no tardarán en llegar; si se queda corto, las críticas se centrarán en la falta de protección para los menores, especialmente en Europa y otras jurisdicciones exigentes.

Aun con sus límites, la nueva función supone un paso relevante en la forma en que las grandes plataformas de IA asumen responsabilidades concretas sobre quién usa sus productos, incluidas alianzas de seguridad online. En el caso de OpenAI, llega tras meses de debate público, avances regulatorios y un crecimiento comercial que obliga a combinar expansión, monetización y seguridad en un mismo movimiento.

Con este despliegue global y la llegada prevista a la Unión Europea en breve, ChatGPT se encamina a un modelo en el que la edad deja de ser solo un dato introducido en un formulario para convertirse en una variable central que determina el tipo de conversaciones, contenidos y límites que el chatbot ofrecerá a cada usuario.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.