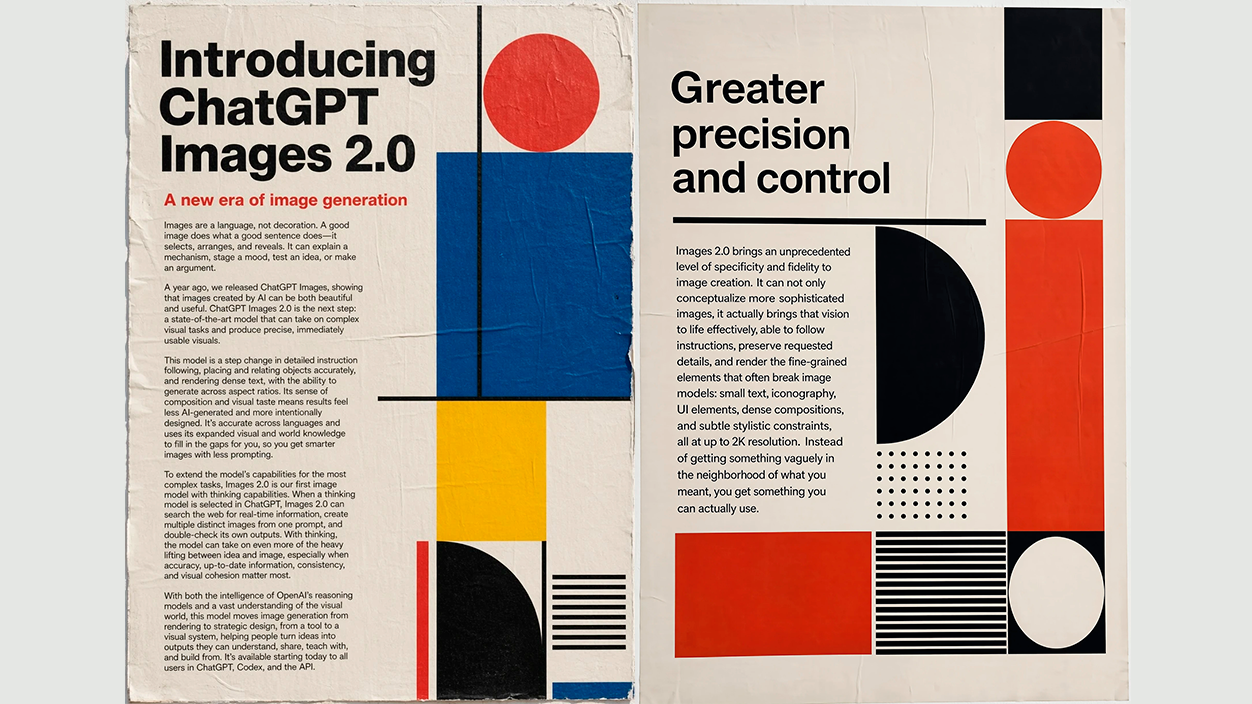

- ChatGPT Images 2.0 integra un nuevo modelo de generación visual en ChatGPT capaz de escribir texto legible y coherente dentro de las imágenes.

- El sistema incorpora capacidades de razonamiento y búsqueda web para crear múltiples imágenes coherentes desde un único prompt.

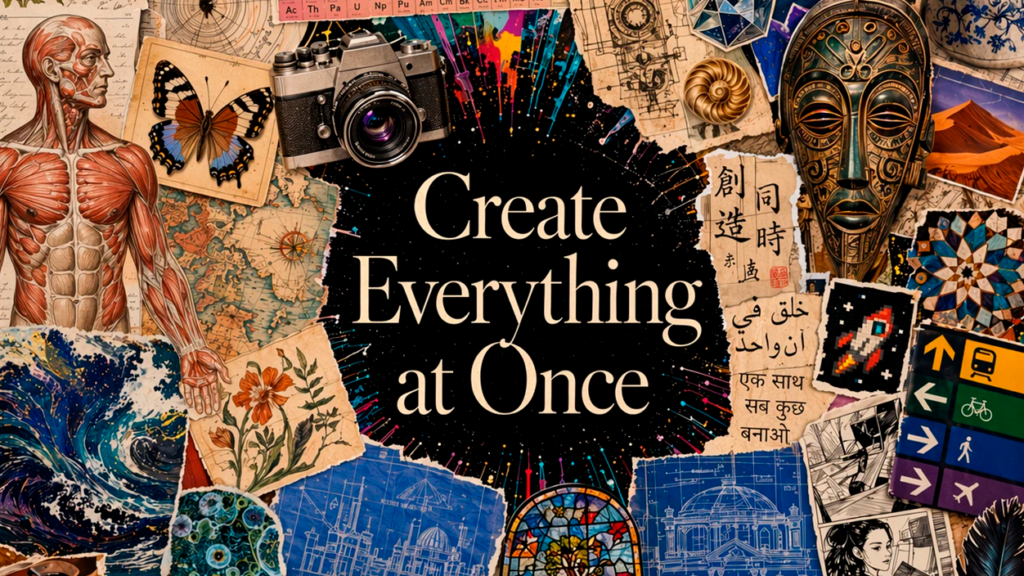

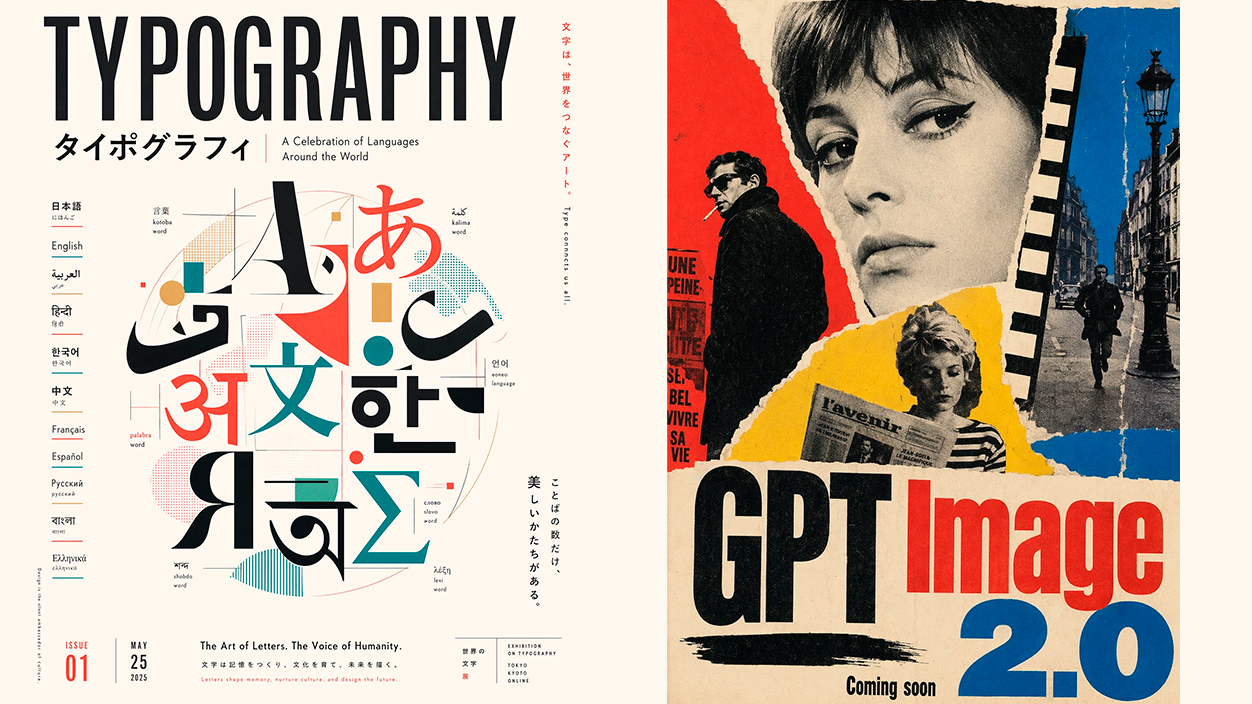

- Mejora el soporte para idiomas no latinos y ofrece formatos flexibles hasta 2K de resolución para usos comerciales y profesionales.

- La API gpt-image-2 permitirá a desarrolladores integrar estas capacidades en productos, automatizando flujos de diseño y marketing.

Hasta hace muy poco era sencillo detectar cuándo una imagen había sido creada por una persona y cuándo por una IA: bastaba con fijarse en los textos torcidos de los carteles, los menús imposibles o las interfaces llenas de letras inventadas. Esa época está cambiando muy rápido y ChatGPT Images 2.0 es, probablemente, el mejor ejemplo. El nuevo modelo de OpenAI ha dado un salto enorme en calidad, sobre todo en algo que llevaba años atragantándose a los modelos visuales: escribir texto legible y coherente dentro de las imágenes.

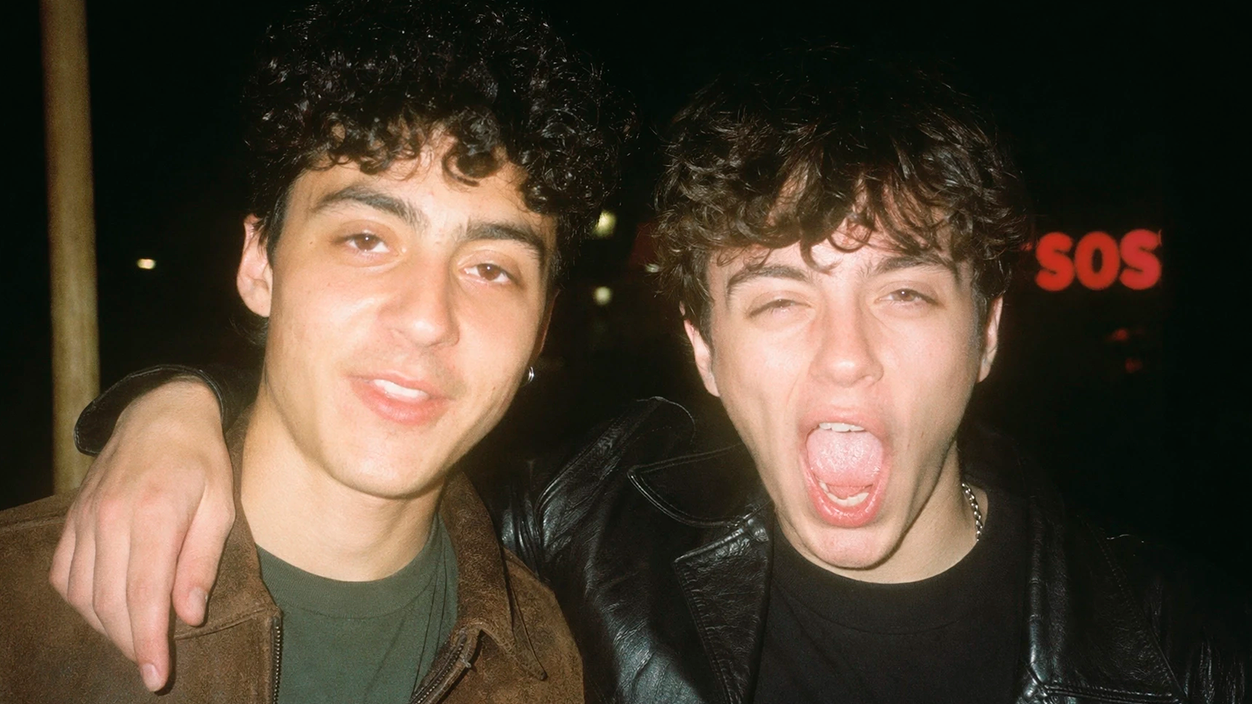

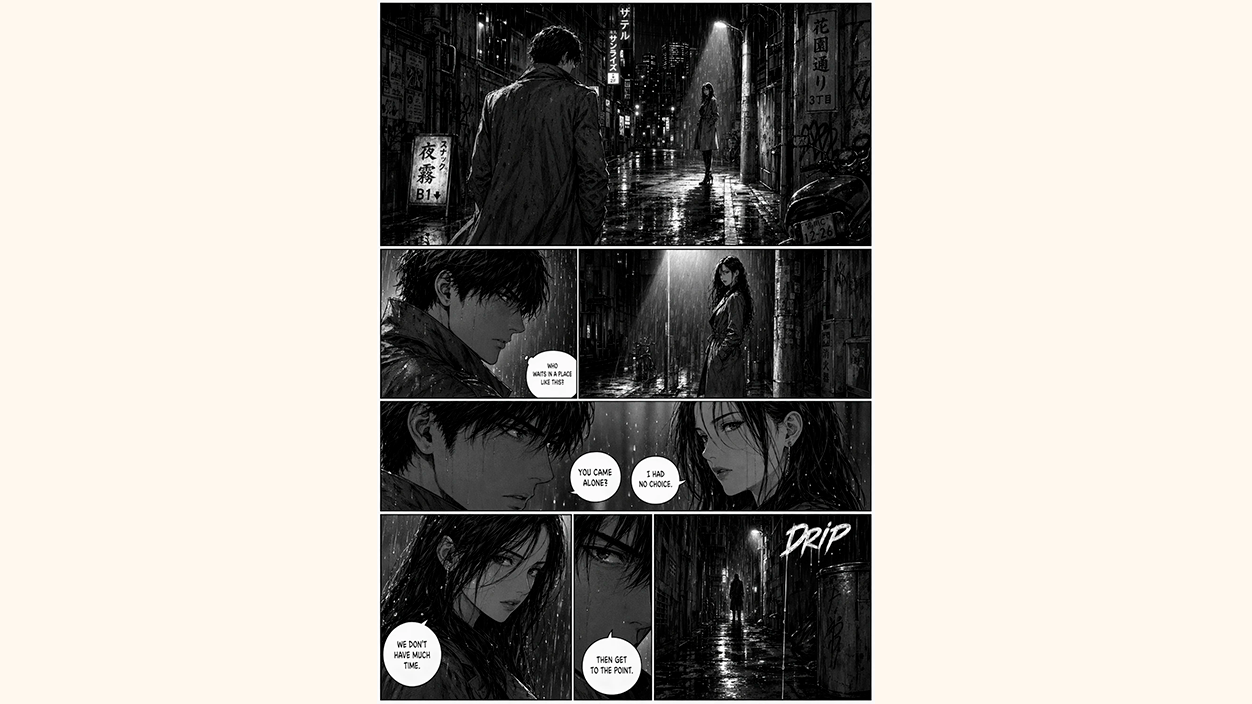

Lo llamativo de Images 2.0 no es solo que genere imágenes vistosas, sino que produzca piezas listas para usar en contextos reales: desde un menú de restaurante que podrías colgar en la pared sin que nadie sospeche, hasta materiales de marketing con distintos formatos, pasando por historietas por paneles o maquetas de interfaces complejas. Detrás de este salto hay cambios de arquitectura, nuevas capacidades de “razonamiento” y una integración mucho más estrecha con el propio ChatGPT.

Qué es ChatGPT Images 2.0 y por qué importa tanto

ChatGPT Images 2.0 es el nuevo modelo de generación de imágenes integrado directamente en ChatGPT y en la API de OpenAI, sucesor del generador nativo que se estrenó con GPT-4o (a menudo llamado GPT Image 1). A diferencia de DALL-E 3, que funcionaba como un modelo separado al que ChatGPT llamaba como herramienta externa, Images 2.0 está “fundido” con el ecosistema GPT, aprovechando sus capacidades de razonamiento, búsqueda y contexto conversacional. Para quien quiera profundizar en usos de ChatGPT con imágenes, es útil leer guías sobre extraer texto de imágenes con ChatGPT.

Su gran gancho es que puede crear varias imágenes a partir de un mismo prompt y, a la vez, generar texto dentro de esas imágenes con una precisión que hace dos años era impensable. Donde antes veíamos letreros del tipo “enchuita” o “churiros” al pedir un menú mexicano, ahora el modelo produce cartas perfectamente legibles, con precios verosímiles y nombres de platos escritos de forma correcta. El único detalle que puede levantar cejas, como bromean algunos analistas, es un ceviche a 13,50 dólares que quizás haga desconfiar de la calidad del pescado, no del generador.

OpenAI ha presentado este modelo como un salto de “fidelidad y especificidad sin precedentes” en la generación visual. Según la compañía, Images 2.0 es capaz de seguir al pie de la letra indicaciones muy concretas, respetar detalles mínimos y manejar elementos que históricamente se le atragantaban a la IA: texto diminuto, iconos, elementos de interfaz de usuario, composiciones densas y restricciones de estilo sutiles, todo ello alcanzando resoluciones de hasta 2K.

En la práctica, esto significa que las imágenes dejan de ser simples ilustraciones espectaculares pero poco fiables para convertirse en activos que se pueden utilizar en publicidad, documentación, prototipado de productos, educación o contenidos editoriales, sin tener que retocar todo el texto a mano después.

Del caos tipográfico a la lectura perfecta: el gran avance en texto

Durante años, el talón de Aquiles de los generadores de imágenes por IA fue la escritura. Menús llenos de palabras inventadas, etiquetas con letras deformadas, interfaces con botones imposibles de leer… Cualquiera que haya trasteado con modelos de difusión lo ha sufrido. Era el truco infalible para desenmascarar una imagen generada por IA: bastaba con mirar una señal o un rótulo.

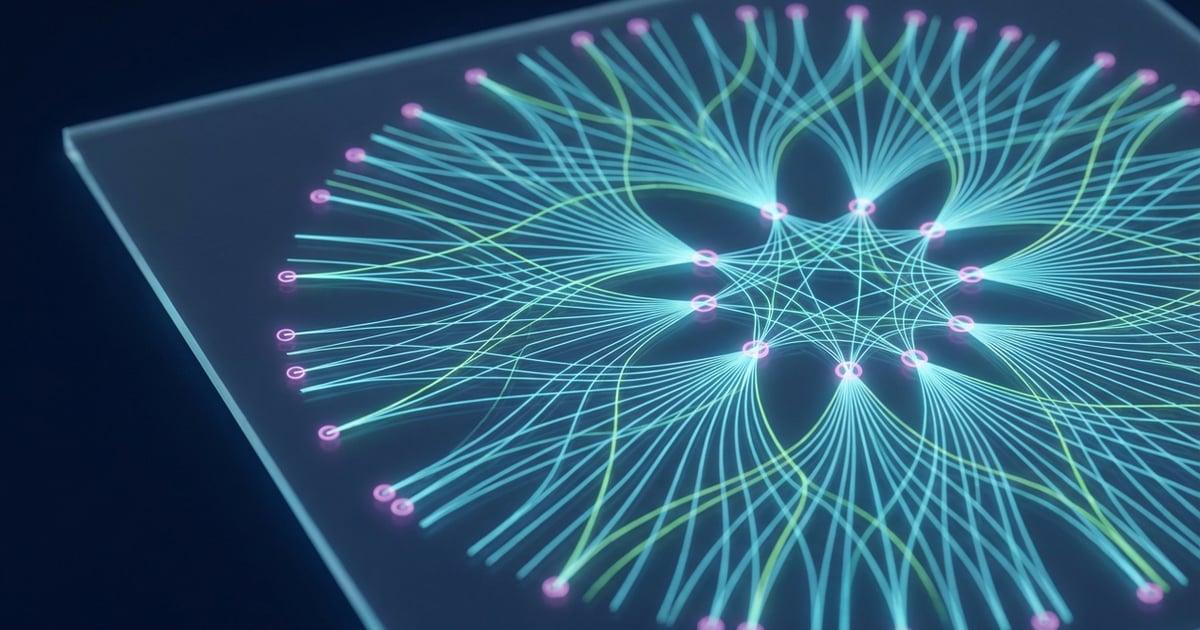

La raíz del problema está en cómo trabajaban la mayoría de modelos de imagen hasta hace poco. Los modelos de difusión reconstruyen una imagen a partir de ruido, “pintando” poco a poco los píxeles hasta que aparece una escena coherente. Pero el texto en una imagen ocupa una porción mínima del total de píxeles, así que el modelo aprende mucho mejor los patrones generales (fondos, formas grandes, rostros) que los detalles de las letras. Como explicaba Asmelash Teka Hadgu, fundador de Lesan AI, los trazos de texto son estadísticamente marginales frente al resto de la imagen.

El resultado era el que todos conocemos: carteles que parecen correctos a primera vista, pero que al acercarse se convierten en una sopa de caracteres, con letras duplicadas, sílabas extrañas y palabras que no existen en ningún idioma. DALL-E 3 ya mejoró bastante este punto, pero seguía siendo habitual tener que regenerar varias veces para conseguir una sola imagen utilizable con texto aceptable.

Para superar ese techo, la investigación empezó a explorar enfoques alternativos como los modelos autorregresivos para imágenes, más parecidos a los grandes modelos de lenguaje: en lugar de reconstruir todo desde ruido, van prediciendo partes de la imagen de forma secuencial, lo que les permite razonar mejor sobre estructuras como el texto. OpenAI, sin embargo, no ha querido desvelar qué arquitectura exacta hay detrás de Images 2.0, manteniendo el misterio incluso en sus sesiones informativas con la prensa.

Lo que sí sabemos es el efecto visible: el nuevo modelo puede generar rótulos largos, banners, menús completos, interfaces de software y elementos con mucho texto con un nivel de ortografía y coherencia que muchos describen como “casi perfecto”. Para usos cotidianos —publicidad, infografías, presentaciones, maquetas de producto— la tasa de errores baja lo suficiente como para que, por fin, el texto deje de ser un estorbo.

Capacidades de razonamiento y conexión con la web

Uno de los puntos donde OpenAI ha puesto más énfasis es en las llamadas “capacidades de razonamiento” de ChatGPT Images 2.0. No se trata solo de plasmar una descripción visual al vuelo, sino de descomponer la tarea en varios pasos, buscar información adicional cuando hace falta y verificar el resultado final antes de devolverlo al usuario.

En la práctica, esto se traduce en que Images 2.0 puede consultar la web para obtener datos recientes y luego integrarlos en una imagen. Un ejemplo muy ilustrativo es la generación de una infografía con el pronóstico del tiempo en San Francisco para el día siguiente: el modelo consulta la previsión, crea un gráfico con temperaturas y lluvia correctas y, además, añade ilustraciones reconocibles de la ciudad, como el Ferry Building, el Castro Theatre, las Painted Ladies o la Pirámide Transamerica, todas representadas de manera convincente.

Esta capacidad de acceder a información actualizada está limitada por un “corte de conocimiento” interno en diciembre de 2025. Es decir, el modelo tiene aprendizaje preentrenado hasta esa fecha, pero puede apoyarse en la búsqueda web para suplir lagunas informativas cuando el prompt lo exija. Aun así, en contextos muy ligados a noticias de última hora o datos cambiantes, conviene no dar por hecho que siempre será perfecto.

Otra consecuencia interesante de este razonamiento multietapa es que el modelo puede generar varias imágenes coherentes entre sí a partir de una sola petición. Por ejemplo, un cuadernillo de estudio entero, una serie de creatividades para redes sociales en distintos formatos o una tira cómica de varios paneles con personajes y estilo consistentes. En lugar de lanzar un prompt por cada imagen, el usuario puede describir el conjunto y dejar que el sistema se organice.

Todo esto hace que la generación ya no sea tan instantánea como escribir una simple pregunta en ChatGPT, pero el tiempo de espera sigue siendo razonable: incluso composiciones complejas como un cómic multipanel suelen estar listas en unos minutos, un coste asumible si el resultado ahorra varias rondas de correcciones manuales.

Soporte mejorado para texto no latino y múltiples idiomas

OpenAI también ha insistido en los avances de Images 2.0 en idiomas que no usan alfabeto latino. El modelo dice manejar mejor el renderizado de escrituras como el japonés, el coreano, el hindi o el bengalí, una asignatura pendiente en muchos modelos, que tienden a centrarse casi en exclusiva en el inglés.

Esto es especialmente relevante para marcas y creadores que trabajan en mercados asiáticos o plurilingües. Hasta ahora, pedir a un generador de imágenes que incluyera texto en japonés o hindi era jugar a la lotería: algunos caracteres salían bien, otros se deformaban y el conjunto resultaba inusable de cara al público. Con Images 2.0, la promesa es que se pueden diseñar carteles, anuncios o interfaces directamente en esos idiomas con resultados mucho más fiables.

Aunque OpenAI no ha ofrecido métricas detalladas, la apuesta estratégica es clara: si la IA visual quiere colarse en flujos de trabajo globales, tiene que dejar de tratar los sistemas de escritura no latinos como un añadido marginal. El objetivo es que un menú en coreano o una infografía en bengalí tengan el mismo nivel de legibilidad que su equivalente en inglés o español.

En el día a día, esto abre la puerta a campañas internacionales coherentes, donde se puedan generar variantes locales de la misma pieza publicitaria simplemente cambiando el idioma en el prompt, en lugar de depender de diseños manuales separados por región o de interminables rondas de maquetación para alinear textos y estilos.

Formatos, proporciones y calidad de imagen

Más allá del texto, ChatGPT Images 2.0 ofrece una flexibilidad mucho mayor en el formato de salida. El modelo permite controlar la relación de aspecto de las imágenes desde 3:1 en horizontal (muy panorámico) hasta 1:3 en vertical (ideal para stories o banners alargados), algo esencial si se quieren generar piezas diseñadas ya para un canal concreto.

El usuario puede indicar estas proporciones directamente en el prompt, pidiendo, por ejemplo, un gráfico 16:9 para una presentación, un formato cuadrado para redes sociales o una composición vertical pensada para móviles. Esta granularidad era limitada en modelos anteriores, que obligaban a recortar o adaptar manualmente las imágenes generadas.

En cuanto a calidad, OpenAI habla de hasta 2K de resolución con una gran atención a la coherencia interna: iluminación estable, texturas bien definidas, materiales creíbles y, algo que muchos usuarios notan enseguida, menos artefactos extraños en manos y rostros. No se trata solo de más píxeles, sino de píxeles mejor aprovechados.

La combinación de alta resolución, buen texto y fidelidad visual transforma el papel de la IA en el diseño cotidiano. Antes, estos modelos eran útiles como bocetos rápidos o inspiración; ahora se acercan al terreno de las piezas finales, listas para usar en campañas, documentación técnica o materiales educativos, reduciendo mucho el trabajo de posproducción y la necesidad de retocar todo el texto a mano.

Comparativa con GPT Image 1, DALL-E 3 y otros modelos

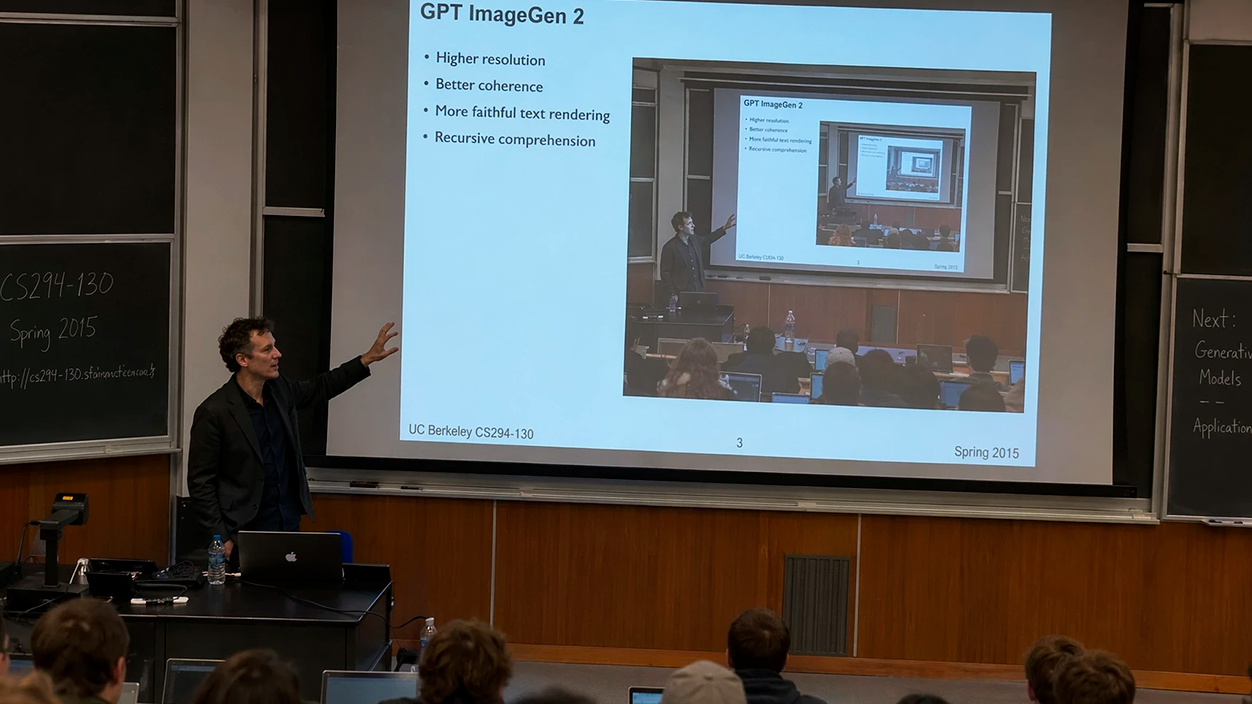

Para entender el salto que supone Images 2.0 conviene compararlo con su predecesor directo y con el resto del ecosistema. GPT Image 1, lanzado junto a GPT-4o en marzo de 2025, ya fue una mejora significativa sobre DALL-E 3: mejor manejo de escenas con varios objetos, colores más fieles a lo solicitado y cierto avance en el texto dentro de las imágenes, aunque todavía irregular.

GPT Image 2 (la base de ChatGPT Images 2.0 detectada en pruebas A/B) parece empujar todos esos frentes un paso más allá. Donde antes el texto era “a veces usable”, ahora se ha convertido en “fiablemente utilizable” en la mayoría de casos: rótulos largos, botones de interfaz, menús, banners… todo aparece escrito con una coherencia que permite integrarlo en flujos de trabajo reales sin miedo a que se cuele una palabra inventada.

Frente a DALL-E 3, la diferencia principal es la integración nativa en el propio modelo de lenguaje. Ya no se trata de un sistema externo al que se hace una llamada, sino de un componente que comparte contexto con la conversación completa. Esto ayuda a seguir instrucciones complejas, a mantener consistencia entre varias imágenes y a adaptar el resultado a lo que se ha hablado previamente con el usuario.

Si lo comparamos con modelos de la competencia, el panorama queda más matizado. Midjourney sigue siendo la referencia en calidad artística y control estético fino, por lo que muchos creadores lo prefieren para piezas puramente visuales o concept art. Sin embargo, su capacidad para manejar texto dentro de las imágenes sigue siendo más limitada y no cuenta con una integración tan profunda con un asistente conversacional.

En el mundo de código abierto, proyectos como Stable Diffusion o FLUX.1 ofrecen enorme flexibilidad y posibilidad de ajuste fino, además de ejecución local sin depender de la nube de un proveedor. Son ideales para perfiles técnicos que quieren control total, pero requieren más configuración, más tiempo de prueba y error y, a menudo, un flujo separado cuando el texto dentro de la imagen es crítico.

Adobe, por su parte, con Firefly, se centra en la integración directa con Creative Cloud y en usos claramente comerciales, con enfoque en coherencia de marca y trazabilidad del contenido. Google compite con Imagen 3, especialmente fuerte en fotorealismo e integrado en su asistente Gemini, mientras Microsoft avanza con Phi 4 multimodal. En este contexto, Images 2.0 parece posicionarse como la opción más sólida cuando lo importante es la combinación de texto fiable, contexto conversacional y fácil incorporación a procesos prácticos.

Casos de uso: de menús y cómics a automatización de marketing

La gran pregunta no es solo qué hace el modelo, sino qué se puede construir encima de él. La mejora en texto hace que, por primera vez, muchos casos de uso que hasta ahora eran poco serios empiecen a ser realistas para producción.

En marketing, por ejemplo, se pueden automatizar creatividades para redes sociales, banners y cabeceras de emails donde el texto principal y los claims aparezcan correctamente escritos, adaptando formato y proporciones para cada canal. En lugar de usar la IA solo para fondos o ilustraciones de acompañamiento, se puede delegar la pieza completa y solo supervisar.

En documentación y reporting, Images 2.0 permite generar infografías, gráficos y visualizaciones con etiquetas legibles y datos reales, ya que puede apoyarse en la búsqueda web o en información proporcionada por el usuario. Esto abre la puerta a informes visuales generados casi en tiempo real a partir de textos o tablas, sin tener que diseñar las gráficas a mano; por ejemplo, automatizando procesos de captura y extracción de texto para datos a incluir en las visualizaciones.

En producto y diseño UX, la capacidad del modelo para crear capturas de pantalla e interfaces muy verosímiles es especialmente interesante. Se pueden producir maquetas de aplicaciones, dashboards o webs completas a partir de una descripción natural, útiles para presentaciones internas, propuestas a clientes o incluso como base para que un diseñador las refine.

En educación, la creación de cuadernos de ejercicios ilustrados, apuntes visuales o historietas didácticas se simplifica enormemente. Un profesor puede pedir un conjunto de viñetas con personajes que expliquen un concepto, todas con el mismo estilo y con textos adaptados a la edad del alumnado, sin necesidad de encargos a ilustradores externos para cada iteración.

Y para desarrolladores y “builders” de herramientas de IA, el modelo desbloquea flujos antes inviables: bots capaces de generar automáticamente portadas de artículos, miniaturas para vídeo, plantillas de presentaciones o creatividades personalizadas a partir de datos de usuario, todo ello con la confianza de que el texto visible no estará hecho un desastre.

Disponibilidad, API y segmentación entre usuarios

OpenAI ha anunciado que ChatGPT Images 2.0 estará disponible para todos los usuarios de ChatGPT y Codex, con la salvedad de que quienes pagan por planes de suscripción podrán acceder a resultados más avanzados o a un mayor volumen de generación. Es una estrategia que encaja con el modelo de negocio habitual de la compañía: ofrecer una base potente en la versión gratuita y reservar la máxima capacidad para los clientes de pago.

Además, la empresa lanzará la API gpt-image-2, pieza clave para que desarrolladores integren el modelo en sus propias aplicaciones. El esquema de precios dependerá de la calidad y la resolución de las imágenes solicitadas, siguiendo la lógica habitual de los servicios de OpenAI: mayor tamaño y más calidad implican un coste superior por generación.

Antes del anuncio oficial, la comunidad ya había detectado la existencia de GPT Image 2 mediante pruebas A/B dentro de ChatGPT. Algunos usuarios notaron que, de repente, las imágenes con texto salían mucho mejor que antes, y desarrolladores que monitorizan respuestas de la API vieron aparecer cadenas de versión nuevas en los metadatos. A partir de ahí empezaron las comparativas sistemáticas, que confirmaron un salto claro en calidad.

En cuanto a plazos, OpenAI no ha dado una fecha cerrada para la disponibilidad plena via API, pero su patrón suele ser claro: pruebas internas, despliegue para grupos seleccionados, activación progresiva en ChatGPT y, finalmente, apertura en la API con documentación y ejemplos. GPT Image 1 siguió una trayectoria similar, así que es razonable esperar algo parecido con Images 2.0.

Para usuarios finales, esto significa que muchas plataformas de terceros que ya integran modelos de OpenAI incorporarán el nuevo generador sin que haya que hacer nada especial. Desde herramientas de automatización de contenidos hasta editores online, bastará con que sus desarrolladores actualicen la llamada de modelo; los usuarios notarán simplemente que, de repente, los textos en las imágenes dejan de fallar.

Qué cambia para diseñadores, creadores y empresas

La entrada en escena de ChatGPT Images 2.0 marca un punto de inflexión en cómo se percibe la generación visual por IA en entornos profesionales. Hasta ahora, muchos equipos de diseño o marketing la veían como un juguete curioso o una ayuda para bocetar ideas, pero no como algo en lo que confiar para materiales finales.

Con un modelo capaz de escribir texto correcto, respetar estilos y generar composiciones densas a alta resolución, la conversación cambia. Pasa a ser una herramienta que puede encargarse de un porcentaje significativo del trabajo repetitivo: adaptaciones de campañas a múltiples formatos, versiones multilingües de una misma pieza, variantes de un diseño para pruebas A/B, etcétera.

Para los diseñadores, lejos de ser una amenaza directa, puede funcionar como un acelerador. En lugar de invertir horas en tareas mecánicas, pueden centrarse en la dirección de arte, la definición de la identidad visual o la creación de conceptos originales, dejando que la IA se ocupe de generar y refinar propuestas bajo sus instrucciones.

En empresas sin grandes equipos creativos, el impacto puede ser incluso mayor. Pymes, medios pequeños o proyectos personales pasan a tener acceso a un nivel de calidad visual que antes exigía contratar servicios externos o comprar plantillas genéricas. Eso no elimina la necesidad de criterio, pero sí baja mucho la barrera de entrada.

Al mismo tiempo, la mejora en texto obliga a plantear con más seriedad cuestiones de ética, uso responsable y verificación de contenidos. Si un cartel, una captura de pantalla o una supuesta fotografía con rótulos parecen completamente auténticos, distinguir lo generado de lo real se complica, lo que refuerza la importancia de sistemas de trazabilidad, marcas de agua y políticas claras en plataformas y medios.

En conjunto, ChatGPT Images 2.0 representa el paso de las imágenes “bonitas pero sospechosas” a las imágenes que se pueden poner a trabajar. Menús que se podrían imprimir tal cual, interfaces que parecen sacadas de un producto operativo, infografías con datos correctos y etiquetas legibles… todo ello generado conversando con un modelo de lenguaje que entiende contexto, puede buscar información y es capaz de revisar lo que produce. Si algo define este salto, es que ya no hablamos solo de espectacularidad visual, sino de utilidad real para el día a día.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.