- ChatGPT Salud integra historiales clínicos y apps de bienestar con la IA de OpenAI, empezando en Estados Unidos.

- La herramienta se centra en resolver dudas cotidianas, interpretar resultados y ayudar con seguros médicos, sin diagnosticar ni tratar.

- OpenAI refuerza la privacidad: cifrado, espacio separado, datos de salud fuera del entrenamiento de modelos y control del usuario.

- El uso masivo de ChatGPT para consultas sanitarias revela carencias del sistema de salud de EE.UU. y abre debates éticos para Europa.

La irrupción de ChatGPT en el ámbito de la salud está marcando un nuevo punto de inflexión en la relación entre pacientes, datos médicos y sistema sanitario, especialmente en Estados Unidos. OpenAI ha decidido dar un paso más con el lanzamiento de ChatGPT Salud, una nueva experiencia dentro del asistente conversacional que se apoya en la integración de historiales clínicos y aplicaciones de bienestar para ofrecer respuestas mucho más contextualizadas.

Este movimiento llega después de que la propia compañía reconociera que la salud es ya uno de los temas más consultados en ChatGPT, con cientos de millones de preguntas semanales sobre bienestar, síntomas, pruebas diagnósticas o seguros médicos. En un país como EE.UU., donde navegar el sistema sanitario es un auténtico laberinto, la herramienta se presenta como un apoyo adicional para el paciente, aunque envuelta en fuertes debates sobre precisión, privacidad y límites de la inteligencia artificial.

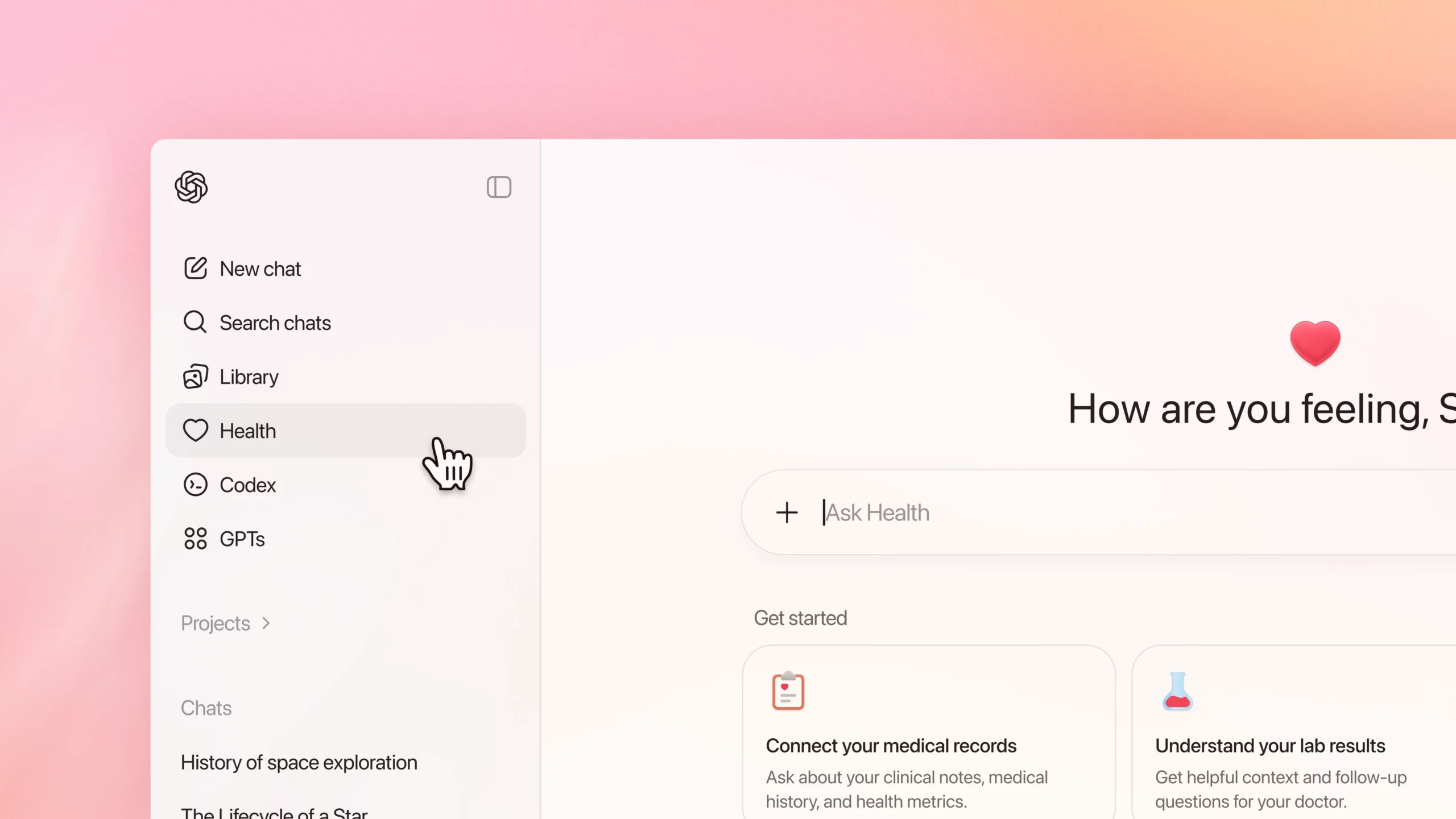

Qué es exactamente ChatGPT Salud y qué pretende hacer

ChatGPT Salud es una sección específica dentro de ChatGPT pensada para agrupar todo lo relacionado con bienestar y atención sanitaria en un único espacio. La idea de OpenAI es que el usuario pueda conectar su información médica personal con el chatbot para recibir explicaciones y orientaciones basadas en sus propios datos, y no solo en respuestas genéricas.

La compañía insiste en que esta experiencia no está diseñada para diagnosticar enfermedades ni para prescribir tratamientos. Su función es más bien acompañar al usuario en tareas del día a día: comprender informes, preparar visitas médicas, interpretar resultados de laboratorio o aclarar dudas sobre pólizas y facturas de seguros. Es decir, busca cubrir ese tramo intermedio entre la búsqueda en internet y la consulta con un profesional.

Según OpenAI, ChatGPT Salud se ha construido para dar cabida a un problema muy frecuente: la información sanitaria del paciente suele estar dispersa entre portales hospitalarios, apps de ejercicio, PDFs con análisis y notas médicas. La nueva pestaña intenta concentrar todo eso en un entorno único, con un lenguaje más llano y una interacción conversacional.

La propia firma de Sam Altman admite que este es solo el comienzo de una estrategia más amplia, en la que la IA podría ir ampliando el número de fuentes que es capaz de integrar y el tipo de tareas de apoyo que puede asumir dentro del ecosistema sanitario.

Integración con historiales clínicos y apps de bienestar

Una de las piezas clave del proyecto es la posibilidad de conectar historiales médicos electrónicos y aplicaciones de salud directamente con ChatGPT Salud. En el caso de Estados Unidos, OpenAI colabora con b.well, una red de datos sanitarios en tiempo real orientada al consumidor, que permite importar expedientes médicos bajo estándares de seguridad elevados.

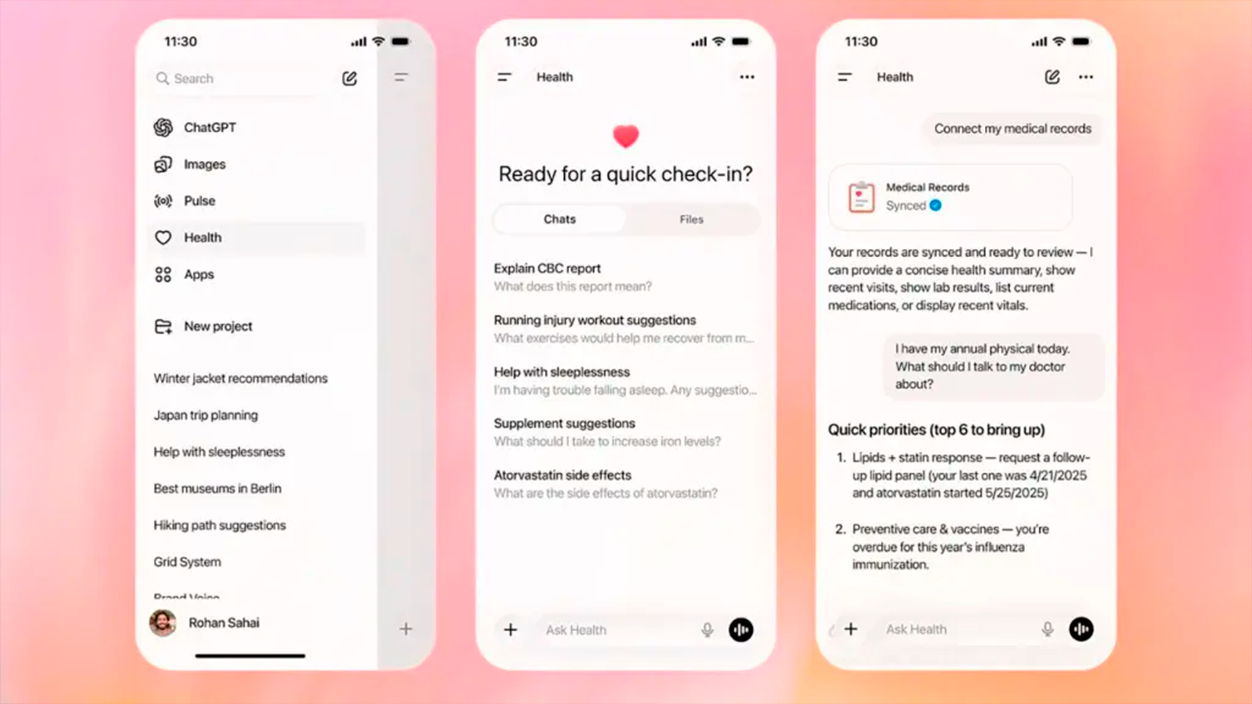

Esta integración está inicialmente restringida a usuarios mayores de 18 años en territorio estadounidense, que pueden vincular sus registros para que el chatbot tenga contexto sobre pruebas previas, resúmenes de visitas, diagnósticos antiguos o medicación en curso. El acceso, recalca OpenAI, puede revocarse en cualquier momento desde el apartado de aplicaciones de la configuración.

Además de los historiales clínicos, la experiencia admite la conexión de aplicaciones de bienestar como Apple Health, Function o MyFitnessPal. A través de estos servicios, ChatGPT Salud puede tener en cuenta datos relacionados con el sueño, la actividad física, la alimentación o el peso, junto con registros de otros dispositivos y wearables.

Con esa combinación, la IA es capaz de interpretar resultados recientes, detectar patrones a lo largo del tiempo e incluso adaptar las explicaciones a hábitos concretos del usuario. Por ejemplo, puede ayudar a entender por qué se ha alterado un valor en una analítica, sugerir preguntas para plantear al médico o cruzar el plan de ejercicio recomendado con el horario real que recogen los dispositivos conectados.

OpenAI sostiene que todas las apps integradas en la sección Salud deben cumplir requisitos estrictos de privacidad y seguridad, limitarse a los datos mínimos necesarios y superar una revisión adicional antes de incorporarse al sistema, un aspecto especialmente relevante de cara a un eventual despliegue en Europa bajo marcos como el RGPD.

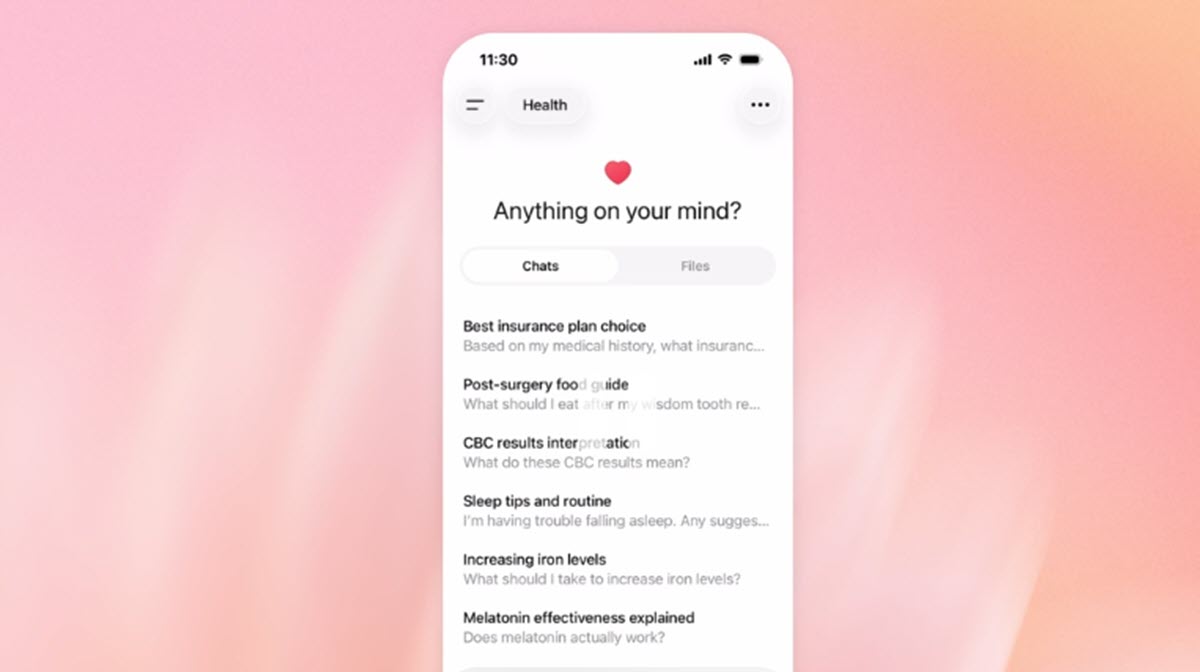

Cómo se usa ChatGPT Salud en la práctica

Desde el punto de vista del usuario, ChatGPT Salud aparece como una pestaña diferenciada con historial propio, separada del resto de conversaciones que se mantienen en el asistente. Dentro de esa sección se almacenan los chats, los archivos subidos, las aplicaciones vinculadas y cualquier memoria que el sistema genere sobre la situación de salud del usuario.

Para empezar a utilizarla, el paciente puede cargar documentos clínicos directamente (informes, resultados de laboratorio, resúmenes de alta, etc.) o activar la conexión con las aplicaciones de bienestar compatibles desde el menú de herramientas o desde el panel de configuración. Una vez hecho esto, el funcionamiento es muy similar al chat habitual, pero con un contexto sanitario mucho más rico.

En este entorno especializado se pueden enviar fotos, adjuntar PDFs, usar dictado por voz o aprovechar funciones de búsqueda para moverse por conversaciones anteriores. La herramienta también permite añadir instrucciones personalizadas solo para la pestaña de Salud, por ejemplo para priorizar determinados temas, evitar otros más sensibles o ajustar el nivel de detalle de las explicaciones.

Entre los casos de uso que OpenAI destaca como más habituales aparecen tareas como preparar una visita médica (organizando síntomas, fechas y preguntas), revisar informes que el usuario no termina de comprender, o contrastar las ventajas e inconvenientes de seguros médicos según el patrón de uso sanitario de cada persona.

Un punto importante es que el sistema intenta sugerir cuándo acudir a un profesional, especialmente ante síntomas que pueden requerir atención urgente. Sin embargo, la propia empresa remarca que ChatGPT Salud no sustituye el juicio clínico y que, ante dudas serias, el chatbot debe verse como un apoyo para comunicarse mejor con el médico, no como un filtro que decida si se busca ayuda o no.

El contexto de EE.UU.: seguros, facturas y laberintos administrativos

Más allá de las funciones puramente médicas, los datos de uso recopilados por OpenAI muestran que una parte enorme de las consultas semanales tiene que ver con el seguro médico y la facturación. Millones de mensajes giran en torno a precios de procedimientos, reclamaciones, coberturas, códigos de facturación y dudas sobre qué incluye realmente cada póliza.

En la práctica, muchos usuarios emplean ChatGPT como una especie de GPS dentro del sistema sanitario estadounidense, pidiéndole que traduzca jerga técnica, que les ayude a redactar cartas de reclamación o que les indique paso a paso qué deben preguntar a su aseguradora o al hospital antes de aceptar un presupuesto.

Este fenómeno encaja con datos externos, como las encuestas que indican que una parte significativa de la población renuncia a pruebas o tratamientos recomendados por puro coste económico. En ese escenario, tener una herramienta que facilite entender facturas, estimar gastos y preparar negociaciones con la aseguradora puede marcar la diferencia entre seguir adelante con una intervención o descartarla.

Sin embargo, ningún chatbot puede garantizar la respuesta de una compañía de seguros ni sustituir documentación oficial. Su papel es más bien ayudar a comprender el terreno de juego y rebajar la sensación de indefensión que produce enfrentarse a un sistema burocrático complejo, algo que también resulta familiar en ciertos trámites sanitarios europeos, aunque el contexto de financiación sea distinto.

Otra realidad que resalta el informe es el uso intenso del sistema en horarios en los que los centros sanitarios están cerrados, lo que sugiere que muchas personas recurren a la IA en plena madrugada para decidir si esperan a la consulta habitual o si acuden a urgencias. Aquí se abre uno de los debates más sensibles, porque el riesgo de interpretar la respuesta como una orden médica es alto cuando el usuario está asustado o con dolor.

Desiertos sanitarios, apoyo en zonas rurales y relación con Europa

OpenAI también subraya que una parte relevante de las conversaciones sobre salud proviene de zonas rurales y regiones con escasez de recursos sanitarios. En esos llamados “desiertos sanitarios”, donde faltan especialistas y los desplazamientos son largos, ChatGPT se usa como una especie de puente temporal hasta la próxima visita.

En ese tipo de contextos, la IA ayuda a interpretar resultados que ya se tienen, preparar el encuentro con el médico o decidir si un síntoma justifica el viaje inmediato a un centro sanitario. De nuevo, el objetivo oficial no es que la herramienta sustituya al profesional, sino que el paciente llegue a la consulta con la situación mejor organizada y las dudas más claras.

Si se proyecta este uso a Europa, la foto cambia pero no del todo. Aunque los sistemas europeos son en su mayoría de financiación pública y con cobertura más universal, también existen áreas rurales con menos especialistas, listas de espera prolongadas y dificultades para acceder a información clara sobre pruebas y tratamientos.

En países como España, donde las competencias sanitarias están muy fragmentadas y los portales de paciente varían por comunidad, una experiencia del tipo ChatGPT Salud podría, en teoría, ayudar a unificar la lectura de informes y la planificación de cuidados para la ciudadanía. No obstante, cualquier despliegue requeriría un encaje fino con la normativa europea de protección de datos y con las agencias reguladoras nacionales.

Además, la población europea suele mostrar una sensibilidad especialmente alta hacia la cesión de datos de salud a empresas tecnológicas privadas, por lo que la aceptación social de un servicio como este, incluso con garantías técnicas sólidas, no está ni mucho menos garantizada.

Privacidad, seguridad y tratamiento de los datos de salud

Conscientes de la delicadeza del terreno, desde OpenAI se ha insistido en que ChatGPT Salud funciona como un entorno separado con privacidad reforzada. La empresa asegura que las conversaciones de salud no se utilizan para entrenar los modelos principales, pese a preocupaciones sobre brechas de datos, un punto clave para quienes desconfían de que sus datos médicos terminen alimentando sistemas de IA de uso general. Además, se aplican capas adicionales de cifrado tanto en tránsito como en reposo, y se recomienda activar la autenticación multifactor para reducir el riesgo de accesos no autorizados.

En lo que respecta a las aplicaciones conectadas, OpenAI explica que solo se accede a la información de salud con permiso explícito del usuario, incluso si esas apps ya estaban vinculadas fuera de la pestaña de Salud. Se informa de qué tipos de datos puede recoger cada servicio y el usuario puede cortar la conexión de forma inmediata desde la configuración.

La compañía subraya también que los modelos se han entrenado para no retener información personal concreta procedente de los chats y que existen herramientas para eliminar conversaciones de sus sistemas en un plazo determinado. Este enfoque, si bien responde a las preocupaciones de privacidad en EE.UU., recuerda inevitablemente a los requisitos más estrictos que impone la normativa europea en materia de datos sensibles.

Para el debate en España y en la UE, aspectos como la separación de entornos, la desactivación del entrenamiento con datos de salud o la obligación de informar con claridad sobre los flujos de datos serán determinantes a la hora de evaluar futuras integraciones o posibles pilotos en sistemas públicos.

Un desarrollo validado con profesionales sanitarios

Otro de los pilares del proyecto es la colaboración con la comunidad clínica. OpenAI afirma haber trabajado durante más de dos años con más de 260 profesionales sanitarios de 60 países y de múltiples especialidades para definir qué hace que una respuesta en salud sea realmente útil y, sobre todo, qué la convierte en potencialmente peligrosa.

Este grupo de expertos habría aportado más de 600.000 valoraciones sobre las salidas del modelo en unas 30 áreas clave, ayudando a ajustar tanto el contenido como el tono y la urgencia con la que se anima al usuario a buscar atención presencial. La intención es reducir al máximo respuestas ambiguas o poco prudentes, especialmente en situaciones clínicas delicadas.

Como parte de ese trabajo, la compañía ha desarrollado HealthBench, un marco de evaluación propio que, en lugar de usar únicamente preguntas tipo examen, se centra en criterios más cercanos a la práctica médica real: seguridad, claridad, adecuación de la derivación a un profesional y respeto al contexto individual de cada paciente.

Según OpenAI, este enfoque permite que ChatGPT Salud sea más fiable a la hora de explicar en lenguaje sencillo resultados de laboratorio, resumir instrucciones de alta, sugerir cuestiones para plantear al médico o interpretar los datos provenientes de dispositivos y apps de bienestar.

Pese a esta validación, la empresa insiste en la misma idea: el objetivo es complementar el trabajo de los profesionales sanitarios, liberándoles de parte de la carga explicativa y administrativa, pero sin reemplazar el juicio clínico ni la relación directa con el paciente.

Alucinaciones, confianza y límites de la IA en salud

El propio ecosistema tecnológico no deja pasar por alto los riesgos de un sistema como este. Las llamadas “alucinaciones” de la IA —respuestas incorrectas presentadas con gran seguridad— son especialmente problemáticas cuando el tema es la salud, porque el usuario puede confundir la fluidez verbal con precisión científica.

Críticas recogidas en medios especializados señalan que, en momentos de angustia o ansiedad, un paciente puede aferrarse a la respuesta de un chatbot como si fuese una opinión médica firme, aunque el sistema esté pensado solo para ofrecer orientación general; casos como demandas por suicidio han elevado la alarma sobre los riesgos de confianza excesiva.

Además de la precisión, aparece la cuestión de la privacidad en conversaciones muy emocionales. Volcar detalles íntimos de la propia historia clínica en un chat puede resultar tentador cuando se percibe la IA como un interlocutor paciente y siempre disponible, pero ese impulso debe equilibrarse con buenas prácticas de minimización de datos y con un entendimiento claro de qué se almacena y bajo qué condiciones.

Para mitigar estos problemas, el diseño de ChatGPT Salud incorpora mensajes de advertencia, recordatorios de que no sustituye al médico y una tendencia a recomendar atención profesional cuando aparecen señales de alarma. Aun así, la responsabilidad final sigue recayendo en el usuario y en cómo interpreta las respuestas.

En Europa, donde los reguladores han mostrado una especial preocupación por los usos de la IA en ámbitos sensibles, este tipo de riesgos será un elemento central en cualquier discusión sobre la conveniencia de introducir herramientas similares en entornos sanitarios públicos o privados.

Disponibilidad, despliegue gradual y dudas sobre su llegada a Europa

Por el momento, ChatGPT Salud se está desplegando de manera limitada, con un grupo reducido de usuarios tempranos que acceden a la nueva pestaña a través de una lista de espera. OpenAI planea ampliar la disponibilidad progresivamente en la web y en iOS durante las próximas semanas en Estados Unidos.

La compañía no ha facilitado fechas concretas para otros mercados, ni ha aclarado cuándo podría llegar a países europeos o bajo qué condiciones. La integración con historiales clínicos, en particular, parece estrechamente ligada a la infraestructura de datos sanitarios estadounidense y a acuerdos con intermediarios como b.well.

En el ámbito europeo, un hipotético despliegue de ChatGPT Salud tendría que alinearse con la normativa comunitaria de protección de datos, los requisitos de los reguladores nacionales y, previsiblemente, con el marco específico que se vaya configurando en torno a la futura regulación de la inteligencia artificial.

Mientras tanto, es probable que los usuarios de España y de otros países de la UE sigan utilizando la versión general del asistente para consultas de salud de carácter informativo, con las limitaciones que ya se han ido introduciendo para evitar consejos médicos directos y para reducir el riesgo de interpretaciones peligrosas.

En este contexto de pruebas en EE.UU. y cautela en otros mercados, ChatGPT Salud se perfila como un experimento de alto impacto: una herramienta que nace para organizar datos, aclarar dudas y acompañar al paciente, pero que también pone sobre la mesa las tensiones entre innovación tecnológica, acceso a la sanidad, privacidad y seguridad clínica, cuestiones que tanto en Estados Unidos como en Europa seguirán marcando el debate durante los próximos años.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.