- Claude, el chatbot de Anthropic, ha escalado al top del App Store de EE. UU., llegando a disputar y en algunos momentos superar a ChatGPT.

- Su auge se apoya en una gran ventana de contexto, foco en seguridad y ética, y una experiencia móvil muy cuidada.

- La controversia con el Pentágono y los acuerdos de OpenAI con Defensa han disparado la atención pública y el debate sobre el uso militar de la IA.

- Para empresas y startups en España y Europa, el caso refuerza la idea de un mercado de IA más maduro, diverso y alineado con regulaciones como el AI Act.

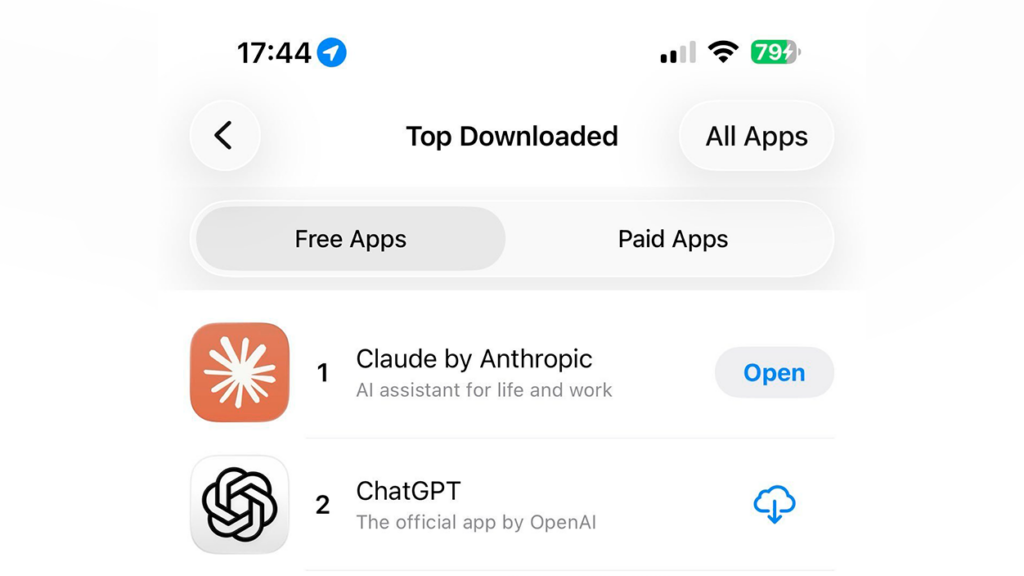

El ecosistema de inteligencia artificial generativa vive un movimiento que pocos daban por hecho tan pronto: Claude, el asistente conversacional de Anthropic, ha conseguido colocarse en la parte alta del App Store de Estados Unidos, peleando de tú a tú con ChatGPT y superando a Google Gemini en descargas. Lo que parecía un duelo casi cerrado se ha convertido en una competición abierta en la que los usuarios empiezan a mirar más allá del nombre más conocido.

Este cambio en los rankings no es solo una anécdota de tienda de aplicaciones. El ascenso de Claude en el App Store refleja que la forma en la que personas, empresas y equipos técnicos eligen su asistente de IA está madurando. En un contexto como el europeo, donde pesan mucho la regulación, la privacidad y la ética, que una alternativa centrada en la seguridad y el control del uso gane terreno envía un mensaje claro al mercado.

De fuera del top 100 a lo más alto del App Store

En cuestión de semanas, los datos de firmas de analítica como SensorTower han pasado de situar a Claude fuera del top 100 de apps gratuitas del App Store estadounidense a verlo dentro del top 20 durante febrero, para después escalar hasta el segundo puesto e incluso llegar a disputarle el liderato a ChatGPT. El podio se ha ido configurando con ChatGPT en la primera posición, Claude en la segunda y Google Gemini ocupando el tercer lugar.

Ese salto tan brusco no responde a una simple actualización de producto o a una campaña de publicidad masiva. Varios medios especializados, desde TechCrunch hasta CNBC, apuntan a una mezcla de mejoras técnicas, boca a boca y un fuerte empujón mediático vinculado a la relación de Anthropic con el Pentágono y al debate sobre el uso militar de la IA.

Por el camino, Claude ha pasado por fases muy distintas: primero como app para usuarios avanzados y perfiles tech, después como alternativa visible a ChatGPT, y ahora como referencia clara en el App Store que compite por convertirse en el asistente de IA que la gente lleva en el bolsillo. Para el sector tecnológico europeo, que observa de cerca lo que ocurre en Estados Unidos, estos movimientos son un anticipo de lo que puede venir aquí.

Al mismo tiempo, el crecimiento no se ha limitado a las descargas gratuitas. Desde Anthropic se habla de un aumento notable de usuarios de pago: más del 60 % de subida en cuentas gratuitas desde principios de año, suscripciones diarias multiplicadas y una base de clientes de pago que se ha más que duplicado. Esto sugiere que no estamos solo ante curiosidad pasajera, sino ante una adopción que empieza a consolidarse.

El punto de inflexión: la controversia con el Pentágono

Una parte clave del tirón de Claude en la App Store tiene que ver con una disputa de alto perfil entre Anthropic y el Departamento de Defensa de Estados Unidos. La compañía, fundada y dirigida por Dario Amodei, llevaba tiempo colaborando con el gobierno en tareas como análisis de inteligencia, apoyo a operaciones y ciberseguridad dentro de redes clasificadas, siempre bajo ciertas limitaciones de uso.

El choque se produjo cuando el Pentágono trató de obtener un acceso prácticamente sin restricciones a los modelos de Anthropic para cualquier finalidad considerada legal, incluida la vigilancia masiva interna y el desarrollo de armas totalmente autónomas impulsadas por IA. La empresa se negó a eliminar salvaguardas diseñadas precisamente para impedir esos escenarios, algo que forma parte de su propuesta de “IA constitucional”.

Esa negativa desembocó en una respuesta agresiva desde Washington: se amenazó con cancelar un contrato valorado en alrededor de 200 millones de dólares, se planteó designar a Anthropic como riesgo para la cadena de suministro de seguridad nacional y se invocó la Ley de Producción para la Defensa para tratar de presionar a la compañía. El entonces presidente Donald Trump criticó públicamente a Anthropic en redes, lo que amplificó aún más el conflicto.

Paradójicamente, esa ofensiva institucional generó un efecto foco. La polémica saltó de los círculos especializados al gran público: titulares en televisión, debates en redes sociales y un interés creciente por “la app de IA que le planta cara al Pentágono”. El resultado fue un auténtico efecto Streisand aplicado al mundo de la inteligencia artificial, con miles de usuarios descargando Claude para ver de qué iba todo aquello.

OpenAI, acuerdos con Defensa y un mercado partido en dos

Mientras se tensaba la cuerda con Anthropic, OpenAI siguió una vía distinta. Su CEO, Sam Altman, anunció un acuerdo con el Departamento de Defensa para desplegar modelos de IA en redes clasificadas, asegurando la existencia de salvaguardas frente a vigilancia interna y armas autónomas. La interpretación de esos límites, en todo caso, ha sido objeto de debate entre expertos y opinión pública.

Ese movimiento ha llevado a que, de facto, el mercado de IA aplicada a entornos militares se divida entre actores dispuestos a flexibilizar ciertas barreras y otros que optan por mantener líneas rojas más duras, incluso a costa de perder contratos millonarios. En ese mapa, Anthropic ha terminado asociada a la defensa de una IA más restringida en usos sensibles, mientras OpenAI aparece como el proveedor preferente del gobierno estadounidense.

Para el conjunto del sector, esta situación tiene implicaciones de calado. Las empresas de IA ya no compiten solo en precisión del modelo o velocidad de respuesta; también lo hacen en postura ética, relación con los gobiernos y grado de apertura a usos de alto riesgo. Ese posicionamiento acaba influyendo en la percepción de marcas, en la elección de herramientas por parte de empresas y, como se ha visto con Claude, en el comportamiento de los usuarios de a pie.

Esta fragmentación también crea oportunidades para terceros. Startups, integradores y consultoras pueden construir propuestas de valor diferenciadas según con qué proveedor trabajen y qué límites acepten. En Europa, donde la regulación tiende a marcar más distancia con los usos militares controvertidos, la postura de Anthropic puede encajar mejor con las exigencias de muchas organizaciones públicas y privadas.

Por qué los usuarios están eligiendo Claude en el App Store

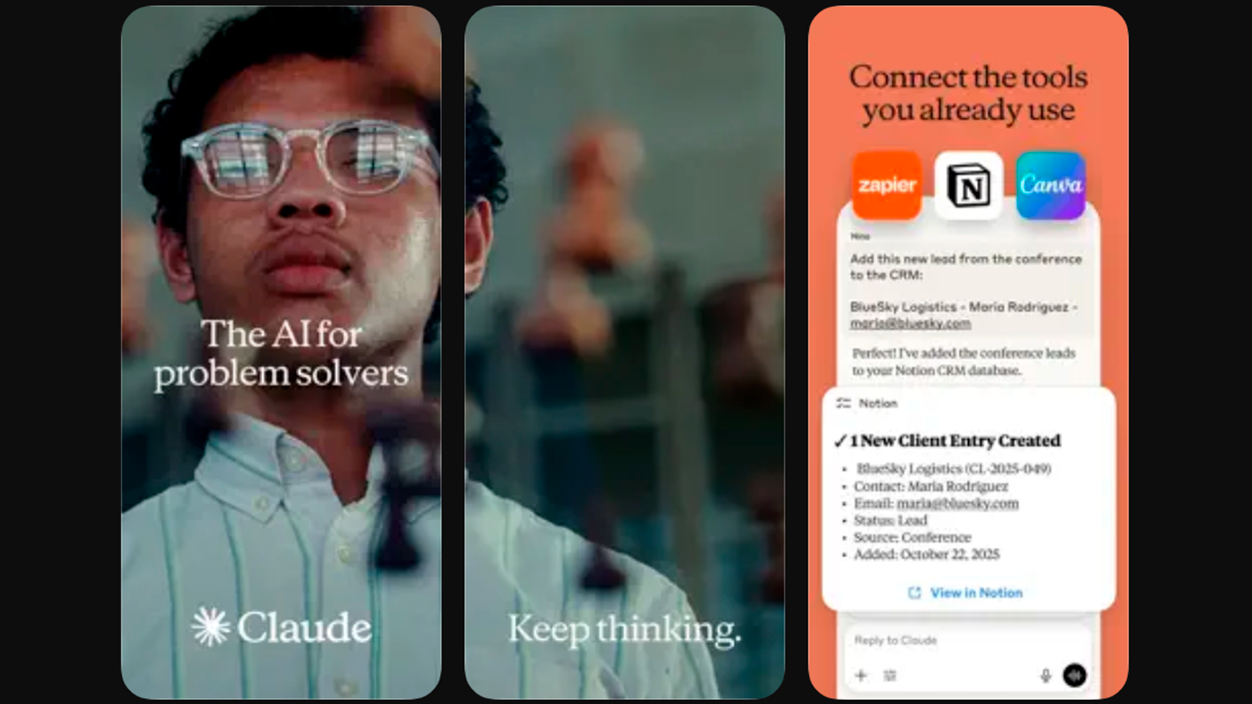

Más allá del ruido político, el crecimiento de Claude en la App Store se sostiene en una serie de atributos técnicos y de producto que están pesando mucho en la elección de los usuarios, especialmente los más exigentes. Uno de los puntos más citados es su ventana de contexto ampliada, que permite trabajar con documentos largos, conversaciones extensas e hilos complejos sin perder coherencia.

Para profesionales que manejan contratos, informes técnicos, documentación legal o grandes bases de conocimiento, poder cargar todo ese material y recibir análisis consistentes dentro de una misma sesión representa una ventaja competitiva clara. En empresas españolas y europeas, donde proliferan los casos de uso centrados en revisión documental y consultoría, este aspecto puede decantar la balanza.

Otro elemento clave es el enfoque de Anthropic en la IA constitucional. La compañía entrena sus modelos guiándose por un conjunto explícito de principios que buscan limitar sesgos, reducir respuestas peligrosas o inadecuadas y mantener ciertos estándares éticos. Para organizaciones europeas que se mueven bajo el paraguas del RGPD y del futuro AI Act, trabajar con un proveedor que enfatiza estos aspectos puede resultar más tranquilizador.

También se destaca el estilo de respuesta de Claude: muchos usuarios perciben un tono más matizado, menos automático y con mayor capacidad de razonamiento estructurado. En tareas que requieren explicar paso a paso cómo se llega a una conclusión, comparar escenarios o tomar decisiones informadas, este tipo de salida es especialmente valioso.

A nivel práctico, la app de Claude ha sido bien recibida por su interfaz sencilla y orientada a la productividad. Sin demasiadas florituras, permite organizar chats, adjuntar archivos y retomar contextos con facilidad desde el móvil. En un mundo en el que gran parte de la interacción con IA ocurre ya desde el smartphone, esa experiencia de uso marca diferencias tanto en Estados Unidos como en Europa.

Un mercado de IA más maduro, exigente y fragmentado

La escalada de Claude en el ranking del App Store confirma que el mercado de asistentes de IA está entrando en una fase de mayor madurez. Los usuarios ya no se conforman con tener “un chatbot cualquiera”; comparan, prueban y se quedan con la herramienta que mejor encaja con sus casos de uso, valores y expectativas de calidad.

En este escenario, el liderazgo deja de ser un título fijo. ChatGPT mantiene una posición dominante por base de usuarios, reconocimiento de marca e integración en el ecosistema de Microsoft, pero la irrupción de Claude demuestra que una combinación de producto sólido, ética definida y visibilidad mediática puede mover fichas incluso en un tablero tan competido.

Para empresas y administraciones europeas, esto se traduce en un abanico de opciones más amplio. Es cada vez más habitual ver arquitecturas en las que se combinan varios modelos de IA: Claude para análisis profundo de documentación, ChatGPT para generación rápida de contenido o prototipado, Gemini para integraciones con servicios de Google, y modelos abiertos desplegados en infraestructuras propias para usos muy específicos.

Esta diversificación no solo aumenta la resiliencia —al evitar dependencia total de un único proveedor—, sino que también permite adaptar mejor cada pieza del stack de IA a las exigencias regulatorias locales. En la Unión Europea, donde se está afinando la normativa sobre sistemas de alto riesgo, esa capacidad de elegir y mezclar herramientas será especialmente relevante.

La consecuencia directa es que el “ganador único” en la carrera de la IA es cada vez menos probable. En su lugar, se perfila un ecosistema en el que distintos actores lideran segmentos concretos, y donde la batalla se juega más en la calidad del resultado, la confianza y la experiencia de uso que en el simple efecto novedad.

Impacto y oportunidades para España y Europa

Que el gran salto de Claude se haya producido en el App Store estadounidense no significa que el asunto quede al otro lado del Atlántico. Para España y el resto de Europa, el caso sirve como señal y como aviso: las decisiones empresariales sobre ética, colaboración con gobiernos y diseño de salvaguardas no son detalles de marketing, sino factores que influyen directamente en la adopción.

En nuestro entorno, donde el AI Act europeo va a imponer obligaciones claras en transparencia, gestión de riesgos y supervisión humana, contar con herramientas que ya integren un fuerte enfoque en seguridad y gobernanza puede simplificar la vida a muchas organizaciones. La narrativa de Anthropic sobre límites al uso militar de la IA y rechazo a la vigilancia masiva encaja con las preocupaciones que suelen aparecer en los debates públicos europeos.

Para el ecosistema emprendedor, la situación abre varias líneas de trabajo. Por un lado, la posibilidad de ofrecer servicios de integración y consultoría alrededor de Claude, ChatGPT y otros modelos, ayudando a empresas españolas a elegir la combinación óptima según sector, sensibilidad de los datos y requisitos regulatorios. Por otro, la opción de construir productos verticales —en ámbitos como legal, sanitario o financiero— apoyándose en APIs de IA y añadiendo capas de adaptación local, cumplimiento normativo y especialización lingüística.

Además, el interés creciente por las implicaciones éticas de la IA abre espacio para soluciones europeas que destaquen precisamente por su alineación con los marcos regulatorios comunitarios. Aunque Anthropic y OpenAI son actores estadounidenses, su pugna en la App Store muestra que hay demanda real de herramientas que ofrezcan más control sobre cómo y para qué se usan los modelos.

En definitiva, el fenómeno Claude App Store funciona como un termómetro: indica hasta qué punto los usuarios están dispuestos a moverse hacia alternativas que combinan buenas prestaciones técnicas con un discurso claro sobre seguridad y límites de uso. Para España y Europa, donde esas preocupaciones son especialmente visibles, puede ser el anticipo de una adopción más selectiva y sofisticada de la IA en los próximos años.

Lo que está ocurriendo con Claude en el App Store deja claro que la carrera de la inteligencia artificial no se decide solo por quién llegó primero, sino por quién es capaz de ofrecer una herramienta útil, con resultados de calidad y un marco de uso que genere confianza. Entre la polémica con el Pentágono, el auge en descargas y el foco en seguridad, Anthropic ha conseguido situar su asistente en el centro del mapa competitivo, obligando a empresas y usuarios —también en España y en Europa— a replantearse qué esperan exactamente de un chatbot de IA y qué condiciones están dispuestos a aceptar a cambio de su potencia.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.