- Los deepfakes combinan redes neuronales y grandes volúmenes de datos para crear vídeos, imágenes y audios falsos cada vez más realistas.

- Los detectores avanzados analizan rasgos faciales, parpadeo, iluminación, audio y metadatos para estimar la probabilidad de manipulación.

- Medios, bancos, plataformas sociales y justicia dependen ya de estas herramientas para frenar desinformación, fraude y suplantación.

- La mejor defensa une tecnología de detección, regulación y pensamiento crítico para evaluar cualquier contenido viral.

Los vídeos deepfake en internet están creciendo a un ritmo brutal y cada vez resulta más complicado distinguir lo real de lo manipulado. La combinación de redes sociales, herramientas de IA al alcance de cualquiera y una falta general de verificación crea un caldo de cultivo perfecto para la desinformación, el fraude y el daño reputacional, tanto a personas como a empresas. ¿Es posible detectar vídeos deepfake en internet? La respuesta es sí. Pero hay que saber cómo.

En los últimos tiempos se están generalizando soluciones de detección de deepfakes que mezclan visión por computador, análisis forense digital y sentido común. No basta con mirar “a ojo”: hoy existen sistemas capaces de revisar microgestos faciales, metadatos, patrones de audio o incluso el flujo sanguíneo que reflejan los píxeles de un vídeo. En este artículo vamos a bajar al detalle: qué son los deepfakes, qué riesgos plantean, qué herramientas concretas puedes usar para detectarlos y qué papel juega el criterio humano y la regulación.

Qué es un deepfake y cómo se genera

Un deepfake es, en esencia, un contenido audiovisual falso generado o manipulado con técnicas de aprendizaje profundo. Puede ser un vídeo, una foto o un audio en el que se recrea el rostro, la voz o los gestos de una persona para hacerle decir o hacer cosas que nunca ocurrieron. El término viene de la unión de “deep learning” y “fake”, y se popularizó a raíz de los primeros montajes pornográficos donde se reemplazaban caras de actrices por las de famosas.

La mayoría de deepfakes modernos se construyen con redes neuronales profundas, sobre todo GAN (Generative Adversarial Networks) y CNN (Convolutional Neural Networks). Las CNN se especializan en entender y replicar patrones visuales complejos (rasgos faciales, texturas, sombras), mientras que las GAN enfrentan dos redes: una genera contenido falso y otra actúa como “policía” que intenta distinguir lo falso de lo real, obligando al generador a mejorar hasta producir resultados extremadamente convincentes.

Para llegar a ese grado de realismo, se alimenta al modelo con grandes volúmenes de datos de la persona a imitar: fotos, vídeos, audios, diferentes ángulos, gestos y condiciones de luz. Tras un proceso de entrenamiento en el que las dos redes (generador y discriminador) se retroalimentan, se obtiene un modelo capaz de producir secuencias donde la cara, la voz y los movimientos parecen legítimos a simple vista.

El flujo típico de creación suele incluir tres etapas principales: recopilación de datos, entrenamiento del modelo y generación del deepfake. En la fase final suele añadirse un refinado manual: corrección de deformaciones, suavizado de bordes, retoques de color o ajuste del audio para que encaje con la boca y el contexto.

Por qué los vídeos deepfake son un problema serio

El auge de los deepfakes no es una anécdota tecnológica: está teniendo impacto real en política, finanzas, periodismo, justicia y vida privada. Informes recientes apuntan a que el número de deepfakes se multiplica cada año, con crecimientos desorbitados de cientos de puntos porcentuales en regiones como Latinoamérica, y a que el mercado asociado a esta tecnología moverá miles de millones en pocos años.

Uno de los riesgos más evidentes es su uso en campañas de desinformación y manipulación política. Se han visto ya vídeos de líderes pidiendo rendirse en plena guerra, declaraciones inventadas de figuras públicas o montajes que buscan avivar teorías conspirativas. Aunque muchos de estos casos terminan siendo desenmascarados, el daño ya está hecho: la pieza circula masivamente antes de ser desmentida.

Otro frente crítico es el fraude y la suplantación de identidad. La combinación de clonación de voz y vídeo sintético permite, por ejemplo, llamar a un empleado suplantando a su jefe para ordenar una transferencia, o superar de forma fraudulenta procesos de verificación de identidad mediante selfies o videollamadas; un riesgo que también afecta a sistemas de verificación de edad en App Store. Instituciones financieras, fintech y empresas de verificación KYC son objetivos prioritarios de estos ataques.

Tampoco se puede ignorar el uso masivo de deepfakes para contenido sexual no consentido y ciberacoso. Una proporción altísima de los vídeos deepfake en la red tiene contenido pornográfico con caras de mujeres famosas o anónimas, incluidas menores de edad, sin ningún tipo de permiso. Esto plantea problemas graves de privacidad, de salud mental y de protección de la propia imagen, especialmente entre adolescentes.

Desde el punto de vista jurídico, los deepfakes introducen además el llamado “Liar’s Dividend”: incluso cuando un vídeo es genuino, una persona puede alegar que está manipulado y sembrar la duda. Esto complica la admisión y valoración de pruebas audiovisuales en procedimientos judiciales, reforzando la necesidad de peritajes forenses expertos y herramientas de verificación robustas.

Cómo funcionan los detectores avanzados de deepfakes

Las mejores soluciones actuales de detección de deepfakes combinan visión por computador, machine learning y análisis forense de vídeo, imagen y audio. La idea es cazar pequeñas incoherencias que, aunque pasen desapercibidas al ojo humano, se vuelven evidentes para un modelo entrenado con millones de ejemplos de contenido real y falso.

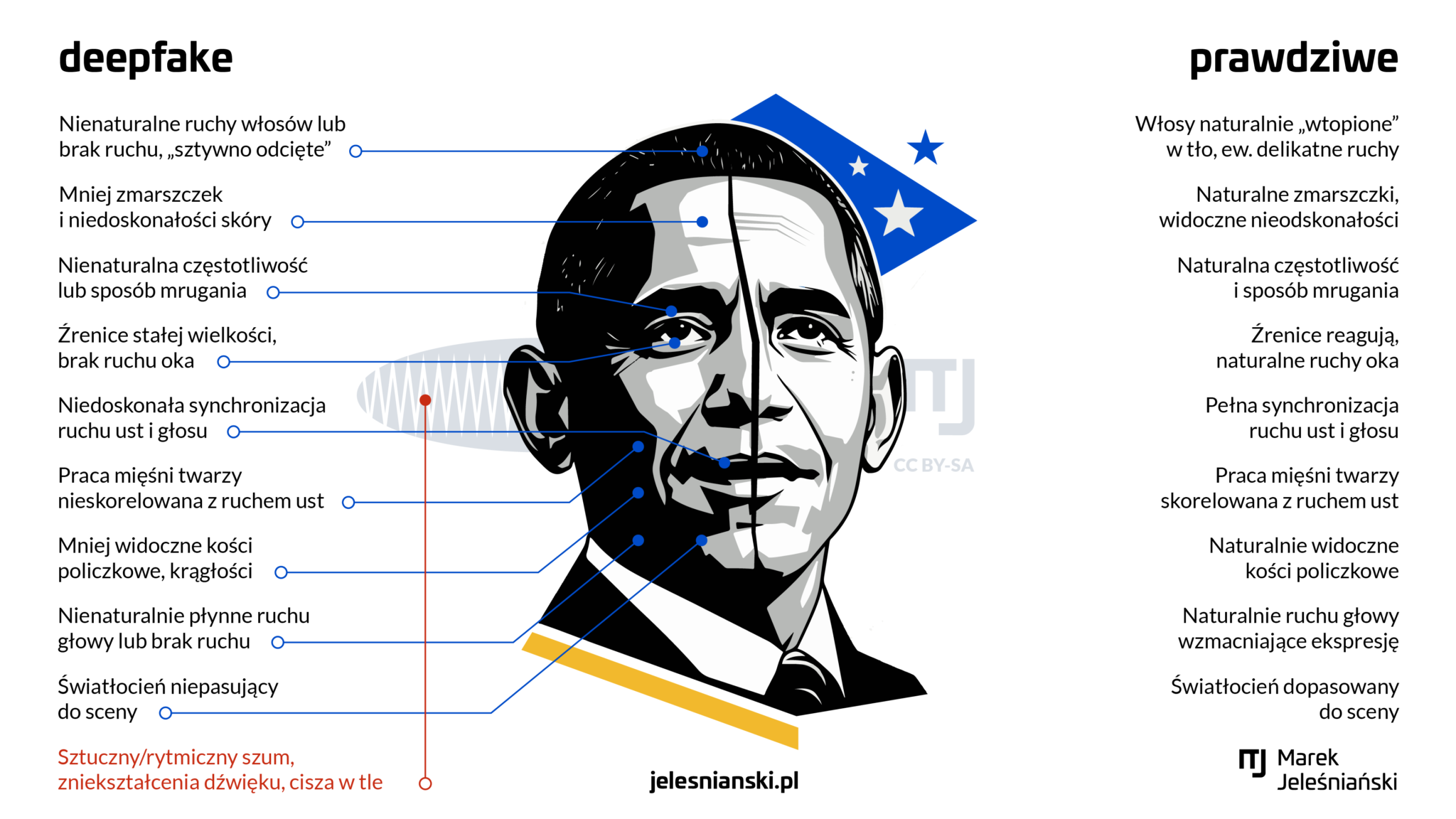

En el caso del vídeo, se analizan microexpresiones faciales, patrones de parpadeo, movimientos antinaturales y artefactos de compresión. Los deepfakes a menudo generan sutiles errores en la alineación de ojos y boca, en la continuidad temporal de los rasgos o en la forma en que se deforma la cara al hablar y gesticular. Los modelos más avanzados siguen puntos clave en el rostro (landmarks) y estudian su comportamiento fotograma a fotograma.

La iluminación también es una pista clave: sombras mal orientadas, brillos inconsistentes o reflejos imposibles pueden delatar que la cara ha sido pegada sobre otro cuerpo o entorno. A nivel de píxel, algunos detectores buscan patrones de ruido o texturas que las redes generativas tienden a repetir, así como anomalías en los bordes entre el rostro y el fondo.

En audio, los modelos revisan frecuencias, ritmo, entonación y coincidencia entre fonemas y movimientos de labios. Herramientas especializadas detectan voces clonadas analizando irregularidades en el espectrograma, artefactos propios de la síntesis y desajustes entre lo que se oye y lo que la boca aparenta pronunciar en vídeo.

Muchas soluciones profesionales integran estos análisis en APIs REST que devuelven puntuaciones de confianza, mapas de calor resaltando zonas manipuladas y metadatos forenses. Esto permite automatizar la moderación de contenido en plataformas, disparar alertas en sistemas de onboarding digital o ayudar a periodistas y verificadores en su trabajo diario.

Herramientas basadas en IA para detectar deepfakes

Una de las líneas de defensa más potentes la forman los detectores de deepfakes basados en aprendizaje automático que procesan vídeo, imagen y audio de forma automatizada. Vamos a repasar varias de las soluciones más representativas que se mencionan en las fuentes y en la literatura reciente.

Platforms como Sentinel ponen el foco en una detección en tiempo real de deepfakes con especial atención al rostro y al parpadeo. Este tipo de servicios permiten subir vídeos, imágenes o audios (o integrarse vía API) y devuelven informes donde se señalan las zonas sospechosas, de manera que el usuario puede ver exactamente dónde se ha retocado el material.

Otras soluciones como Sensity se orientan a monitorizar grandes volúmenes de contenido en redes sociales y plataformas online. Gracias a modelos de deep learning entrenados de forma continua, son capaces de localizar intercambios de caras, audios manipulados e imágenes generadas por IA a escala, algo fundamental para gobiernos, medios y compañías que luchan contra la desinformación visual y el fraude de identidad.

En el ámbito de la verificación de identidad, herramientas como HyperVerge se integran directamente en flujos KYC y procesos de onboarding digital para frenar ataques de suplantación. Combinan reconocimiento facial, detección de vida (liveness) y modelos anti-deepfake certificados (por ejemplo con normas como ISO 30107) para asegurarse de que quien aparece ante la cámara es una persona real y no un vídeo sintético reproducido frente al dispositivo.

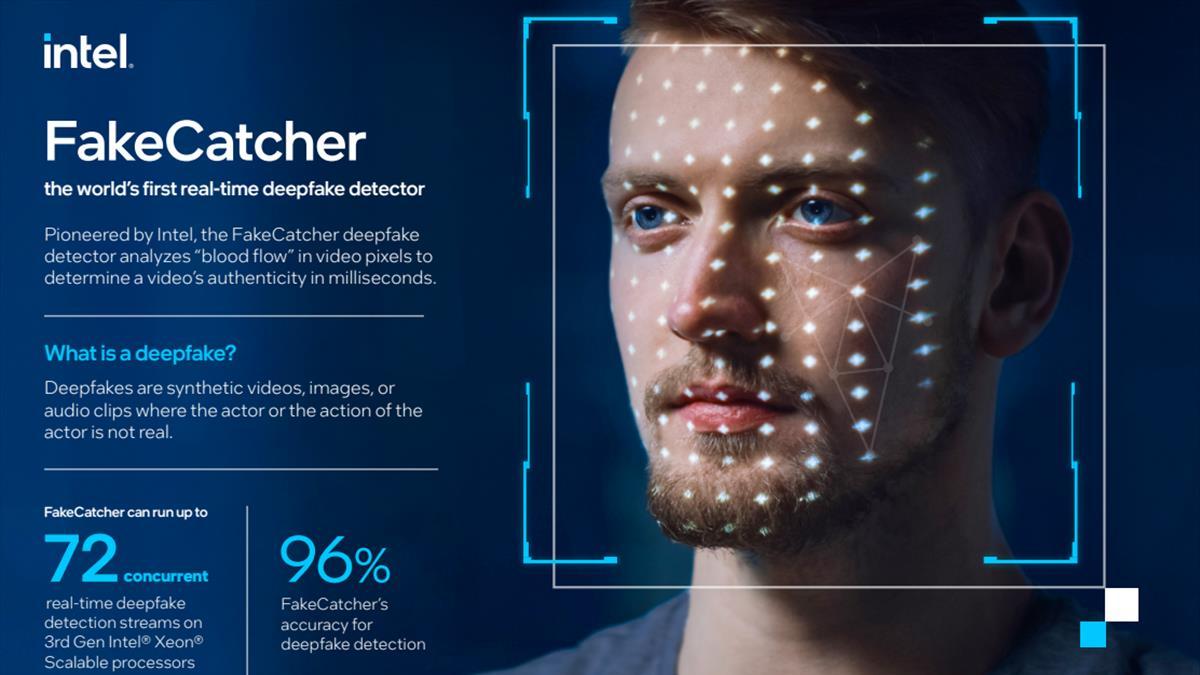

También han surgido soluciones forenses muy sofisticadas como el FakeCatcher de Intel, que se basa en algo tan sutil como el “flujo sanguíneo” perceptible en los píxeles de un vídeo. Analizando variaciones minúsculas de color en distintas zonas de la piel, puede estimar si el patrón se corresponde con una circulación sanguínea real o es una generación sintética sin esa coherencia fisiológica, alcanzando tasas de acierto muy elevadas y devolviendo resultados en milisegundos.

Para el usuario general hay opciones más accesibles como Deepware Scanner, que permite subir un vídeo o pegar un enlace para obtener una valoración sobre si hay indicios de deepfake. Este tipo de servicios suelen ofrecer un escaneo rápido que, sin ser infalible, sirve como primer filtro para decidir si conviene realizar un análisis más profundo.

Herramientas que analizan metadatos y estructura del archivo

Más allá del contenido visible, cualquier archivo digital lleva consigo metadatos: información sobre cuándo, cómo y con qué se creó o modificó. Aunque no existe una “etiqueta mágica” que diga «esto es un deepfake», revisar estos datos ayuda a reconstruir la historia del archivo y a detectar incoherencias.

Entre los datos habituales encontramos fecha y hora de creación y modificación, dispositivo y software utilizado, formato, resolución, geolocalización y datos de autoría. Que la fecha no cuadre con el evento que supuestamente se muestra, o que un vídeo atribuido a un móvil concreto aparezca como creado con un software de edición avanzado, ya es una señal de alarma.

Herramientas clásicas como MediaInfo o ExifTool permiten extraer y analizar estos metadatos de fotos, vídeos y audios. Aunque no están pensadas específicamente para deepfakes, son muy útiles en manos de periodistas, investigadores OSINT o peritos forenses, porque aportan contexto técnico y permiten ver si ha habido múltiples ediciones o conversiones sospechosas.

Eso sí, es importante tener claro que los metadatos son manipulables y a menudo se eliminan cuando se sube contenido a determinadas redes o se reexporta el archivo. Por ello deben utilizarse como una pieza más del puzzle, combinándolos con análisis visual, de audio y de procedencia criptográfica cuando esté disponible.

Herramientas centradas en anomalías específicas

Junto a los detectores generalistas han surgido soluciones pensadas para identificar patrones muy concretos que suelen fallar en los deepfakes. Son especialmente interesantes para investigadores y para casos complejos donde se necesita un nivel extra de detalle.

Un ejemplo claro es la herramienta basada en el desajuste entre fonemas (lo que se oye) y visemas (cómo se mueven los labios), desarrollada por investigadores de universidades como Stanford y California. Analiza vídeo y audio conjuntamente y detecta si hay incoherencias sistemáticas entre los sonidos y la articulación de la boca, algo relativamente habitual en montajes donde se sustituye el discurso original.

Otras plataformas como DuckDuckGoose apuestan por una detección de espectro completo, es decir, analizan diferentes tipos de manipulación visual y generan informes claros sobre cómo han llegado a su veredicto. Esto es especialmente valioso para empresas que necesitan justificar decisiones de moderación o para equipos legales que requieren trazabilidad en el análisis.

Tampoco hay que olvidar los proyectos pensados para apoyar al trabajo humano, como InVID, que se presenta como una extensión de navegador para descomponer vídeos en fotogramas clave. En lugar de darte directamente una etiqueta de “falso” o “real”, te facilita el material para que seas tú quien compruebe detalles como carteles, matrículas, sombras o elementos del contexto, apoyándote si lo deseas en búsquedas inversas de imágenes.

Incluso herramientas que no son detectores tradicionales, como ciertos asistentes de IA capaces de analizar vídeo fotograma a fotograma y resaltar posibles artefactos típicos de generación, pueden servir como ayuda inicial para decidir si un caso merece una investigación más técnica.

Recursos prácticos y herramientas concretas para el día a día

Si quieres empezar a evaluar contenidos por tu cuenta, existen plataformas accesibles que permiten subir vídeos o imágenes y obtener un informe básico. Algunas ofrecen planes gratuitos con límites por mes y versiones de pago para uso intensivo o empresarial.

Entre los detectores para vídeo e imagen, además de los ya mencionados, destacan servicios como Reality Defender o Sensity AI, que funcionan como capas adicionales de seguridad para empresas y plataformas que manejan grandes volúmenes de contenido. Muchas de ellas combinan análisis automático en la nube con paneles de control donde se revisan alertas y tendencias.

En el ámbito del audio, soluciones como IDLive Voice Clone Detection o TruthScan AI Voice Detector se centran en diferenciar voces reales de voces clonadas por IA. Son especialmente útiles para call centers, sistemas de banca telefónica y cualquier escenario donde una orden verbal pueda desencadenar acciones sensibles.

Para el mundo académico y textual, donde el reto principal es saber si un documento ha sido escrito por una persona o por un modelo de lenguaje, existen detectores como Copyleaks, TextDetector.ai, Compilatio, QuillBot AI Detector o Scribbr. No determinan si el texto es “verdadero” o “falso”, pero pueden ayudar a evaluar la autoría y el posible uso de IA generativa en trabajos académicos o informes.

En la práctica, muchas organizaciones combinan todas estas piezas: detectores de vídeo, herramientas de audio, análisis de metadatos y revisiones humanas, a menudo complementadas por metodologías OSINT (búsqueda de fuentes abiertas) que ayudan a contextualizar y verificar lo que se ve en pantalla.

El papel insustituible del criterio humano

Por muy avanzadas que sean las herramientas, seguimos necesitando mirar con espíritu crítico cualquier contenido llamativo que nos llega al móvil. Las máquinas ayudan, pero el primer filtro somos nosotros, y conviene interiorizar algunas buenas prácticas básicas.

Para empezar, es clave verificar siempre la fuente y la procedencia del vídeo. No es lo mismo un clip anónimo reenviado por WhatsApp que una pieza publicada por un medio contrastado que asume responsabilidad editorial. Si algo te llega sin contexto claro, plantéate de inmediato si merece tu confianza.

En segundo lugar, conviene fijarse en señales visuales sospechosas: contornos borrosos, sombras que no encajan, expresiones faciales extrañas o movimientos de ojos poco naturales. En los vídeos de peor calidad estas pistas saltan a la vista, pero incluso en montajes pulidos puede haber pequeños fallos en pendientes, gafas, manos que pasan por delante de la cara o transiciones bruscas en el fondo.

También tiene mucho sentido apoyarse en plataformas de verificación y fact-checking que ya están trabajando sobre muchos de los bulos virales. En España, proyectos como Maldita o Newtral publican desmentidos, análisis detallados y guías prácticas para que el público aprenda a detectar contenidos manipulados.

Por último, hay un componente de educación digital y pensamiento crítico que no se puede externalizar. Enseñar a jóvenes y adultos a desconfiar de lo que confirma sus sesgos, a contrastar versiones y a preguntar “quién gana con que yo crea esto” es tan importante como cualquier algoritmo de detección. La tecnología puede ser parte del problema o parte de la solución, según cómo la usemos.

A medida que los deepfakes se vuelven más realistas y accesibles, se hace evidente que la defensa pasa por una mezcla equilibrada de herramientas de detección, regulaciones claras y una ciudadanía con criterio. Los sistemas capaces de analizar movimientos faciales, parpadeos, iluminación, metadatos y audio en tiempo real ya existen y seguirán mejorando, pero su verdadero valor aparece cuando se integran en procesos responsables y se combinan con profesionales formados y usuarios que no se dejan arrastrar por cualquier vídeo viral que aparece en su pantalla.

Redactor especializado en temas de tecnología e internet con más de diez años de experiencia en diferentes medios digitales. He trabajado como editor y creador de contenidos para empresas de comercio electrónico, comunicación, marketing online y publicidad. También he escrito en webs de economía, finanzas y otros sectores. Mi trabajo es también mi pasión. Ahora, a través de mis artículos en Tecnobits, intento explorar todas las novedades y nuevas oportunidades que el mundo de la tecnología nos ofrece día a día para mejorar nuestras vidas.