- Ny model specialiseret i programmering med komprimering til lange sessioner uden at miste sammenhæng.

- Målbare forbedringer i benchmarks (SWE-Bench, SWE-Lancer, Terminal-Bench) og brug af færre tokens.

- Tilgængelig til Plus, Pro, Business, Edu og Enterprise; integration med Codex-værktøjer; offentlig API planlagt.

- Isoleret miljø uden netværk som standard, med sikkerheds- og overvågningskontroller.

OpenAI har introduceret GPT-5.1-Codex-Max, en ny model for kunstig intelligens orienteret mod softwareudvikling, der følger med lover at holde kursen i langsigtede projekter uden at miste kontekstI praksis taler vi om en udviklingen af Codex i stand til at udføre komplekse opgaver i timevis, med forbedringer i effektivitet og hastighed som er mærkbare i virkelige arbejdsgange.

Den store nyhed ligger i dens evne til at ræsonnere på en vedvarende måde takket være en hukommelseshåndteringsteknik kaldet komprimeringDenne tilgang gør det muligt for kontekstvinduet at blive mættet, før det bliver overbelastet. Systemet identificerer redundanser, opsummerer tilbehøret og gemmer det væsentlige.og dermed undgå de typiske forsømmelser, der forsinker langsigtede opgaver.

Hvad er GPT-5.1-Codex-Max?

Det er en specifik model til programmering optimeret til udvidede softwareudviklingsopgaverFra kodegennemgang til generering af pull requests og support af frontend-udvikling. I modsætning til tidligere generationer er det trænet til at opretholde konsistens på lange arbejdsdage og i depoter af betydelig størrelse.

OpenAI placerer GPT-5.1-Codex-Max et trin over Codex ved at tillade kontinuerlige strømme i 24 timer eller mere uden forringende resultaterFor disse byggeprodukter betyder det færre afbrydelser på grund af kontekstgrænser og mindre tid spildt på at genforklare opgaver i successive iterationer.

Tekniske innovationer og komprimeringsteknikken

Nøglen ligger i historiekomprimeringModellen identificerer, hvilke dele af konteksten der bogstaveligt talt er undværlige, opsummerer dem og bevarer kritiske referencer for at fortsætte med opgaven uden at overbelaste hukommelsen. Denne mekanisme kaldes også "komprimering" i nogle materialer, men den beskriver den samme proces med intelligent filtrering af konteksten.

Med dette fundament kan GPT-5.1-Codex-Max fortsætte med at iterere over koden, rette fejl og omstrukturere Hele moduler kan køres uden at kontekstvinduet bliver en flaskehals. I intensive brugssager reducerer det også antallet af tokens, der kræves til behandling, hvilket påvirker både omkostninger og latenstid.

Modellen inkorporerer en tilstand af "Ekstra høj" argumentation Til vanskelige problemer, med det formål at fordybe sig i analysen, når opgaven kræver det, samtidig med at der opretholdes ensartethed i output i processer med mange trin og afhængigheder.

Ydeevne og benchmarks: hvad tallene siger

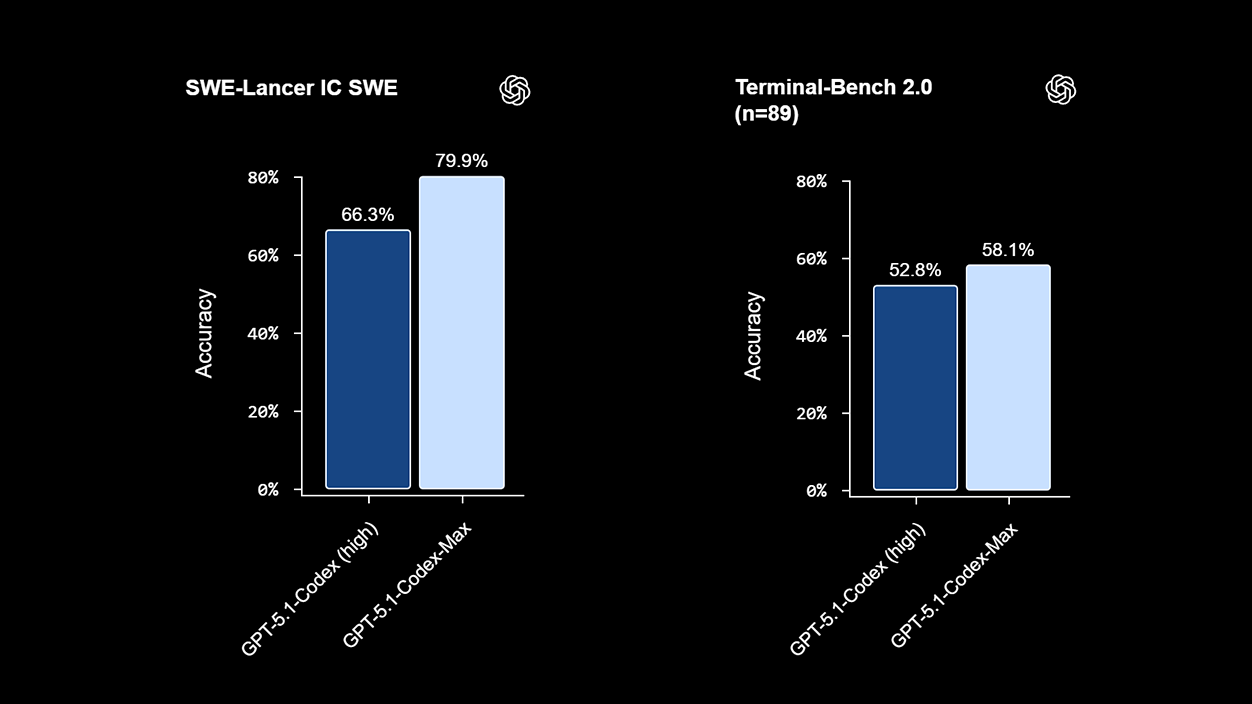

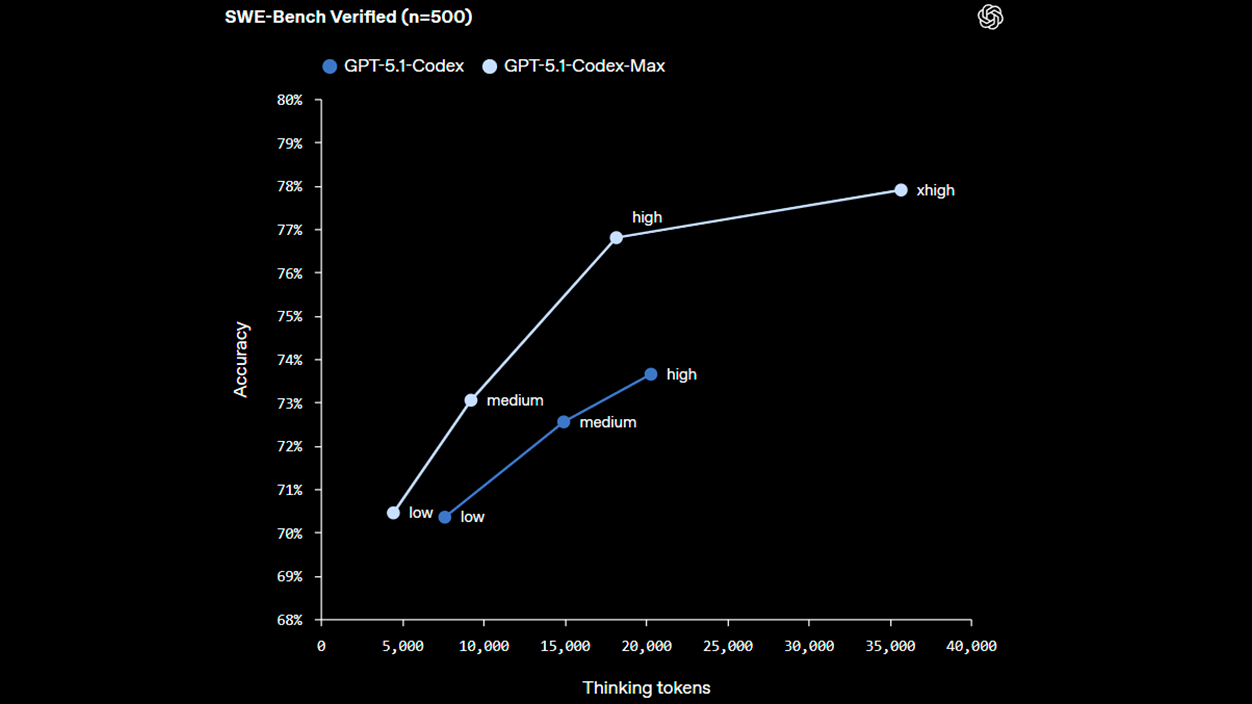

I interne evalueringer med fokus på programmering, GPT-5.1-Codex-Max er en forbedring i forhold til sin forgænger på forskellige fronter, med højere succesrater og større token-effektivitetDisse resultater, rapporteret af OpenAI, De afspejler tests på virkelige ingeniøropgaver og batterier såsom SWE-Bench Verified, SWE-Lancer IC SWE og Terminal-Bench 2.0..

Blandt de delte data når modellen ca. 77,9% på SWE-Bench verificeret (sammenlignet med 73,7 % af GPT-5.1-Codex), registre 79,9% i SWE-Lancer IC SWE og opnå 58,1% i Terminal-Bench 2.0Desuden er der i længerevarende sammenhænge målt hastighedsforøgelser på 27 % til 42 % i typiske opgaver sammenlignet med Codex ifølge de samme kilder.

I sammenligninger offentliggjort med andre modeller, som f.eks. Gemini 3 ProOpenAI sigter mod en lille fordel i flere kodningsbenchmarks, og inklusive paritet i konkurrenceprægede tests som LiveCodeBench ProDet er vigtigt at huske på, at disse tal stammer fra interne målinger og kan variere i produktionsmiljøer.

Integrationer, værktøjer og tilgængelighed i Spanien og Europa

GPT-5.1-Codex-Max er nu operationel på overflader baseret på KodeksDe officielle CLI-, IDE-udvidelser og kodegennemgangstjenester for OpenAI-økosystemVirksomheden angiver, at offentlig API-adgang vil komme i en senere fase, så teams kan begynde at teste det i dag. native værktøjer mens de forbereder tilpassede integrationer.

Med hensyn til kommerciel tilgængelighed, planerne ChatGPT Plus, Pro, Business, Edu og Enterprise De inkluderer den nye model fra lanceringen. Brugere og organisationer i Spanien og resten af verden Den Europæiske Union Med disse abonnementer kan du aktivere det i dine flows uden behov for yderligere implementeringer, så længe du bruger Codex' kompatible overflader.

OpenAI bemærker også, at modellen er optimeret til at fungere i Windows-miljøer, hvilket udvider omfanget ud over Unix og letter dets implementering i virksomheder med blandede udviklingsparker og standardiserede virksomhedsværktøjer.

Driftssikkerhed og risikostyring

For at reducere risikoen i lange eksekveringer opererer modellen i en isoleret arbejdsområdeuden tilladelse til at skrive uden for standardområdet. Desuden er netværksforbindelse deaktiveret, medmindre det udtrykkeligt er aktiveret af den ansvarlige udvikler, hvilket forstærker privatliv.

Miljøet indeholder mekanismer for overvågning der registrerer unormal aktivitet og afbryder processer, hvis der er mistanke om misbrug. Denne konfiguration søger at afbalancere agentautonomi med rimelige sikkerhedsforanstaltninger for teams, der administrerer følsom kode eller kritiske lagre.

Brugstilfælde hvor det bidrager mest

Den største fordel ses i job, der kræver vedvarende hukommelse og kontinuitet: Omfattende refactoring, debugging, der kræver langvarig overvågning, løbende kodegennemgange og automatisering af pull requests i store repositoriesI disse opgaver reducerer komprimering "slid" på konteksten og opretholder sammenhængen.

For startups og tekniske teams, Delegering af disse processer til en stabil model giver mulighed for større fokus på produktprioriteterfor at fremskynde leverancer og reducere fejl som følge af træthed eller manuel gentagelse. Alt dette, med et mere strømlinet tokenforbrug end i tidligere versioner.

- Multimodulprojekter hvor kontinuitet mellem sessionerne er afgørende.

- Assisteret CI/CD med kontroller og rettelser der rykker frem i baggrunden.

- Frontend-support og tværkontekstanmeldelser i komplekse brugerhistorier.

- Fejlanalyse og fejlfinding langvarig uden at genforklare sagen hver par timer.

Forskelle sammenlignet med Codex og andre modeller

Den største forskel fra den klassiske Codex ligger ikke kun i den rå kraft, men også i effektiv konteksthåndtering På lang sigt udmærkede Codex sig ved specifikke opgaver; Codex-Max er designet til vedvarende processer, hvor modellen fungerer som en samarbejdspartner, der ikke mister overblikket, efterhånden som timerne går.

Sammenligninger med alternativer som f.eks. Gemini 3 Pro De hælder til fordel for GPT-5.1-Codex-Max i flere kodningstests Ifølge de offentliggjorte data, selvom Det klogeste at gøre er at validere disse resultater i vores egne miljøer og med reelle arbejdsbyrder. før det standardiseres i en organisations pipeline.

Enhver, der har brug for en kodedrevet AI, der kan modstå tekniske maratonløb uden at blive træt, vil finde i GPT-5.1-Codex-Max en mulighed specifikt rettet mod kontinuitet, sikkerhed som standard og token-effektivitet; et sæt kvaliteter, der i teams i Spanien og Europa med krævende rytmer kan omsættes til hurtigere leverancer og finere kodevedligeholdelse.

Jeg er en teknologientusiast, der har vendt sine "nørde" interesser til et erhverv. Jeg har brugt mere end 10 år af mit liv på at bruge avanceret teknologi og pille ved alle slags programmer af ren nysgerrighed. Nu har jeg specialiseret mig i computerteknologi og videospil. Dette skyldes, at jeg i mere end 5 år har skrevet til forskellige hjemmesider om teknologi og videospil, og lavet artikler, der søger at give dig den information, du har brug for, på et sprog, der er forståeligt for alle.

Har du spørgsmål, så spænder min viden fra alt relateret til Windows styresystemet samt Android til mobiltelefoner. Og mit engagement er over for dig, jeg er altid villig til at bruge et par minutter og hjælpe dig med at løse eventuelle spørgsmål, du måtte have i denne internetverden.