- Google enrichit Android XR avec des fonctionnalités telles que PC Connect, le mode voyage et des avatars réalistes pour Galaxy XR.

- En 2026, deux types de lunettes IA sous Android XR feront leur apparition : l'une sans écran et l'autre avec un écran intégré, en collaboration avec Samsung, Gentle Monster et Warby Parker.

- XREAL prépare les lunettes filaires Project Aura, des lunettes XR légères avec un champ de vision de 70 degrés, axées sur la productivité et le divertissement.

- Google ouvre la préversion développeur 3 du kit de développement logiciel Android XR afin que les développeurs puissent facilement adapter leurs applications Android à l'environnement spatial.

Google a décidé d'accélérer le rythme avec Android XR et les nouvelles lunettes Grâce à l'intelligence artificielle, ils élaborent une feuille de route qui intègre casques de réalité mixte, lunettes connectées et outils de développement au sein d'un écosystème unique. Après des années d'expérimentations discrètes en réalité augmentée, l'entreprise revient sur le devant de la scène avec des produits plus aboutis, conçus pour un usage quotidien.

Ces derniers mois, l'entreprise a détaillé Nouvelles fonctionnalités pour le visualiseur Galaxy XR de Samsung, a montré des progrès dans le premières lunettes IA basées sur Android XR et a donné un aperçu de Projet AuraIl s'agit de lunettes XR filaires développées en collaboration avec XREAL. Le tout est intégré autour de Gemini, le modèle d'IA de Google, qui devient le cœur de l'expérience.

Android XR prend forme : davantage de fonctionnalités pour le casque Galaxy XR

Au cours de l'événement «Android Show : Édition XRLors de la conférence qui s'est tenue le 8 décembre à Mountain View et a été suivie de près en Europe, Google a confirmé que Android XR est désormais opérationnel sur le Visionneuse Galaxy XR La plateforme propose également plus de 60 jeux et expériences sur Google Play. L'objectif est de transformer ce système en une interface commune unifiant casques de réalité virtuelle, lunettes connectées et autres appareils. vêtements spatial.

L’une des grandes nouveautés est Connexion PCune application qui permet Connectez un ordinateur Windows au Galaxy XR et afficher le bureau dans l'environnement immersif comme s'il s'agissait d'une simple fenêtre. Ainsi, l'utilisateur peut travailler sur son PC, déplacer des fenêtres, utiliser des applications bureautiques ou jouer à des jeux, mais avec écrans virtuels flottant dans l'espace devant lui.

Sont également inclus : mode de voyageCette option est conçue pour ceux qui utilisent l'écran en déplacement, par exemple dans un train, un avion ou une voiture (toujours en tant que passager). stabilise le contenu à l'écran pour que les vitres ne « s'échappent » pas lorsque vous bougez la tête ou à cause des secousses du véhicule, réduisant ainsi la sensation de vertige et rendant plus confortable le visionnage de films, le travail ou la navigation sur Internet lors de longs trajets.

Un autre élément pertinent est Votre imageun outil qui génère un avatar tridimensionnel du visage de l'utilisateur Ce modèle numérique est créé à partir d'un scan effectué avec un téléphone portable et reproduit en temps réel. Les expressions faciales, les mouvements de la tête et même les mouvements de la bouche lors des appels vidéo sur Google Meet et autres plateformes compatibles, offrant une présence plus naturelle que les avatars de dessins animés classiques.

Les modes PC Connect et voyage sont désormais disponibles. disponible pour les propriétaires de Galaxy XRBien que la fonctionnalité « Votre image » soit actuellement en version bêta, Google a également annoncé qu'elle sera lancée dans les prochains mois. Autospatialisation du système, une fonction prévue pour 2026 qui Il convertira automatiquement les fenêtres 2D en expériences 3D immersives.permettant de transformer des vidéos ou des jeux en scènes spatiales en temps réel sans que l'utilisateur ait à intervenir.

Deux familles de lunettes à intelligence artificielle : avec et sans écran

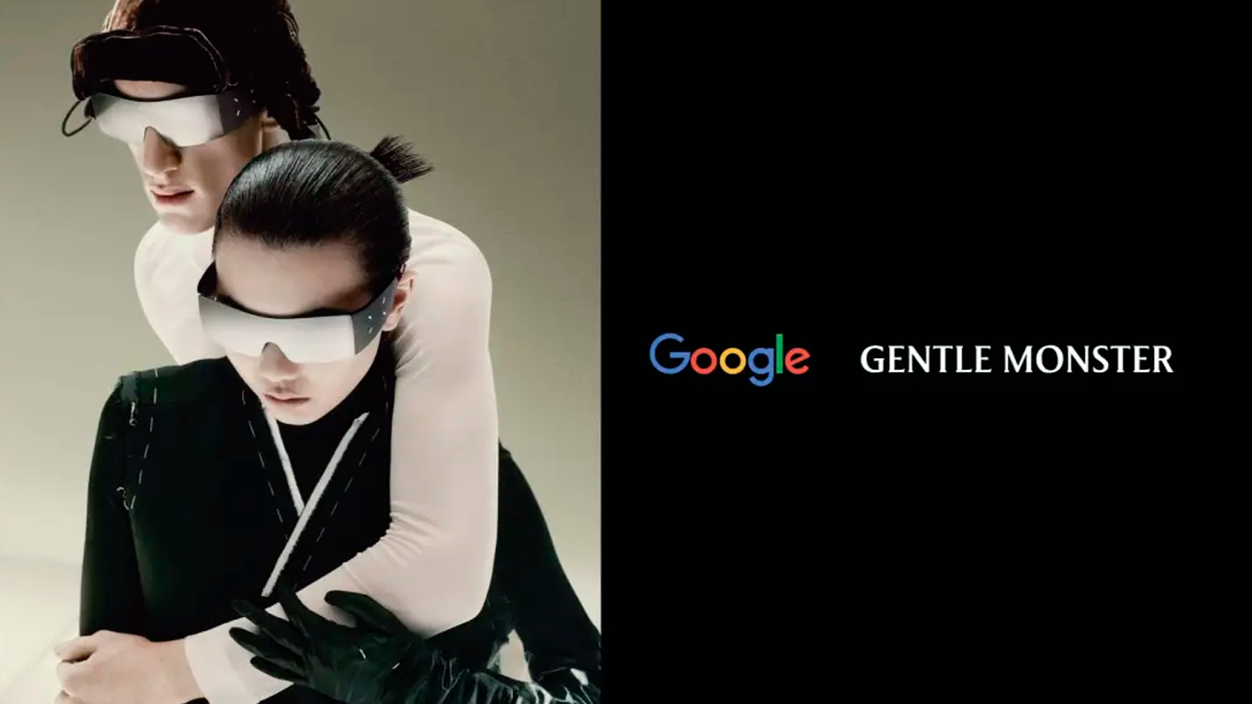

Au-delà des casques, Google a confirmé que Elle lancera ses premières lunettes à intelligence artificielle basées sur Android XR en 2026.En collaboration avec des partenaires tels que Samsung, Gentle Monster et Warby Parker, la stratégie repose sur deux gammes de produits aux approches distinctes mais complémentaires : Lunettes sans écran axées sur l'audio et la caméra, et d'autres avec écran intégré pour une réalité augmentée légère.

Le premier type d'appareil est Lunettes IA sans écranConçues pour ceux qui souhaitent une assistance intelligente sans changer leur vision du monde. Ces montures intègrent microphones, haut-parleurs et caméras, et ils comptent sur Gémeaux Répondre aux commandes vocales, analyser son environnement ou effectuer des tâches rapides. Ses utilisations prévues incluent : Prenez des photos sans sortir votre téléphone, recevez des instructions vocales, demandez des recommandations de produits ou poser des questions sur un lieu précis.

Le deuxième modèle va encore plus loin et ajoute un écran intégré à l'objectif, capable d'afficher des informations directement dans le champ de vision de l'utilisateur. Cette version vous permet de voir Itinéraires Google Maps, sous-titres avec traduction en temps réel, notifications ou rappels superposée au monde réel. L'idée est d'offrir une expérience de réalité augmentée légère. sans atteindre le poids ni le volume d'un casque de réalité mixtemais avec suffisamment d'informations visuelles pour le rendre utile.

Lors de démonstrations internes, certains testeurs ont pu utiliser prototypes monoculaires —avec un seul écran sur l'objectif droit— et versions binoculairesavec un écran pour chaque œil. Dans les deux cas, il est possible de voir. interfaces flottantes, appels vidéo dans des fenêtres virtuelles et des cartes interactives qui s'adaptent à la direction du regard, tirant parti de la technologie microLED que Google développe depuis l'acquisition de Raxium.

Ces prototypes ont été utilisés pour tester, par exemple, Lecture de musique avec commandes à l'écran, la visualisation de appels vidéo avec l'image de l'autre personne flottant à l'écran, vague traduction en temps réel avec sous-titres superposésLe modèle Nano Banana Pro de Google a même été utilisé pour retoucher des photos prises directement avec les lunettes et visualiser le résultat en quelques secondes, sans avoir besoin de sortir le téléphone de sa poche.

Intégration avec Android, Wear OS et l'écosystème Better Together

L'un des avantages que Google souhaite exploiter avec ces lunettes Android XR est intégration avec le L'écosystème Android et Wear OSL'entreprise insiste sur le fait que tout développeur programmant déjà pour Android possède un avantage significatif : Les applications mobiles peuvent être projetées du téléphone vers les lunettes., offrant des notifications enrichies, des commandes multimédias et des widgets spatiaux sans nécessiter de modifications initiales majeures.

Lors des démonstrations préalables au lancement, on a pu constater comment Les photos prises avec les lunettes sans écran peuvent être prévisualisées sur une montre Wear OS. par le biais d'une notification automatique, renforçant l'idée d'un écosystème connecté, « Ensemble, c'est mieux ». De plus, il a été démontré gestes des mains et mouvements de la tête pour contrôler l'interface Android XR, réduisant ainsi la dépendance aux commandes physiques.

En matière de navigation, Android XR tire parti de l'expérience Google Maps Live Viewmais transférées sur les lunettes. L'utilisateur ne voit qu'une petite carte avec la prochaine adresse lorsqu'il regarde droit devant lui, tandis que en inclinant la tête vers le bas Une carte plus grande se déplie, avec une boussole indiquant la direction vers laquelle vous êtes tourné. D'après ceux qui l'ont essayée, Les transitions sont fluides. et cette sensation rappelle celle d'un guide de jeu vidéo, mais intégré à l'environnement réel.

Google encourage également les tiers, tels que les services de transport, à tirer parti de ces fonctionnalités. Un exemple présenté était intégration avec des applications de transport comme Uberoù l'utilisateur peut suivre étape par étape l'itinéraire jusqu'au point de prise en charge à l'aéroport, en visualisant les instructions et les repères visuels directement dans son champ de vision.

Pour l'année 2026, l'entreprise prévoit Fournir des kits de développement pour lunettes monoculaires Android XR des programmeurs sélectionnés, tandis que tout le monde pourra expérimenter avec un émulateur de passage optique dans Android StudioL'interface utilisateur a été conçue pour avoir une complexité similaire à celle d'un widget d'écran d'accueil, ce qui correspond mieux à utilisations rapides et contextuelles que les applications de bureau traditionnelles.

Projet Aura : lunettes XR avec câble et champ de vision élargi

Parallèlement au développement de lunettes IA légères, Google collabore avec XREAL sur Projet Aura, clous Lunettes XR filaires fonctionnant sous Android XR qui visent à se positionner entre un casque audio encombrant et des lunettes de tous les jours. Cet appareil se concentre sur un conception légèreCependant, elle nécessite une batterie externe et une connexion à un ordinateur pour augmenter sa puissance.

Le projet Aura propose un champ de vision d'environ 70 degrés et utilise technologies de transparence optique qui permettent de superposer directement du contenu numérique à l'environnement réel. Grâce à cela, l'utilisateur peut Répartissez plusieurs fenêtres de travail ou de divertissement dans l'espace physique, sans bloquer ce qui se passe autour de vous, ce qui est particulièrement utile pour les tâches de productivité ou pour suivre des instructions tout en effectuant d'autres activités.

Une utilisation pratique serait suivre une recette de cuisine dans une fenêtre flottante placé sur le plan de travail pendant que les ingrédients sont préparés, ou Consultez la documentation technique tout en travaillant les mains libres. L'appareil est alimenté par une batterie externe ou directement à partir d'un ordinateurqui peuvent également projeter votre bureau dans l'environnement de réalité mixte, transformant ainsi les lunettes en une sorte d'écran spatial.

En matière de contrôle, le projet Aura adopte un système de suivi des mains similaire à celui du Galaxy XRBien qu'il possède moins de caméras, cela facilite l'adaptation des utilisateurs ayant déjà utilisé d'autres appareils XR. Google a annoncé qu'il proposera Plus de détails sur son lancement tout au long de l'année 2026, la date à laquelle il devrait commencer à arriver sur le marché.

Cette catégorie de lunettes filaires confirme l'idée qu'Android XR ne se limite pas à un seul type d'appareil. La même base logicielle vise à englober Des casques immersifs aux lunettes légères, y compris des solutions hybrides comme Aura, afin que l'utilisateur puisse choisir à tout moment le niveau d'immersion et de confort dont il a besoin.

Partenariats avec Samsung, Gentle Monster et Warby Parker

Pour éviter de répéter les erreurs de Google Glass, l'entreprise a opté pour collaborer avec des marques spécialisées dans l'optique et la modeSamsung gère une grande partie du matériel et de l'électronique, tandis que Gentle Monster et Warby Parker apportent leur expertise en matière de conception de selles. qui peuvent passer pour des lunettes classiques et être confortables pendant de nombreuses heures.

Lors de l'émission Android Show | XR Edition, Warby Parker a confirmé que Il travaille avec Google sur des lunettes légères dotées d'intelligence artificielle.avec un lancement prévu en 2026. Bien que les détails concernant les prix et les canaux de distribution n'aient pas encore été communiqués, la société évoque montures conçues pour un usage quotidien, bien loin du caractère expérimental des premières tentatives de Google il y a dix ans.

Dans ce contexte, Android XR et Gemini fournissent la couche technologique, tandis que les partenaires se concentrent sur la réalisation Supports discrets, bien ajustés et d'un poids raisonnableL’objectif est clair : les lunettes doivent ressembler à n’importe quel autre modèle commercial, mais avec des capacités intégrées d’IA et de réalité augmentée qui ajoutent de la valeur sans attirer trop l’attention.

Ces alliances positionnent Google dans concurrence directe avec Meta et ses lunettes Ray-Ban Metaainsi qu'avec les avancées d'Apple en matière d'informatique spatiale. Cependant, la stratégie de l'entreprise implique plateformes ouvertes et collaboration industrielletenter d'intégrer les développeurs et fabricants de lunettes traditionnelles à l'écosystème Android XR.

Outils et kits de développement logiciel : Android XR s’ouvre aux développeurs

Pour que tous ces éléments s'assemblent, Google a lancé Android XR SDK Developer Preview 3qui ouvre officiellement les API et les outils nécessaires à la création d'applications spatiales pour les visionneuses et les lunettes XR. L'interface suit le design de Matériel 3 et les directives de conception que Google appelle en interne Glimmer, adaptées aux éléments flottants, aux cartes et aux panneaux 3D.

Le message adressé au secteur est clair : Ceux qui développent déjà pour Android sont, dans une large mesure, prêts à passer à Android XR.Grâce au SDK et aux émulateurs, les programmeurs peuvent commencer à porter leurs applications mobiles, à ajouter des couches de réalité augmentée, à intégrer des commandes gestuelles ou à personnaliser l'affichage des notifications dans l'espace.

Google insiste sur le fait qu'elle ne souhaite pas submerger les utilisateurs d'interfaces complexes. C'est pourquoi de nombreux éléments d'Android XR sont conçus pour être simples. cartes légères, contrôles flottants et widgets contextuels Elles apparaissent en cas de besoin et disparaissent lorsqu'elles ne fournissent plus d'informations pertinentes. De cette manière, L'objectif est d'éviter la sensation d'un « écran permanent » devant les yeux. et favorise une relation plus naturelle avec l'environnement.

L'entreprise a clairement indiqué que Android XR est une plateforme ouverteEt que les fabricants de matériel, les studios de jeux vidéo, les entreprises de productivité et les services cloud auront la possibilité d'expérimenter. En Europe, on espère que cette approche contribuera à… nouvelles applications commerciales, éducatives et de communication Adoptez la réalité mixte sans avoir à développer des solutions à partir de zéro.

La décision de Google avec Android XR et ses nouvelles lunettes IA laisse entrevoir un scénario dans lequel La réalité mixte et l'assistance intelligente sont réparties sur différents formats d'appareils.: spectateurs immersifs À l'instar du Galaxy XR pour des expériences immersives, des lunettes légères pour un usage quotidien et des modèles filaires comme le Project Aura pour ceux qui privilégient la productivité et la qualité d'image, si l'entreprise parvient à concilier design, confidentialité et facilité d'utilisation, il est probable que dans les années à venir, ces lunettes cesseront d'être considérées comme une expérience et deviendront un accessoire technologique aussi courant que le smartphone aujourd'hui.

Je suis un passionné de technologie qui a fait de ses intérêts de « geek » un métier. J'ai passé plus de 10 ans de ma vie à utiliser des technologies de pointe et à bricoler toutes sortes de programmes par pure curiosité. Aujourd'hui, je me spécialise dans l'informatique et les jeux vidéo. En effet, depuis plus de 5 ans, j'écris pour différents sites Web sur la technologie et les jeux vidéo, créant des articles qui cherchent à vous donner les informations dont vous avez besoin dans un langage compréhensible par tous.

Si vous avez des questions, mes connaissances s'étendent de tout ce qui concerne le système d'exploitation Windows ainsi qu'Android pour les téléphones mobiles. Et mon engagement est envers vous, je suis toujours prêt à consacrer quelques minutes et à vous aider à résoudre toutes les questions que vous pourriez avoir dans ce monde Internet.