- Instagram avisará a los padres si sus hijos buscan de forma reiterada términos ligados al suicidio o la autolesión.

- Las alertas solo funcionarán si está activada la supervisión parental y llegarán por email, SMS, WhatsApp y notificación en la app.

- La función se estrenará en EE. UU., Reino Unido, Australia y Canadá y se extenderá a otras regiones, incluida Europa, a lo largo del año.

- Meta amplía estas medidas al uso de su inteligencia artificial, en pleno contexto de presión judicial por el impacto de Instagram en la salud mental juvenil.

Instagram ha decidido dar un paso más en el control de los contenidos sensibles relacionados con el suicidio y la autolesión entre menores. La plataforma, propiedad de Meta, activará un sistema de avisos para que los padres sepan si sus hijos adolescentes buscan de forma insistente este tipo de términos en la red social.

La nueva función se enmarca en el programa de supervisión parental y cuentas de adolescente de Instagram y busca que las familias puedan detectar a tiempo posibles señales de alerta. Según la compañía, la mayoría de menores no realiza este tipo de búsquedas, pero cuando ocurre, quieren que los adultos dispongan de información y recursos para reaccionar con rapidez.

Cómo funcionarán las alertas por búsquedas de suicidio y autolesión

El sistema no se activará ante una consulta aislada, sino cuando la plataforma detecte varios intentos en un periodo corto con palabras clave claramente vinculadas al suicidio o a hacerse daño a uno mismo. Entrarían aquí términos como «suicidio», «autolesión» o frases que sugieran intención de autolesionarse.

Para definir ese umbral de activación, Instagram asegura haber trabajado con su grupo asesor especializado en suicidio y autolesiones, analizando patrones de comportamiento para evitar tanto falsos positivos como avisos que lleguen demasiado tarde. La idea es dar margen para que el menor pueda encontrarse con recursos de ayuda sin que cualquier búsqueda puntual genere una alarma inmediata en la familia.

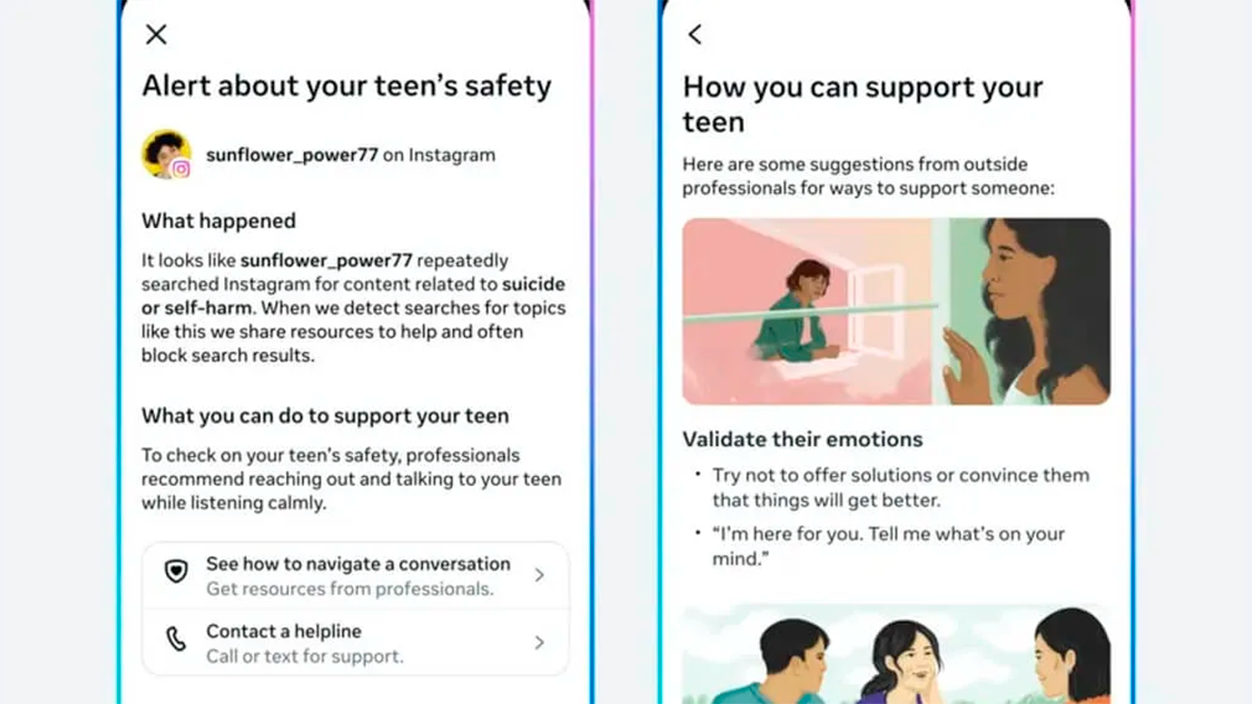

Cuando se cumplan las condiciones fijadas por la plataforma, se enviará una notificación a los adultos que tengan activada la supervisión de la cuenta del menor. Esas alertas llegarán por correo electrónico, SMS o WhatsApp, dependiendo de los datos de contacto que los padres hayan facilitado, y también aparecerán como aviso dentro de la propia app de Instagram.

Al pulsar sobre la notificación, se abrirá un mensaje a pantalla completa explicando que el adolescente ha intentado buscar varias veces contenido relacionado con el suicidio o la autolesión en un intervalo breve de tiempo. En ese mismo panel se ofrecerán enlaces a materiales elaborados por expertos para orientar a los padres sobre cómo abordar una conversación delicada con su hijo.

Qué cambia en la política de contenidos de Instagram

Meta insiste en que ya aplica políticas estrictas contra el contenido que promueve o glorifica el suicidio y las autolesiones. De hecho, cuando un adolescente realiza una búsqueda evidente sobre estos temas, la plataforma no muestra resultados relacionados, sino que deriva al usuario a líneas de ayuda y organizaciones especializadas en apoyo psicológico y prevención.

Al mismo tiempo, Instagram permite que los usuarios compartan experiencias personales relacionadas con problemas de salud mental, siempre que no se presenten de forma que inciten a imitar conductas de riesgo. Ese tipo de publicaciones, matiza la compañía, se ocultan a los menores, incluso si son compartidas por cuentas que ellos ya siguen.

Con la incorporación de las nuevas alertas, el objetivo declarado por Meta es complementar ese bloqueo de búsquedas con un canal directo hacia los padres o tutores. La idea es que no solo la plataforma intervenga redirigiendo al adolescente a recursos de apoyo, sino que también los adultos tengan la posibilidad de intervenir personalmente si lo consideran necesario.

La empresa reconoce que recibir un aviso de este tipo puede resultar muy angustiante para cualquier familia, pero defiende que las notificaciones se han diseñado precisamente para ofrecer información clara y herramientas concretas, y no quedarse solo en un mensaje alarmista sin contexto.

Despliegue por países y situación en España y Europa

Las nuevas alertas comenzarán a habilitarse en Estados Unidos, Reino Unido, Australia y Canadá a partir de la próxima semana para aquellos padres que ya utilizan las opciones de supervisión parental de Instagram. La compañía ha adelantado que la función se extenderá a otras regiones a lo largo del año, aunque sin concretar todavía una fecha cerrada para España u otros países europeos.

En el caso de las cuentas de adolescente, la activación de estas señales llegará como parte de las herramientas de seguridad que Meta lleva tiempo desplegando. Algunos medios especializados señalan que la función podría estar habilitada por defecto en las cuentas de menores, mientras otros recogen que será necesaria la inscripción expresa en el programa de supervisión; en cualquier caso, los padres deberán estar vinculados a la cuenta del menor para recibir las notificaciones.

El anuncio coincide con un debate creciente en Europa sobre cómo proteger a los menores en redes sociales. Varios gobiernos, entre ellos los de España, Grecia o Eslovenia, han empezado a estudiar límites de edad más estrictos para acceder a plataformas como Instagram, siguiendo el ejemplo de países que se plantean prohibir el uso de redes por debajo de los 16 años.

En paralelo, Reino Unido ha abierto la puerta a nuevas restricciones sobre contenidos dañinos para menores, mientras la Unión Europea discute la aplicación práctica de su normativa sobre servicios digitales, que exige más transparencia a las grandes tecnológicas en cuestión de algoritmos, moderación de contenidos y protección de menores.

La inteligencia artificial, otro frente de protección

Meta también ha anunciado que prepara un sistema de alertas similar para las interacciones de adolescentes con su inteligencia artificial. La compañía reconoce que muchos jóvenes recurren ya a chatbots y asistentes virtuales para hablar de temas sensibles, entre ellos la salud mental, y quiere que los padres sean avisados si se detectan conversaciones relacionadas con suicidio o autolesiones.

Actualmente, los modelos de IA integrados en los servicios de Meta —como Meta AI— están entrenados para responder de forma segura a los menores, redirigiéndoles hacia recursos de ayuda cuando aparecen ciertos términos o indicios de riesgo. Con el nuevo sistema, si el adolescente intenta mantener conversaciones de este tipo con la IA, los padres recibirán un aviso en términos similares al de las búsquedas dentro de Instagram.

La compañía no ha detallado todavía qué expresiones exactas activarán estas alertas en el caso de la inteligencia artificial, ni cómo distinguirá entre una consulta informativa y una señal potencial de peligro. Lo que sí ha avanzado es que se trata de un proyecto en desarrollo y que ofrecerán más información «en los próximos meses», a medida que se vaya desplegando.

Este movimiento llega en un contexto en el que distintos gobiernos y reguladores observan con lupa el auge de la IA generativa y su posible impacto en menores. El caso del chatbot Grok, vinculado a la red X (antigua Twitter), que generó contenidos sexualizados, ha reforzado la presión para imponer salvaguardas más estrictas cuando hay niños y adolescentes de por medio.

Presión judicial y debate sobre el impacto en la salud mental

El anuncio de Instagram no se produce en el vacío. Meta afronta en Estados Unidos varios procesos judiciales por daños a menores, en los que se cuestiona si sus plataformas, y en particular Instagram, han sido diseñadas para resultar adictivas y si han contribuido a problemas de salud mental en adolescentes.

En Los Ángeles se celebra un juicio en el que se analiza si las funciones de la red social fomentan la dependencia y exponen a los menores a un flujo continuo de contenidos potencialmente dañinos, incluidos aquellos vinculados a trastornos alimentarios, autolesiones o ideas suicidas. Otra causa abierta en Nuevo México indaga si Meta no protegió adecuadamente a los menores frente a la explotación sexual dentro de sus servicios.

Durante su comparecencia ante el tribunal de California, el consejero delegado de Meta, Mark Zuckerberg, ha mantenido que las redes sociales no han demostrado científicamente causar adicción ni dañar de forma directa la salud mental, apoyándose en la literatura académica disponible. Al mismo tiempo, ha defendido que la responsabilidad principal en la verificación de edad debería recaer en los sistemas operativos y en las tiendas de aplicaciones, como Apple y Google, y no solo en los desarrolladores de cada app.

La compañía también ha sido objeto de críticas por la manera en que el cifrado de extremo a extremo en algunas de sus aplicaciones podría complicar la detección y denuncia de abusos sexuales infantiles. Meta sostiene que colabora con las autoridades y niega que sus medidas de privacidad busquen obstaculizar la investigación de estos delitos.

En este ambiente de presión política y legal, las nuevas herramientas de alerta en Instagram se interpretan como un intento de reforzar la imagen de compromiso con la seguridad de los menores y mostrar a los reguladores que la empresa está dispuesta a introducir cambios técnicos para adaptar su modelo de negocio a las exigencias actuales.

Redes sociales, autolesiones y percepción social

El debate sobre el papel de plataformas como Instagram en la salud mental de los jóvenes no se limita a los tribunales. Estudios recientes en España, como los impulsados por grupos de investigación universitarios en el ámbito de la infancia y la adolescencia, apuntan a que una parte significativa de los menores ha estado expuesta a contenidos sobre autolesiones a través de redes, mensajería e incluso ciberacoso.

No se trata solo de publicaciones que promuevan directamente hacerse daño, sino también de imágenes, metáforas y códigos compartidos entre iguales que permiten hablar de estas conductas sin mencionarlas de forma explícita. Este tipo de lenguaje cifrado circula por diferentes plataformas y puede contribuir a normalizar ciertas prácticas o, al menos, a restarles gravedad ante los ojos de quienes ya están en una situación de vulnerabilidad.

Aun así, los propios adolescentes y jóvenes reclaman en su mayoría un mayor control sobre los contenidos relacionados con autolesiones en redes sociales. La percepción generalizada es que estos espacios se han convertido en lugares donde el fenómeno se comparte, se comenta y, en ocasiones, se banaliza, lo que complica el trabajo de familias y profesionales a la hora de prevenir conductas de riesgo.

En ese contexto, propuestas como las alertas de Instagram generan opiniones encontradas: por un lado, se valoran como una herramienta adicional para detectar posibles casos de peligro; por otro, surge el debate sobre la privacidad de los adolescentes y hasta qué punto este tipo de supervisión puede afectar a la confianza entre padres e hijos.

La plataforma asegura que su intención es encontrar un equilibrio entre la protección y el respeto a la intimidad, limitando las alertas a situaciones en las que se observe una reiteración clara de búsquedas potencialmente preocupantes y acompañando siempre la notificación de información útil y recursos profesionales.

Con esta combinación de bloqueo de resultados, redirección a líneas de ayuda, avisos a los padres e integración de la inteligencia artificial en la detección de patrones de riesgo, Instagram intenta reforzar su posición en un terreno especialmente sensible. Resta por ver cómo se implementarán exactamente estas medidas en países europeos como España y hasta qué punto lograrán responder a las preocupaciones sociales y regulatorias sobre el impacto de la red social en la salud mental de los menores.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.