- MatX cierra una ronda de 500 millones de dólares para desarrollar chips de IA especializados

- Fundadores con amplia experiencia previa en las TPU de Google y colaboración con TSMC

- Promesa de rendimiento muy superior a las GPU actuales de Nvidia para entrenar grandes modelos

- Impacto potencial en costes, disponibilidad y diversificación del hardware de IA en Europa

La joven compañía MatX se ha convertido en uno de los nombres más comentados del hardware para inteligencia artificial tras anunciar una financiación de 500 millones de dólares. Esta inyección de capital sitúa a la startup en el radar de todo el sector al presentarse como un posible contrapeso al dominio de Nvidia en los centros de datos dedicados a IA.

Detrás de la cifra de 500M no solo hay dinero, sino una apuesta clara por desarrollar una nueva generación de chips específicamente concebidos para entrenar y ejecutar modelos de lenguaje de gran tamaño y otras aplicaciones avanzadas de IA. En un momento en el que la escasez de GPU y los costes desbordados marcan la agenda, el proyecto de MatX genera muchas expectativas, también en el mercado europeo.

Quién está detrás de MatX 500M y qué persigue la compañía

La historia de MatX 500M arranca en 2023, cuando dos ingenieros con larga trayectoria en Google deciden montar su propia empresa de semiconductores. Reiner Pope, actual CEO, había liderado el desarrollo de software de IA para las TPU (Tensor Processing Units) del gigante de Mountain View, mientras que su cofundador Mike Gunter fue uno de los principales responsables del diseño de hardware de esas mismas TPU.

Esta combinación de experiencia en la arquitectura de chips y en el software que los explota es uno de los grandes activos de la compañía. Haber trabajado de primera mano en la infraestructura que sostiene muchos de los servicios de IA de Google proporciona a MatX una visión muy detallada de qué cuellos de botella sufren los sistemas actuales y dónde se pueden exprimir mejoras significativas de rendimiento.

La última ronda de financiación, una Serie B de 500 millones, ha sido liderada por el fondo Jane Street y por Situational Awareness, vehículo de inversión impulsado por el exinvestigador de OpenAI Leopold Aschenbrenner. Se han sumado también actores relevantes del sector tecnológico como Marvell Technology, NFDG, Spark Capital y figuras conocidas como los cofundadores de Stripe, Patrick y John Collison.

Este respaldo llega después de una Serie A en 2024, en la que MatX recaudó alrededor de 100 millones de dólares liderados por Spark Capital, con una valoración entonces por encima de los 300 millones. Aunque la empresa no ha revelado públicamente cuánto vale tras el cierre de los 500M, la comparación inevitable es con su rival Etched, que levantó una cantidad similar situándose en torno a los 5.000 millones de valoración.

Un mercado dominado por Nvidia que busca alternativas

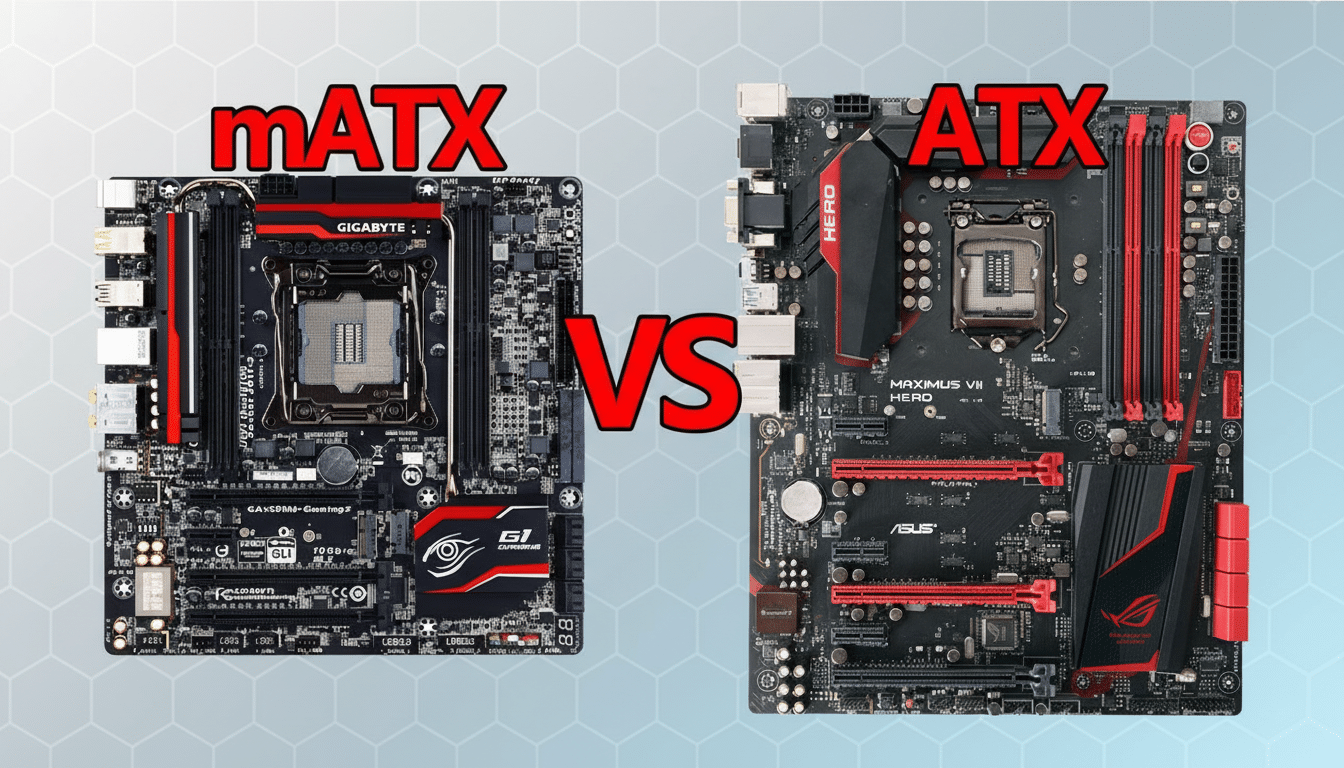

El desembarco de MatX 500M hay que entenderlo en el contexto de un mercado de chips para IA desbordado por la demanda. El auge de los modelos de lenguaje, de la IA generativa y de nuevas aplicaciones empresariales ha disparado el consumo de cómputo, situando a Nvidia en una posición casi hegemónica con sus GPU H100 y H200 en centros de datos.

Este dominio, que se estima en más del 80% del mercado de GPU para IA en servidores, tiene un coste para el ecosistema: precios muy elevados, listas de espera prolongadas y una fuerte dependencia de un único proveedor. Para empresas europeas y españolas que quieren desplegar sus propios modelos en la nube o en instalaciones propias, acceder a suficiente hardware Nvidia se ha convertido en una carrera de fondo.

En este escenario, el interés por alternativas competitivas se ha disparado. Grandes corporaciones, proveedores cloud regionales y startups de IA en Europa buscan hardware que permita escalar sin quedar atrapados en la combinación de altos costes y escasez de GPU. Es ahí donde la propuesta de MatX 500M puede encajar si consigue materializar sus promesas de rendimiento y eficiencia.

La apuesta de los inversores por compañías como MatX refleja una convicción compartida: el mercado de infraestructura de IA es tan grande que hay espacio para nuevos actores siempre que aporten ventajas claras en precio, disponibilidad o consumo energético. La financiación masiva no garantiza el éxito, pero sí ofrece tiempo y recursos para intentar cerrar esa brecha.

Qué hace distintos a los chips MatX 500M frente a las GPU actuales

Aunque la empresa mantiene en reserva buena parte de las especificaciones técnicas, el mensaje central es claro: los procesadores de MatX están diseñados desde cero para IA. A diferencia de las GPU tradicionales, que nacieron pensadas para gráficos y se han adaptado a trabajos de machine learning, estos chips persiguen desde el primer momento optimizar las operaciones de álgebra lineal y procesamiento tensorial que dominan en las redes neuronales modernas.

La compañía asegura que su objetivo es lograr un rendimiento hasta diez veces superior al de las GPU de Nvidia en tareas de entrenamiento de grandes modelos. Traducido al día a día de un laboratorio de investigación europeo o de una startup que entrena su propio modelo de lenguaje, eso podría implicar reducir drásticamente tiempos de entrenamiento o, manteniendo los plazos, bajar los costes de infraestructura de forma notable.

Más allá de la potencia bruta, MatX insiste en la importancia de la eficiencia energética y del rendimiento por euro invertido. La electricidad y el espacio en centros de datos son limitados, especialmente en países europeos con fuertes regulaciones ambientales y costes energéticos elevados. Un chip que ofrezca más operaciones de IA por vatio puede marcar diferencias importantes en proyectos a gran escala.

El bagaje del equipo fundador en las TPU de Google sugiere que conocen bien los compromisos que exige este tipo de diseño: cómo estructurar la memoria, qué instrucciones priorizar, qué tipos de precisión numérica son más rentables para acelerar el aprendizaje profundo o cómo facilitar la vida a los desarrolladores que luego tendrán que programar sobre ese hardware.

El reto del software y el ecosistema frente a Nvidia

Uno de los obstáculos más serios para cualquier aspirante a competir con Nvidia no está solo en fabricar un chip rápido, sino en construir un ecosistema de software sólido. Durante más de una década, la compañía californiana ha reforzado su posición con CUDA, bibliotecas altamente optimizadas y una comunidad de desarrolladores muy amplia.

Para que MatX 500M logre una adopción relevante, tendrá que ofrecer herramientas de desarrollo, drivers y compatibilidad con los principales frameworks de IA (como PyTorch o TensorFlow) que reduzcan al mínimo el esfuerzo de migrar. Si moverse de GPU Nvidia a hardware MatX implica rehacer por completo el código, muchos equipos técnicos en Europa lo pensarán dos veces.

La empresa es consciente de ello y ya está volcando parte de los recursos de la ronda de 500M en reforzar el área de software. El objetivo pasa por que los desarrolladores puedan aprovechar los chips MatX casi como un reemplazo directo dentro de sus flujos de trabajo actuales, sin tener que reinventar todo su stack tecnológico.

Además, MatX debe articular una red de socios que incluya proveedores cloud, integradores de sistemas y operadores de centros de datos que puedan ofrecer su hardware como alternativa viable en contratos públicos y privados, algo especialmente relevante en el contexto de la estrategia europea para ganar autonomía en tecnologías críticas.

Producción con TSMC y hoja de ruta hasta 2027

En el terreno industrial, MatX 500M ha confirmado que está trabajando con TSMC, el mayor fabricante de semiconductores por contrato del mundo, para llevar sus diseños a producción. Pasar de un prototipo en laboratorio a una fabricación estable en volumen es un proceso complejo que suele requerir entre dos y cuatro años en el sector de los chips de alto rendimiento.

La compañía maneja como horizonte de referencia el año 2027 para iniciar entregas comerciales de sus procesadores a gran escala. Esto sitúa el proyecto en un calendario relativamente ajustado, teniendo en cuenta que el ritmo de innovación en IA es vertiginoso y que los competidores no se detienen.

El capital obtenido en la ronda de 500M debe cubrir buena parte de las fases críticas: diseño final, tape-out, validación, pruebas de rendimiento real y los acuerdos logísticos necesarios para suministrar chips a clientes de todo el mundo, afrontando problemas de suministro como la crisis de la memoria NAND. Para Europa y España, esto abre la puerta a que en pocos años puedan incorporar esta nueva opción en sus centros de datos, si la empresa logra cumplir sus plazos.

Mientras tanto, la compañía tendrá que ir cerrando acuerdos piloto con potenciales clientes clave, incluyendo grandes plataformas de IA, proveedores de servicios cloud regionales y, previsiblemente, consorcios académicos y de investigación europeos interesados en reducir su dependencia de Nvidia.

Impacto potencial para España y Europa en la carrera de la IA

Desde la óptica europea, la irrupción de proyectos como MatX 500M encaja con la voluntad de diversificar el suministro de hardware crítico. La Comisión Europea lleva tiempo advirtiendo del riesgo de concentrar demasiada capacidad de cómputo en manos de unos pocos actores globales, tanto a nivel de hardware como de servicios en la nube.

Para centros de datos ubicados en países como España, Francia o Alemania, disponer de alternativas competitivas en chips de IA puede facilitar el despliegue de nubes soberanas, así como proyectos de infraestructura compartida que atiendan a universidades, centros de supercomputación y grandes empresas.

En el terreno empresarial, startups españolas que trabajan con modelos de lenguaje, visión por computador o IA generativa podrían beneficiarse de mejores condiciones económicas y menor congestión si proveedores locales deciden integrar los procesadores MatX en sus ofertas. Una eventual bajada del coste de cómputo permitiría experimentar más, iterar modelos con mayor rapidez y, en general, reducir barreras de entrada.

Con todo, la realidad es que el peso específico de Nvidia sigue siendo enorme y es probable que convivan diversas soluciones durante años. El papel de MatX dependerá de su capacidad para demostrar en pruebas reales que la promesa de mayor rendimiento por dólar (o por euro) se cumple, especialmente en casos de uso que interesan a la industria europea, como la IA aplicada a manufactura, energía, salud o administración pública.

El movimiento de MatX 500M simboliza, en definitiva, una fase de maduración del mercado de chips de IA, donde el protagonismo ya no recae únicamente en un único proveedor. La combinación de una financiación muy abultada, un equipo con experiencia contrastada en TPU, el respaldo de inversores de peso y una alianza industrial con TSMC coloca a la startup en una posición a seguir de cerca por corporaciones y desarrolladores en España y en el resto de Europa, que buscan más opciones para sostener el crecimiento de sus proyectos de inteligencia artificial.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.