- Un vídeo viral muestra a un Tesla con FSD dirigiéndose hacia un lago antes de que el conductor intervenga

- El incidente se suma a otros casos que mantienen bajo escrutinio a Autopilot y Full Self-Driving

- El sistema sigue siendo de nivel 2 y requiere supervisión constante del conductor pese a su nombre comercial

- El modelo de suscripción y la presión regulatoria abren el debate sobre cómo se vende y controla esta tecnología

Un nuevo incidente con un vehículo de Tesla ha encendido de nuevo el debate sobre los límites de la conducción automatizada. Un propietario ha denunciado que su coche, con el software de Full Self-Driving (FSD) activado, intentó dirigirse hacia un lago antes de que él tomara el control, una escena que ha corrido como la pólvora en redes sociales y ha reabierto la discusión sobre hasta dónde puede delegarse realmente la conducción en la máquina.

El caso se enmarca en un contexto en el que los sistemas avanzados de asistencia a la conducción están bajo lupa de reguladores y usuarios en todo el mundo, también en Europa y España, donde las autoridades de tráfico observan con atención cualquier incidente de este tipo en mercados como Estados Unidos. Aunque el suceso ha tenido lugar al otro lado del Atlántico, sus implicaciones alimentan la conversación global sobre seguridad, responsabilidad y expectativas en torno al coche “que se conduce solo”.

El Tesla que casi acaba en el lago: el vídeo que incendia las redes

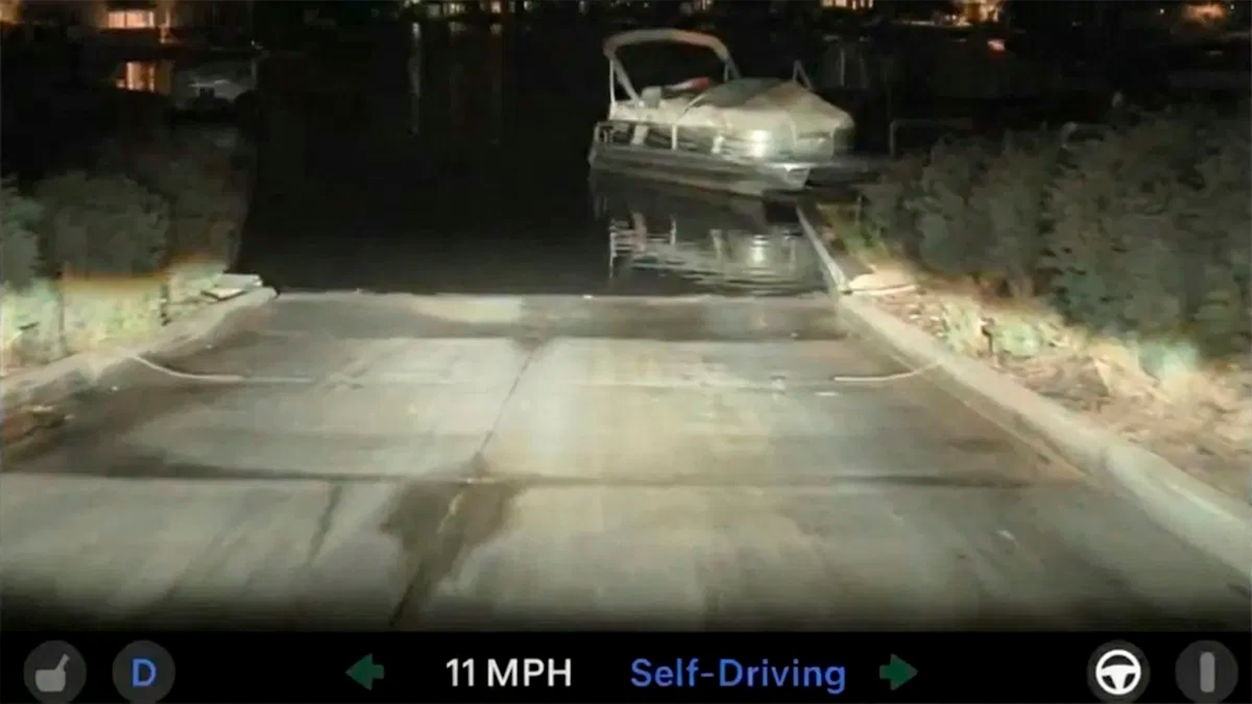

El origen de la polémica es un vídeo publicado en X (antes Twitter) por el usuario Daniel Milligan, donde se aprecia cómo un Tesla con FSD activado se aproxima a una zona sin salida que termina directamente en el agua. En las imágenes, el coche continúa avanzando hacia el lago hasta que el conductor decide intervenir y abortar la maniobra, evitando que el vehículo acabe en el agua.

Según el propio propietario, el coche circulaba con la versión FSD 14.2.2.4, una de las iteraciones más recientes del sistema distribuido por la compañía. Tesla habría descrito esta actualización como una mera optimización respecto a la anterior, sin detallar cambios de calado, lo que ha despertado aún más dudas sobre si se están comunicando con suficiente claridad las modificaciones introducidas en cada versión.

El vídeo superó el millón de reproducciones en pocas horas y, como suele ocurrir en estos casos, se convirtió rápidamente en símbolo de un debate mucho más amplio. Numerosos usuarios comentaron la grabación, algunos reprochando a Tesla el uso de una denominación comercial tan ambiciosa como “Full Self-Driving”, y otros recordando que el conductor sigue teniendo la última palabra y la obligación legal de supervisar siempre el trayecto.

Con cada nuevo incidente llamativo, se amplifica una sensación de desconfianza entre parte de la opinión pública, especialmente entre quienes aún dudan de la madurez de estos sistemas. Aun así, otros usuarios defendieron que el caso ilustra precisamente la importancia de mantener la atención y estar preparado para corregir al sistema, incluso cuando funciona aparentemente de forma fluida.

Un sistema avanzado, pero aún de nivel 2

Uno de los puntos más controvertidos es la distancia entre el nombre comercial del sistema y su realidad técnica. A pesar de denominarse “Full Self-Driving”, el FSD de Tesla está catalogado como un sistema de automatización de nivel 2 según las escalas de la industria, lo que implica que el conductor debe mantener tanto las manos en el volante como la vista en la carretera, preparado para intervenir en cualquier momento.

En la práctica, esto significa que, aunque el coche pueda gestionar de forma automática el mantenimiento de carril, los cambios de vía, las frenadas, las aceleraciones e incluso maniobras en cruces, la responsabilidad última sigue siendo humana. No se permite, al menos legalmente, desentenderse de la conducción, por mucho que el coche sea capaz de realizar buena parte de las tareas de forma automatizada.

Este desfase entre marketing y funcionamiento real es precisamente lo que critican no pocos expertos en seguridad vial y asociaciones de consumidores. A su juicio, un nombre tan rotundo como “Conducción Autónoma Total” genera expectativas que no se corresponden con el producto, y puede llevar a algunos usuarios a confiarse de más, reduciendo su vigilancia justo cuando debería ser constante.

Desde el punto de vista regulatorio europeo, la nomenclatura y la forma en que se comercializan estos sistemas no es un asunto menor. Las autoridades comunitarias han mostrado interés en que la información que recibe el usuario sea clara y no induzca a error, especialmente en lo que se refiere al grado real de autonomía que ofrecen estos asistentes.

Investigaciones y escrutinio regulatorio sobre Tesla

El incidente del coche acercándose al lago llega en un momento delicado para la compañía. En Estados Unidos, la Administración Nacional de Seguridad del Tráfico en las Carreteras (NHTSA) mantiene investigaciones abiertas sobre millones de vehículos Tesla equipados con Autopilot y FSD. Los reguladores analizan colisiones, maniobras erráticas y comportamientos anómalos en intersecciones y situaciones complejas.

Entre los puntos de interés de las autoridades figuran episodios en los que los coches habrían cambiado de carril de forma inesperada, se habrían aproximado demasiado a cruces complicados o habrían mostrado decisiones aparentemente erráticas en lo que en inteligencia artificial se conoce como “edge cases” o casos límite de la IA. Estos son escenarios poco frecuentes o difíciles de predecir, en los que los algoritmos tienen más probabilidades de equivocarse.

Aunque las investigaciones se centran en el mercado estadounidense, los resultados podrían influir en cómo se regulan en Europa sistemas equivalentes. La Unión Europea tiende a observar con detenimiento los movimientos de los reguladores norteamericanos en materia de seguridad vial y tecnológica, y no sería extraño que los hallazgos de la NHTSA alimentaran futuras normativas comunitarias.

Hasta ahora, Tesla ha defendido que sus sistemas reducen la siniestralidad en comparación con la conducción puramente humana, apoyándose en datos internos sobre kilómetros recorridos con y sin Autopilot o FSD activados. Sin embargo, la falta de acceso público y detallado a esos datos hace que muchos expertos acojan esas afirmaciones con cautela y reclamen más transparencia.

Suscripción mensual, promesas y percepción del usuario

Paralelamente a los asuntos de seguridad, la estrategia comercial de Tesla con el FSD también se encuentra en el centro del debate. La compañía ha reforzado su apuesta por un modelo de suscripción mensual para acceder al paquete de conducción automatizada avanzada, relegando a un segundo plano la compra definitiva mediante un único pago elevado.

Este enfoque refuerza la idea de que el sistema es, en realidad, un servicio digital en constante evolución más que una función cerrada y finalizada del vehículo. Las mejoras, cambios y ajustes se distribuyen vía actualización de software, lo que permite introducir novedades con rapidez, pero también implica que el comportamiento del coche puede variar con cada nueva versión.

En mercados como el europeo, donde el desembolso en suscripciones tecnológicas empieza a saturar a muchos consumidores, la percepción del valor de un servicio de este tipo no es un tema menor. Si cada mes se paga por una capacidad que, sobre el papel, promete facilitar la vida al volante, el listón de exigencia en términos de fiabilidad y seguridad se eleva considerablemente.

Las promesas reiteradas de Elon Musk sobre la llegada de una conducción totalmente autónoma “sin supervisión” han añadido más presión. A día de hoy, y ya entrados en 2026, esa conducción realmente autónoma todavía no ha llegado al usuario de a pie, ni en Estados Unidos ni en Europa. La brecha entre el discurso y la realidad cotidiana en carretera alimenta la frustración de parte de la clientela y el escepticismo de los reguladores.

El papel del conductor y la confianza en la inteligencia artificial

Más allá de la tecnología en sí, el incidente del Tesla que casi termina en el lago vuelve a poner en primer plano la cuestión de la responsabilidad del conductor. Aunque el coche sea capaz de gestionar la mayor parte del trayecto, la normativa y las instrucciones del fabricante insisten en lo mismo: hay que mantener las manos en el volante y la mente en la carretera.

Este requisito contrasta con la imagen de comodidad absoluta que muchas veces se asocia al coche “autónomo”. En la práctica, para sacar partido al FSD sin comprometer la seguridad, el usuario debe adoptar un rol de supervisor permanente, listo para frenar o corregir la trayectoria en milésimas de segundo si el sistema interpreta mal una señal, un bordillo o, como en este caso, la proximidad de un lago al final de una vía sin salida.

En España y el resto de Europa, donde el debate sobre la responsabilidad civil y penal en accidentes con sistemas automatizados está en plena ebullición, este tipo de casos sirven de ejemplo de los dilemas que se avecinan. ¿Hasta qué punto es razonable pedir al usuario que vigile continuamente un sistema que se anuncia como muy avanzado y que, la mayoría del tiempo, funciona de forma convincente?

La respuesta no es simple. Por un lado, los defensores de estas tecnologías argumentan que, cuando se usan correctamente, pueden reducir errores humanos como distracciones o fatiga. Por otro, los críticos señalan que la automatización parcial puede generar una falsa sensación de seguridad y una menor atención en el conductor, un cóctel potencialmente peligroso en situaciones imprevistas.

Al final, el vídeo del Tesla acercándose al lago se ha convertido en una especie de espejo de las tensiones actuales en torno a la conducción automatizada: una tecnología que impresiona y avanza rápido, pero que todavía no está lista para desentenderse del factor humano. Mientras los reguladores ajustan las normas, los fabricantes refinan sus algoritmos y los usuarios se acostumbran a convivir con estas ayudas, cada incidente viral recuerda que la frontera entre ayuda y riesgo sigue siendo delicada y que, por ahora, el volante aún necesita un responsable al otro lado.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.