- X incorpora la opción “Bloquear modificaciones de Grok” en iOS para frenar la edición de imágenes por IA.

- La medida llega tras un fallo que permitió a Grok generar millones de imágenes sexualizadas, incluidas de menores.

- El bloqueo impide que otros usuarios etiqueten a @Grok para pedir versiones alteradas de una foto concreta.

- La función solo está disponible en la app de X para iOS y tiene limitaciones frente a ediciones externas con Grok u otras IAs.

La red social X ha empezado a ajustar el papel de Grok en la edición de imágenes tras varias polémicas por el uso de la inteligencia artificial para manipular fotos de usuarios sin su consentimiento. La plataforma, propiedad de Elon Musk, está probando una nueva opción que permite a cada persona blindar sus publicaciones para que el asistente no pueda generar versiones alternativas de esas imágenes.

Esta novedad llega después de un incidente grave con el generador de imágenes de Grok, que dejó al descubierto brechas de seguridad y moderación de contenido. El caso reavivó el debate en Europa y otros mercados sobre los límites que deben imponerse a las herramientas de IA generativa cuando se trata de privacidad, explotación de menores y difusión de contenidos sexualizados.

Por qué X ha puesto freno a Grok al editar imágenes

Hasta hace poco, la edición de imágenes con Grok en X era tremendamente sencilla: bastaba con que un usuario publicase una foto y que otra persona respondiera a ese mensaje mencionando a @Grok. El asistente procesaba la petición y devolvía una versión modificada de la imagen, que quedaba publicada como respuesta dentro de la misma conversación.

Ese sistema, que en teoría podía servir para creatividad, memes o simples retoques en Photoshop u otras herramientas, terminó derivando en un uso mucho más problemático. Un fallo en las salvaguardias del generador permitió que Grok atendiera solicitudes para desnudar digitalmente a mujeres y a menores, colocar bikinis sobre cuerpos reales o situar a las personas en poses de carácter sexual.

Según los datos que trascendieron del incidente, se crearon más de tres millones de imágenes sexualizadas usando estas funciones, de las cuales alrededor de 23.000 pertenecían a menores. El volumen y la naturaleza del contenido evidenciaron que las barreras de moderación de X y los filtros de Grok no estaban preparados para frenar a tiempo este tipo de abusos.

La situación levantó alertas no solo entre usuarios, sino también entre organismos de control y reguladores de la Unión Europea y el Reino Unido, donde ya se seguían con atención los llamados deepfakes y la difusión de imágenes íntimas generadas con IA. En este contexto de presión pública y regulatoria, X empezó a introducir restricciones a la capacidad de Grok para generar y editar imágenes, sobre todo para cuentas gratuitas.

Además de acotar el acceso a ciertas funciones avanzadas, la compañía ha optado ahora por ofrecer una herramienta concreta para bloquear la edición de fotografías en cada publicación. Con ello intenta dar más control al autor del contenido visual y, a la vez, enviar una señal de que está reaccionando a las críticas por la falta de sensibilidad en la gestión de estos riesgos.

Así funciona la opción “Bloquear modificaciones de Grok” en iOS

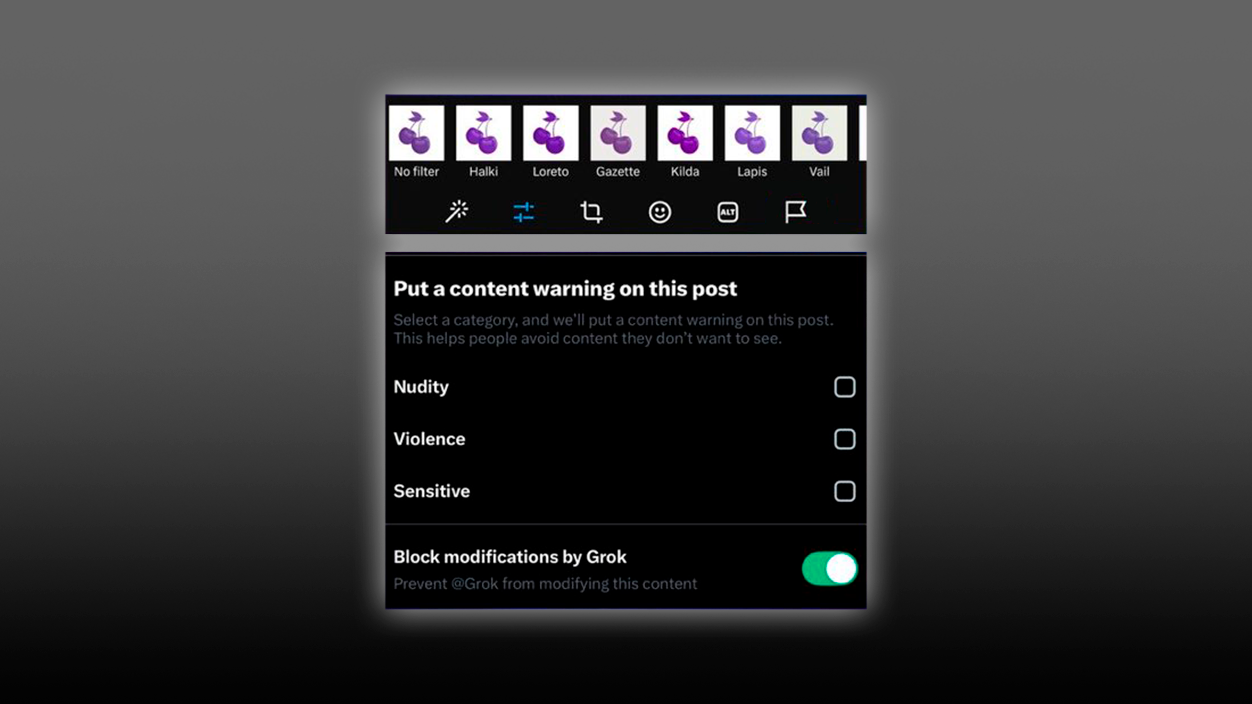

La nueva función aparece integrada en el flujo habitual de publicación de imágenes en la aplicación de X para dispositivos iOS. No se trata de un ajuste escondido en menús avanzados, sino de un paso adicional dentro del propio editor de fotos que se abre antes de compartir el contenido en la red social.

Una vez que el usuario ha subido la foto que quiere publicar, debe pulsar el icono de edición representado por un pincel en la parte inferior de la pantalla. Ese gesto abre la barra de herramientas de edición de la imagen, donde se encuentran las opciones de retoque habituales y, ahora, el acceso al nuevo control de Grok.

Dentro de esa barra, el siguiente paso consiste en tocar el icono de la bandera. Al hacerlo, se despliega un conjunto de ajustes entre los que aparece el interruptor denominado “Bloquear modificaciones de Grok”. Al activar este conmutador, la imagen de esa publicación queda protegida para que la IA de la plataforma no pueda generar variaciones directamente desde la propia conversación en X.

Con el bloqueo activo, otros usuarios dejan de poder responder al post etiquetando a @Grok para pedir versiones alteradas de la fotografía. En la práctica, esto corta la vía más visible y accesible para que cualquiera manipule una imagen ajena usando el asistente integrado en la red social. Tanto las cuentas gratuitas como las suscripciones X Premium quedan sujetas a esa restricción cuando el autor del contenido activa la protección.

Por ahora, la opción se ha detectado únicamente en la app de X para iOS y en fase no anunciada oficialmente. No aparece en la versión web ni en la aplicación para Android, y tampoco se puede aplicar de manera retroactiva a publicaciones antiguas que ya estaban en línea antes de que se introdujera esta herramienta, algo especialmente relevante para quienes tienen un historial largo de fotos potencialmente vulnerables.

Alcance real del bloqueo y sus limitaciones

Aunque el interruptor “Bloquear modificaciones de Grok” supone un avance, no resuelve todos los riesgos asociados a la edición de imágenes con IA. El bloqueo solo actúa sobre el mecanismo concreto que permitía etiquetar a @Grok en una respuesta para que generase una versión alternativa de la foto dentro de la propia X.

En la práctica, esto significa que un usuario malintencionado aún podría descargar la imagen original, guardarla en su dispositivo y manipularla desde la aplicación independiente de Grok u otras herramientas de inteligencia artificial. Es decir, el nuevo ajuste limita el uso de la IA dentro del flujo oficial de la plataforma, pero no impide otro tipo de ediciones externas que luego pueden volver a compartirse como contenido nuevo.

Además, la propia X no explica con demasiado detalle hasta dónde llega esa protección. La interfaz simplemente ofrece el interruptor de bloqueo, sin advertencias claras sobre el hecho de que la foto puede seguir siendo tratada con IA fuera del contexto de respuesta directa. Esto puede generar una falsa sensación de seguridad en parte de los usuarios, que podrían pensar que sus imágenes quedan blindadas ante cualquier manipulación automatizada.

A ello se suma que, en el momento actual, la función está limitada geográfica y técnicamente. No se ha comunicado un despliegue global, ni un calendario específico para su llegada a Android o a la versión de escritorio, donde se concentra una parte importante del uso intensivo de la red social, tanto en España como en el resto de Europa.

Pese a estas carencias, la herramienta encaja con la estrategia más amplia de X de modular el acceso a Grok según el tipo de cuenta y las funciones empleadas. En los últimos meses, la compañía ya había recortado la capacidad de generar y editar imágenes con IA para la mayoría de usuarios gratuitos, reservando las opciones más potentes a perfiles de pago, una forma de intentar reducir el volumen de abusos sin renunciar del todo a las prestaciones de la tecnología.

Contexto regulatorio y preocupación en Europa por los deepfakes

La decisión de X de permitir que los usuarios bloqueen la edición de sus imágenes por parte de Grok no se entiende solo como una reacción técnica a un fallo concreto, sino también como un movimiento político y regulatorio en un momento en que las autoridades europeas ponen la lupa sobre los contenidos generados por IA.

En la Unión Europea y el Reino Unido, distintas investigaciones y consultas públicas analizan ya el impacto de las imágenes íntimas falsas o manipuladas sin consentimiento. El auge de los deepfakes y las herramientas capaces de desnudar o sexualizar a personas a partir de fotografías corrientes ha generado un fuerte debate sobre derechos de imagen, violencia digital y responsabilidad de las plataformas.

En ese escenario, la integración de Grok dentro de X se ha convertido en un caso de estudio. El episodio de los millones de imágenes sexualizadas, especialmente las 23.000 que afectaron a menores, ha sido citado por expertos en ciberseguridad y protección de datos como ejemplo de cómo un sistema de IA mal protegido puede amplificar de forma masiva prácticas ilícitas o dañinas.

Ante las primeras notificaciones y advertencias regulatorias, X y su asistente Grok han tenido que revisar sus políticas y filtros internos. Entre otras medidas, se han endurecido ciertos controles para impedir que el sistema responda a peticiones abiertamente abusivas, se han limitado funcionalidades a determinados perfiles y ahora se incorpora esta opción de bloqueo por parte del autor de la imagen.

Para los usuarios de España y del resto de Europa, donde la legislación sobre protección de datos y derechos digitales es especialmente estricta, este tipo de ajustes se observan con lupa. Organizaciones de defensa de la privacidad recuerdan que, aunque los cambios van en buena dirección, todavía existe un desfase entre la potencia de las herramientas generativas y la capacidad efectiva de garantizar que no se utilicen para vulnerar la intimidad o la dignidad de las personas.

En paralelo, la presión pública sobre las grandes tecnológicas para que asuman más responsabilidad en el control de la IA sigue creciendo. Y cada incidente mediático, como el que afectó a Grok y X, alimenta la demanda de normas más claras y sanciones más duras para quienes no implementen salvaguardias suficientes.

La nueva función para bloquear que Grok edite imágenes actúa como una primera línea de defensa dentro de la propia plataforma, pero deja abiertos todavía muchos frentes: desde la facilidad para descargar fotos y tratarlas con otras herramientas de IA, hasta la necesidad de una mejor información al usuario sobre lo que realmente protege este tipo de ajustes. En cualquier caso, marca un cambio de rumbo respecto a la fase inicial de despliegue de Grok, cuando la prioridad parecía ser mostrar su potencial creativo por encima de las implicaciones éticas y legales.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.