- YouTube amplia su sistema de detección de deepfakes generados con IA a políticos, funcionarios y periodistas, más allá del programa de socios.

- La herramienta funciona de forma similar a Content ID, pero enfocada en rostros y voces, y permite solicitar la retirada de vídeos.

- Cada caso se evalúa individualmente para equilibrar protección de la identidad y libertad de expresión, con excepciones para parodia y sátira.

- La medida llega en pleno debate regulatorio global sobre la IA generativa y la desinformación, con impacto directo en Europa y España.

El problema de los deepfakes en YouTube ha dejado de ser un asunto anecdótico para convertirse en una inquietud estructural dentro del debate público. Las tecnologías de inteligencia artificial generativa permiten fabricar vídeos que imitan rostros, voces y gestos con un realismo sorprendente, algo que multiplica el riesgo de campañas de desinformación y de suplantación de identidad, especialmente en contextos políticos y mediáticos.

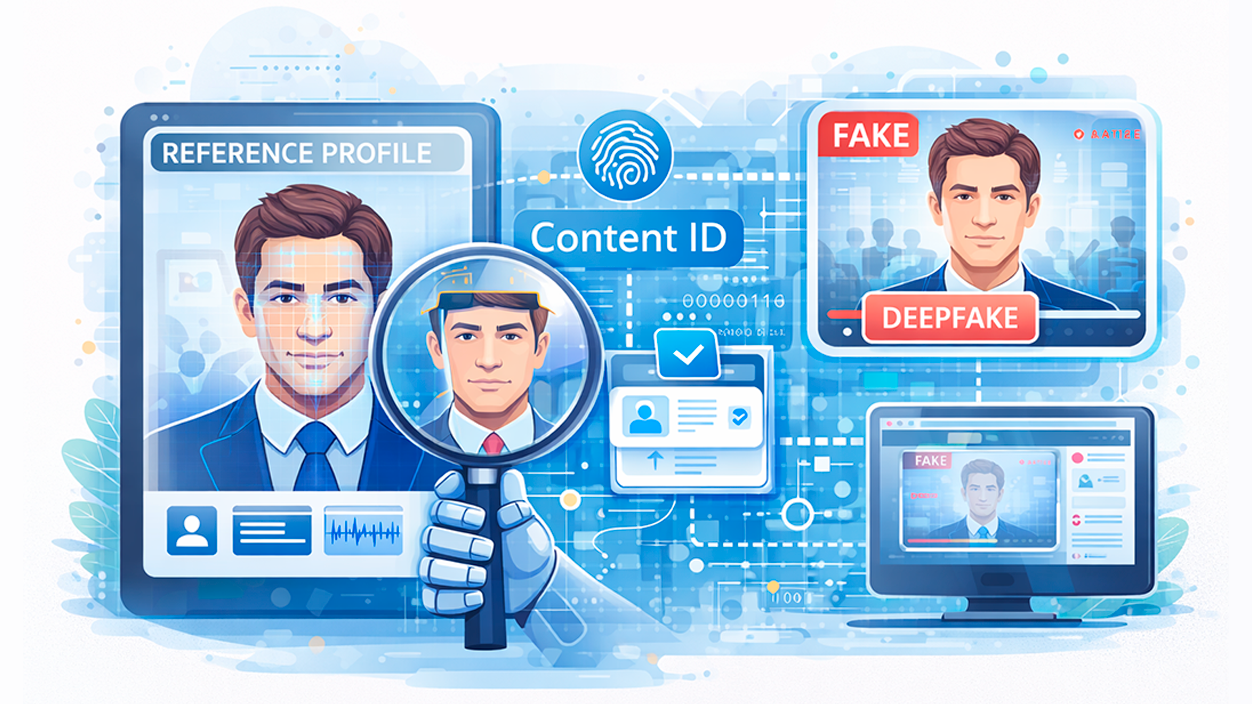

En este escenario, YouTube ha decidido ampliar de forma notable su herramienta de detección de semejanza generada por IA, un sistema pensado para identificar cuándo la imagen de una persona está siendo utilizada sin permiso en vídeos creados o manipulados mediante inteligencia artificial. Lo que empezó como una función reservada a creadores del programa de socios se está extendiendo ahora a políticos, responsables públicos y periodistas, considerados perfiles de alto riesgo por su influencia en la conversación social.

YouTube lleva su detección de deepfakes a figuras públicas de alto riesgo

La plataforma ha confirmado que el piloto de detección de deepfakes se abre a un nuevo grupo de usuarios: funcionarios gubernamentales, candidatos políticos y periodistas. Hasta ahora, la función estaba disponible principalmente para los integrantes del YouTube Partner Program, incluidos miles de creadores profesionales y algunas celebridades que habían sufrido suplantaciones mediante IA.

El movimiento llega en un momento especialmente sensible por el calendario electoral y la polarización informativa, también en Europa y España. Un vídeo falso en el que parezca que un candidato hace declaraciones inexistentes o que un periodista difunde mensajes manipulados puede influir en la agenda mediática en cuestión de horas.

Según explica la compañía, la herramienta permite a estas personas detectar contenido generado por IA que reproduzca su rostro o su voz sin consentimiento. Si consideran que ese vídeo vulnera su privacidad o puede causar un daño grave a su reputación, pueden iniciar una solicitud para que el material sea retirado de la plataforma.

Los portavoces de YouTube insisten en que la función se plantea como una medida de seguridad cívica, no como una vía para silenciar críticas. De hecho, la lista completa de políticos y periodistas que han sido invitados a participar en el programa piloto no se hace pública, en parte para evitar que la herramienta se convierta en un arma arrojadiza dentro de disputas partidistas.

Así funciona la detección de semejanza: el «Content ID» de los deepfakes

El sistema que YouTube está desplegando se inspira directamente en Content ID, la herramienta que la plataforma lleva años utilizando para identificar música, fragmentos de vídeo y otros contenidos protegidos por derechos de autor. La gran diferencia es que, en lugar de buscar coincidencias de audio o imagen estática, aquí el foco está en la identidad biométrica de la persona protegida.

Para poder utilizar esta protección, el usuario debe crear un perfil de referencia con su rostro (y, en algunos casos, su voz). En la práctica, esto implica subir un vídeo o una selfie de calidad y acompañarlo de un documento oficial de identidad. Es un proceso similar a la verificación que ya se exige en otros servicios digitales, pero en este caso el objetivo no es mostrar un sello público de cuenta verificada, sino activar el escaneo automático de coincidencias dentro de YouTube.

- Una vez verificada la identidad, la plataforma genera una huella digital biométrica de la persona.

- A partir de ahí, los sistemas de IA de YouTube analizan los nuevos vídeos que se suben en busca de rostros o voces que se parezcan de forma significativa al perfil registrado.

- Cuando se detecta una posible coincidencia, el vídeo se marca en las herramientas internas del usuario para que este pueda revisarlo.

- Si el afectado considera que se trata de un deepfake o de un uso no autorizado de su imagen, puede presentar una solicitud formal de eliminación.

En segundo plano, la compañía combina técnicas clásicas de reconocimiento (como el hashing para copias exactas) con modelos avanzados de IA capaces de identificar patrones típicos de contenido generado artificialmente, desde pequeñas anomalías en la geometría facial hasta movimientos poco naturales o síntesis de voz poco coherente con el vídeo original.

Además, Google ha ido incorporando marcadores digitales invisibles en algunos contenidos generados con sus propias herramientas, una especie de marca de agua que facilita rastrear el origen de un vídeo. Este tipo de señalización no resuelve por sí sola el problema de los deepfakes, pero añade una capa más de trazabilidad en un entorno donde la manipulación audiovisual es cada vez más accesible.

Quién puede acceder y qué requisitos impone YouTube

Hasta hace poco, solo los creadores que formaban parte del programa de socios tenían acceso a la detección de semejanza. Esa fase inicial sirvió para probar la tecnología con actores, deportistas y youtubers muy conocidos, que ya habían sufrido falsas entrevistas, anuncios o colaboraciones inventadas con IA.

Con la expansión anunciada, YouTube abre el sistema a tres grupos nuevos de forma prioritaria: funcionarios públicos, candidatos políticos en activo y periodistas. Se trata de colectivos que, según la compañía, están especialmente expuestos al uso malicioso de su imagen, tanto en campañas electorales como en contextos de desinformación más amplios.

El acceso, no obstante, no es automático. Para poder activar la protección, los interesados deben pasar por un proceso de verificación de identidad estricta, que incluye la subida de un vídeo o selfie reciente y la presentación de un documento oficial de identidad. Este paso pretende evitar que terceros se apropien de la identidad ajena para reclamar vídeos de forma abusiva.

YouTube insiste en que los datos recabados en ese proceso no se utilizan para entrenar los modelos de IA de Google, sino únicamente para la comprobación de identidad y el funcionamiento del sistema de detección. Aun así, la cesión de información biométrica a una gran plataforma tecnológica ya está generando debate en algunos círculos de privacidad y protección de datos, especialmente en la Unión Europea, donde el marco regulatorio es más exigente.

Por ahora, el sistema proactivo de detección sigue reservado a figuras con alta exposición pública. El resto de usuarios de YouTube continúa teniendo acceso a los mecanismos tradicionales de denuncia y privacidad para denunciar deepfakes o montajes lesivos, pero sin el escaneo automatizado y continuo que sí disfrutan los perfiles incluidos en el programa.

Detección no es igual a eliminación: el peso de la libertad de expresión

Uno de los matices clave del sistema es que la simple detección de un deepfake no implica su borrado inmediato. Cada solicitud presentada por una persona protegida se analiza de forma individual a la luz de las políticas de privacidad de la plataforma. Es decir, hay un filtro humano y normativo antes de que un vídeo desaparezca de YouTube.

La empresa remarca que no pretende eliminar toda pieza que use IA para recrear a una figura pública. Se contemplan excepciones explícitas para la parodia, la sátira política y otros formatos que, aun siendo incómodos para algunos implicados, forman parte de la libertad de expresión y del debate democrático. Un montaje exagerado de un líder mundial, claramente humorístico, podría seguir en línea aunque el sistema lo detecte y el protagonista pida su retirada.

Este enfoque responde en parte a la realidad de que no todos los deepfakes tienen intenciones maliciosas. Muchos se utilizan en clave de humor, crítica social o experimentación artística. De hecho, responsables de producto de YouTube han señalado que, entre celebridades y creadores que ya usan la herramienta, el volumen de peticiones de retirada ha sido muy bajo porque buena parte del contenido detectado resulta ser inofensivo o incluso beneficioso para su visibilidad.

Sin embargo, el escenario cambia cuando el foco se pone en cargos públicos y periodistas. En estos casos, un vídeo manipulado puede erosionar la confianza ciudadana, distorsionar procesos electorales o dañar gravemente la credibilidad de medios de comunicación. Es ahí donde la plataforma reconoce que la herramienta puede jugar un papel más crítico y donde sus decisiones serán observadas con lupa por campañas, organizaciones civiles y reguladores.

No todos los usuarios se benefician de este nivel de protección. Quienes no forman parte del programa de socios ni del grupo de figuras públicas cubiertas continúan dependiendo del sistema estándar de denuncias, que carece del componente de escaneo automático. Este desequilibrio entre la protección que reciben los perfiles con poder e influencia y la que obtiene un ciudadano corriente alimenta un debate creciente sobre la equidad en la gobernanza digital.

Etiquetas, nuevas funciones y contexto regulatorio en Europa

En paralelo a la detección de semejanza, YouTube mantiene su política de etiquetar los vídeos generados o alterados con IA. La ubicación de esos avisos no es siempre la misma: en algunos casos aparecen en la descripción, mientras que en contenidos considerados especialmente sensibles (por ejemplo, relacionados con elecciones o cuestiones cívicas) la etiqueta se muestra de forma más visible sobre el propio reproductor.

Responsables de la plataforma admiten que no todo uso de IA requiere el mismo nivel de advertencia. No es lo mismo un corto animado generado con un modelo de vídeo que una supuesta rueda de prensa de un ministro fabricada desde cero. Esa graduación del aviso se apoya en un criterio editorial y en la sensibilidad del tema tratado, lo que inevitablemente abre la puerta a discusiones sobre la coherencia y transparencia de estas decisiones.

De cara al futuro, YouTube estudia funcionalidades adicionales para endurecer la respuesta frente a los deepfakes más problemáticos. Entre las opciones que se barajan figuran impedir directamente la subida de ciertos vídeos antes de que se publiquen, si el sistema detecta infracciones claras, o permitir que las personas afectadas moneticen algunos contenidos en lugar de eliminarlos, en un modelo similar al de Content ID para derechos de autor.

La compañía también planea extender la detección más allá del rostro, hacia voces reconocibles y otros elementos de propiedad intelectual, como personajes emblemáticos o estilos muy característicos. Esta ampliación cobra sentido en un entorno en el que la clonación de voz es casi tan accesible como la manipulación de imagen, y donde una imitación sonora convincente puede ser tan dañina como un vídeo manipulado.

Todo este despliegue tecnológico se produce mientras avanza el debate regulatorio en torno a la IA generativa en Estados Unidos y la Unión Europea. YouTube ha mostrado su apoyo a iniciativas como la NO FAKES Act en EE. UU., que busca establecer un derecho federal sobre la propia imagen y la voz, y se presenta como modelo exportable a otros países. En Europa, el impulso del AI Act y otras normas sobre transparencia y moderación de contenidos apunta en la misma dirección: exigir a las grandes plataformas más claridad sobre cuándo un vídeo está generado por IA y qué herramientas se utilizan para combatir los abusos.

En países como España, donde la desinformación digital y la suplantación de cargos públicos han ido ganando peso en el debate, movimientos como el de YouTube se observan como una pieza adicional del puzle regulatorio y tecnológico. No resuelven por sí solos el problema de los deepfakes, pero marcan un estándar de actuación que otras redes y servicios de vídeo empiezan a replicar.

La apuesta de YouTube por ampliar la detección de deepfakes con IA muestra hasta qué punto la autenticidad digital se ha convertido en un elemento crítico de la vida pública online. Plataformas, legisladores y usuarios se mueven en un equilibrio delicado entre fomentar la creatividad y la innovación y frenar los usos más dañinos de la tecnología. Con su nueva herramienta orientada a políticos, funcionarios y periodistas, YouTube da un paso más en esa dirección, aunque quedan abiertas preguntas relevantes sobre quién recibe protección prioritaria, cómo se toman las decisiones de retirada y qué margen real tienen los ciudadanos de a pie para defender su identidad frente a montajes cada vez más creíbles.

Soy un apasionado de la tecnología que ha convertido sus intereses «frikis» en profesión. Llevo más de 10 años de mi vida utilizando tecnología de vanguardia y trasteando todo tipo de programas por pura curiosidad. Ahora me he especializado en tecnología de ordenador y videojuegos. Esto es por que desde hace más de 5 años que trabajo redactando para varias webs en materia de tecnología y videojuegos, creando artículos que buscan darte la información que necesitas con un lenguaje entendible por todos.

Si tienes cualquier pregunta, mis conocimientos van desde todo lo relacionado con el sistema operativo Windows así como Android para móviles. Y es que mi compromiso es contigo, siempre estoy dispuesto a dedicarte unos minutos y ayudarte a resolver cualquier duda que tengas en este mundo de internet.