- DGX Spark integra el superchip GB10 Grace Blackwell con 128 GB de memoria unificada para cargas intensivas de IA de escritorio.

- DGX OS, junto con el DGX Dashboard, simplifica la configuración inicial, las actualizaciones y la monitorización del sistema.

- Docker, NVIDIA Container Runtime y TensorRT permiten desplegar modelos como YOLO26 con un rendimiento de inferencia muy elevado.

- Seguir buenas prácticas de monitorización, gestión de memoria y uso de FP16/INT8 maximiza el aprovechamiento del hardware.

¿Tienes un NVIDIA DGX Spark y te preguntas cómo sacarle partido desde el primer minuto? Este pequeño “cubo” esconde una potencia digna de un centro de datos en formato de sobremesa, pero para aprovecharlo bien conviene tener clara la configuración inicial, las opciones de acceso y las mejores prácticas de rendimiento. En este artículo te explicamos cómo completar la configuración inicial del DGX Spark de NVIDIA paso a paso y sin errores.

Todo, desde la puesta en marcha del DGX Spark y la configuración del sistema, hasta el acceso local y remoto. Sin olvidarnos del uso de Docker y TensorRT y algunas pautas para que no se te escape nada importante de DGX OS ni de las herramientas de monitorización.

Qué es exactamente NVIDIA DGX Spark y para quién está pensado

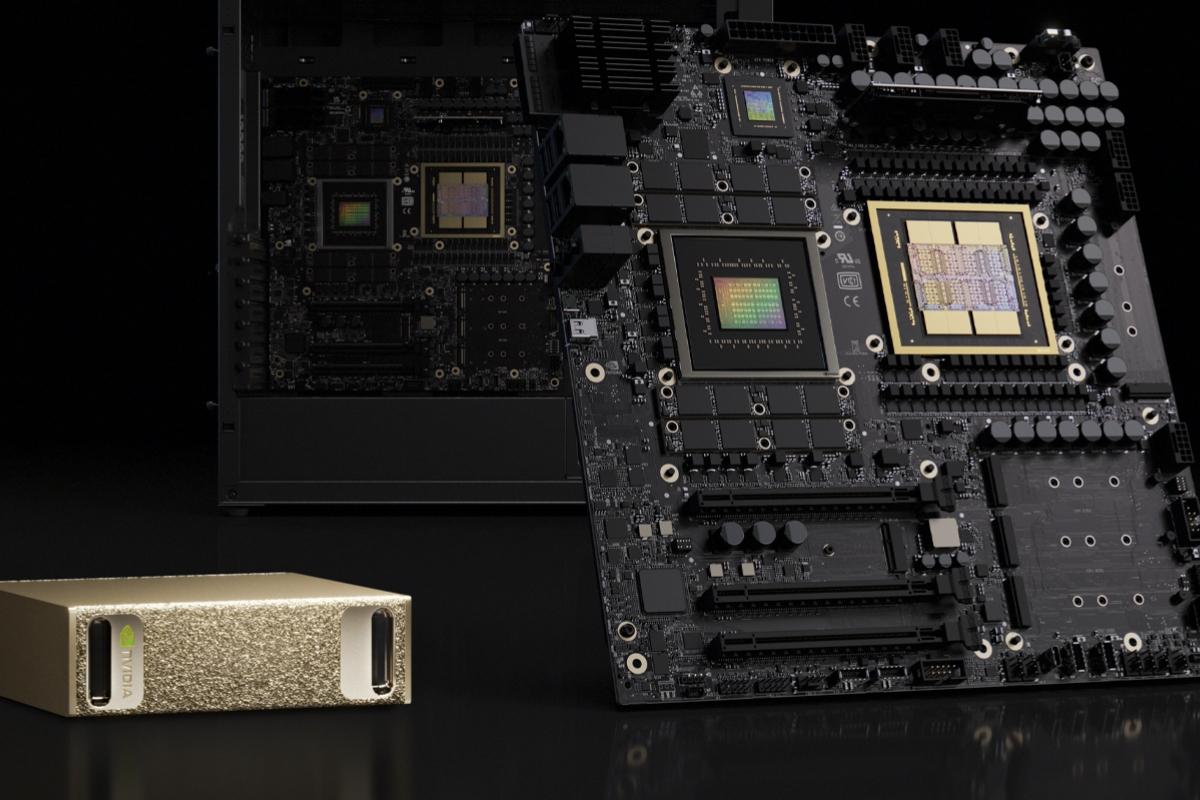

NVIDIA DGX Spark es una especie de “superordenador de IA de escritorio” que integra el superchip NVIDIA GB10 Grace Blackwell en un formato ultracompacto, de unos 150 mm × 150 mm × 50,5 mm y apenas 1,2 kg de peso. En la práctica, esto significa que puedes llevarte al cliente, a la oficina o a tu casa una máquina con rendimiento de IA de centro de datos.

La combinación de CPU Grace y GPU Blackwell permite alcanzar hasta 1 petaFLOP de potencia de cómputo de IA en precisión FP4, más que suficiente para ejecutar inferencia local de modelos gigantescos, de hasta unos 200.000 millones de parámetros, y para afinar (fine-tuning) modelos de hasta unos 70.000 millones de parámetros en una sola unidad.

Además del músculo de cálculo, lo que marca la diferencia es su memoria y conectividad. El DGX Spark incorpora 128 GB de memoria unificada LPDDR5x compartida entre CPU y GPU, con un bus de 256 bits, frecuencia en torno a 4266 MHz y un ancho de banda cercano a los 273 GB/s, lo que evita el clásico trasiego de datos entre memoria del sistema y de la GPU.

En cuanto a almacenamiento, el sistema puede montarse con 1 TB o 4 TB de NVMe M.2 con autocifrado, ampliable con unidades externas por USB-C. A nivel de red y puertos físicos, incluye 1x RJ-45 a 10 GbE, una tarjeta de red inteligente ConnectX-7, Wi-Fi 7, Bluetooth 5.4, cuatro puertos USB Tipo-C, un HDMI 2.1a y salida de audio multicanal por HDMI. Para vídeo integra un motor NVENC y un motor NVDEC, lo que facilita tanto la codificación como la decodificación acelerada por hardware.

Todo esto lo hace ideal para desarrolladores de IA, investigadores, científicos de datos e ingenieros de ventas técnicas que necesiten entrenar, ajustar y desplegar modelos localmente, así como hacer demos en vivo con modelos de lenguaje grandes o sistemas de visión por computador avanzados.

DGX OS y el panel de control DGX Dashboard

La base de software del sistema es DGX OS, una distribución Linux personalizada por NVIDIA pensada específicamente para cargas de trabajo de IA, machine learning y análisis avanzado. No es un Ubuntu “pelao”, sino una versión tuneada y probada a fondo para que todo el hardware del DGX Spark funcione desde el primer arranque.

DGX OS aporta una plataforma robusta, estable y mantenida, con controladores NVIDIA preinstalados y configurados, optimizaciones del kernel, herramientas de gestión y un calendario de actualizaciones relativamente previsible: suele haber dos grandes releases al año (aproximadamente en febrero y agosto), reforzadas con parches de seguridad entre medias.

Otro punto clave es el DGX Dashboard, un panel de control integrado al que puedes acceder una vez que el sistema está en marcha. Desde este panel puedes vigilar el estado del sistema en tiempo real, instalar actualizaciones, modificar ajustes básicos como el nombre del equipo y, además, acceder a un entorno de JupyterLab para trabajar con notebooks locales sin complicarte la vida.

El Dashboard se convierte, en la práctica, en el centro neurálgico para monitorizar las métricas operativas, gestionar el software y lanzar tus primeros experimentos sin necesidad de tirar de terminal para todo.

Qué viene en la caja y modos de funcionamiento

Cuando desempaquetas el equipo te encontrarás con la unidad principal DGX Spark, el cable de alimentación de CA, el adaptador de corriente USB-C y una guía de inicio rápido. Esa guía impresa es más importante de lo que parece, porque lleva pegada la información para el modo de configuración por red, incluyendo el SSID y la contraseña del punto de acceso Wi-Fi que crea el propio Spark en el primer arranque.

El sistema admite dos formas de trabajo desde el inicio: un modo independiente, con monitor, teclado y ratón conectados directamente, y un modo tipo “appliance de red”, en el que haces la configuración inicial desde otro equipo a través de la red local usando un navegador web.

En modo independiente, lo suyo es conectar un monitor por HDMI, un teclado y un ratón (USB o Bluetooth), enchufar el adaptador de corriente a la toma USB-C situada más a la izquierda y pulsar el botón de encendido. No es un detalle menor: NVIDIA indica claramente que se debe usar ese puerto específico para la alimentación.

En el modo “headless” o de red, el DGX Spark actúa inicialmente como punto de acceso Wi-Fi con SSID y clave propios. Te conectas a esa red desde otro equipo, abres el navegador y entras en la URL de configuración que viene en la guía rápida. Desde ahí puedes completar el asistente de primer arranque sin necesidad de tener pantalla ni teclado enganchados al DGX Spark.

Asistente de primer arranque y configuración inicial

La primera vez que arrancas el DGX Spark, se lanza automáticamente un asistente de configuración inicial que guía todo el proceso. El objetivo de este asistente es dejar el sistema completamente preparado con tu idioma, tu usuario, tu conexión de red y la imagen de software completa descargada e instalada.

Lo primero que verás será la selección de idioma y zona horaria. A medida que escribes, los campos se van filtrando, lo que facilita encontrar rápidamente, por ejemplo, “Madrid” o “Barcelona”. Después aparece la elección de distribución de teclado, pero solo si estás usando un monitor local; si haces la configuración en modo red, ese paso no aparece tal cual.

Tras eso, llega la parte legal: es necesario leer y aceptar el acuerdo de licencia de NVIDIA para continuar, algo que se solventa con un clic en Aceptar. A continuación, el asistente te pedirá que crees una cuenta de usuario local con nombre y contraseña, que será la que uses para iniciar sesión en el sistema de forma habitual.

Hay también una sección de participación voluntaria en el programa de mejora de la experiencia de usuario. Puedes decidir si enviar o no datos de uso y telemetría a NVIDIA; si no te interesa, basta con desmarcar la opción.

El siguiente bloque está dedicado a la conectividad. Si tienes el equipo conectado por Ethernet con acceso a Internet, el paso de selección de Wi-Fi se omite automáticamente. De lo contrario, tendrás que elegir una red Wi-Fi, introducir la contraseña y esperar a que el sistema se conecte. Una vez en línea, el DGX Spark descarga e instala la imagen completa de DGX OS.

Esta descarga e instalación puede llevar un buen rato, y es crucial no apagar ni reiniciar el equipo durante el proceso. El sistema puede reiniciarse varias veces por su cuenta y, si estás configurando a través de la red desde otro ordenador, puede que te quedes sin acceso temporalmente mientras se aplica la actualización.

Cuando todo termina, el DGX Spark reinicia, aparece la pantalla de inicio de sesión y ya puedes entrar con el usuario que acabas de crear. Te encontrarás con un escritorio DGX Spark limpio, con Docker, CUDA, controladores y herramientas básicas ya listos para empezar a trabajar.

Comprobaciones básicas del sistema tras la instalación

Tras el primer inicio de sesión, lo recomendable es hacer un rápido chequeo del sistema desde la terminal para confirmar que todo está en orden. Puedes abrir la consola pulsando Ctrl + Alt + T o buscando «Terminal» en el menú de aplicaciones.

Para revisar la CPU, basta con ejecutar lscpu, lo que mostrará información detallada de la CPU Grace, el número de núcleos (20, repartidos entre 10 Cortex-X925 y 10 Cortex-A725) y las capacidades de la arquitectura ARM64 que monta el DGX Spark.

En cuanto al almacenamiento, puedes usar lsblk para listar las particiones y capacidades. Verás la unidad NVMe principal, que en los modelos de 4 TB se muestra como unos 3,7 TB por el clásico tema de la diferencia entre gigabytes decimales y gibibytes binarios.

Para verificar la GPU y su estado, el comando clave es nvidia-smi. Ahí se muestra la GPU GB10 Grace Blackwell, la memoria disponible, la versión de los controladores y, si hay procesos de cómputo activos, qué aplicaciones están haciendo uso de la GPU en ese momento.

También conviene comprobar qué versiones de Docker y CUDA vienen preinstaladas. Con docker -v puedes ver la versión del motor Docker, y con nvcc -V obtendrás la información de la versión de CUDA configurada en el sistema DGX Spark.

Actualización de DGX OS y uso de la ISO de instalación

Para tener el sistema al día, NVIDIA ofrece dos vías principales de actualización de DGX OS: a través de la aplicación gráfica de actualizaciones de software o mediante la terminal con las herramientas de gestión de paquetes habituales (apt).

Si optas por la parte gráfica, puedes ir a Mostrar aplicaciones, luego Configuración del sistema y, dentro, abrir «Actualizaciones de software». Desde allí se descargan e instalan nuevos paquetes, parches de seguridad y actualizaciones de sistema. Al terminar, bastará con reiniciar el equipo para que todo quede aplicado.

Si prefieres la terminal, abre una consola y ejecuta primero sudo apt update para refrescar la lista de paquetes disponibles. Después, con sudo apt upgrade, se actualizan los paquetes instalados en base a esa información. Durante el proceso se te pedirá la contraseña de administrador y que confirmes la actualización respondiendo con Y cuando se solicite. Al concluir, es recomendable reiniciar la máquina.

En el caso de que quieras hacer una instalación limpia desde cero, NVIDIA proporciona una imagen ISO de DGX OS específica para DGX Spark. El proceso típico consiste en arrancar desde una memoria USB con esa ISO y usar el menú GRUB para seleccionar la opción de instalación adecuada, como por ejemplo “Instalar DGX OS 7.2.1 para DGX Spark”. La instalación suele tardar alrededor de 25-30 minutos.

Antes de arrancar desde el USB, es buena idea ejecutar sudo sync en el sistema desde el que crees la memoria para asegurarte de que se han vaciado los buffers de escritura. Luego, en el equipo DGX, se conecta el USB, se enciende y se pulsa F7 cuando aparezca el logotipo de Dell para elegir el dispositivo de arranque correspondiente a la unidad flash.

Si la instalación desde la unidad de recuperación da problemas, se recomienda verificar la integridad del archivo ISO mediante la suma de comprobación MD5. En Windows puedes usar el comando de PowerShell Get-FileHash con algoritmo md5, y en Linux la utilidad md5sum. Si la suma calculada no coincide con la publicada por NVIDIA, habrá que descargar la ISO de nuevo y recrear el USB.

Acceso remoto por SSH y otros métodos

Más allá del uso en modo escritorio, una forma habitual de trabajar con DGX Spark es a través de acceso remoto por SSH, herramientas de sincronización o escritorios remotos. DGX OS incluye de serie un servidor OpenSSH, así que no hay que instalarlo a mano.

Para conectar por SSH, primero necesitas saber la dirección IP del DGX Spark en tu red local. Desde la terminal, puedes usar el comando ip a para listar las interfaces y localizar la IP asignada por DHCP o la que hayas configurado manualmente.

Con esa IP en la mano, ya puedes usar tu cliente SSH favorito desde otro equipo: PuTTY, MobaXterm, XShell, FinalShell o el propio comando ssh en Linux y macOS. Normalmente solo tendrás que introducir la IP, el puerto por defecto 22, tu usuario y tu contraseña. La primera vez se te pedirá que aceptes la clave del host, algo que puedes confirmar para que quede guardada.

Además de SSH, hay herramientas como NVIDIA Sync y opciones de escritorio remoto que permiten acceder a la interfaz gráfica o a determinados servicios del DGX Spark desde otro ordenador en la misma red. Esto es interesante si usas el Spark como “servidor de IA” y no quieres tenerlo siempre con pantalla y teclado conectados.

Docker, NVIDIA Container Runtime y grupos de usuarios

DGX Spark viene preparado para trabajar con contenedores desde el primer día. El sistema incluye Docker preinstalado, junto con NVIDIA Container Runtime y NVIDIA Container Toolkit, de forma que los contenedores pueden acceder a la GPU sin quebraderos de cabeza adicionales.

NVIDIA Container Runtime actúa como capa de integración entre Docker y la GPU, encargándose de exponer los dispositivos de GPU dentro de los contenedores, gestionar la selección de drivers y bibliotecas CUDA y soportar entornos con varias GPU, aunque en el Spark lo habitual es trabajar con el superchip GB10 como unidad principal.

Por debajo, NVIDIA Container Toolkit agrupa los componentes necesarios para que todo esto sea dinámico: configuración de dispositivos de GPU, inyección de librerías CUDA, integración con Docker y compatibilidad con plataformas de orquestación de contenedores de mayor nivel, si en algún momento quieres montar algo más complejo.

Por defecto, para ejecutar comandos Docker necesitas usar sudo. Si quieres lanzar contenedores sin tener que poner sudo todo el rato, puedes añadir tu usuario al grupo docker con el comando sudo usermod -aG docker $USER. Después de hacer esto, es recomendable cerrar sesión y volver a entrar o directamente reiniciar para que el cambio de grupo surta efecto.

Una vez configurado, es buena idea probar que Docker ve la GPU correctamente. Para ello, puedes ejecutar un contenedor de PyTorch desde nvcr.io/nvidia/pytorch:25.08-py3 usando algo como:

docker run –rm -it –gpus=all -v «$PWD»:/workspace -w /workspace nvcr.io/nvidia/pytorch:25.08-py3

Dentro de ese contenedor, si ejecutas nvidia-smi y nvcc -V, deberías obtener información coherente de la GPU y de CUDA. Si todo se ve normal, significa que la integración entre Docker y la aceleración por GPU en tu DGX Spark está funcionando como debe.

Instalación nativa de Ultralytics YOLO26 y dependencias

Si tu objetivo es usar DGX Spark como plataforma para visión artificial, una de las opciones más actuales es trabajar con Ultralytics YOLO26. Puedes hacerlo de dos maneras principales: tirando de una imagen Docker ya preparada o realizando una instalación nativa en DGX OS.

La ruta rápida es la de Docker. NVIDIA y Ultralytics proporcionan imágenes Docker precompiladas compatibles con la arquitectura ARM64 y CUDA 13, pensadas para funcionar tanto en Jetson AGX Thor (con JetPack 7.0) como en DGX Spark (con DGX OS). Esto simplifica mucho la vida si no quieres pelearte con dependencias.

Si prefieres instalación nativa sin contenedor, el proceso pasa por actualizar la lista de paquetes del sistema, instalar y actualizar pip y, a continuación, instalar el paquete ultralytics con sus dependencias opcionales para poder exportar modelos a formatos alternativos.

Durante esta instalación se arrastran también paquetes como Torch y Torchvision. Sin embargo, las versiones que llegan vía pip pueden no estar 100 % optimizadas para la arquitectura ARM64 del DGX Spark con CUDA 13, por lo que se recomienda instalar versiones específicas de PyTorch y Torchvision que hayan sido compiladas con soporte completo para esa combinación de hardware y software.

En este contexto, se ha documentado un aviso relacionado con la compatibilidad ARM64 que, afortunadamente, ya tiene corrección enviada al repositorio principal de PyTorch (PR #164590) y se integrará en la versión 2.10. Mientras tanto, el mensaje puede ignorarse con seguridad porque no impide el funcionamiento normal, aunque conviene revisar la documentación de Ultralytics y de PyTorch para seguir las recomendaciones de versiones exactas.

ONNX Runtime GPU en ARM64 y exportación de modelos

Para algunos flujos de trabajo de exportación y despliegue, además de PyTorch y TensorRT, vas a necesitar onnxruntime-gpu. Aquí aparece un matiz importante: el paquete onnxruntime-gpu que se publica en PyPI no incluye actualmente binarios precompilados para arquitecturas aarch64 como la del DGX Spark.

Eso obliga a instalar onnxruntime-gpu de forma manual, usando el paquete adecuado para ARM64 y la versión de Python presente en DGX OS. En el caso típico documentado, se trata de onnxruntime-gpu 1.24.0 con soporte para Python 3.12. Puedes descargar el paquete desde los repositorios oficiales y luego instalarlo con pip apuntando al archivo concreto.

Disponer de onnxruntime-gpu operativo resulta útil cuando quieres probar exportaciones a ONNX y compararlas con otros formatos (por ejemplo, para benchmarks de inferencia), aunque la recomendación principal en DGX Spark suele centrarse en TensorRT como formato final de despliegue.

Uso de TensorRT en DGX Spark con YOLO26

Entre todos los formatos de exportación de modelos que soporta Ultralytics (PyTorch, TorchScript, ONNX, OpenVINO y otros), TensorRT es el que mayor rendimiento de inferencia proporciona sobre el hardware NVIDIA, y en particular sobre la arquitectura Blackwell del DGX Spark.

El flujo típico consiste en partir de un modelo YOLO26 entrenado en formato PyTorch (por ejemplo, YOLO26n u otras variantes) y usar la funcionalidad de exportación de Ultralytics para generar un motor TensorRT optimizado. En este proceso puedes ajustar parámetros como el tamaño de entrada, el batch size o la precisión numérica (FP32, FP16, INT8) en función de tus necesidades.

En el DGX Spark, lo habitual es buscar el equilibrio entre rendimiento y precisión habilitando FP16 o incluso INT8 cuando el caso de uso lo permite. Estas precisiones reducidas aprovechan a fondo los Tensor Cores de quinta generación de Blackwell y permiten multiplicar los FPS de inferencia, especialmente cuando aumentas el tamaño de lote.

Una vez convertido el modelo, la inferencia con TensorRT puede ejecutarse desde scripts de Python o desde contenedores dedicados, integrando el motor en tu aplicación. Ultralytics ofrece ejemplos y una guía específica de integración con TensorRT donde se explica cómo cargar el engine, preparar los tensores de entrada/salida y medir el rendimiento en diferentes configuraciones.

Benchmarks de la familia YOLO11 en DGX Spark

Aunque la guía está centrada en YOLO26, es interesante echar un vistazo a los benchmarks realizados por Ultralytics con la familia YOLO11 en DGX Spark, ya que sirven de referencia del tipo de rendimiento que puedes esperar con modelos modernos de detección.

Los tests se han ejecutado en múltiples formatos de modelo: PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN y ExecuTorch, siempre con precisión FP32 y un tamaño de imagen de entrada de 640 píxeles por defecto.

La tabla comparativa interna refleja resultados para cinco variantes diferentes (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) e incluye información sobre estado del modelo, tamaño, mAP50-95(B) y tiempo de inferencia por formato. De nuevo, TensorRT destaca claramente por ofrecer la mejor combinación de velocidad y precisión, lo que refuerza la recomendación de usarlo como destino principal de exportación.

Si quieres reproducir estos resultados en tu propio DGX Spark, Ultralytics proporciona scripts que automatizan la exportación y medición de todos esos formatos. Lo normal es que puedas adaptar esos ejemplos a YOLO26 e incluso a tus propios modelos personalizados con unos pequeños cambios de configuración.

Con todo esto bien configurado —desde el asistente inicial, pasando por DGX OS y Docker, hasta TensorRT y las herramientas de monitorización— el DGX Spark se convierte en una plataforma extremadamente versátil para experimentar, prototipar y desplegar soluciones de IA avanzadas sin depender continuamente de un centro de datos remoto.

Redactor especializado en temas de tecnología e internet con más de diez años de experiencia en diferentes medios digitales. He trabajado como editor y creador de contenidos para empresas de comercio electrónico, comunicación, marketing online y publicidad. También he escrito en webs de economía, finanzas y otros sectores. Mi trabajo es también mi pasión. Ahora, a través de mis artículos en Tecnobits, intento explorar todas las novedades y nuevas oportunidades que el mundo de la tecnología nos ofrece día a día para mejorar nuestras vidas.